电气设备长期运行后,会受到多种因素的影响,从而导致电气设备出现异常发热。红外成像技术作为对设备热故障进行检测的一种有效手段,已经在电力领域中被广泛应用[1-2]。由于不同设备的发热缺陷判断标准有所差异,因此准确检测出电气设备类型是开展电气设备发热缺陷检测工作的前提。传统的红外图像检测手段主要依赖人工和专家经验,这种方法效率低下。随着深度学习技术的持续进步,基于卷积神经网络CNN的目标检测算法在图像识别领域取得了显著成果,为电气设备红外图像识别开辟了新的途径。基于深度学习的目标检测算法包括RCNN[3]、Fast RCNN[4]、Faster RCNN[5]、SSD[6] 、YOLO系列[7-11]等。Cheng等[12]对Fast RCNN算法进行改进后用于电力设备红外图像检测,具有较好的鲁棒性和泛化能力。王勋等[13]将R-FCN模型分别与两种不同大小的卷积神经网络算法结合,识别精度达到0.914 3,但这些算法参数量较大,难以满足实时识别的需求。王永平等[14]采用YOLO v3算法,通过添加卷积模块、调整部分参数和改进损失函数以实现高压开关设备发热故障的检测,然而由于噪声等因素的干扰,使得训练所用的红外图像质量不高。李北明等[15]提出了一种基于特征蒸馏的改进Ghost-YOLOv5红外目标检测算法,提高了模型在红外数据集上的识别速度,但识别精度不高。Chen等[16]对YOLOv5网络进行优化,通过引入改进后的快速空间金字塔池化模块,解耦检测头和SCYLLA交并比损失,改善了复杂环境中安全绳挂钩的漏检、误检情况。Li等[17]引入跨阶段局部瓶颈模块和一个结合了YOLOv5算法的微小目标预测头来检测光伏电池板的缺陷,提高了模型在多尺度目标检测中的精度。目前,YOLO系列算法已发布多个版本,其中,YOLOv5是YOLO系列中性能较好的算法,具有较高的检测精度和检测速度。与其他版本相比,YOLOv5易于训练和部署,并且自带多种数据增强方法,有利于对红外图像进行检测。

本文针对收集到的电气设备红外图像质量较差以及已有算法对电气设备红外图像的识别精度不高等问题,对采集到的红外图像进行数据增强,同时提出一种电力设备红外图像检测算法Infrared-defect-YOLOv5,并进行了实验验证。

1 电气设备红外图像数据增强

在使用红外测温仪采集电气设备红外图像时,往往会受到工作环境和硬件缺陷等因素的干扰,使采集到的红外图像具有信噪比和对比度低以及特征不明显等缺点。

1.1 基于快速引导滤波的图像去噪

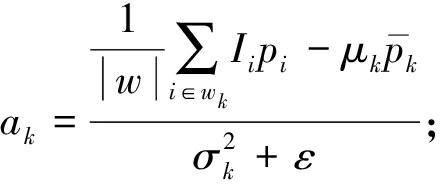

红外测温仪采集到红外图像中存在高斯噪声,常使用图像滤波技术对图像进行去噪,应用较多的滤波算法包括均值滤波、高斯滤波、双边滤波、快速引导滤波等,其中快速引导滤波[18]是最常用的边缘保护滤波算法之一。该算法利用局部线性模型思想,能够在图像滤波过程中保留电气设备图像中的边缘特征、设备纹理和细节信息。其滤波过程包含引导图像I、输入图像p和输出图像q,q和I呈线性关系,表达式如式(1)所示:

qi=akIi+bk,∀i∈wk。

(1)

式中:ak和bk为滤波窗口wk在像素k处的线性关系系数。算法原理是先将输入图像和引导图像进行下采样以降低算法的计算复杂度,然后将得到的引导图像的边缘特征和输入图像的颜色特征进行整合,得到输出图像q,当I和p为同一图像时,便能保持图像边缘信息。ak和bk可通过式(2)来求取,通过式(2)计算使得输出图像q和输入图像p的像素值差值最小,进而减少因滤波造成的原始图像失真。

(2)

式中:ε为正则化参数,可调节滤波效果。使用最小二乘法进行计算可求得ak和bk:

(3)

(4)

式中:定义滤波窗口wk内的像素总数为|w|;μk和![]() 分别代表引导图像I和输入图像p在该窗口内的平均像素值;σk表示引导图像在wk内的标准差。

分别代表引导图像I和输入图像p在该窗口内的平均像素值;σk表示引导图像在wk内的标准差。

快速引导滤波利用下采样与上采样操作将算法运行速度提高10倍以上,在保证图像质量的前提下可快速实现图像滤波。为了直观地观察不同滤波算法的优缺点,使用常用的4种滤波算法对添加噪声后的电流互感器红外图像进行滤波处理,滤波效果对比如图1所示。由图1可知,使用均值滤波和高斯滤波算法处理后的图像比较模糊,且边缘特征不显著;双边滤波与快速引导滤波算法的滤波结果差异不大,相较于前面两种方法,其滤波后的图像较为清晰;快速引导滤波算法与双边滤波算法相比,在边缘特征以及纹理细节等方面处理效果更优,对图像的处理速度更快。因此,本文采用快速引导滤波算法进行图像去噪。

图1 不同滤波算法滤波效果对比图

Figure 1 Filtering effect of different filtering alorithms comparison diagram

1.2 基于改进CLAHE的图像对比度增强

采集到的电气设备红外图像的对比度也较低,使得图像纹理特征不明显,因此需要对红外图像进行对比度增强处理。

本文采用限制对比度自适应直方图均衡化(contrast limited adaptive histogram equalization,CLAHE)算法来对图像进行对比度增强[19]。该算法通过设定图像阈值实现对对比度的有效控制,直方图中超出阈值的像素会被裁剪并均分到每个灰度级上,从而限制对比度过度增强。但是,直方图超出阈值的部分会被裁剪并均分,导致图像细节信息的丢失,不能对图像的边缘细节特征进行增强,同时,也可能存在图像亮度过度增加的问题。因此,本文通过引入Gamma函数校正来对CLAHE算法进行改进,Gamma函数可以对图像的对比度和亮度进行校正,通过控制校正系数γ来控制校正程度。在CLAHE算法中加入Gamma函数校正,可以在红外图像整体对比度提升的同时增强局部对比度,保持边缘和细节特征,具体步骤如下。

步骤1 将待处理的变电设备红外图像分割成M×N个连续、不重叠的子部分,一般取M=N=8。

步骤2 通过累积分布函数计算每个子部分的直方图,并根据每个子部分直方图来求取裁剪阈值T:

(5)

式中:C为裁剪系数,设定其值为3;Nx和Ny分别代表各个子部分在x轴和y轴方向上的像素数目;H代表灰度级数。

步骤3 对每个子部分的像素进行重新分配,将直方图高于阈值的部分进行裁剪并均匀分布在下方。

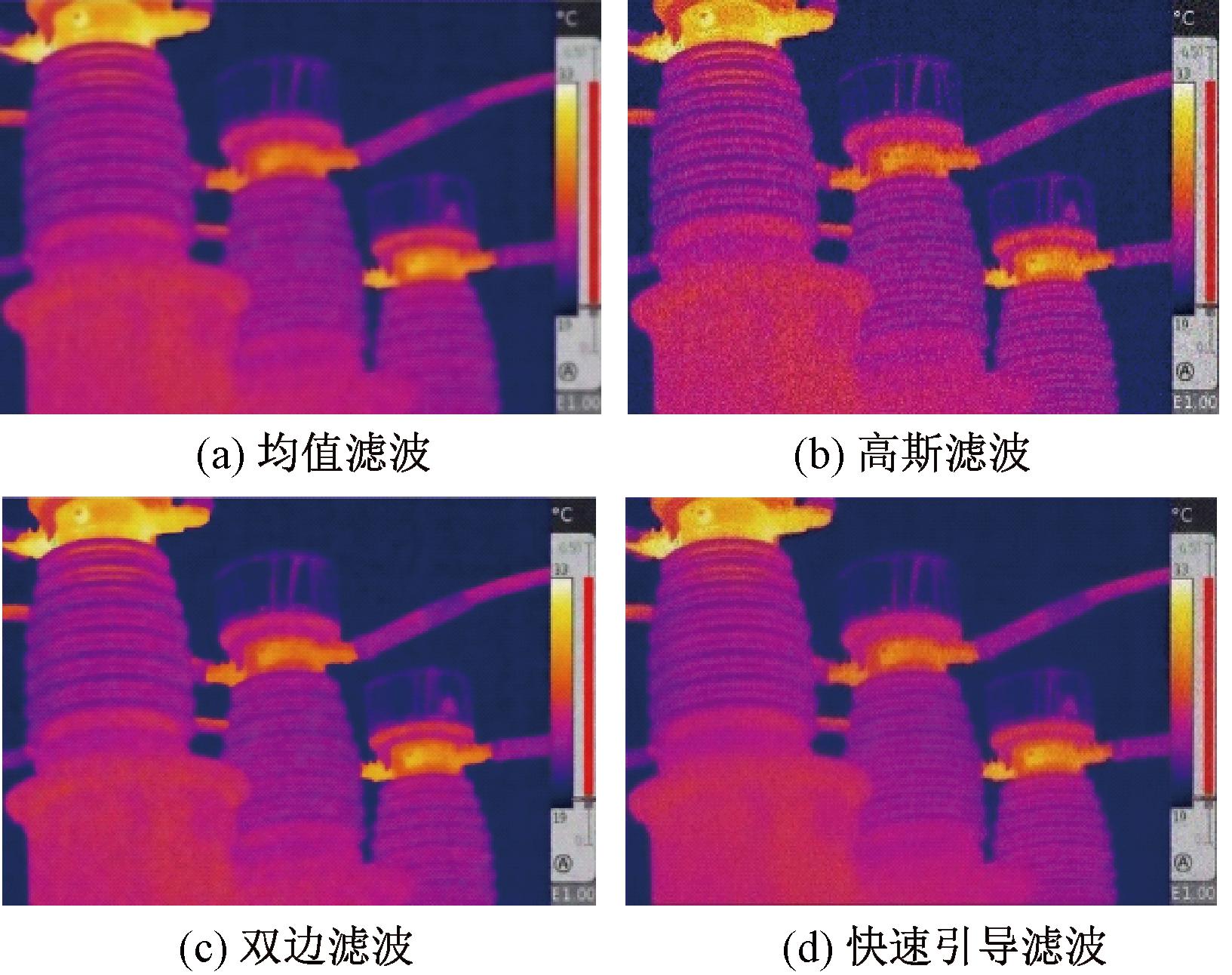

将改进后的CLAHE算法与目前常用的直方图均衡化(histogram equalization,HE)算法以及原CLAHE算法进行对比,各算法对比度增强效果如图2所示。由图2可知,经过HE算法处理后的红外图像对比度被过度增强,同时背景噪声被过度放大,纹理细节信息模糊。使用CLAHE算法对图像处理后,其整体对比度得到提升,有效避免了背景噪声的过度增强,然而该算法在提升图像的局部对比度方面表现不显著。如图2(c)中矩形框标注的区域所示,该部分由于其局部对比度相对较低,使得设备的细节特征突出不明显。使用改进后的CLAHE算法处理后的红外图像在提升整体对比度的同时也加强了图像局部对比度,纹理特征明显,便于后期进行模型训练。

图2 不同对比度增强算法效果对比图

Figure 2 Comparison diaram of effects of different contrast enhancement algorithms

2 基于YOLOv5的网络模型改进

2.1 YOLOv5目标检测算法原理

YOLOv5算法具有结构简单、易于训练和优化等特点,适用于实时目标检测任务,已在图像识别领域广泛应用。

YOLOv5网络结构主要由输入端、Backbone、Neck和检测头4部分组成。其中,输入模块负责对输入图像进行预处理,具体包括采用Mosaic数据增强技术、实施自适应图像缩放以及自适应锚框计算等方式。Backbone部分采用CSPDarknet53作为其核心架构,负责从输入图像中提取特征。此外,Focus结构被用于减小计算量同时保留原始图片信息。Neck部分主要负责特征融合和增强,采用路径聚合网络(path aggregation network,PANet)和特征金字塔网络(feature pyramid network,FPN)的组合,通过执行上采样与下采样操作,实现了跨尺度特征图的融合,生成多尺度的特征金字塔,以提高模型对不同尺度目标的检测能力。检测头则根据融合后的特征图进行目标的分类和定位预测,包括边界框、类别概率和目标置信度。

2.2 YOLOv5网络模型改进

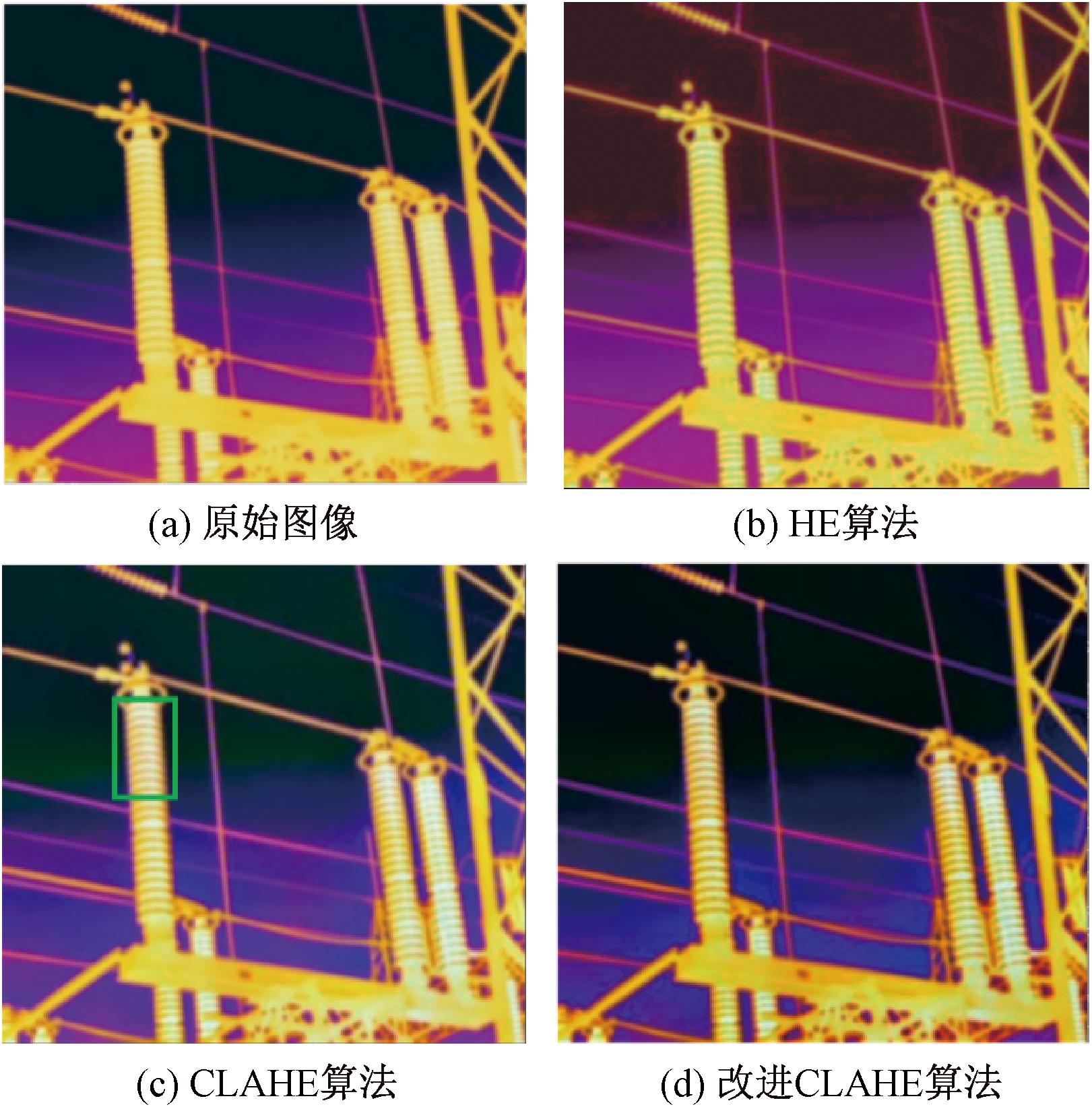

为了提高对电气设备的检测精度,进一步解决电气设备红外图像中存在的特征不明显的问题,本文从两个方面对原YOLOv5算法进行改进,提出了一种电气设备红外图像检测算法Infrared-defect-YOLOv5,网络结构如图3所示。

图3 Infrared-defect-YOLOv5算法网络结构图

Figure 3 Infrared-defect-YOLOv5 algorithm network structure diagram

2.2.1 改进特征融合模块

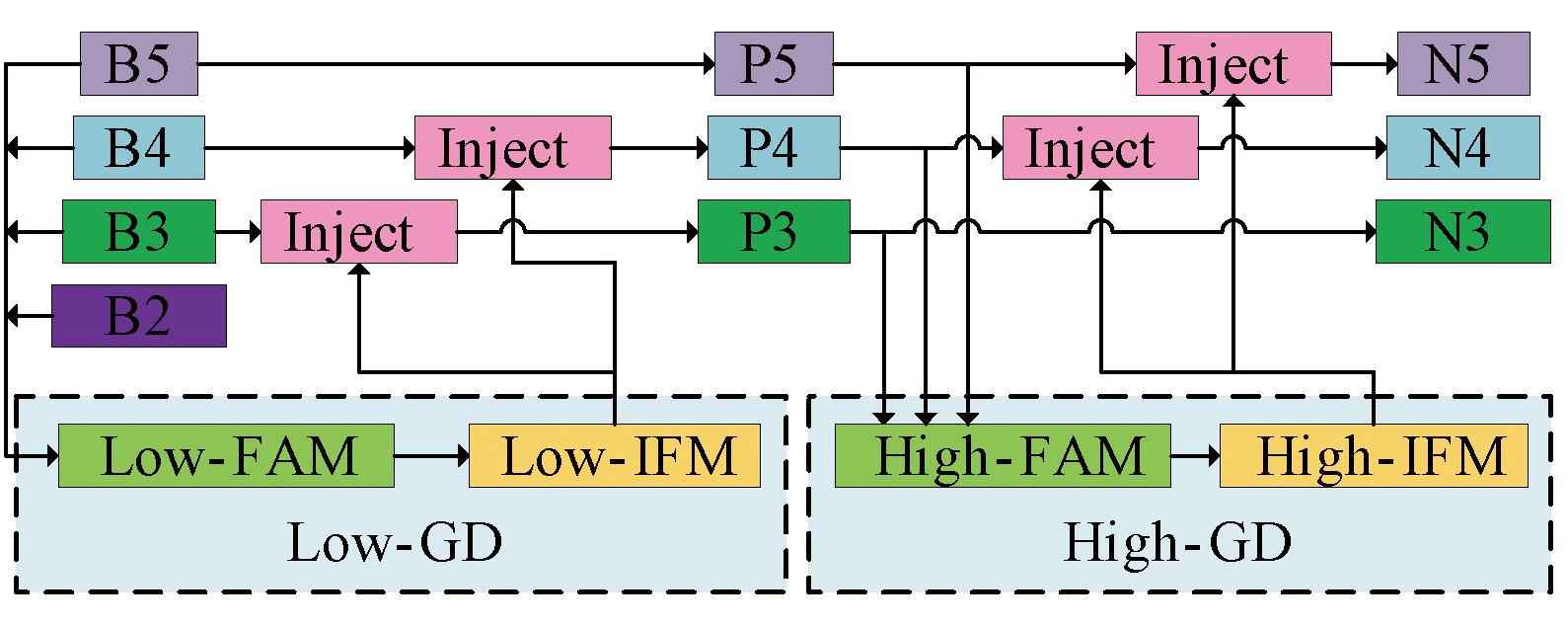

当前YOLOv5算法在特征融合模块对跨层信息进行融合时会存在信息丢失、速度低等问题。Neck部分主要负责多尺度特征融合,因此对Neck部分进行改进,采用一种信息聚集和分发机制(gather-and-distribute,GD)[20],其结构如图4所示。GD机制主要通过对不同尺度的特征图进行采集和融合,并将融合后的特征分发到不同层,提高特征信息融合能力。该机制主要依靠特征对齐模块(feature alignment module,FAM)、信息融合模块(information fusion module,IFM)及信息注入模块(information injection module,Inject)。FAM模块主要收集算法中Backbone部分输出的不同尺度的特征图,并通过池化或者双线性插值操作来对齐特征;IFM将FAM对齐后的特征进行融合生成全局特征;Inject模块将收集到的全局特征注入不同层级中,从而增强分支的检测能力。

图4 信息聚集和分发机制结构图

Figure 4 Information aggregation and distribution mechanism structure diagram

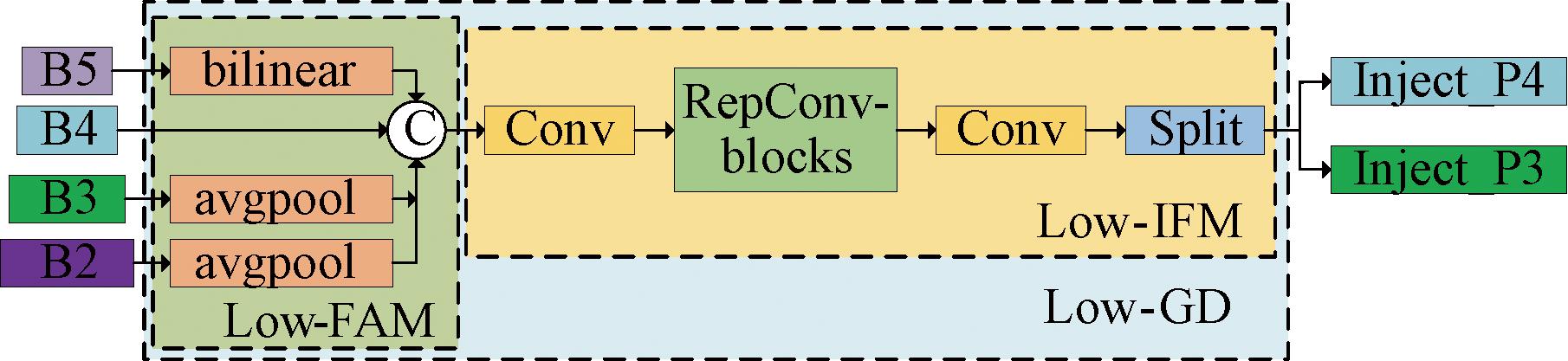

为了提高模型对不同大小目标的检测能力,将GD机制分为两个分支:低级聚集和分发机制(Low-GD)及高级聚集和分发机制(High-GD)。这两个分支分别提取和融合大尺寸和小尺寸的特征图,与Inject模块一起增强了Neck部分的信息融合能力。低级聚集和分发机制(Low-GD)主要包括低级特征对齐模块(Low-FAM)和低级信息融合模块(Low-IFM),其结构如图5所示。Low-FAM主要用于特征对齐,使得所有输入特征图尺寸与基准大小相同,最后通过Concat操作在通道上相加。Low-IFM主要通过RepConv-blocks模块进行特征融合,前后两个卷积用于转换通道数,最后通过Split模块得到全局信息。

图5 低级聚集和分发机制结构图

Figure 5 Low-level aggregation and distribution mechanism structure diagram

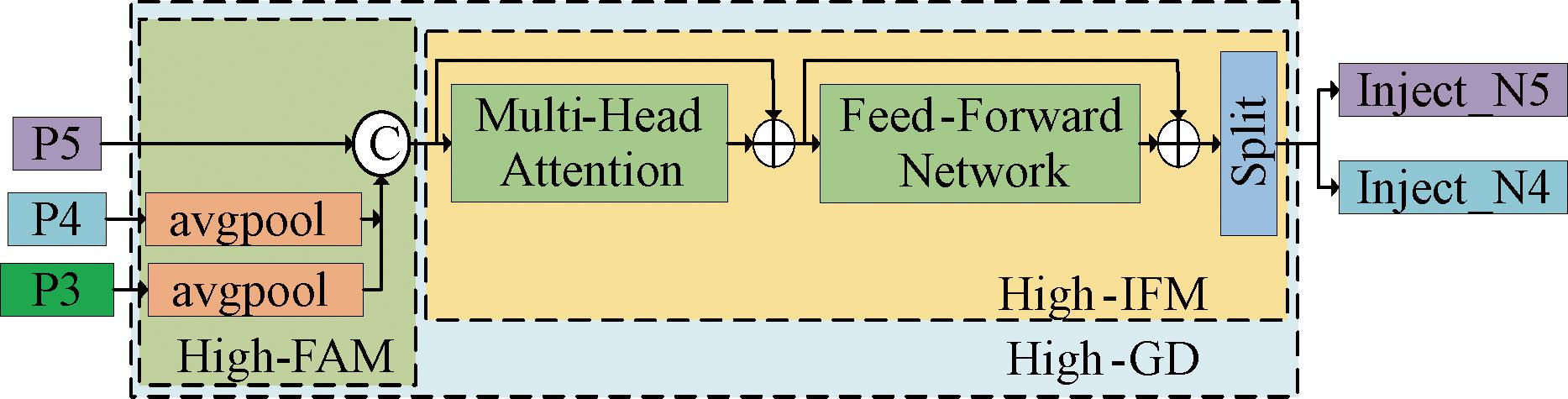

高级聚集和分发机制(High-GD)主要包括高级特征对齐模块(High-FAM)和高级信息融合模块(High-IFM),其结构如图6所示。High-FAM与Low-FAM功能大致相同,High-FAM以最小的特征图尺寸为基准,对较大的特征图进行平均池化操作,然后相加。High-IFM通过Multi-Head Attention 与 Feed-Forward Network模块得到融合特征,然后通过Split模块得到全局信息。

图6 高级聚集和分发机制结构图

Figure 6 High-level aggregation and distribution mechanism structure diagram

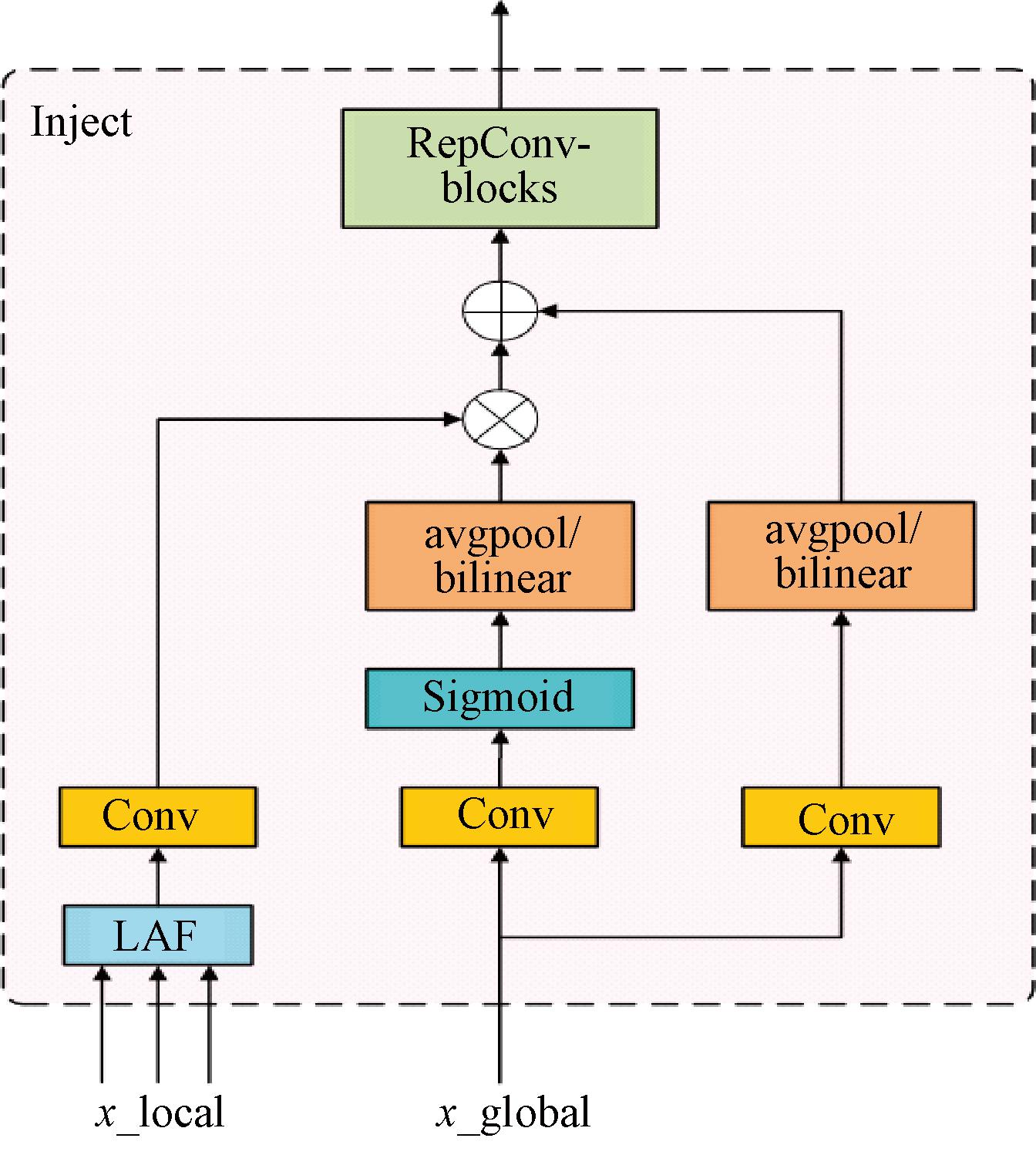

Inject模块主要用于特征信息注入,其结构如图7所示。该模块的一个输入x_local为当前尺度下的局部特征,如B3、B4。另一个输入x_global为IFM生成的全局特征,如Inject_P3、Inject_P4。融合过程中如果特征尺寸不一可通过平均池化或双线性插值方式进行处理,RepConv-blocks模块主要用于进一步提取和融合信息。

图7 Inject模块结构图

Figure 7 Inject module structure diagram

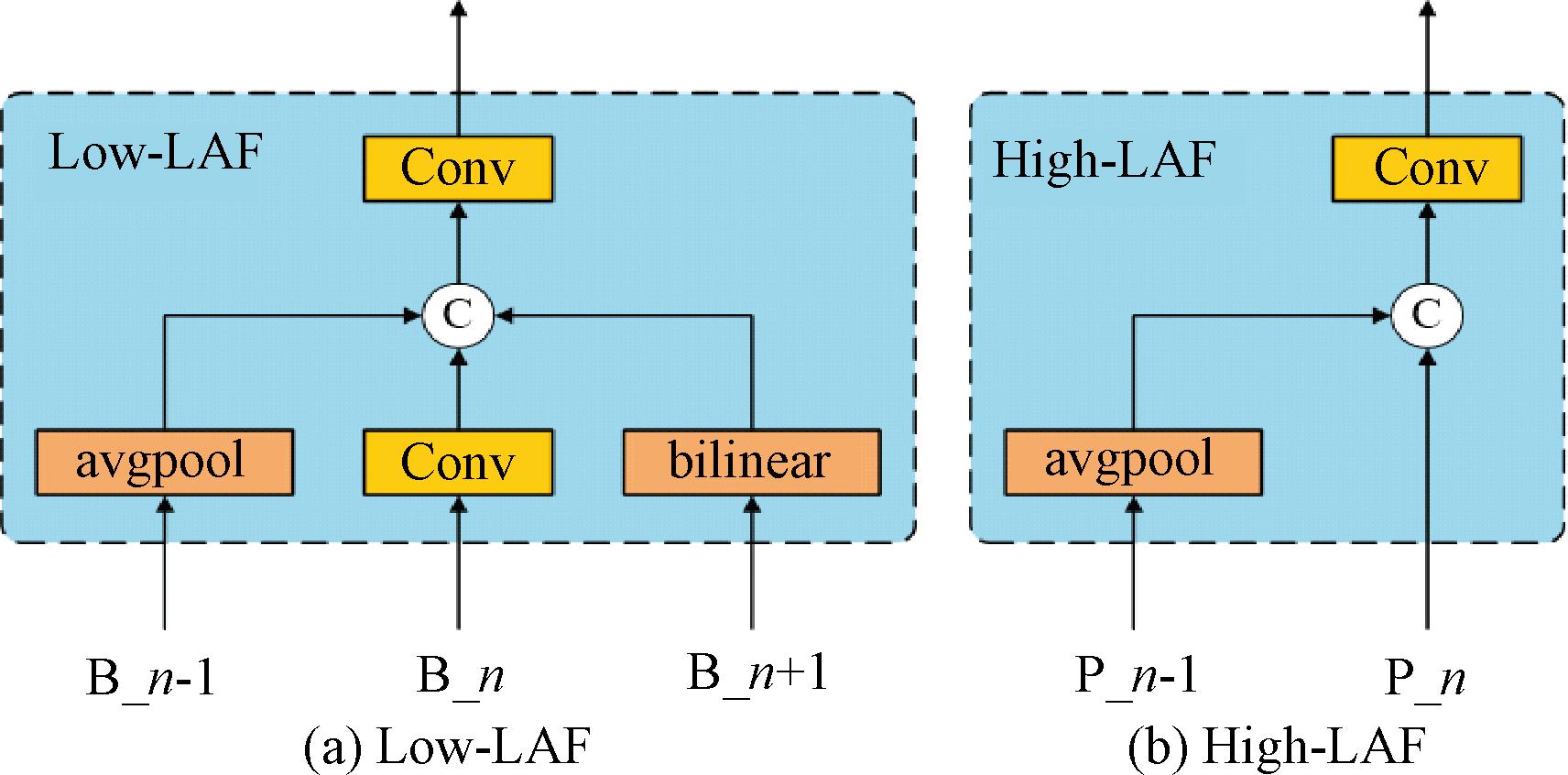

为了融合更多特征,在Inject模块的输入位置引入了轻量级相邻层融合模块(lightweight adjacent layer fusion,LAF),如图8所示。

图8 LAF模块结构图

Figure 8 LAF module structure diagram

Low-LAF(图8(a))将当前特征与相邻两层特征进行合并,通过池化和双线性插值方式统一特征图大小。High-LAF(图8(b))只将当前特征与相邻一层特征合并,仅通过池化方式统一大小。使用GD机制对YOLOv5算法中的Neck部分进行改进,可以大幅提高算法的多尺度特征融合能力,加强不同层级之间的联系,从而提高算法对电气设备红外图像的识别能力。

2.2.2 引入Focal-CIoU损失函数

YOLOv5当前采纳了CIoU-Loss作为其损失函数,该函数综合考虑了目标框的中心点的欧氏距离、宽高比差异以及重叠面积等因素,公式为

(6)

(7)

式中:IoU被定义为预测框b与真实框bgt之间的交并比;ρ表示两个矩形框中心点间的欧氏距离;c为预测框与真实框共同覆盖的最小外接矩形的对角线长度。权重函数α和宽高比度量函数v的表达式为

(8)

(9)

式中:wgt和hgt代表真实框的宽度与高度;预测框的宽度与高度由w、h表示。

由于收集到的电气设备红外图像质量整体不高,高质量样本较少,很多低质量的样本数据贡献了大部分梯度,使得训练样本不平衡,限制了边界框的回归。在检测模型训练过程中,高质量的样本总是比低质量的样本稀缺,正负样本严重不平衡,不利于模型训练。为了解决正负样本不平衡的问题,Lin等[21]提出了Focal Loss损失函数。本文采用将Focal Loss和CIoU相结合后构建的Focal-CIoU损失函数来代替CIoU,其公式为

LFocal-CIoU=IoUγLCIoU。

(10)

式中:γ为权重系数,本文取0.5。由于低质量样本的IoU小,损失LCIoU较大,与IoUγ相乘后LCIoU数值显著减小,可以有效抑制低质量样本对损失的贡献,而高质量样本的IoU大,损失LCIoU较小,与IoUγ相乘后LCIoU数值变化不大,从而可以更多地关注高质量样本,抑制低质量样本,提升模型收敛速度。

3 基于改进YOLOv5的红外图像检测

3.1 训练环境搭建

本文模型训练环境配置为Windows11系统、Inter i7-14650HX处理器、RTX 4060显卡、16 G内存、Python3.8.10、Pytorch1.9.0、CUDA11.3。

3.2 数据集预处理

对某变电站实地拍摄以及网络获取的电气设备原始红外图像共1 050张,使用前文所介绍的两种数据增强方法以及常用的几何变换、像素变换、背景替换等方式对收集到的电气设备红外图像进行图像预处理,最终所构建的红外数据集共有图片2 592张。使用LabelImg软件对数据集进行标注,生成适用于模型训练的txt格式的标签文件。将数据集划分为训练集、验证集和测试集,划分比例为6∶2∶2。

以常见的5种电气设备为例制作数据标签,分别是断路器、电压互感器、电流互感器、避雷器、隔离开关,其标签数量分别为696,915,1 146,347,441,标签数量总计为3 545。

3.3 实验及结果分析

模型性能评估指标包括精确率(Precision)、召回率(Recall)、P-R曲线、帧率以及平均精度均值(mAP)等。其中,帧率作为衡量模型检测效率的重要参数,具体指的是模型每秒能够处理的图像帧数。P-R曲线是一种二维图像,其横轴为召回率,纵轴为精确率。该曲线与坐标轴围成的区域面积用于量化某一类别的平均精度AP值,对所有N个类别的AP值进行算术平均,即为mAP值。

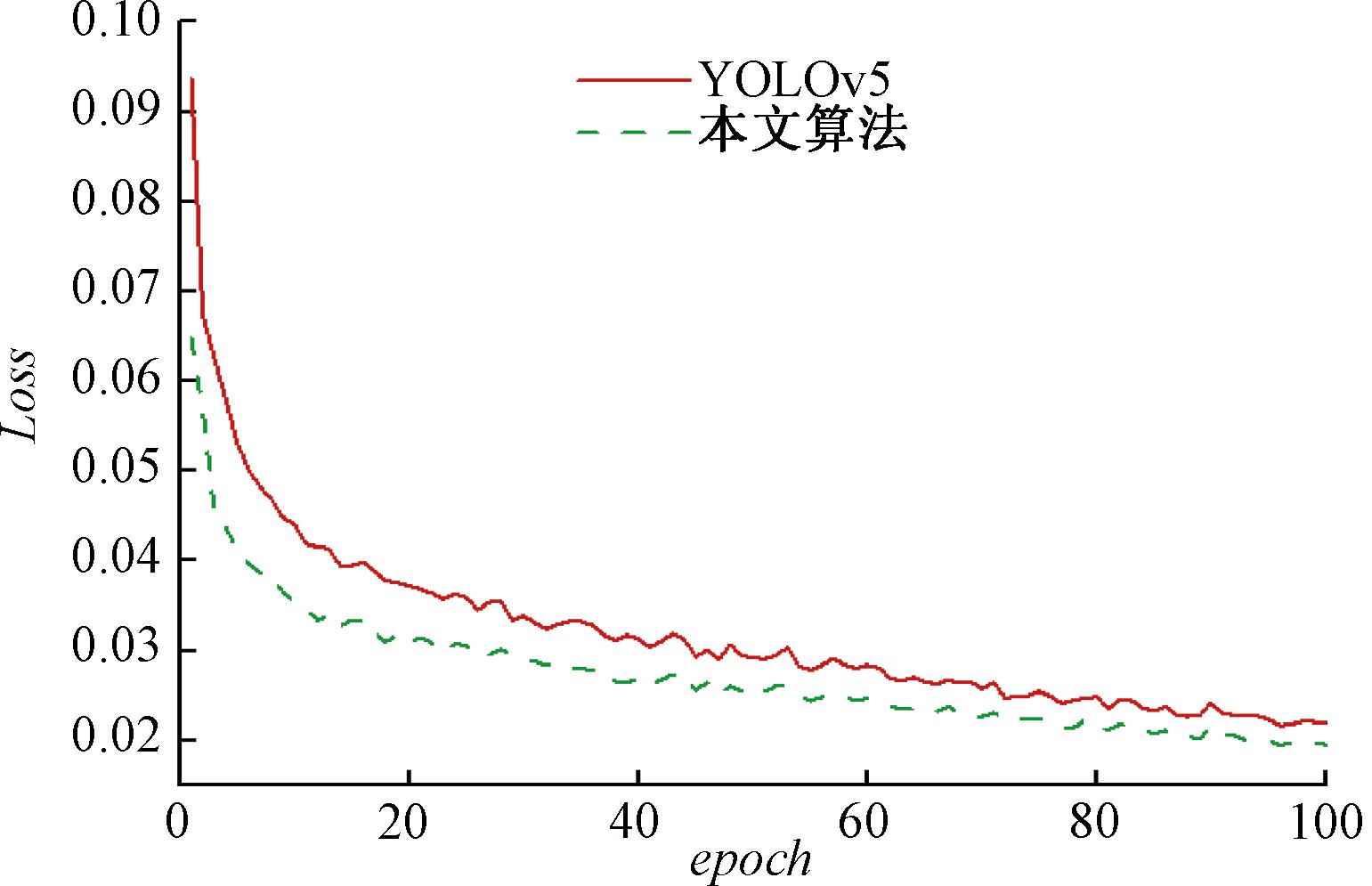

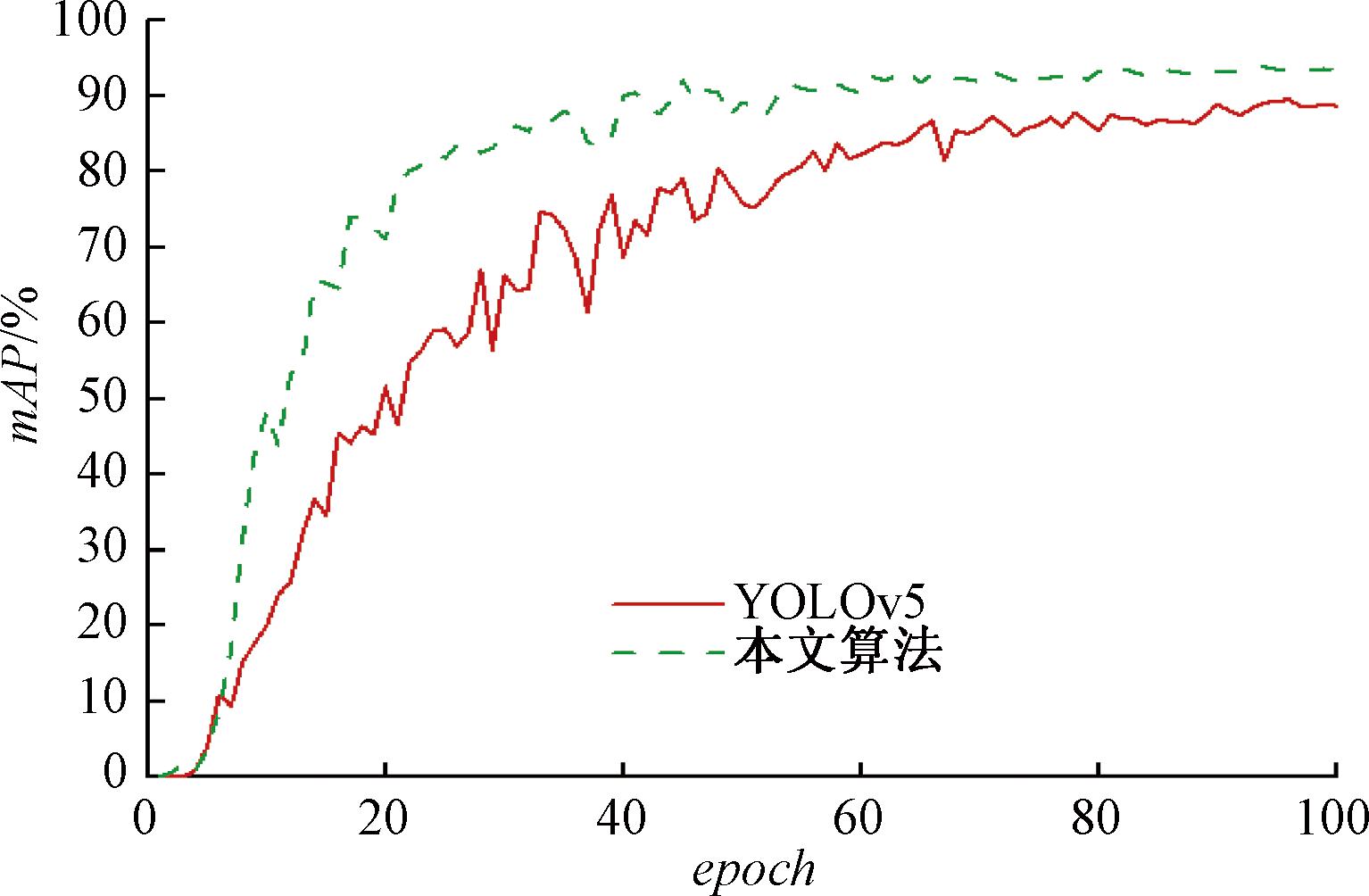

图9为算法改进前后的损失函数变化曲线,由于引入了Focal-CIoU损失函数,使得改进后的算法损失函数数值整体较小,而且收敛速度更快、收敛性更好。图10为模型改进前后的mAP值随训练轮数epoch的变化曲线。由图10可以看出,改进后的算法曲线上升趋势更快,同时mAP值提升明显,训练过程较为稳定。

图9 算法改进前后损失函数变化曲线

Figure 9 The loss function change curve before and after the improvement of the algorithm

图10 算法改进前后mAP变化曲线

Figure 10 mAP change curve before and after the improvement of the algorithm

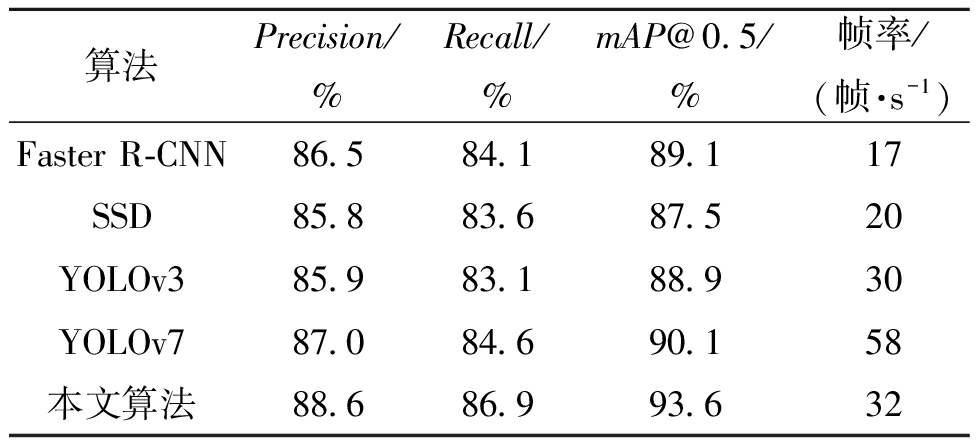

将本文算法与Faster R-CNN等算法进行对比分析,并使用上文所阐述的模型评估指标进行评估,实验结果见表1。由表1可知,本文方法的mAP值相比Faster R-CNN[5]、SSD[6]、YOLOv3[9]、YOLOv7[22]分别提高了4.5百分点、6.1百分点、4.7百分点、3.5百分点。与其他几种算法相比,本文方法在保持最高识别精度的同时还有较高的推理速度。

表1 不同算法实验结果对比

Table 1 Comparison of experimental results of different algorithms

算法Precision/%Recall/%mAP@0.5/%帧率/(帧·s-1)Faster R-CNN86.584.189.117SSD85.883.687.520YOLOv385.983.188.930YOLOv787.084.690.158本文算法88.686.993.632

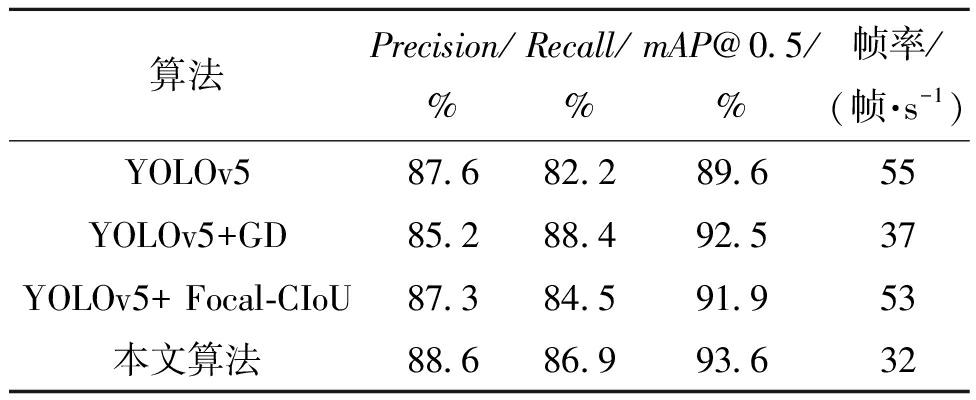

对算法的不同改进方法进行消融实验,同时使用评估指标对消融实验结果进行了对比分析,具体结果见表2。由表2可知,使用改进前的YOLOv5目标检测算法训练后的检测模型mAP值为89.6%,帧率为55帧/s。在算法中引入GD机制后,模型的mAP值较原算法提高了2.9百分点,但帧率降低为37帧/s。采用Focal-CIoU损失函数后mAP值提高了2.3百分点,帧率变化不大,为53帧/s。将两个改进方法相结合后的本文算法Infrared-defect-YOLOv5的mAP值为93.6%,较改进前提高了4.0百分点,识别精度提高,同时精确率和召回率也有不同程度的提高,然而由于引入GD机制提高了模型的参数量,使得计算量增大,因此帧率降低为32帧/s,但整体推理速度仍然较快,能够满足实际需求。

表2 消融实验结果对比

Table 2 Comparison of ablation results

算法Precision/%Recall/%mAP@0.5/%帧率/(帧·s-1)YOLOv587.682.289.655YOLOv5+GD85.288.492.537YOLOv5+ Focal-CIoU87.384.591.953本文算法88.686.993.632

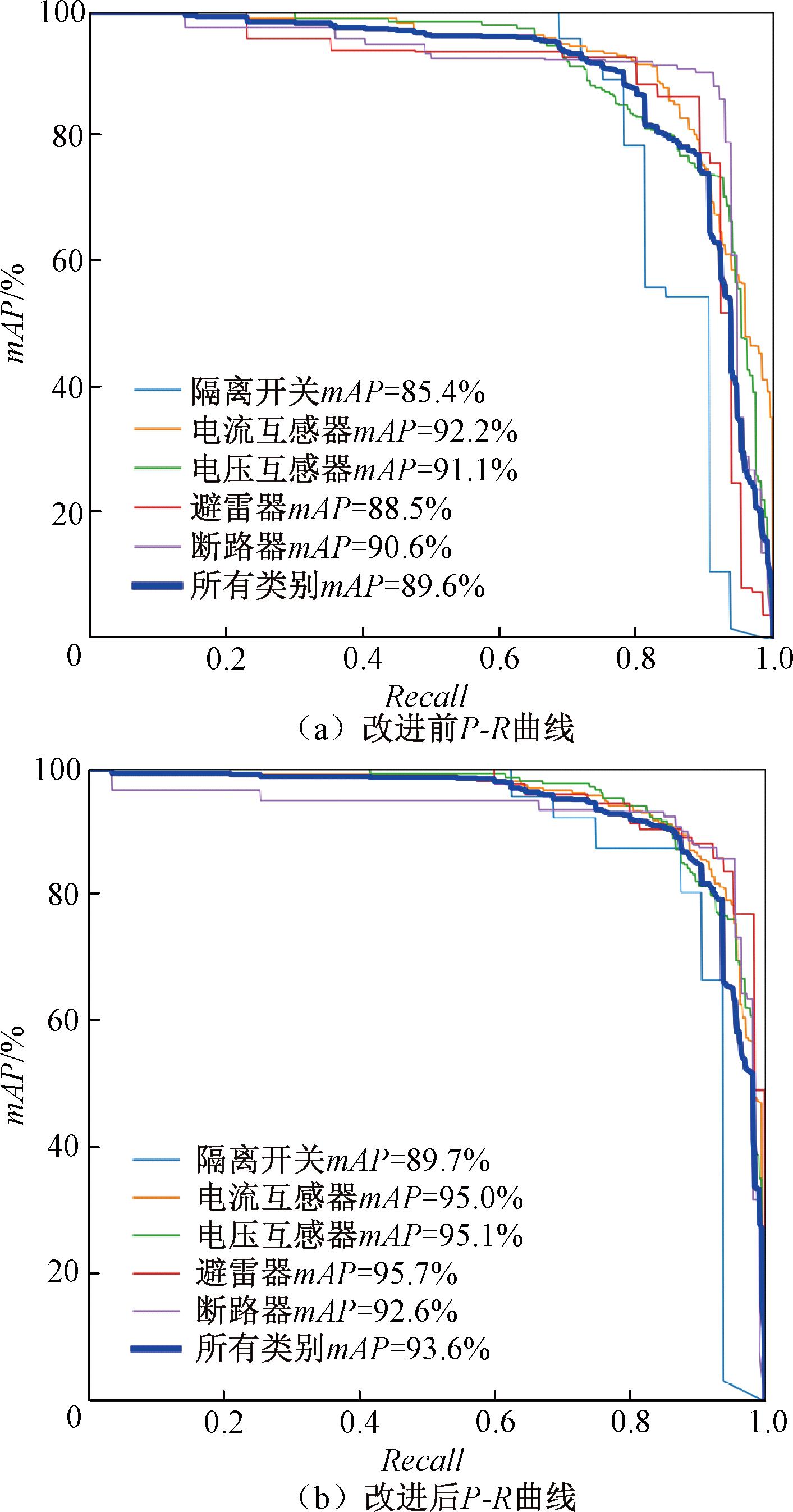

图11为算法改进前后的P-R曲线对比,根据P-R曲线可得各个设备的mAP值,改进后模型的P-R曲线更靠近右上角,mAP值更高,各个电气设备的mAP值都有所提升。其中,隔离开关的识别效果较差,mAP值为89.7%,电流互感器、电压互感器、避雷器三者的识别精度相差不大,识别效果最好的避雷器的mAP值稳定在95.7%。

图11 P-R曲线对比

Figure 11 Comparison of P-R curves

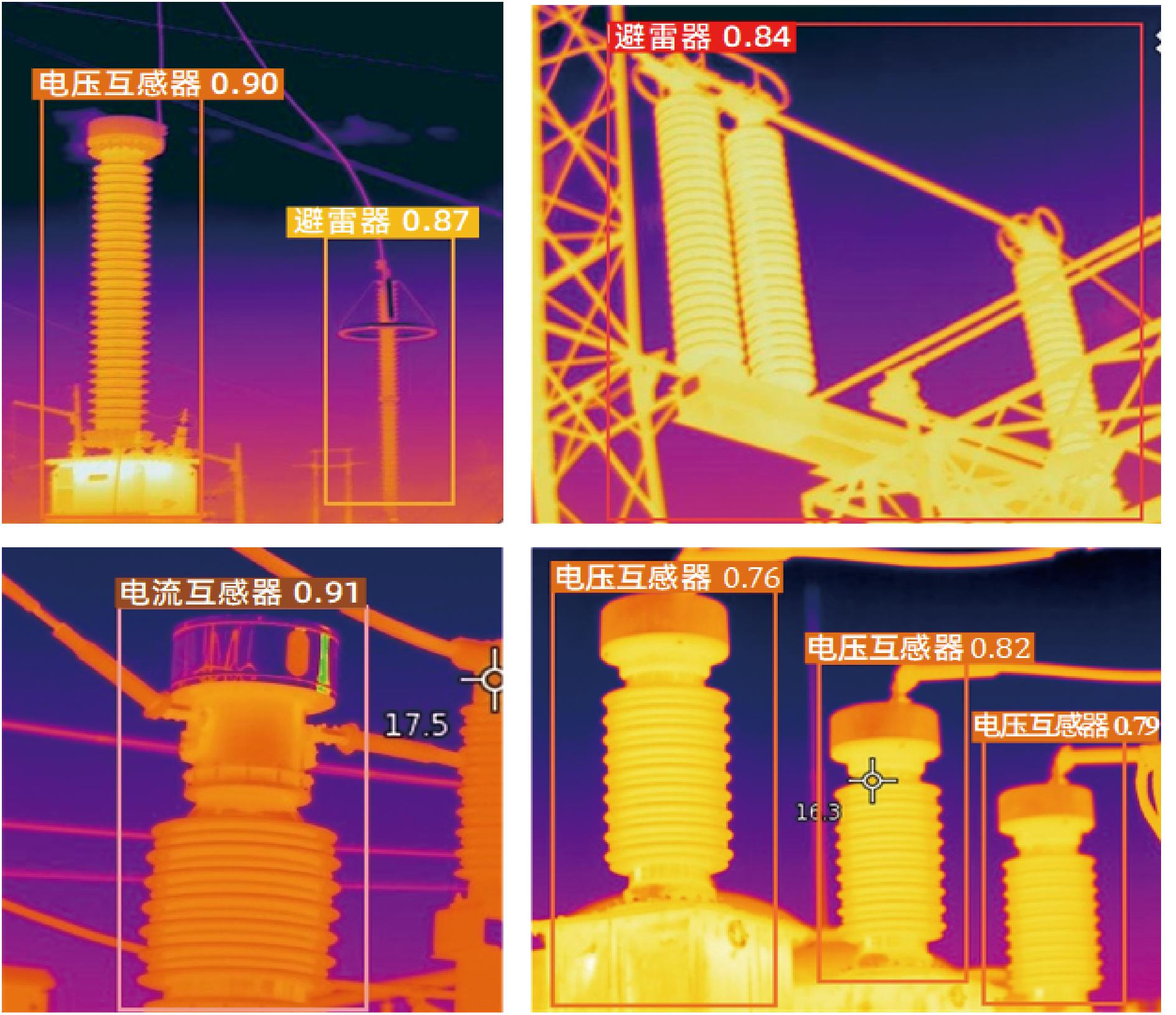

使用改进后的检测模型进行测试,如图12所示,改进后的Infrared-defect-YOLOv5算法训练得到的模型识别置信度较高,能够对电气设备红外图像进行准确识别分类。

图12 Infrared-defect-YOLOv5算法识别效果图

Figure 12 Infrared-defect-YOLOv5 algorithm recognition effect diagram

4 结论

本文针对红外图像存在的信噪比和对比度低等问题,对电气设备红外图像进行数据增强,使用快速引导滤波算法进行图像去噪,在CLAHE算法中引入Gamma函数校正对电气设备红外图像进行对比度增强处理。然后提出一种电气设备红外图像检测算法Infrared-defect-YOLOv5,在原算法的Neck部分引入GD机制来改进特征融合模块,提高多尺度特征融合能力,同时使用Focal-CIoU损失函数替代现有的损失函数,从而解决了训练过程中正负样本比例失衡的问题。改进后的算法mAP值为93.6%,较改进前相比提高了4.0百分点,同时模型检测速度较快,能够满足实时检测的需求。

[1] MERADI S, LARIBI S, BOUSLIMANI S, et al. Analysis of failure in low-voltage terminal connections and fault classification in power transformer using infrared thermography[J]. Journal of Failure Analysis and Prevention, 2024, 24(2): 547-558.

[2] 肖懿, 罗丹, 蒋沁知, 等. 基于温度概率密度的变电站高压设备故障热红外图像识别方法[J]. 高电压技术, 2022, 48(1): 307-318.XIAO Y, LUO D, JIANG Q Z, et al. Thermal infrared image recognition method for high voltage equipment failure in substation based on temperature probability density[J]. High Voltage Engineering, 2022, 48(1): 307-318.

[3] GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]∥2014 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2014: 580-587.

[4] GIRSHICK R. Fast R-CNN[C]∥2015 IEEE Internatio-nal Conference on Computer Vision (ICCV). Piscataway: IEEE, 2015: 1440-1448.

[5] REN S Q, HE K M, GIRSHICK R, et al. Faster R-CNN: towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149.

[6] LIU W, ANGUELOV D, ERHAN D, et al. SSD: single shot MultiBox detector[C]∥Computer Vision-ECCV 2016. Cham: Springer, 2016: 21-37.

[7] REDMON J, DIVVALA S, GIRSHICK R, et al. You only look once: unified, real-time object detection[C]∥2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Piscataway: IEEE, 2016: 779-788.

[8] REDMON J, FARHADI A. YOLO9000: better, faster, stronger[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Piscataway: IEEE, 2017: 6517-6525.

[9] REDMON J, FARHADI A. YOLOv3: an incremental improvement[EB/OL]. (2018-04-08) [2025-08-01]. https: ∥arxiv. org/abs/1804.02767.

[10] BOCHKOVSKIY A, WANG C Y, LIAO H. YOLOv4: optimal speed and accuracy of object detection[EB/OL]. (2020-04-23) [2025-08-01]. https: ∥arxiv.org/abs/2004.10934.

[11] LI C Y, LI L L, JIANG H L, et al. YOLOv6: a single-stage object detection framework for industrial applications[EB/OL]. (2022-09-01) [2025-08-01]. https: ∥arxiv.Org/abs/2209.02976.

[12] CHENG Y, XIA L Z, YAN B, et al. A defect detection method based on faster RCNN for power equipment[J]. Journal of Physics: Conference Series, 2021, 1754(1): 012025.

[13] 王勋, 毛华敏, 李唐兵, 等. 基于迁移学习和R-FCN的电力设备红外图像识别算法[J]. 传感器与微系统, 2021, 40(1): 147-150.WANG X, MAO H M, LI T B, et al. Recognition algorithm for infrared image of power equipment based on transfer learning and R-FCN[J]. Transducer and Microsystem Technologies, 2021, 40(1): 147-150.

[14] 王永平, 张红民, 彭闯, 等. 基于YOLO v3的高压开关设备异常发热点目标检测方法[J]. 红外技术, 2020, 42(10): 983.WANG Y P, ZHANG H M, PENG C, et al. The target detection method for abnormal heating point of high-voltage switchgear based on YOLO v3[J]. Infrared Technology, 2020, 42(10): 983.

[15] 李北明, 金荣璐, 徐召飞, 等. 基于特征蒸馏的改进Ghost-YOLOv5红外目标检测算法[J]. 郑州大学学报(工学版), 2022, 43(1): 20-26.LI B M, JIN R L, XU Z F, et al. An improved Ghost-YOLOv5 infrared target detection algorithm based on feature distillation[J]. Journal of Zhengzhou University (Engineering Science), 2022, 43(1): 20-26.

[16] CHEN M J, LAN Z X, DUAN Z X, et al. HDS-YOLOv5: an improved safety harness hook detection algorithm based on YOLOv5s[J]. Mathematical Biosciences and Engineering, 2023, 20(8): 15476-15495.

[17] LI L L, WANG Z F, ZHANG T T. GBH-YOLOv5: ghost convolution with BottleneckCSP and tiny target prediction head incorporating YOLOv5 for PV panel defect detection[J]. Electronics, 2023, 12(3): 561.

[18] HE K M, SUN J. Fast Guided Filter. [EB/OL]. (2015-05-05) [2025-08-01]. https: ∥arxiv.org/abs/1505.00996.

[19] 马敏慧, 王红茹, 王佳. 基于改进的MSRCR-CLAHE融合的水下图像增强算法[J]. 红外技术, 2023, 45(1): 23-32.MA M H, WANG H R, WANG J. An underwater image enhancement algorithm based on improved MSRCR-CLAHE fusion[J]. Infrared Technology, 2023, 45(1): 23-32.

[20] WANG C C, HE W, NIE Y, et al. Gold-YOLO: efficient object detector via gather-and-distribute mechanism[EB/OL]. (2023-09-20) [2025-08-01]. https: ∥arxiv.org/abs/2309.11331.

[21] LIN T Y, GOYAL P, GIRSHICK R, et al. Focal loss for dense object detection[C]∥2017 IEEE International Conference on Computer Vision (ICCV). Piscataway: IEEE, 2017: 2999-3007.

[22] WANG C Y, BOCHKOVSKIY A, LIAO H M. YOLOv7: trainable bag-of-freebies sets new state-of-the-art for real-time object detectors[C]∥2023 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Piscataway: IEEE, 2023: 7464-7475.