时序预测通过分析历史数据之间的关联来预测未来趋势,是目前的研究热点之一。在某些领域中,决策者需根据短期时序数据变化快速作出精准决策,对预测实时性要求极高。如在金融市场中,实时预测可帮助交易者迅速作出买卖决策;在能源行业,实时预测有助于提升电网运行效率和可靠性;在城市交通领域,实时预测能为城市规划和交通管理提供重要决策支持。因此,时序预测模型在保持高精度的同时,还需兼顾时效性[1-2]。

早期的时序预测广泛采用循环神经网络(RNN)[3],能够以自回归方式有效捕捉序列中的规律性。然而,RNN存在梯度消失和爆炸问题,限制了处理长序列的能力。长短期记忆网络(LSTM)[4]和门控循环单元(GRU)[5]在一定程度上缓解了上述问题,但仍难以同时有效处理长期与短期依赖。2017年,Transformer模型[6-7]被提出,凭借其强大的并行计算能力和全局依赖建模优势,在多项时序预测任务中表现卓越,成为研究热点。

根据建模机制的不同,基于Transformer的时序预测模型可分为两类:基于块的模型和基于变量的模型。基于块的模型,例如PatchTST[8],将时序划分为片段,并利用注意力机制挖掘局部时序模式,但在多变量交互建模方面存在不足;基于变量的模型,例如iTransformer[9],通过变量间的注意力机制显式建模变量相关性,特别适用于高维多元时序预测。然而,这类模型的计算复杂度和序列长度呈指数(平方)增长,严重限制了其在实时场景中的应用。

为降低计算和存储开销,多种模型轻量化技术被提出,如模型剪枝[10]、量化[11]、知识蒸馏[12]和矩阵压缩[13]等。模型剪枝通过移除网络中的冗余连接或非必要结构减小模型规模;量化通过降低数值精度减少存储和计算开销;知识蒸馏通过师生框架提升小模型的表达能力;矩阵压缩,例如奇异值分解(singular value decomposition,SVD)[14]则利用权重矩阵的低秩特性进行更底层的数字重构与参数压缩,实现效率提升。这些方法在视觉和自然语言处理任务中取得了显著进展,然而在时序预测方面仍处于初级阶段。

针对上述问题,本文提出一种基于iTransformer的轻量级时序预测模型ILformer。该模型引入奇异值分解对注意力输出矩阵进行降维,将参数量从6.40×106减少至1.36×106,显著缓解了长序列预测中的内存瓶颈问题。同时,ILformer采用改进的线性注意力机制[15],将计算复杂度从指数降至线性,计算量从57×106降低至25×106,推理时间从97.1 ms缩短至42.0 ms,且展现出较好的性能平衡。

1 ILformer模型

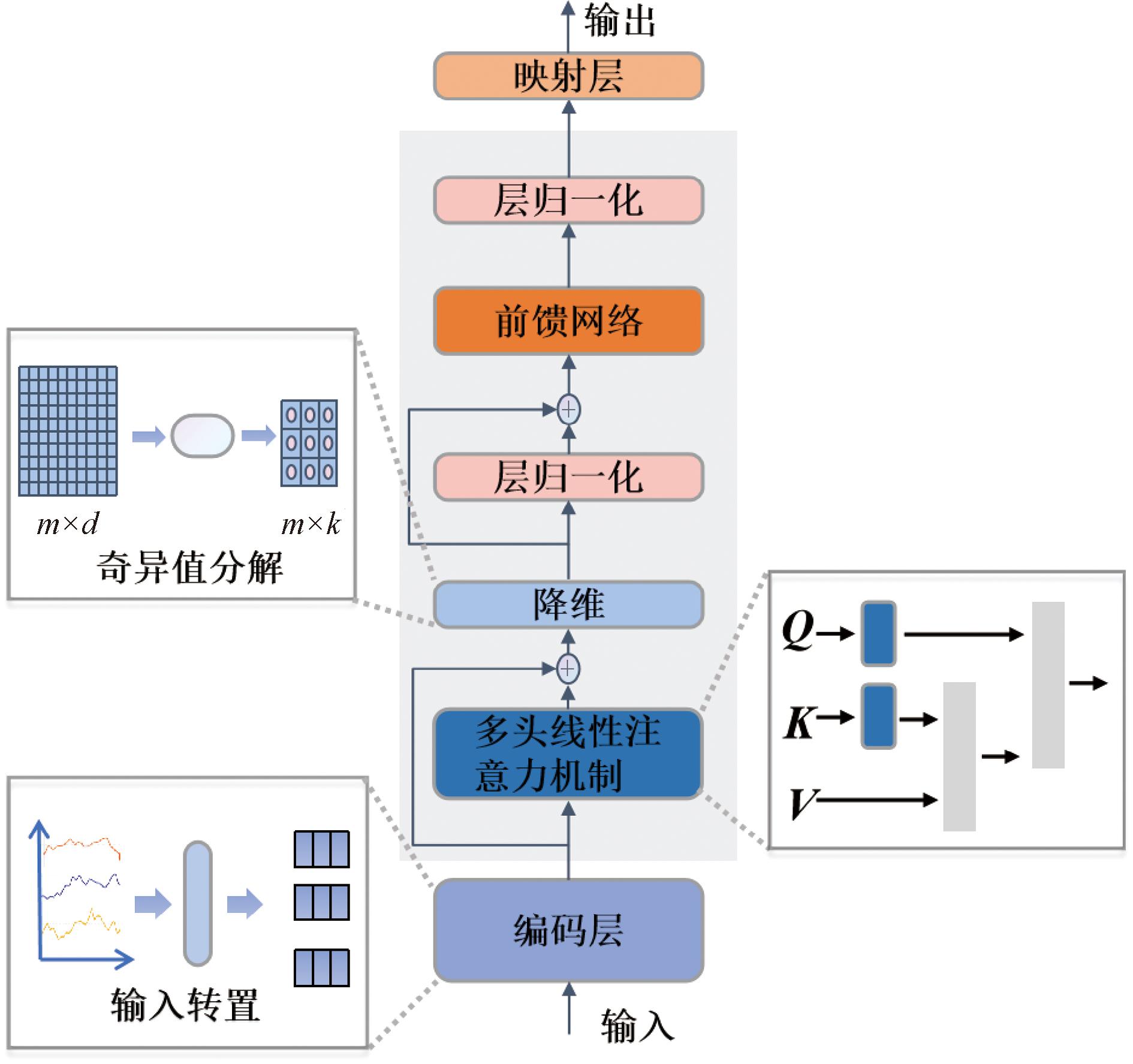

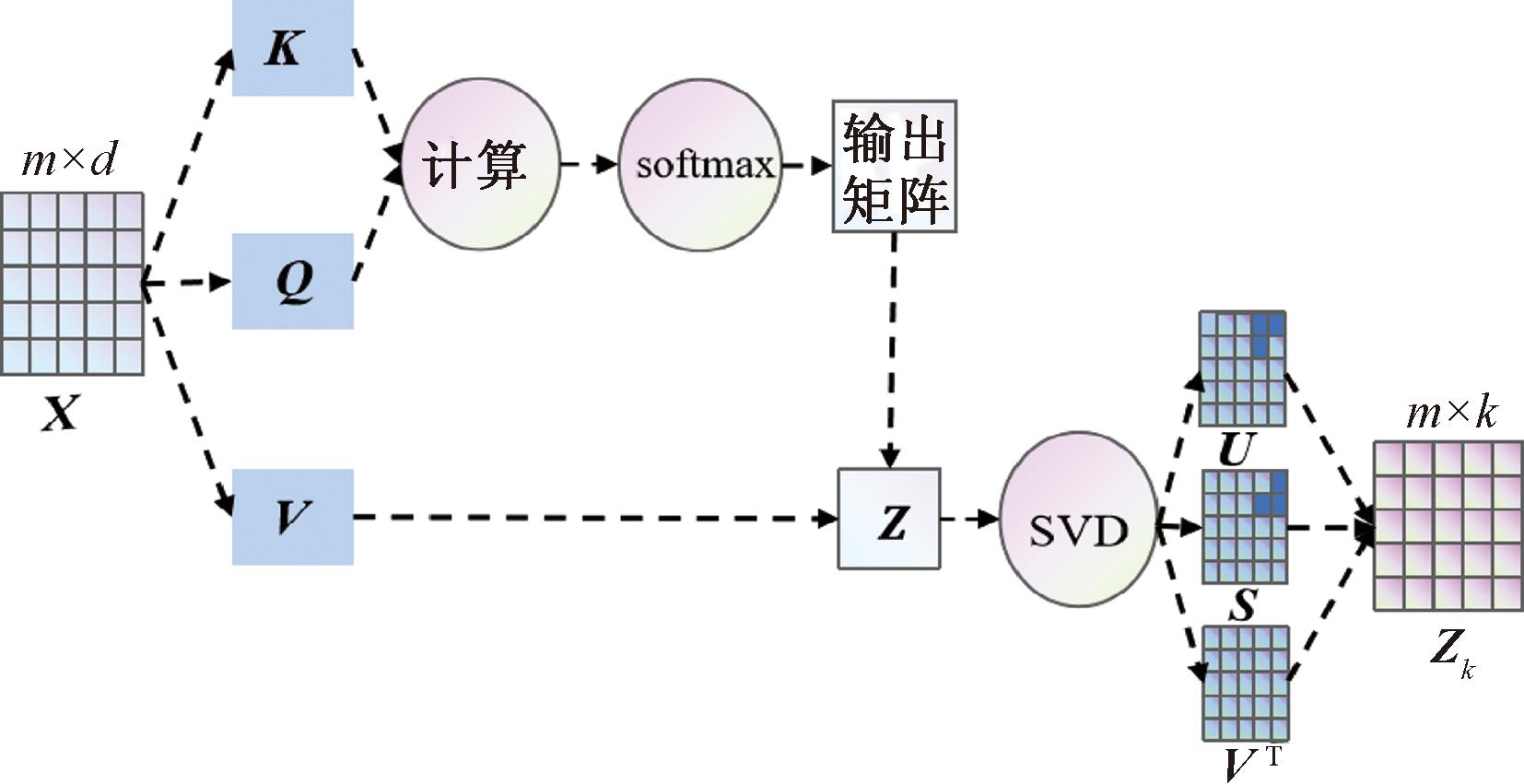

本文提出的ILformer模型整体架构如图1所示。首先,在编码层中,对输入数据进行转置处理,将每个特征的时序整体视为一个编码层的Token;其次,通过多头线性注意力机制重新调整矩阵连乘的计算次序,有效提升推理速度;最后,输出矩阵通过奇异值分解进行降维处理,进一步降低计算量和内存开销。此外,ILformer沿用了Transformer中的层归一化和前馈网络设计,并在最后加入一个线性层作为解码层,生成未来n个时间段的预测值。

图1 ILformer模型架构图

Figure 1 ILformer model architecture

ILformer算法伪代码如下。

算法1 ILformer算法。

输入:时间序列X、SVD截断秩k、编码器层数L;

输出:预测序列Y。

① X=LayerNorm(X);∥输入序列归一化处理

② X=X.transpose∥维度转置,变量视为Token;∥多层感知机对特征进行嵌入编码

③ H0=MLP(X);

④ for l in {1,…,L}:

⑤ Z=LinearAttention(Hl-1)∥线性注意力机制;

⑥ Zk=SVD(Z,k); ∥奇异值分解降维∥残差连接与层归一化

⑦ H′=LayerNorm(Hl-1+Zk);∥前馈神经网络用于特征提取与融合

⑧ Hl=LayerNorm(H′+FeedForward(H′));

⑨ End for∥解码层:将Token投影回预测序列长度

⑩ Y=Projection(HL);

Y=Y.transpose;

Y=Y.transpose;

Return Y

Return Y

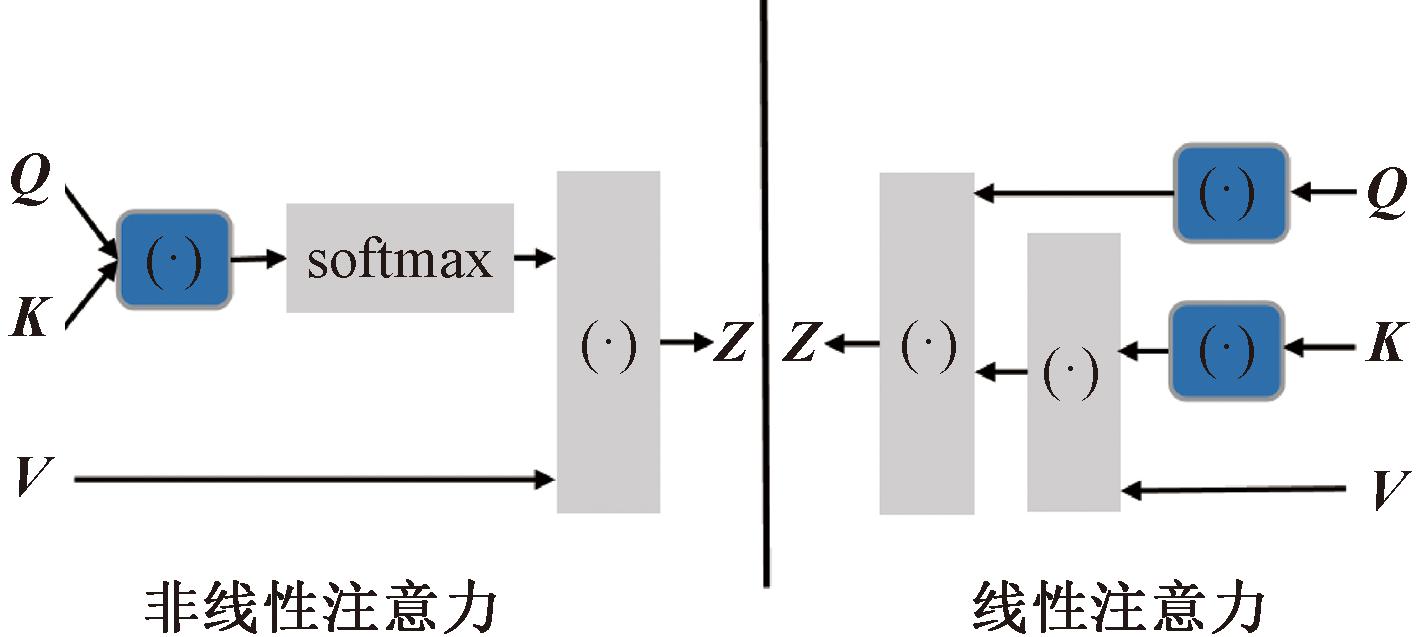

1.1 线性注意力机制

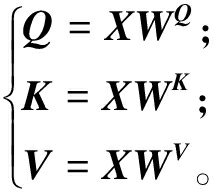

对于Transformer类模型,自注意力机制需要为每个时间步生成查询(Q)、键(K)和值(V)矩阵。在传统的softmax注意力机制[16]中,假定输入序列长度为m,嵌入维度为d,即注意力输入为X∈Rm×d,分别乘上3个权值矩阵WQ∈Rd×dq,WK∈Rd×dk及WV∈Rd×dv后得到Q、K、V矩阵,对于自注意力有dq=dk=dv,因此矩阵可如下表示:

(1)

给定3个矩阵后,自注意力的计算方式如下:

(2)

矩阵Q与KT相乘之后除以![]() 主要是解决softmax激活函数梯度消失的问题。将上式展开得到每行自注意力矩阵的计算方式如下:

主要是解决softmax激活函数梯度消失的问题。将上式展开得到每行自注意力矩阵的计算方式如下:

(3)

在非线性注意力中,要求先计算Q和K的矩阵乘法,再计算其与V的乘法。可依乘法结合律,将(φ(Q)φ(K)T)V改为φ(Q)(φ(K)TV),即用φ(Q)乘上φ(K)TV[17],如图2所示。

图2 注意力计算顺序图

Figure 2 Attention computation order diagram

输入的Q、K、V通过线性变换进行投影Q′=QWq,K′=KWk,V′=VWv,将投影后的查询、键和值矩阵变换为多头注意力的格式,并改变原多头注意力中的排列顺序。本文采用爱因斯坦求和规则[18]计算Q和V的相似度,具体如下:

scores=Q′(K′)T。

(4)

在注意力机制中,softmax激活函数用来实现归一化,因此使用式(5)计算注意力:

(5)

最终,将注意力输出矩阵A与V′相乘,再通过输出层权重Wo进行映射,得到输出矩阵:

(6)

传统注意力机制在处理长时序数据时注意力分布往往较为稀疏,导致模型难以有效捕捉序列中的关键模式[19]。本文通过简化计算,将注意力机制的复杂度从传统的二次复杂度降低至线性,线性注意力机制不仅大幅提高了计算效率,还保持了模型对关键模式的高效建模能力。

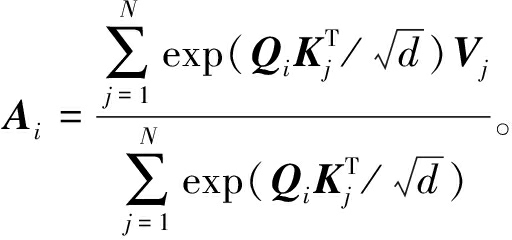

1.2 低秩分解

注意力机制中矩阵由输入序列生成的向量构成,用于计算各时间步的相关性和依赖关系。由于需实时从输入数据中生成,且运算消耗大量计算资源和时间,尤其对于维度差异较大的矩阵V和K,在乘积计算中易出现大量冗余数据,增加计算开销,因此,对模型中矩阵的维度进行缩减,能够显著降低矩阵乘法的计算量[20]。

为加速计算并减少计算复杂度,本文模型在原始模型的自注意力机制后引入奇异值分解[21]来降低Z的维度并保留最重要的特征,分解公式如下:

Z=UΣVT。

(7)

式中:U∈Rm×m为左奇异向量矩阵;Σ∈Rm×d为对角矩阵;V∈Rd×d为右奇异向量矩阵。

矩阵Zp可表示为奇异值和奇异向量的加权和:

(8)

式中:σi为奇异值;ui和vi分别为U和V的第i列;p=min(m,d)。为了降低维度,仅保留前k个最大的奇异值及其对应的奇异向量,秩为k情况下矩阵Zk的最佳近似满足以下形式:

(9)

式中:Uk∈Rm×k;Σk∈Rk×k;Vk∈Rd×k。降维后注意力输出矩阵的维度从m×d降低至m×k。

引入SVD后,计算过程包括计算Z的截断S及后续处理降维后的矩阵,最终复杂度为O(md2+m2d+mdk+m2k)。由于k<<d,复杂度显著降低。SVD方法的降维流程如图3所示。

图3 SVD方法的降维流程

Figure 3 Dimensionality reduction process using SVD

SVD通过保留最大奇异值,有效提取注意力矩阵中最重要的信息,减少无关或冗余数据的干扰,并降低了内存需求。对于时序数据而言,通常表现出周期性或趋势性,这些特征在奇异值分解中对应于较大的奇异值及其关联的奇异向量。通过截断SVD,去除噪声和冗余信息,从而增强模型对核心特征的捕捉能力,提升预测的准确性和鲁棒性。

2 实验设置

2.1 数据集

本文实验在以下8个公开基准数据集上进行。其中,ETT[22]记录了电力变压器中与油温相关的运行参数,包含来自2个独立变压器共7个特征;Traffic[22]记录了美国加州交通部门高速公路网络中862个传感器测得的每小时道路占用率;Electricity[23]记录了321名用户每小时的用电量(单位:kW·h),涵盖2012年至2014年的用电记录;Exchange-Rate[24]收集了1990年至2016年8个不同国家每日相对于美元的汇率;Weather[22]包含了2020年德国气象站记录的21项气象指标。

在数据预处理阶段,首先,对每个数据集的时序特征应用Z-score归一化处理,公式表示为

(10)

式中:μx和σx分别基于训练集的均值和标准差计算。其次,针对缺失值问题,采用线性插值法进行填补[25],该方法通过相邻观测值的加权平均估算缺失点,有效维护时序的连续性特征。最后,对于具有明显周期特性的数据集,例如ETT和Weather,通过引入时间戳特征,例如小时序数和星期序数,以增强模型对时序模式的捕捉能力。

数据集被划分为训练集、验证集和测试集,按照7∶2∶1的比例分割。输入序列长度统一固定为96时间步,预测长度设置为多尺度任务{96, 192, 336, 720},覆盖短期至长期预测场景。

2.2 评估指标

为了全面评估模型在时序预测中的表现、复杂度和实时性,本文采用5个指标来评估模型性能,包括参数量、均方误差(MSE)、平均绝对误差(MAE)、计算量以及推理速度。其中,参数量指模型中所有参数的总数,用于反映模型的大小和存储需求。参数量越小,表示模型越轻量化,存储需求也越低。MSE和MAE[26]数值越小表示模型性能越好,MSE和MAE公式如下:

(11)

(12)

式中:yi为实际值;![]() 为预测值;n为样本数量。计算量衡量一个网络模型的计算复杂度。推理速度指模型每次迭代处理一个批次数据所需的时间。

为预测值;n为样本数量。计算量衡量一个网络模型的计算复杂度。推理速度指模型每次迭代处理一个批次数据所需的时间。

2.3 实验环境

本文全部实验均在一个高性能虚拟化计算平台上完成。该平台配备了NVIDIA虚拟GPU技术。具体的硬件配置包括4个虚拟CPU核心、16 GB内存和1块NVIDIA VGPU50-12虚拟显卡。在软件环境方面,本文采用Python 3.8作为编程语言,并基于PyTorch 2.0.0框架开发。

模型训练采用Adam优化器,其学习率为0.001,批量大小为256。所有模型均训练100个epoch,并在每个epoch结束后在验证集上评估性能,保存验证损失最小的模型用于最终测试。为充分保证实验的可复现性,本文固定了PyTorch、NumPy和Python随机数生成器的种子,并对所有超参数进行严格控制和记录。

3 结果分析

在时序数据预测领域,Informer模型[22]、Reformer模型[27]和Flashformer模型[28]在减轻注意力负担方面具有典型性。其中,Informer模型通过引入稀疏注意力和蒸馏技术将计算复杂度从二次方降低到接近线性;Reformer模型通过局部敏感哈希机制使自注意力机制仅关注序列中最相关部分从而降低计算复杂度;Flashformer模型通过引入门控注意力单元(GAU)来提高处理长序列数据的效率。

为评估ILformer模型中注意力机制改进带来的效果,本文选取以上3个模型作为baseline。同时,为进一步验证ILformer模型的有效性,还将其与iTransformer和Transformer模型进行对比实验。

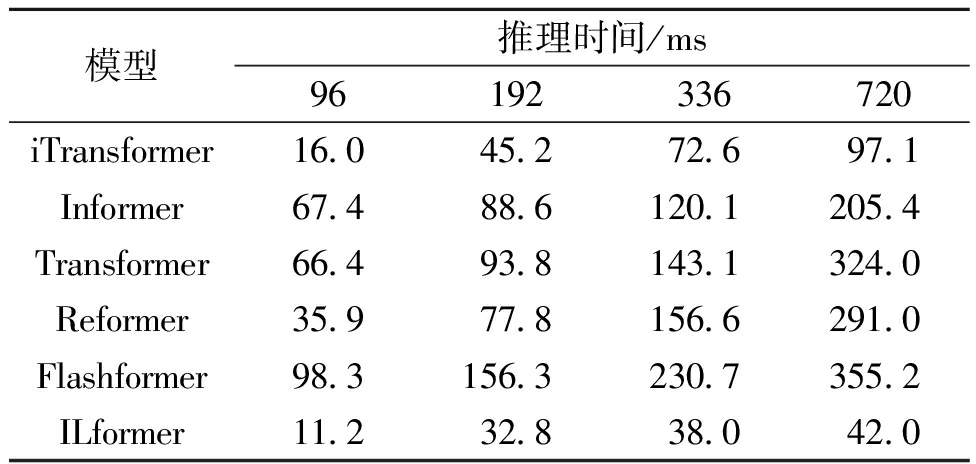

3.1 时效性分析

为了验证ILformer模型在推理过程中的优势,本文在ETT数据集上对比了不同算法在不同预测长度下的推理表现,实验结果见表1。从实验结果可知,不同模型的增长速度存在显著差异,ILformer的推理时间在不同预测长度下表现出平稳的增长趋势,从96步预测时的11.2 ms增加到720步预测时的42.0 ms,总增幅约为274.1%。相比之下,Informer 和 Transformer 在较长预测长度下的推理时间显著增加,特别是在720步预测时,推理时间超过200 ms,Transformer 增幅为387.8%,表现出较高的计算延迟。Flashformer在720步预测时推理时间达到355.2 ms,表明其对预测长度变化具有高敏感性。在预测长度为96步时,ILformer 相比原模型 iTransformer推理时间缩短30.0%。总体而言,ILformer在各预测长度下推理时间平均减少约30 ms,减少比例超过40.46%。这些结果表明,ILformer在推理过程中的高效性和对预测长度变化的鲁棒性,使其在实时性要求较高的任务中具有显著优势。

表1 不同算法的推理时间对比

Table 1 Inference time comparison of different algorithms

模型推理时间/ms96192336720iTransformer16.045.272.697.1Informer67.488.6120.1205.4Transformer66.493.8143.1324.0Reformer35.977.8156.6291.0Flashformer98.3156.3230.7355.2ILformer11.232.838.042.0

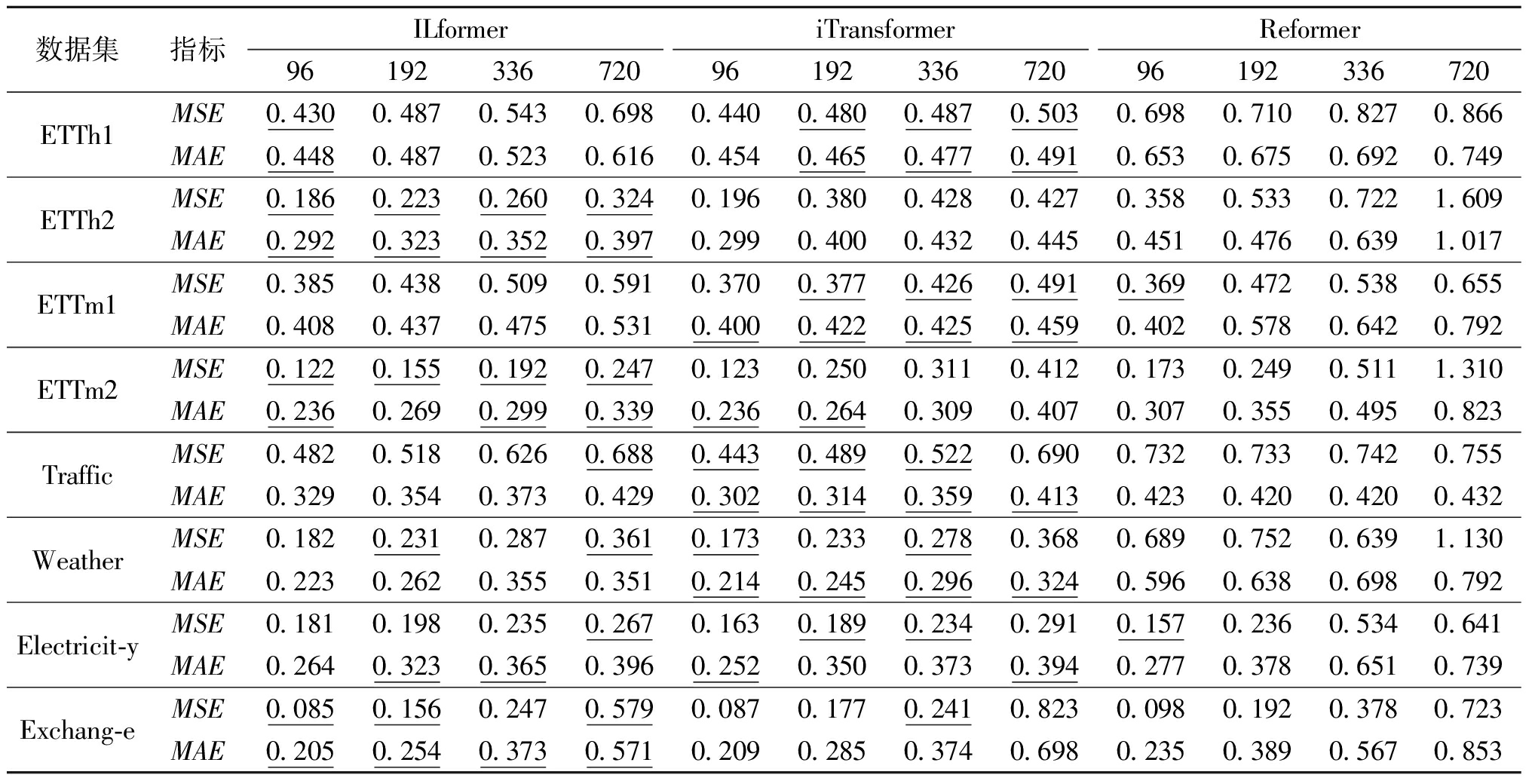

3.2 预测误差分析

本文对比了ILformer、iTransformer及经典轻量化模型Reformer在8个数据集上的评估结果,选取 MSE和MAE作为评价指标,结果如表2所示,实验结果中,对MSE和MAE的最优值进行了下划线标注。

表2 不同算法的MSE/MAE对比

Table 2 MSE/MAE comparison of different algorithms

数据集指标ILformeriTransformerReformer961923367209619233672096192336720ETTh1MSE0.4300.4870.5430.6980.4400.4800.4870.5030.6980.7100.8270.866MAE0.4480.4870.5230.6160.4540.4650.4770.4910.6530.6750.6920.749ETTh2MSE0.1860.2230.2600.3240.1960.3800.4280.4270.3580.5330.7221.609MAE0.2920.3230.3520.3970.2990.4000.4320.4450.4510.4760.6391.017ETTm1MSE0.3850.4380.5090.5910.3700.3770.4260.4910.3690.4720.5380.655MAE0.4080.4370.4750.5310.4000.4220.4250.4590.4020.5780.6420.792ETTm2MSE0.1220.1550.1920.2470.1230.2500.3110.4120.1730.2490.5111.310MAE0.2360.2690.2990.3390.2360.2640.3090.4070.3070.3550.4950.823TrafficMSE0.4820.5180.6260.6880.4430.4890.5220.6900.7320.7330.7420.755MAE0.3290.3540.3730.4290.3020.3140.3590.4130.4230.4200.4200.432WeatherMSE0.1820.2310.2870.3610.1730.2330.2780.3680.6890.7520.6391.130MAE0.2230.2620.3550.3510.2140.2450.2960.3240.5960.6380.6980.792Electricit-yMSE0.1810.1980.2350.2670.1630.1890.2340.2910.1570.2360.5340.641MAE0.2640.3230.3650.3960.2520.3500.3730.3940.2770.3780.6510.739Exchang-eMSE0.0850.1560.2470.5790.0870.1770.2410.8230.0980.1920.3780.723MAE0.2050.2540.3730.5710.2090.2850.3740.6980.2350.3890.5670.853

根据表2实验结果可知,其与iTransformer模型、Reformer模型相比,ILformer在多个数据集上的预测精度表现更加优秀,取得了最好的效果。具体而言,在ETTh2和ETTm2电力能源数据集上,ILformer模型在大多数预测步长中均取得了最佳结果,相较于原模型iTransformer,MSE分别下降30.1%和13.5%,MAE分别下降34.7%和6.0%;同样地,在Exchange-e汇率数据集上,ILformer的各项评价指标在大多数步长中领先。无论是MSE还是MAE,ILformer的性能均优于经典轻量化模型Reformer,进一步验证了所提模型的有效性。

然而,在Traffic交通流量数据集上,ILformer的表现相对一般。主要原因在于Traffic数据集具有高度的非平稳性和较强的噪声特性,交通流量易受多种不确定因素的影响,如突发事件、天气变化等。在这些因素共同作用下,数据呈现出显著的随机波动和短期变化。这种复杂的时序特征增加了模型在捕捉短期依赖关系时的难度。总体而言,ILformer在大多数数据集上表现优异,证明其在时序预测任务中的性能优势。

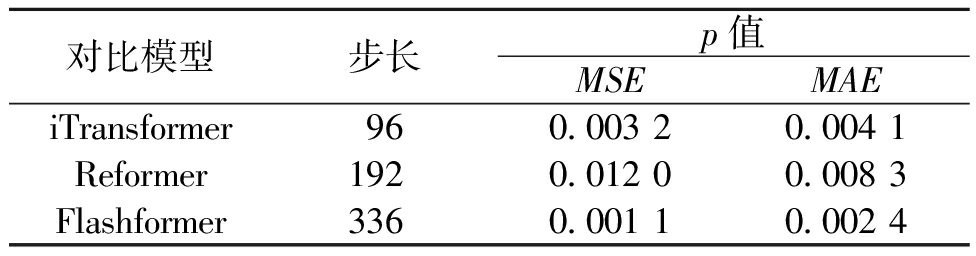

为验证性能差异的统计显著性,本文采用配对t检验(显著性水平α=0.05)对ILformer与baseline模型(iTransformer、Reformer及Flashformer)的MSE/MAE进行10次重复实验分析,统计显著性检验结果如表3所示。由表3可知,ILformer与iTransformer在96步预测的MSE差异的p值为0.003 2(<0.01),具有高度统计显著性。所有比较的p值均小于0.05,表明性能改进不是随机波动所致。

表3 统计显著性检验结果

Table 3 Statistical significance test results

对比模型步长p值MSEMAEiTransformer960.003 20.004 1Reformer1920.012 00.008 3Flashformer3360.001 10.002 4

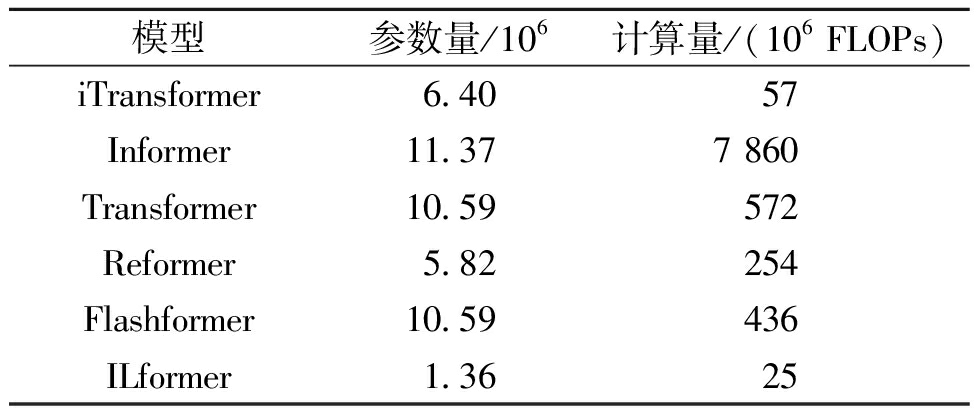

3.3 参数量与计算复杂度分析

本文还对比了不同算法的参数量和计算量,结果如表4所示。由表4可知,ILformer模型在参数量和计算量方面表现出显著优势。Transformer、Informer和Flashformer等模型的参数量较大,导致在训练和推理过程中占用更多内存,增加了硬件资源需求和计算负担。而 ILformer的参数量仅为1.36×106,是对比模型中最小的,为原模型的1/5左右,大幅降低了内存占用。ILformer的计算量,远低于其他模型,体现了其轻量化设计的有效性。

表4 不同算法的参数量和计算量对比

Table 4 Parameter counts and operations comparison of different algorithms

模型参数量/106计算量/(106 FLOPs)iTransformer6.4057Informer11.377 860Transformer10.59572Reformer5.82254Flashformer10.59436ILformer1.3625

实验结果表明,ILformer不仅在存储效率上显著优化,还极大地降低了计算复杂度,为高效的时序预测任务提供了更优的解决方案。

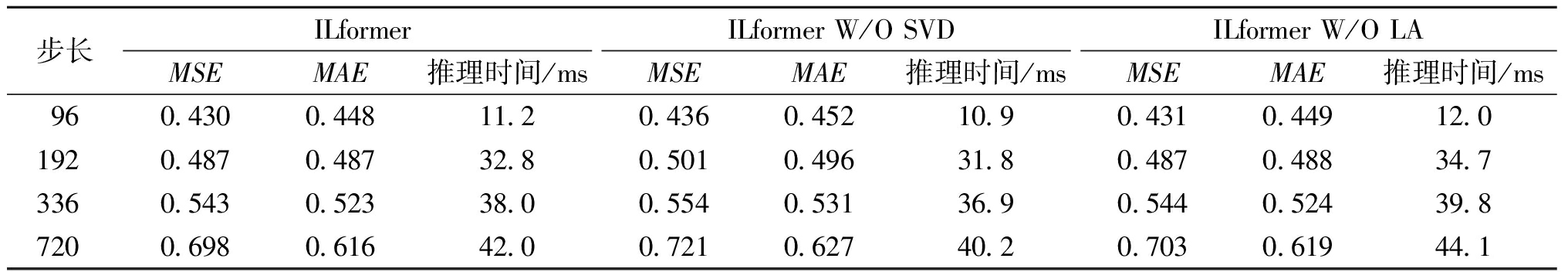

3.4 消融实验

为验证ILformer的结构有效性,本文设计了相应的消融实验。表5展示了从ILformer中移除两个关键方法后得到的实验结果,其中ILformer W/O SVD指未对注意的输入进行矩阵分解降维的模型;ILformer W/O LA指采用普通多头注意力机制替代线性注意力机制的模型。所有模型均在ETT数据集上使用相同的超参数进行评估。从实验结果可知,随着时间步长的增加,所有模型的预测误差(包括MSE和MAE)普遍上升,表明长时间预测更具挑战性。在不同时间步长下,ILformer的预测误差始终较低,尤其在短时间步长下表现尤为显著,验证了线性注意力机制和降维方法在提升模型预测精度方面的协同作用。去除线性注意力机制(ILformer W/O LA)时,推理时间略有增加,同时预测精度有所下降。这表明线性注意力机制不仅提升了预测精度,还显著加快了推理速度。在去除矩阵分解降维(ILformer W/O SVD)后,尽管推理速度有所提升,但预测精度略有下降,进一步说明降维方法对模型精度的积极影响。根据实验结果,ILformer和ILformer W/O LA在大多数时间步长下的预测误差低于不采用降维的模型,证明降维不会影响预测精度。线性注意力机制与降维方法的结合,既能保持较高的计算效率,又能不影响预测精度。总之,消融实验结果充分证明了线性注意力机制和降维方法对ILformer模型性能的关键贡献。这些改进不仅提升了模型的预测精度和推理效率,还为未来的模型优化和实际应用提供了重要的参考依据。

表5 消融实验

Table 5 Ablation experiment

步长ILformerILformer W/O SVDILformer W/O LAMSEMAE推理时间/msMSEMAE推理时间/msMSEMAE推理时间/ms960.4300.44811.20.4360.45210.90.4310.44912.01920.4870.48732.80.5010.49631.80.4870.48834.73360.5430.52338.00.5540.53136.90.5440.52439.87200.6980.61642.00.7210.62740.20.7030.61944.1

4 结论

本文设计并实现了一种轻量级时序预测模型ILformer,解决了Transformer类时序模型难以平衡计算效率和预测精度的问题。通过线性化注意力机制的优化,ILformer推理速度提高了40.46%,满足了时序预测对实时性的要求。ILformer的分解降维处理有效减少了模型参数量,参数量减少了78.75%,大幅度降低了存储需求,使模型更加轻量化。在线性化注意力和降维优化的共同作用下,ILformer的计算量降至原模型的一半,有效减轻了计算负担。此外,ILformer使用奇异值分解进行降维,通过对信号能量的重新分布,能够精准地从数据中蒸馏出序列的长期趋势与周期性核心模式。但是,ILformer在处理高波动时序时表现相对一般,主要因交通流量易受突发事件和天气干扰,呈现非平稳性。同时,模型对短序列敏感,因降维会损失细节特征,例如消融实验所示,SVD移除时MSE略有上升。此外,ILformer依赖全局注意力机制,在极长序列(大于1 000步)下计算效率仍受限;ILformer在720步预测时推理时间达42.0 ms,虽优于baseline,但对实时性要求较高场景,例如毫秒级金融交易,仍需提升。

[1] MENDIS K, WICKRAMASINGHE M, MARASINGHE P. Multivariate time series forecasting: a review[C]∥Proceedings of the 2024 2nd Asia Conference on Computer Vision, Image Processing and Pattern Recognition. New York: ACM, 2024: 1-9.

[2] 梁宏涛, 刘硕, 杜军威, 等. 深度学习应用于时序预测研究综述[J]. 计算机科学与探索, 2023, 17(6): 1285-1300.LIANG H T, LIU S, DU J W, et al. Review of deep learning applied to time series prediction[J]. Journal of Frontiers of Computer Science &Technology, 2023, 17(6): 1285-1300.

[3] ZAREMBA W, SUTSKEVER I, VINYALS O. Recurrent neural network regularization[EB/OL].(2014-09-08)[2025-08-13]. https:∥doi.org/10.48550/arXiv.1409.2329.

[4] HOCHREITER S, SCHMIDHUBER J. Long short-term memory[J]. Neural Computation, 1997, 9(8): 1735-1780.

[5] HE Z S, ZHANG X, LI M, et al. A novel solar radiation forecasting model based on time series imaging and bidirectional long short-term memory network[J]. Energy Science &Engineering, 2024, 12(11): 4876-4893.

[6] HARISH NAYAK G H, ALAM M W, AVINASH G, et al. Transformer-based deep learning architecture for time series forecasting[J]. Software Impacts,2024,22: 100716.

[7] VASWANI A, SHAZEER N, PARMAR N, et al. Attention is all you need[C]∥Proceedings of the 31st International Conference on Neural Information Processing Systems (NIPS). New York:ACM, 2017: 6000-6010.

[8] NIE Y Q, NGUYEN N H, SINTHONG P, et al. A time series is worth 64 words: long-term forecasting with transformers[EB/OL]. (2022-11-27)[2025-08-13]. https:∥doi.org/10.48550/arXiv.2211.14730.

[9] LIU Y, HU T G, ZHANG H R, et al. iTransformer: inverted transformers are effective for time series forecasting[EB/OL]. (2023-10-10)[2025-08-13]. https:∥doi.org/10.48550/arXiv.2310.06625.

[10] 姜晓勇, 李忠义, 黄朗月, 等. 神经网络剪枝技术研究综述[J]. 应用科学学报, 2022, 40(5): 838-849.JIANG X Y, LI Z Y, HUANG L Y, et al. Review of neural network pruning techniques[J]. Journal of Applied Sciences, 2022, 40(5): 838-849.

[11] 高杨, 曹仰杰, 段鹏松. 神经网络模型轻量化方法综述[J]. 计算机科学, 2024, 51(增刊1): 11-21.GAO Y, CAO Y J, DUAN P S. Lightweighting methods for neural network models: a review[J]. Computer Science, 2024, 51(S1): 11-21.

[12] 王改华, 李柯鸿, 龙潜, 等. 基于知识蒸馏的轻量化Transformer目标检测[J]. 系统仿真学报, 2024, 36(11): 2517-2527.WANG G H, LI K H, LONG Q, et al. Object detection of lightweight Transformer based on knowledge distillation[J]. Journal of System Simulation, 2024, 36(11): 2517-2527.

[13] SAHA R, SRIVASTAVA V, PILANCI M. Matrix compression via randomized low rank and low precision factorization[EB/OL]. (2023-10-17)[2025-08-13]. https:∥doi.org/10.48550/arXiv.2310.11028.

[14] YANG X H, LIU W F, LIU W, et al. A survey on canonical correlation analysis[J]. IEEE Transactions on Knowledge and Data Engineering, 2021, 33(6): 2349-2368.

[15] HAN K, WANG Y H, CHEN H T, et al. A survey on vision transformer[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2023, 45(1): 87-110.

[16] 孟祥福, 石皓源. 基于Transformer模型的时序数据预测方法综述[J]. 计算机科学与探索, 2025, 19(1): 45-64.MENG X F, SHI H Y. Survey of Transformer-based model for time series forecasting[J]. Journal of Frontiers of Computer Science &Technology, 2025, 19(1): 45-64.

[17] 连家诚. 面向长序列Transformer的计算简化[D]. 合肥: 中国科学技术大学, 2023.LIAN J C. Computational simplification for long sequence Transformer[D]. Hefei: University of Science and Technology of China, 2023.

[18] ANTONELLI M, LAGO U D, DAVOLI D, et al. An arithmetic theory for the poly-time random functions[EB/OL]. (2023-01-27)[2025-08-13].https:∥doi.org/10.48550/arXiv.2301.12028.

[19] TAY Y, DEHGHANI M, BAHRI D, et al. Efficient transformers: a survey[J]. ACM Computing Surveys, 2022, 55(6): 1-28.

[20] CHEN B D, DAO T, WINSOR E, et al. Scatterbrain: unifying sparse and low-rank attention approximation[EB/OL]. (2021-10-28)[2025-08-13].https:∥doi.org/10.48550/arXiv.2110.15343.

[21] BOYAPATI M, AYGUN R. Semanformer: semantics-aware embedding dimensionality reduction using transformer-based models[C]∥2024 IEEE 18th International Conference on Semantic Computing. Piscataway:IEEE, 2024: 134-141.

[22] ZHOU H Y, ZHANG S H, PENG J Q, et al. Informer: beyond efficient transformer for long sequence time-series forecasting[J]. Proceedings of the AAAI Conference on Artificial Intelligence, 2021, 35(12): 11106-11115.

[23] SALINAS D, FLUNKERT V, GASTHAUS J, et al. DeepAR: probabilistic forecasting with autoregressive recurrent networks[J]. International Journal of Forecasting, 2020, 36(3): 1181-1191.

[24] QIN Y, SONG D J, CHENG H F, et al. A dual-stage attention-based recurrent neural network for time series prediction[C]∥Proceedings of the 26th International Joint Conference on Artificial Intelligence. New York: ACM, 2017: 2627-2633.

[25] NI Z L, YU H, LIU S Z, et al. BasisFormer: attention-based time series forecasting with learnable and interpretable basis[EB/OL]. (2023-10-31)[2025-08-13].https:∥doi.org/10.48550/arXiv.2310.20496.

[26] KONG X J, CHEN Z H, LIU W Y, et al. Deep learning for time series forecasting: a survey[J]. International Journal of Machine Learning and Cybernetics, 2025, 16(7): 5079-5112.

[27] KITAEV N, KALEV L, LEVSKAYA A, et al. Reformer: the efficient transformer[EB/OL]. (2020-01-13)[2025-08-13].https:∥doi.org/10.48550/arXiv.2001.04451.

[28] DAO T, FU D Y, ERMON S, et al. Flashattention: fast and memory-efficient exact attention with io-awareness[C]∥36th Conference on Neural Information Processing Systems.Cambridge:MIT,2022:16344-16359.