车辆重识别(vehicle re-identification, VeReID)是智能交通系统中不可或缺的组成部分,旨在从不同摄像头捕获的车辆图像中检索重复出现的目标车辆。随着计算机视觉研究领域的发展[1-2],车辆重识别技术取得了显著进展[3-4]。然而,在实际场景中,车辆经常受到遮挡,导致部分视觉信息丢失。部分研究者采用像素擦除方法模拟遮挡[5],但在真实交通场景中,行人往往是主要遮挡因素,具体表现为:不同衣着的行人遮挡会引起深度学习模型提取的车辆特征的显著差异;行人遮挡是动态的,遮挡位置的变化会影响特征的提取,从而降低识别精度。此外,摄像头视角变化也会增加车辆特征提取的难度。近年来,相关研究聚焦于改进特征提取网络[6-7],而另一些研究则专注于优化损失函数[8-9],而针对行人干扰问题的研究明显不足,这在一定程度上制约了该技术在实际场景中的应用。

Nguyen等[10]提出了使用共现信息的互相重新排名策略,显著提高了重识别的准确性。Mansourian等[11]提出了一种联合重识别、队伍分类和角色分类的多任务学习方法,该方法通过共享网络提取球员的不同特征来提升重识别的准确度。Chen等[12]提出了NeighborTrack,这是一种改进单目标跟踪的后处理方法,利用邻域轨迹信息来提高跟踪的稳定性和准确性,该方法特别适用于目标出现遮挡或视角发生变化时的场景。

在车辆重识别领域,众多研究都依赖高质量的数据集对模型进行训练和评估。近年来,多个重要的数据集被广泛用于这一研究领域。Liu等[13]发布了VeRi-776数据集,该数据集包含776辆车的50 000多张图像,这些图像是在不同的时间、不同的条件下通过固定的摄像头拍摄的。北京大学收集了一个被广泛使用的ReID基准数据集——VehicleID数据集[14],该数据集由约26 000辆不同车辆的240 000多张图像组成。包含在不同环境条件和相机角度下拍摄的各种类型的车辆,如轿车、卡车和公共汽车)。

然而,在真实场景中,行人干扰给车辆重识别带来了巨大挑战,传统方法在准确性和鲁棒性方面均面临考验。为解决这一问题,本文提出了轨迹优化与背景抑制(track refinement and background suppression, TRaBS)算法,通过轨迹特征匹配和背景噪声消除来有效应对行人干扰对车辆重识别的影响。

1 抗干扰车辆重识别算法

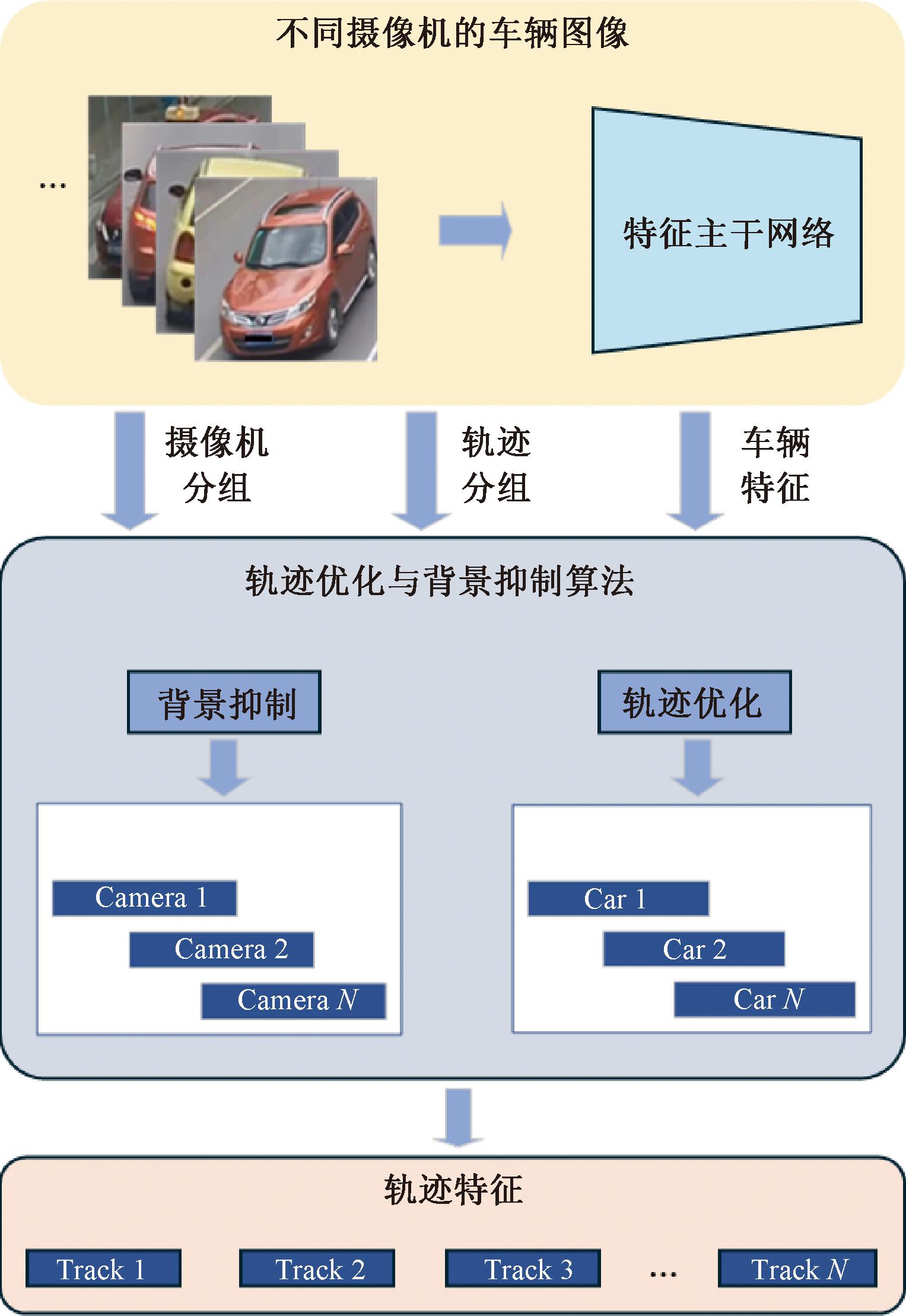

本文提出的TRaBS算法结构如图1所示。该算法旨在解决传统车辆重识别研究中尚未充分解决的行人干扰问题,旨在通过这一关键问题的突破,推动车辆重识别系统在实际场景中的可行部署与应用。

图1 TRaBS算法结构图

Figure 1 Structure diagram of TRaBS

1.1 轨迹优化

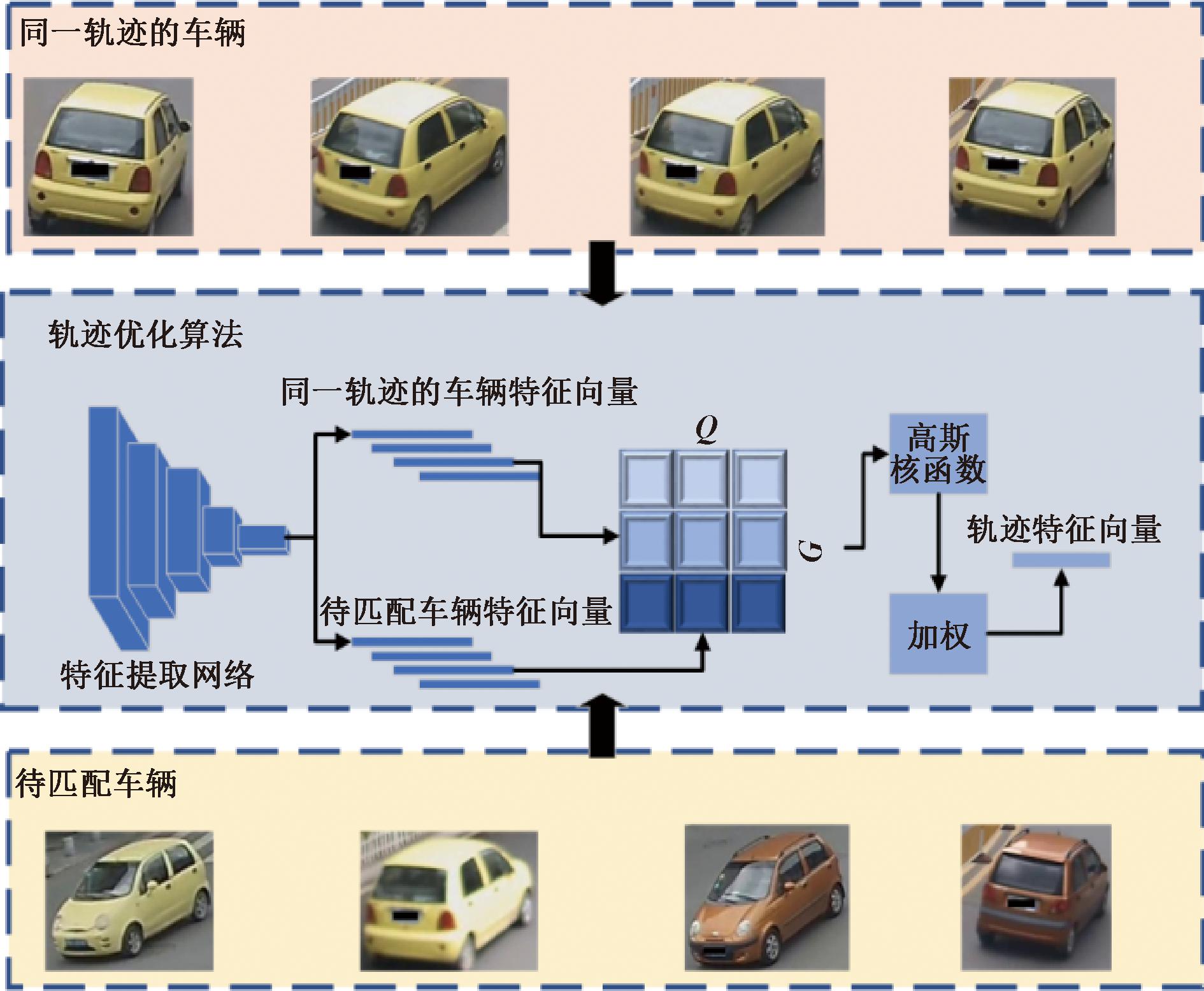

轨迹优化算法的核心目标是利用轨迹特征替代传统的单一车辆特征,如图2所示为轨迹优化算法结构,此方法将匹配过程从单幅图像与单幅图像之间的匹配转变为单幅图像与多幅图像集的匹配,从而提高了车辆特征的鲁棒性和重识别的准确率。

图2 轨迹优化算法结构图

Figure 2 Structure diagram of track refinement

尽管利用轨迹优化方法可以增强车辆重识别的性能,但该方法也面临一些挑战,例如,同一轨迹ID下的多幅车辆图像常因行人干扰、图像模糊等因素而存在质量差异,若简单地对这些图像进行特征平均往往难以有效处理多样化的图像特征。为了解决这一问题,本文采用一种无监督的方法,以不引入额外模型的方式对图像进行权重分配,该方法更具价值且易于应用。

受He等[15]研究的启发,如果一张图库图像和某张查询图像具有相同的ID,那么这张图库图像很可能是其所属轨迹ID中质量最高的一张。依据此思路的逆向推理,如果一张图库图像与某张查询图像越相似,那么这张图库图像的权重应该越大。因此,通过计算查询图像和图库图像之间的特征距离矩阵,可以得到每个图库图像在其所属多张图像中应该分配的权重。但是,此方法同样存在一些问题,使用欧几里得距离来处理两个向量之间的距离问题时得到的结果过于扁平,而车辆的特征是一个比较复杂且非线性的数据,欧几里得距离在处理这种非线性的关系时表现较差。本文通过引入高斯核函数[16]来计算同一轨迹中图库图像的权重,其实质是一种相似性度量,并且衡量的是两个点之间的接近程度而非距离。这种相似性度量基于点与点之间的“接近性”来计算,而非直接计算距离。高斯核函数计算为

(1)

式中:x和y为两个特征向量;‖x-y‖表示两个向量之间的欧几里得距离;σ为控制核宽度的参数,取训练集特征向量的标准差。

具体来说,首先计算代表查询图像集与图库图像集相似的欧几里得距离矩阵Dist(Q,G),其中Q为查询图像集,记为{Q1,Q2,…,Qn};G为图库图像集,记为{G1,G2,…,Gn},对应算法1的输入。根据欧几里得距离矩阵计算出高斯核距离矩阵并且对每行进行归一化得到Gaus(Q,G)。接下来,计算查询图像集与属于同一轨迹ID的图库图像之间相似性的子矩阵Gaus(Q,Gi),其中,Gi为所有轨迹ID为i的图库图像的集合,记为{G1,G2,…,Gj}。然后选择 Gaus(Q,Gi)中最大值高于0.6的行,记为 D′,此操作筛除了差异较大的查询图像。D′是与轨迹ID为i的图库图像集最相似的查询图像。计算D′中每一列的平均值,可以得到该轨迹ID为i的权值平均向量Ai。加权向量的计算为

Wij=Aij-0.01。

(2)

式中:0.01为最小权值下限,即小于0.01的权值会被直接忽略。

轨迹优化的权值计算算法如算法1所示。

算法1 轨迹优化算法。

输入:查询图片特征向量集Q、图库图片特征向量集G;

输出:车辆图片权值矩阵W。

① WE=Euclid(Q,G);

② WG=Gaus(WE);

③ Gaus(Q,Gi)←同一轨迹ID的图库图片汇总到一行组成子矩阵;

④ D′←Gaus(Q,Gi)>0.6;

⑤ While x<j do

⑥ Ai=D′每一列取均值;

⑦ Wi=Ai-0.01;

⑧ End while

利用所求加权向量,轨迹的加权平均特征的计算式为

(3)

式中:F(Gi)为轨迹ID为i的图库图像的特征集合。对结果再进行排名后得到单幅图像到多幅图像的距离矩阵Dist(Q,Gi),通过这个距离矩阵得到重识别的结果。

1.2 背景抑制

背景抑制算法的目标旨在通过整合摄像机的特征信息,减少拍摄背景对车辆特征提取的影响。在车辆重识别任务中,每幅车辆图像都不可避免地包含拍摄场地的背景信息,这导致在特征提取过程中模型往往将车辆和环境背景的特征一同提取,从而影响ReID模型的泛化性和鲁棒性。为了解决上述问题,本文通过优化特征提取过程,削弱背景信息的干扰,从而提高模型对目标车辆特征的提取能力。

同一个摄像机(固定机位)的拍摄背景是固定的,直观上讲,在无法将车辆与背景分离这一前提下,如果可以在提取特征时减弱背景的特征,就可以最大限度地消除背景对车辆特征的影响。

具体来说,对于测试集中属于第C个相机和T个轨迹的图像P,经过模型提取后的特征表示为gp,然后计算第C个相机捕获的所有图像的平均特征,并将平均特征记为![]() 为减少摄像机的背景偏差,图像P的单幅特征fP的计算为

为减少摄像机的背景偏差,图像P的单幅特征fP的计算为

(4)

式中:α为g和![]() 之间的平衡权重。在计算属于第C个相机的所有图像的平均特征时,图像ID信息被忽略。因此,

之间的平衡权重。在计算属于第C个相机的所有图像的平均特征时,图像ID信息被忽略。因此,![]() 可以有效地表示相机信息,而且在测试集上不需要额外训练摄像机场景模型。

可以有效地表示相机信息,而且在测试集上不需要额外训练摄像机场景模型。

2 实验与结果分析

2.1 实验数据

本文提出的TRaBS算法在两个车辆重识别数据集上进行评估。其中,VeRi-776数据集[13]是车辆重识别领域广泛使用的一个公开数据集,使用37 778张图像作为训练集,11 579张图像作为测试集。

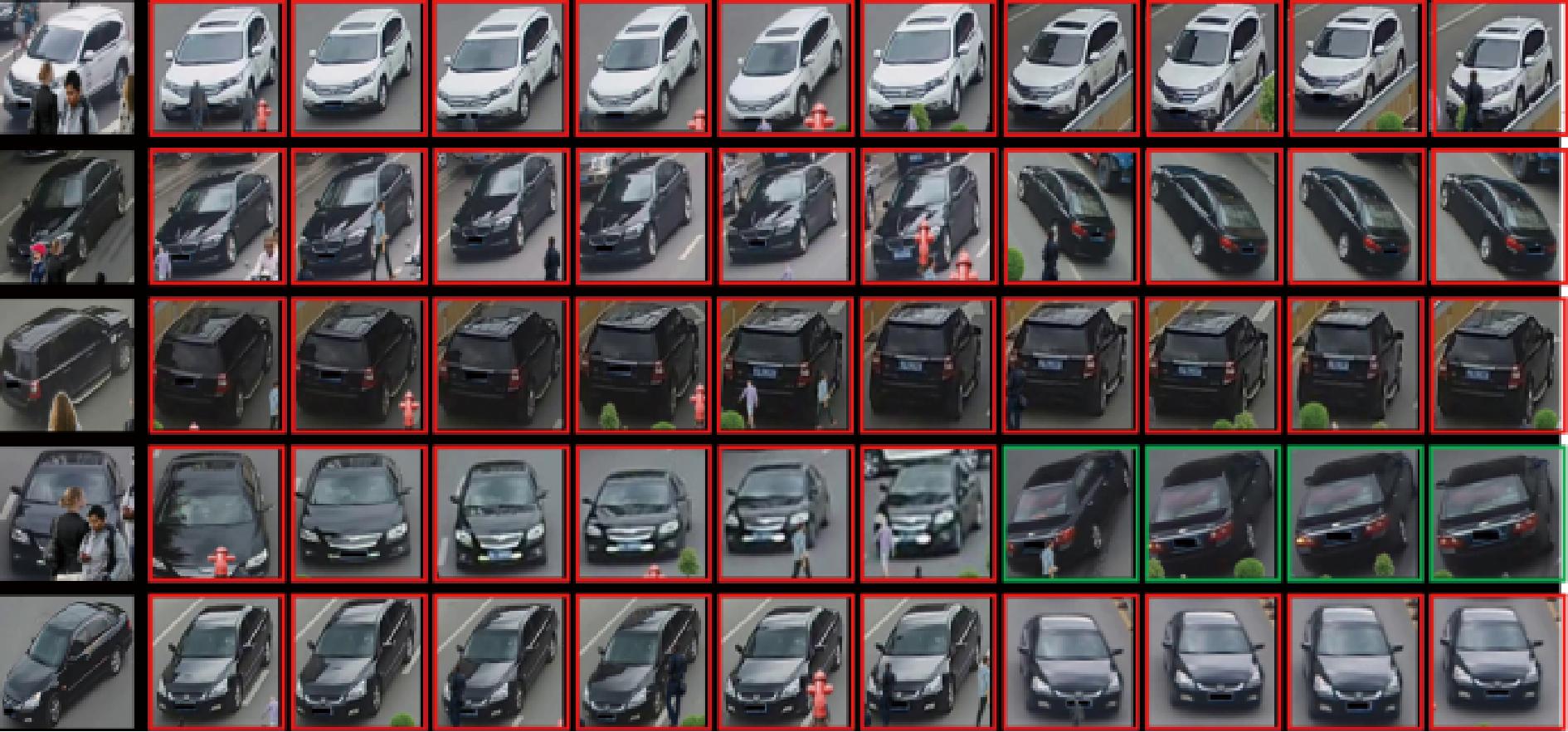

然而,目前绝大多数车辆重识别数据集中图像均是在理想条件下拍摄的无干扰图像,示例如图3所示。本文通过在原始的VeRi-776数据集图像上引入12种不同姿态、不同颜色衣服的行人贴图,创建了干扰数据集VeRi-776-SIM,示例如图4所示。

图3 VeRi-776数据集示例

Figure 3 VeRi-776 dataset samples

图4 VeRi-776-SIM数据集示例

Figure 4 VeRi-776-SIM dataset samples

为了直观评估行人干扰对车辆重识别模型的影响以及验证本文提出方法的抗干扰效果,本文在VeRi-776-SIM数据集上进行实验。为了确保实验结果的可比性,该数据集的划分标准与原始的VeRi-776数据集保持一致。

2.2 实验细节

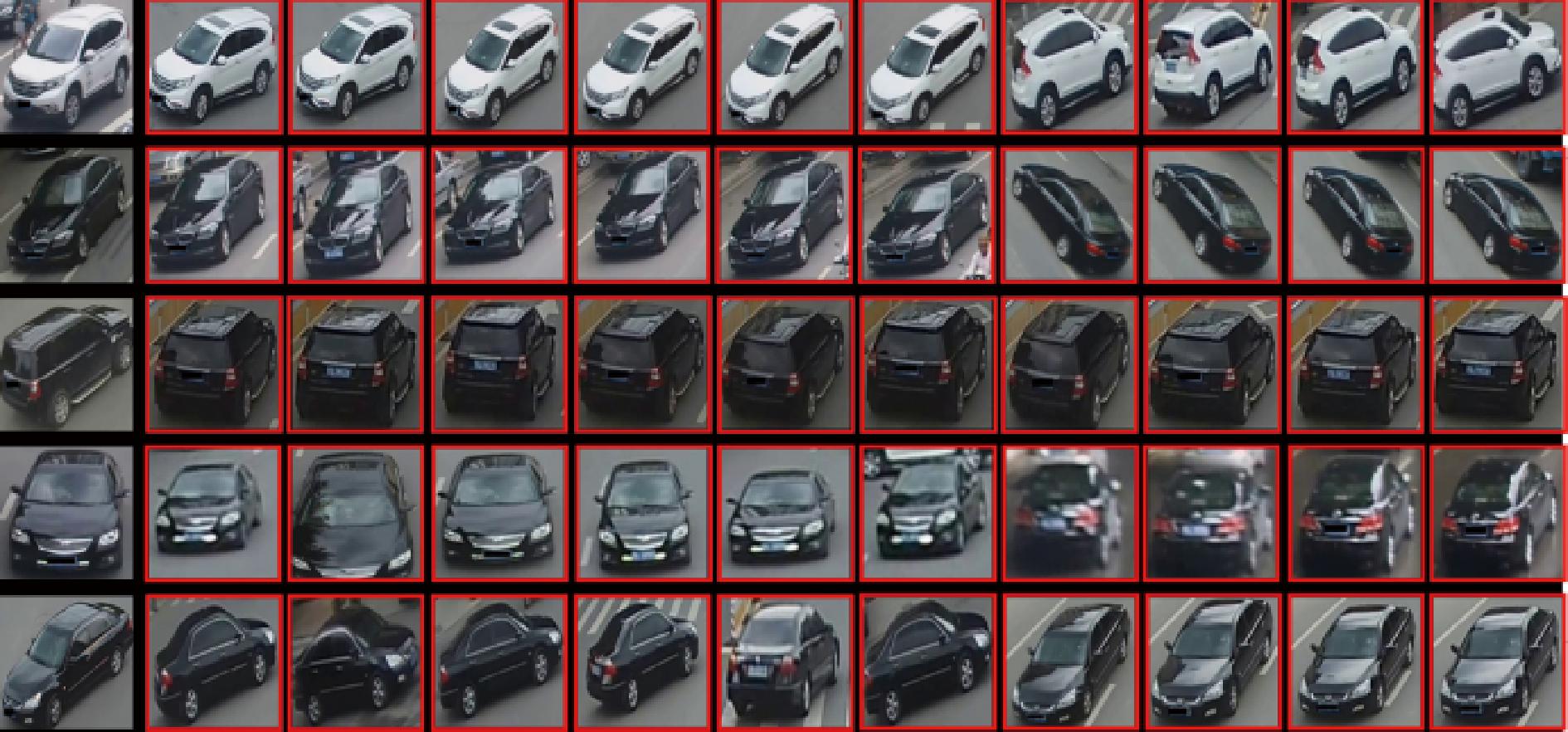

本文的算法在Pytorch 2.1.2中实现,实验在两个NVIDIA A40 GPU上进行。在车辆ReID模型方面,本文选择ResNeXt101-IBN-a[17]作为特征提取网络以及基准模型。本文使用平均精度均值mAP和Rank-1准确率来评估性能。Rank-1准确率表示在查询图像中,目标车辆的最相似匹配是否出现在第1个位置。具体而言,它衡量的是模型将正确车辆识别为最相似车辆的能力。本文的最佳实验结果如图5、图6所示。图5、图6中红色框表示正确的重识别结果,绿色框表示错误的重识别结果。

图5 VeRi-776数据集上最佳重识别效果图

Figure 5 Best re-identification performance chart on the VeRi-776 dataset

图6 VeRi-776-SIM数据集上最佳重识别效果图

Figure 6 Best re-identification performance chart on the VeRi-776-SIM dataset

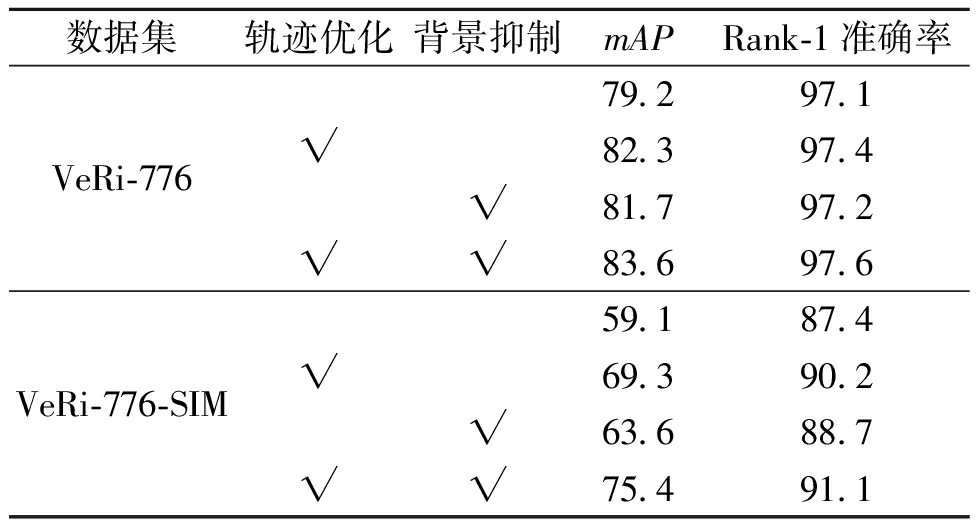

2.3 TRaBS算法的消融实验

为了验证TRaBS算法中两项技术对车辆重识别性能的影响,本文在VeRi-776和VeRi-776-SIM数据集上进行了消融实验,实验结果如表1所示。

表1 TRaBS算法在两个数据集上的消融实验结果

Table 1 Ablation experimental results of TRaBS on two datasets 单位:%

数据集轨迹优化背景抑制mAPRank-1准确率VeRi-77679.297.1√82.397.4√81.797.2√√83.697.6VeRi-776-SIM59.187.4√69.390.2√63.688.7√√75.491.1

由表1可知,使用了TRaBS中两项技术的实验组在两个数据集上得到了最佳的性能指标,且去掉TRaBS算法中任意一项技术,均会导致性能指标的下降。在TRaBS算法的两项技术中,轨迹优化对于性能的提升效果要优于背景抑制。实验结果还显示,采用TRaBS算法的模型在同一数据集上表现出了明显的性能提升,特别是在VeRi-776-SIM数据集上,mAP值提高了16.3百分点。

综上所述,TRaBS算法显著提升了车辆重识别模型在实际环境中的鲁棒性和准确性,尤其是在应对行人干扰时。实验结果不仅验证了TRaBS算法的有效性,还进一步表明两项技术的联合应用比单独使用时能取得更显著的效果。

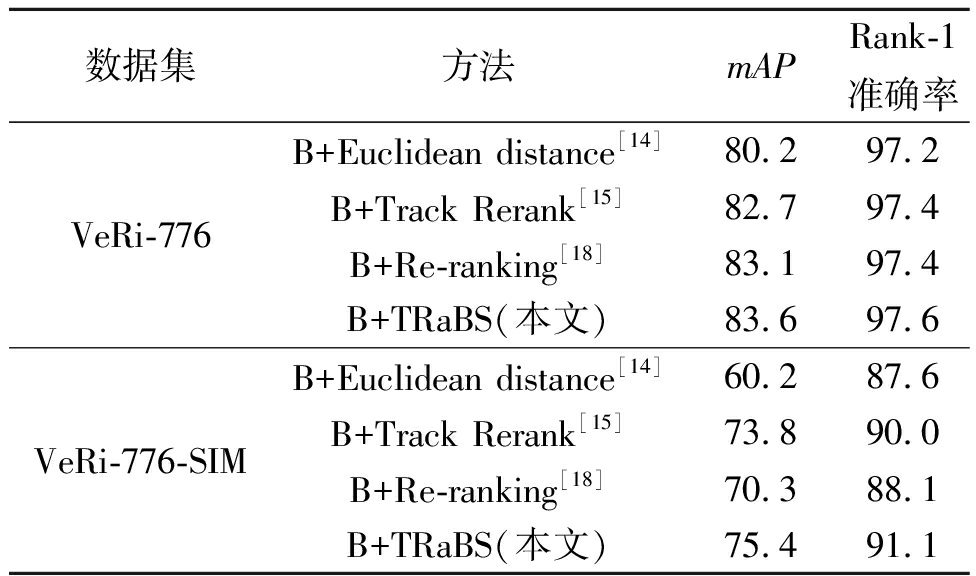

2.4 TRaBS算法对基准模型提升效果的对比实验

为了验证本文提出的TRaBS算法在提升基准模型性能方面的作用,本文在VeRi-776和VeRi-776-SIM数据集上进行了TRaBS算法与其他3种重识别算法的对比实验。本实验选择了3种重识别领域内经典算法进行对比。①基于欧几里得距离(Euclidean distance)的车辆相似度测量方法[14],这一方法通过将车辆特征投影到欧几里得平面来计算两车之间的距离。②Track Rerank方法[15],该方法将车辆特征转化为轨迹特征后进行排序。③Re-ranking方法[18],该方法通过合理的重排序来获得重识别的结果。对比实验结果如表2所示,其中B表示基准模型。

表2 TRaBS算法与其他重识别方法在提升基准模型性能方面的对比结果

Table 2 Comparison of TRaBS algorithm with other re-identification methods in enhancing baseline model performance 单位:%

数据集方法mAPRank-1准确率VeRi-776B+Euclidean distance[14]80.297.2B+Track Rerank[15]82.797.4B+Re-ranking[18]83.197.4B+TRaBS(本文)83.697.6VeRi-776-SIMB+Euclidean distance[14]60.287.6B+Track Rerank[15]73.890.0B+Re-ranking[18]70.388.1B+TRaBS(本文)75.491.1

在VeRi-776-SIM数据集中,行人干扰导致特征畸变,Euclidean distance方法的性能显著下降。在无行人干扰的VeRi-776数据集中,Re-ranking方法优于Track Rerank方法。而在存在行人干扰的VeRi-776-SIM数据集中,Track Rerank表现更为出色,这主要归因于其采用轨迹特征替代单帧图像的单一特征,从而提升了特征表达的鲁棒性。上述结果进一步验证了本文所引入轨迹特征在应对行人干扰方面的有效性。此外,TRaBS算法在两个数据集上均取得了最佳的评估指标,充分证明了其在行人干扰场景下的优越性能。

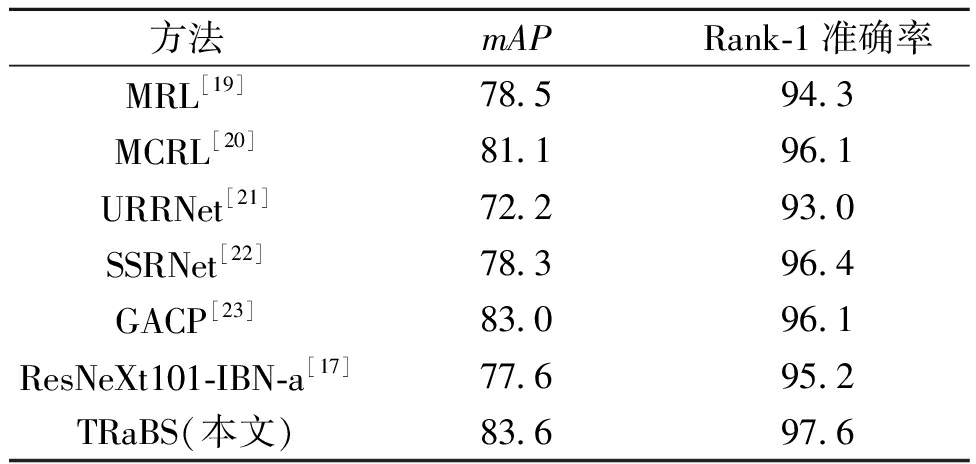

2.5 TRaBS算法与其他方法的性能对比实验

为了验证本文提出的TRaBS算法在车辆重识别效果上的优越性,本文在VeRi-776数据集上将其与其他车辆重识别方法进行比较。对比方法包括几种基于卷积神经网络的算法,如MRL[19]、MCRL[20]、URRNet[21]、SSRNet[22]和GACP[23]。实验结果如表3所示,TRaBS算法优于所有对比方法,取得了最高的性能指标。这一结果显示了TRaBS算法在解决车辆重识别问题上的优势。

表3 不同方法在VeRi-776数据集上重识别效果对比

Table 3 Comparison of re-identification performance of various methods on the VeRi-776 dataset 单位:%

方法mAPRank-1准确率MRL[19]78.594.3MCRL[20]81.196.1URRNet[21]72.293.0SSRNet[22]78.396.4GACP[23]83.096.1ResNeXt101-IBN-a[17]77.695.2TRaBS(本文)83.697.6

综上所述,TRaBS算法不仅能有效应对车辆重识别中的行人干扰问题,还能在无干扰的环境中保持高效性和可靠性。

3 结论

本文提出了一种轨迹优化与背景抑制算法,旨在提升车辆重识别模型的精度和抗干扰能力。该算法通过优化轨迹特征和抑制背景噪声,有效增强了车辆的识别准确性,特别是解决了实际应用中行人干扰的问题。通过广泛的实验验证,证明了该方法在车辆重识别中的显著效果。未来的研究将进一步探索本文所提算法在更复杂的交通场景和环境条件下的应用潜力,并重点优化算法的实时处理能力,以更好地满足实际应用需求。

[1] HAN K, GONG S G, HUANG Y, et al. Clothing-change feature augmentation for person re-identification[C]∥Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE,2023: 22066-22075.

[2] GAO Y L, LU L P, XU B R, et al. Multi-dimensional attention network for vehicle re-identification[C]∥2022 6th CAA International Conference on Vehicular Control and Intelligence. Piscataway: IEEE, 2022: 1-5.

[3] KHORRAMSHAHI P, SHENOY V, CHELLAPPA R. Robust and scalable vehicle re-identification via self-supervision[C]∥2023 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops. Piscataway: IEEE, 2023: 5295-5304.

[4] WANG Y, PENG J J, WANG H B, et al. Progressive learning with multi-scale attention network for cross-domain vehicle re-identification[J]. Science China Information Sciences, 2022, 65(6): 160103.

[5] LUO H, JIANG W, GU Y Z, et al. A strong baseline and batch normalization neck for deep person re-identification[J]. IEEE Transactions on Multimedia, 2020, 22(10): 2597-2609.

[6] YE M, SHEN J B, LIN G J, et al. Deep learning for person re-identification: a survey and outlook[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2022, 44(6): 2872-2893.

[7] NABILA E S, WAHYONO. Person re-identification using background subtraction and Siamese network for pose varians[C]∥2022 8th International Conference on Science and Technology. Piscataway: IEEE, 2022: 1-6.

[8] ZHOU Z L, LI Y J, LI J, et al. GAN-Siamese network for cross-domain vehicle re-identification in intelligent transport systems[J]. IEEE Transactions on Network Science and Engineering, 2023, 10(5): 2779-2790.

[9] LEE S, WOO T, LEE S H. Multi-attention-based soft partition network for vehicle re-identification[J]. Journal of Computational Design and Engineering, 2023, 10(2): 488-502.

[10] NGUYEN N B, NGUYEN V H, NGO T D, et al. Person re-identification with mutual re-ranking[J]. Vietnam Journal of Computer Science, 2017, 4(4): 233-244.

[11] MANSOURIAN A M, SOMERS V, DE VLEESCHOUWER C, et al. Multi-task learning for joint re-identification, team affiliation, and role classification for sports visual tracking[C]∥Proceedings of the 6th International Workshop on Multimedia Content Analysis in Sports. New York:ACM, 2023: 103-112.

[12] CHEN Y H, WANG C Y, YANG C Y, et al. NeighborTrack: improving single object tracking by bipartite matching with neighbor tracklets[EB/OL]. (2022-11-12)[2025-09-18]. https:∥doi.org/10.48550/arXiv.2211.06663.

[13] LIU X C, LIU W, MA H D, et al. Large-scale vehicle re-identification in urban surveillance videos[C]∥2016 IEEE International Conference on Multimedia and Expo.Piscataway: IEEE, 2016: 1-6.

[14] LIU H Y, TIAN Y H, WANG Y W, et al. Deep relative distance learning: tell the difference between similar vehicles[C]∥2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2016: 2167-2175.

[15] HE Z Q, LEI Y, BAI S, et al. Multi-camera vehicle tracking with powerful visual features and spatial-temporal cue[C]∥CVPR Workshops. Piscataway: IEEE, 2019:203-212.

[16] BOSER B E, GUYON I M, VAPNIK V N. A training algorithm for optimal margin classifiers[C]∥Proceedings of the Fifth Annual Workshop on Computational Learning Theory. New York:ACM, 1992: 144-152.

[17] XIE S N, GIRSHICK R, DOLL R P, et al. Aggregated residual transformations for deep neural networks[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2017: 5987-5995.

R P, et al. Aggregated residual transformations for deep neural networks[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2017: 5987-5995.

[18] ZHONG Z, ZHENG L, CAO D L, et al. Re-ranking person re-identification with k-reciprocal encoding[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2017: 3652-3661.

[19] LIN W P, LI Y D, YANG X L, et al. Multi-view learning for vehicle re-identification[C]∥2019 IEEE International Conference on Multimedia and Expo. Piscataway:IEEE, 2019: 832-837.

[20] JIN Y, LI C N, LI Y D, et al. Model latent views with multi-center metric learning for vehicle re-identification[J]. IEEE Transactions on Intelligent Transportation Systems, 2021, 22(3): 1919-1931.

[21] QIAN J C, PAN M T, TONG W, et al. URRNet: a unified relational reasoning network for vehicle re-identification[J]. IEEE Transactions on Vehicular Technology, 2023, 72(9): 11156-11168.

[22] XU Z M, WEI L L, LANG C Y, et al. SSR-net: a spatial structural relation network for vehicle re-identification[J]. ACM Transactions on Multimedia Computing, Communications, and Applications, 2023, 19(6): 1-22.

[23] PANG X Y, TIAN X, NIE X S, et al. Vehicle re-identification based on grouping aggregation attention and cross-part interaction[J]. Journal of Visual Communication and Image Representation, 2023, 97: 103937.