近年来,深度神经网络[1]凭借其卓越的性能在自动驾驶、医学影像处理及物联网边缘设备等领域得到广泛应用。然而,深度神经网络的安全性和可靠性也面临诸多挑战,后门攻击的威胁尤为突出。

后门攻击作为一种训练阶段的攻击方式,对模型训练过程的安全构成了严重的威胁,并且可以通过数据中毒技术轻易实现[2]。具体而言,攻击者在模型训练阶段向部分训练数据中注入预定义的触发器,并将其标签更改为目标标签进行数据投毒,使用这些数据对模型进行训练可以将后门植入模型中。后门模型在对干净输入进行预测时保持正常行为,但对带有触发器的输入,模型的预测结果会被恶意篡改为目标类别。Gu等[3]首次揭示了深度神经网络中的后门威胁,他们使用可见的白色方块作为触发器,但这种触发器容易被人工检测与移除。随着后门攻击技术的发展,后门攻击方法[4-5]的触发器隐匿性不断增强,使得模型后门的移除更加困难。

为了应对后门攻击的威胁,大量的后门防御方法被提出。例如,Tran等[6]利用光谱特征检测过滤中毒样本,并使用净化后的数据对后门模型进行重新训练。Wu等[7]假设与后门相关的神经元对抗性扰动更敏感,并将剪枝过程视为在对抗性扰动下解决极小极大优化问题,以此来去除模型中的后门。Zeng等[8]利用隐式超梯度下降有效地解决了极大极小双优化问题,实现了良好的后门去除效果。Zheng等[9]提出基于熵的剪枝方法来定位和修剪可疑神经元以修复后门模型。然而,这些方法在防御过程中可能仍保留与后门触发器有关的信息,导致后门难以完全清除。此外,因无法访问完整的训练数据,对小部分数据进行微调会引起模型在干净任务上的过拟合,导致其性能降低,并且当训练数据不足或无法访问时,模型的后门移除效果将显著下降。

为了解决上述问题,本文提出了一种新的后门防御方法,即基于剪枝和后门遗忘的无数据后门移除方法(data-free backdoor removal via purning and unlearning,DBR-PU)。该方法将随机通道打乱技术[10-11]和无数据知识蒸馏技术[12-13]相结合,摆脱了传统后门防御方法对原始训练数据的依赖,并采用模型剪枝策略降低了后门触发器对模型的影响。此外,为消除剪枝后的模型仍可能保留部分后门信息的风险,提出了对抗性后门遗忘策略进行补救。该策略首先对剪枝模型Tp的最后n个卷积层进行随机通道打乱处理,再利用过滤后的可信样本集r对Tp执行无数据知识蒸馏以维持模型精度;其次,通过训练一个触发生成器Gp来生成对剪枝模型最敏感的触发模式δ,同时对学生模型S进行反向优化来增强其对触发模式的鲁棒性,二者不断对抗优化,最终得到一个干净的学生模型S。通过在两个通用数据集上进行大量实验,结果表明所提方法在移除模型后门的性能上优于其他几种基线防御方法。

1 后门防御方案

1.1 攻击与防御设置

(1)攻击设置。假设攻击者为某些不受信任的云计算服务提供方,在训练阶段将后门嵌入模型中。攻击者可修改数据集,但不能更改模型结构和超参数。在模型训练阶段,给定训练数据集![]() 其中xi代表训练集的一张图像,yi∈{1,2,…,K}是其对应的标签。攻击者通过将预定义的触发器δ嵌入部分训练图像并修改其标签为目标类,得到中毒训练集Dp(包括中毒样本和干净样本)。攻击者的目标是利用中毒训练集训练一个后门教师模型T,使其能够将带有触发器的样本分类到目标类别,同时保持对干净样本的预测精度与正常模型相当。

其中xi代表训练集的一张图像,yi∈{1,2,…,K}是其对应的标签。攻击者通过将预定义的触发器δ嵌入部分训练图像并修改其标签为目标类,得到中毒训练集Dp(包括中毒样本和干净样本)。攻击者的目标是利用中毒训练集训练一个后门教师模型T,使其能够将带有触发器的样本分类到目标类别,同时保持对干净样本的预测精度与正常模型相当。

(2)防御设置。防御者从一个不受信任的云服务平台下载预训练的后门模型用于下游任务,对后门模型没有任何先验知识(包括训练数据分布、中毒率、触发器样式、目标标签等)。假设防御者可以对模型进行微调,但无法访问用于模型训练的原始数据。防御者的目标是在缺乏原始训练数据的情况下,将后门教师模型T转换为干净的学生模型S。

1.2 防御方法概述

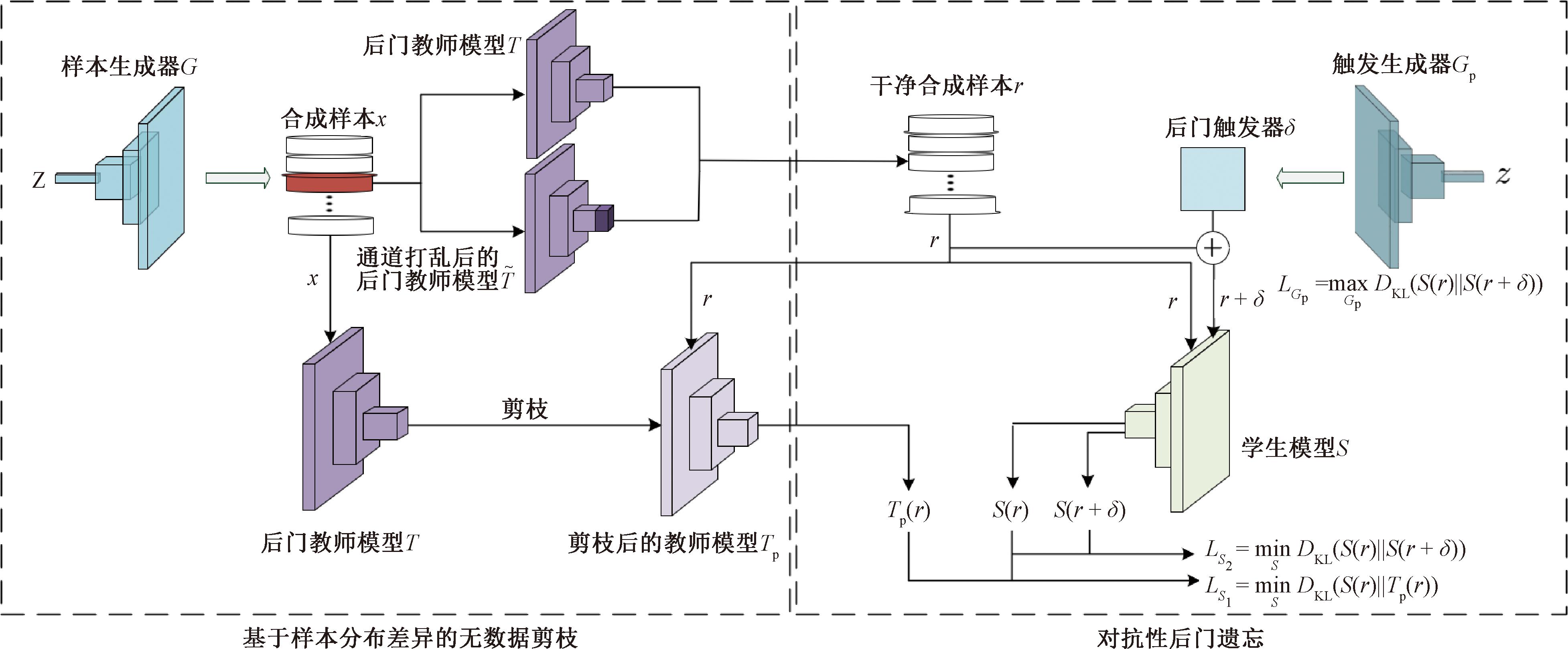

图1为基于剪枝和后门遗忘的无数据后门移除框架图。如图1所示,本文所提的防御方法分为两个阶段:基于样本分布差异的无数据剪枝和对抗性后门遗忘。

图1 基于剪枝和后门遗忘的无数据后门移除框架图

Figure 1 Data-free backdoor removal framework based on pruning and backdoor unlearning

在无数据剪枝阶段,优化样本生成器G用来生成与中毒模型训练数据近似分布的合成样本,这些合成样本包含中毒样本和干净样本的特征。通过分析中毒模型的神经元对合成样本的预激活分布差异可以定位并剪除可疑神经元。然而,对于某些后门攻击,基于样本分布差异的无数据剪枝可能存在后门遗留的风险。其原因在于这些攻击更具鲁棒性,使得中毒样本与干净样本在特征空间上的差异极小,难以完全区分正常神经元和中毒神经元。为了解决这一潜在风险,本文在无数据剪枝阶段后增加了一个对抗性后门遗忘模块来进一步消除剪枝模型遗留的后门知识,降低模型对后门触发器δ的响应。

1.3 基于样本分布差异的无数据剪枝

本节的目标是无须依赖任何原始训练数据,通过基于样本分布差异的无数据剪枝策略减少中毒模型中的后门知识。首先解决的问题是如何获得与中毒模型训练数据相似分布的数据。本文使用无数据知识蒸馏的方法,优化样本生成器G以生成与中毒模型原始训练数据相似分布的合成样本。具体而言,将后门教师模型T视为固定的鉴别器,并初始化样本生成器G。对于任意给定的一组随机向量{z1,z2,…,zm},G通过最小化式(1)的损失函数生成对鉴别器最大响应的样本{x1,x2,…,xm}来拟合原始训练数据,其中xi=G(zi)。生成器损失函数公式为

LG=Loh+αLac+βLie。

(1)

式中:α和β为超参数,其值设置分别为5.0和0.1。

Loh为one-hot损失,表示为

(2)

式中:CE(·)为交叉熵损失函数;pi为中毒教师模型的预测标签,pi=argmax(T(xi))。如果生成器G生成的图像与T的原始训练数据具有相似的分布,那么它们的输出也应与原始训练数据相似。通过one-hot损失,可以限制生成器生成的图像以更高的概率被中毒教师网络归类到特定类别,从而生成与中毒教师网络兼容的合成图像。

除了教师模型预测的类标签外,卷积层提取的中间特征也是输入图像的重要表示。相较于随机向量,真实图像对应的特征图应具有更高的激活值。因此,Lac损失函数定义为

(3)

式中:Tf(xi)表示样本xi的教师网络提取的全连接层的上一层的输出特征。

为了简化深度神经网络的训练过程,通常各类别的训练样本数量是平衡的。为此,使用信息熵损失衡量生成图像的类别数量是否平衡。信息熵损失函数Lie定义为

(4)

式中:![]() 为信息熵的计算公式。当

为信息熵的计算公式。当![]() 时J(q)最大,意味着生成器G生成每一类样本的概率相同,通过最小化Lie可以得到一批均衡的合成图像。学生网络S的参数θ通过最小化生成样本在T和S之间的输出差异来进行优化,本文使用KL散度来衡量这种差异,损失函数为

时J(q)最大,意味着生成器G生成每一类样本的概率相同,通过最小化Lie可以得到一批均衡的合成图像。学生网络S的参数θ通过最小化生成样本在T和S之间的输出差异来进行优化,本文使用KL散度来衡量这种差异,损失函数为

(5)

式中:x为样本生成器G利用服从正态分布的随机变量z生成的一组合成样本。通过上述过程可以得到一个能生成与训练数据近似分布数据的生成器G。接下来,利用这些合成数据实行基于样本分布差异的剪枝策略来净化后门模型。

相关研究[6]发现,干净样本和中毒样本的标准化预激活分布值只在中毒神经元中具有显著差异,在正常神经元中几乎没有变化。对于未受后门攻击影响的干净神经元,这种标准化过程通常会使预激活分布更加符合高斯分布的特性。然而在后门神经元中,后门攻击引入的特定模式或触发器会导致预激活分布偏离标准正态分布,产生混合分布。这种混合分布可能包含一个或多个额外的高斯分量,对应于后门神经元对触发器的响应。这些额外的高斯分量与原本的高斯分布相混合,改变了整体分布的形状,使其不再遵循单一的高斯分布。

本文选择采用微分熵来识别混合分布中不同于高斯分布的其他分布。微分熵衡量的是连续随机变量分布的不确定性或信息量。对于连续型随机变量X,微分熵[14]被定义为

(6)

混合分布的微分熵通常小于单一高斯分布,这是因为混合分布的不确定性在某种程度上受到更强的约束。具体而言,当存在后门触发器时,神经元对特定输入的响应变得可预测,从而降低了分布的熵。因此,可以通过比较各神经元标准化预激活分布的微分熵来识别潜在的后门神经元。

为了衡量神经元对后门行为的重要性,本文引入神经元敏感度函数:

η(T,k,l)=CE(y,T(xp))-CE(y,T-(k,l)(xp))。

(7)

式中:xp代表中毒数据;-(k,l)代表对后门模型第k层的第l个神经元进行剪枝。通过对比后门模型的每个神经元修剪前后在中毒数据集上的损失改变值可以定位与后门相关的神经元,通过式(8)可以找到与后门行为最相关的后门神经元集合:

Bμ={η(T,k,l)>μ}。

(8)

式中:阈值μ>0。令![]() 作为标准化的预激活分布值,后门神经元可以与正常神经元分离,通过设置一个合适的阈值满足以下不等式:

作为标准化的预激活分布值,后门神经元可以与正常神经元分离,通过设置一个合适的阈值满足以下不等式:

![]()

(9)

式中:X为X~N(0,1)的标准高斯分布。

1.4 对抗性后门遗忘

对抗性后门遗忘(ABU)策略通过对抗性蒸馏消除无数据剪枝后的后门模型中可能残留的后门信息,增强模型对后门触发器的鲁棒性。

已有研究[11]揭示了后门攻击中触发器激活的稀疏特性,即它们主要集中在少量特定的通道中进行稀疏编码和激活,且在后门模型的最后几层中更为明显。相反,干净图像的特征在各个通道中均匀分布,需要跨多个通道进行编码才能有效分类。

基于此发现,本文提出一种过滤中毒样本的策略:对中毒模型的最后n个卷积层实施随机通道打乱,过滤生成器生成的携带后门特征的可疑样本。鉴于后门触发器的稀疏性,这种随机通道打乱不会影响模型对中毒样本的预测,因为后门特征依赖于少数通道,随机通道打乱不会破坏连接。相反,由于干净图像的特征均匀分布于各个通道,随机通道打乱会破坏干净图像的预测路径。因此,如果一个样本在随机通道打乱前后能稳定预测为同一类别,则该样本很可能是中毒样本。

通过对Tp的最后n个卷积层进行随机通道打乱得到![]() 默认设置n=2。本文定义了一个过滤生成中毒样本的指示函数

默认设置n=2。本文定义了一个过滤生成中毒样本的指示函数![]() 当Tp(x)和

当Tp(x)和![]() 的预测标签相同时,该函数等于0,即x很大程度上是中毒样本。利用指示函数对样本生成器G生成的合成样本集x进行过滤可以得到可信样本集r,r为指示函数等于1的合成样本的集合。至此,可以得到学生网络S的第一个损失函数:

的预测标签相同时,该函数等于0,即x很大程度上是中毒样本。利用指示函数对样本生成器G生成的合成样本集x进行过滤可以得到可信样本集r,r为指示函数等于1的合成样本的集合。至此,可以得到学生网络S的第一个损失函数:

LS1=DKL(S(r)||Tp(r))。

(10)

学生网络S以最小化与教师模型Tp在可信样本集r上的输出差异为手段,保持模型的原始精度。

此外,对抗性后门遗忘(ABU)定义了一个触发生成器Gp来合成对S最敏感的后门触发器δ,这里δ设置为5。通过对干净样本r添加δ,可以最大限度地改变S对这些样本的输出差异。为实现触发器的隐蔽性,约束![]()

以控制δ的稀疏性水平,并且选择使用KL散度来衡量r添加δ前后模型的输出差异。KL散度的值越大,模型的输出变化越明显,说明S对Gp生成的δ越敏感。Gp的损失函数定义如下:

以控制δ的稀疏性水平,并且选择使用KL散度来衡量r添加δ前后模型的输出差异。KL散度的值越大,模型的输出变化越明显,说明S对Gp生成的δ越敏感。Gp的损失函数定义如下:

LGp=-DKL(S(r)||S(r+δ))。

(11)

学生网络S则对触发生成器Gp的损失函数反向优化,通过最小化样本r与添加δ后的样本(r+δ)之间的输出差异来减少学生网络对触发器的响应,迫使其遗忘自身残留的后门知识。由此可以得到学生网络S的第二个损失函数:

LS2=DKL(S(r)||S(r+δ))。

(12)

在每一轮的训练中,更新学生网络S 5次来最小化与Tp之间的输出差异,然后再更新Gp 1次。通过交替优化Gp和S直至达到平衡状态,这样可以得到一个精度与教师模型相当的干净学生模型。

2 实验

2.1 实验设置

攻击设置:本文对6个具有代表性的后门攻击方法进行防御评估,包括5种标签中毒攻击:BadNets[3]、Blended[15]、IAB[16]、WaNet[4]、BPP[17]和一种经典的干净标签攻击SIG[5]。其中BadNets使用白色方块作为触发器的可见后门攻击;Blended是基于全局噪声的隐形后门攻击;WaNet是基于图像扭曲转换的不可见后门攻击;SIG是利用正弦信号作为触发器的干净标签攻击;IAB根据输入数据的特征动态地调整触发器;BPP攻击通过对抗性对比学习和图像量化技术来设计高效隐蔽的触发器。在所有攻击中,SIG中毒率设置为0.5,其余的攻击中毒率设置为0.1,并在CIFAR10和GTSRB数据集中选择第一个类作为目标类,即yt=0。所有的攻击方法都采用典型的数据增强技术,例如对图像进行随机裁剪和旋转等。

防御设置:本文将所提方法与5种基线防御方法进行了对比,其中包括FP[18]、ANP[7]、I-BAU[8]、EP[9]和Spectral[6]。评估采用BackdoorBench[19]的默认防御设置,这是一个全面的后门攻击与防御评估基准框架。实验默认使用学习率为0.001的Adam优化器来更新G和Gp,使用学习率为0.015、动量为0.9、权重衰减为0.000 5的SGD优化器来更新S。为了加快训练进度,实验选择使用教师网络的参数来初始化学生网络。此外,生成器每批次生成512个合成样本,样本生成器预训练80轮模拟原始训练数据。在对抗性后门遗忘阶段,学生网络和生成器联合优化5次迭代×200轮,在每次迭代中,学生网络更新5次,生成器更新1次。

实验使用的GPU为显存12 GB的GeForce RTX 3080Ti,CPU为Intel Xeon E5-2697 v4,操作系统为Debian 11,运行环境为Pytorch 1.13.1和cuda 11.7,选择PreAct-Resnet18作为基准网络,整个后门移除过程约需5 h。

2.2 评估指标

为了评估防御方法的性能,本文采用两个常用指标:①模型在干净测试集上的分类准确率(ACC),即模型对不含后门触发器的测试样本的分类准确率;②模型在中毒测试集上的攻击成功率(ASR),即模型将带有触发器的测试样本错误分类为目标标签的比例。一个成功的后门防御方法应显著降低ASR,同时保持与原始模型相近的ACC。换言之,ASR值越低,ACC值越高,防御方法的性能越好。

2.3 实验结果

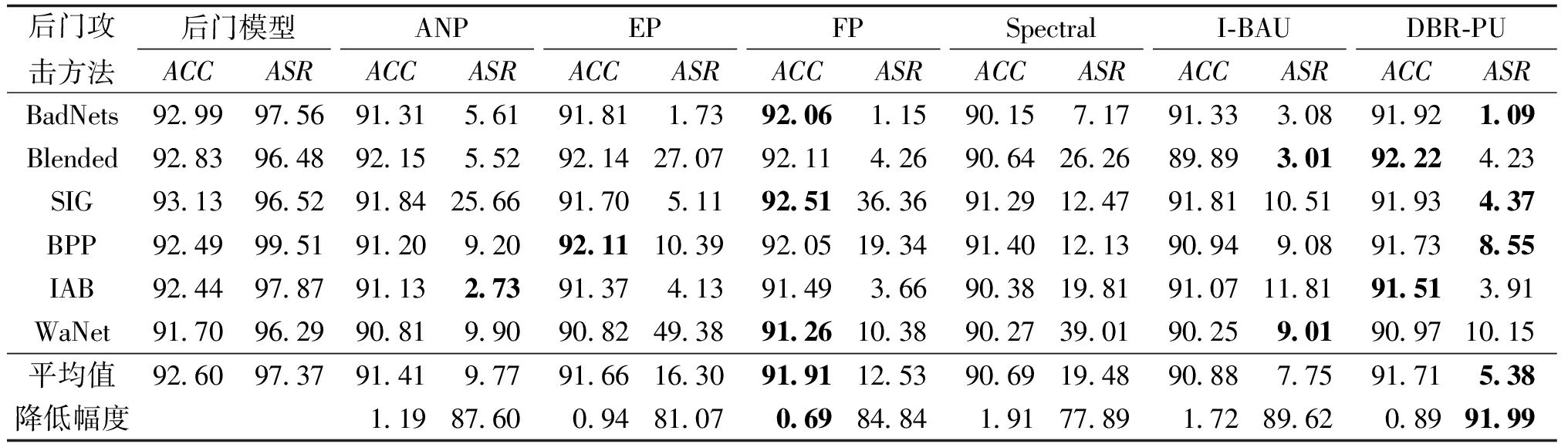

本节通过实验验证了所提防御方法(DBR-PU)在移除模型后门方面的性能,并将其在准确率(ACC)和攻击成功率(ASR)方面的表现与5种基准模型修复方法进行对比。DBR-PU与5种基线防御方法在CIFAR10和GTSRB数据集中的对比结果如表1和表2所示。

表1 DBR-PU与5种基线防御方法在CIFAR10数据集中的对比结果

Table 1 Comparison results of DBR-PU and five baseline defense methods on the CIFAR10 dataset 单位:%

后门攻击方法后门模型ANPEPFPSpectralI-BAUDBR-PUACCASRACCASRACCASRACCASRACCASRACCASRACCASRBadNets92.9997.5691.315.6191.811.7392.061.1590.157.1791.333.0891.921.09Blended92.8396.4892.155.5292.1427.0792.114.2690.6426.2689.893.0192.224.23SIG93.1396.5291.8425.6691.705.1192.5136.3691.2912.4791.8110.5191.934.37BPP92.4999.5191.209.2092.1110.3992.0519.3491.4012.1390.949.0891.738.55IAB92.4497.8791.132.7391.374.1391.493.6690.3819.8191.0711.8191.513.91WaNet91.7096.2990.819.9090.8249.3891.2610.3890.2739.0190.259.0190.9710.15平均值92.6097.3791.419.7791.6616.3091.9112.5390.6919.4890.887.7591.715.38降低幅度1.1987.600.9481.070.6984.841.9177.891.7289.620.8991.99

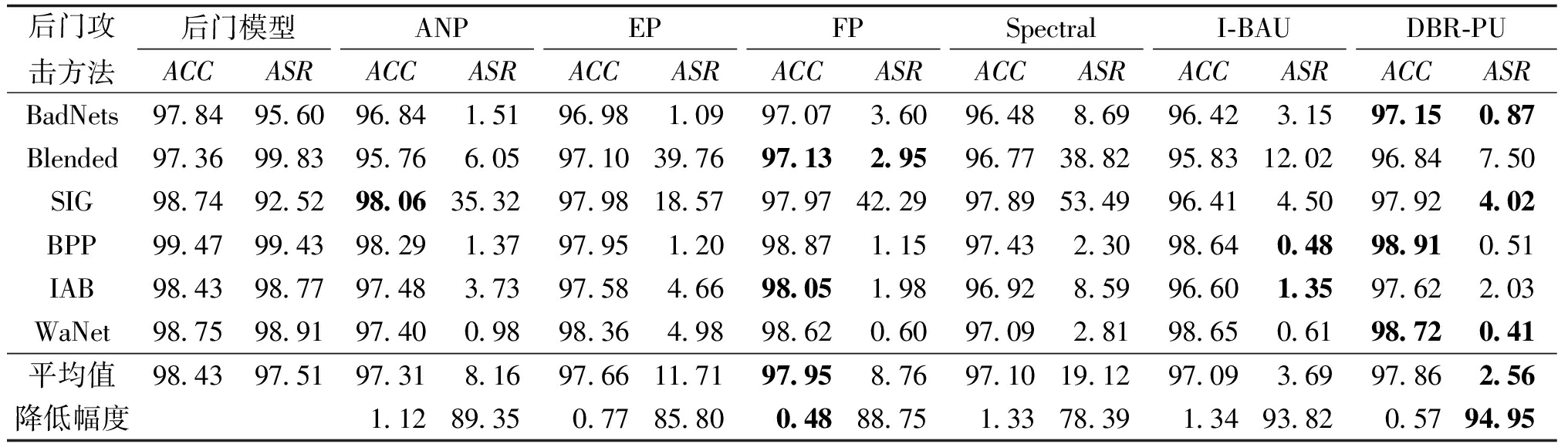

表2 DBR-PU与5种基线防御方法在GTSRB数据集中的对比结果

Table 2 Comparison results of DBR-PU and five baseline defense methods on the GTSRB dataset 单位:%

后门攻击方法后门模型ANPEPFPSpectralI-BAUDBR-PUACCASRACCASRACCASRACCASRACCASRACCASRACCASRBadNets97.8495.6096.841.5196.981.0997.073.6096.488.6996.423.1597.150.87Blended97.3699.8395.766.0597.1039.7697.132.9596.7738.8295.8312.0296.847.50SIG98.7492.5298.0635.3297.9818.5797.9742.2997.8953.4996.414.5097.924.02BPP99.4799.4398.291.3797.951.2098.871.1597.432.3098.640.4898.910.51IAB98.4398.7797.483.7397.584.6698.051.9896.928.5996.601.3597.622.03WaNet98.7598.9197.400.9898.364.9898.620.6097.092.8198.650.6198.720.41平均值98.4397.5197.318.1697.6611.7197.958.7697.1019.1297.093.6997.862.56降低幅度1.1289.350.7785.800.4888.751.3378.391.3493.820.5794.95

表1中展示了DBR-PU与5种基准防御方法在CIFAR10上对6种后门攻击的防御效果,实验采用ACC和ASR作为评估指标。实验结果中,防御性能最佳的数值用黑体表示。实验结果表明,在无须任何干净数据的情况下,所提方法DBR-PU在CIFAR10数据集的表现优于其他5种基线防御方法。DBR-PU的平均ACC仅下降0.89%,性能仅次于FP的0.69%,但可以将平均ASR从97.37%降低到5.38%,降幅达91.99%,优于所有的基线防御方法。尽管保持模型原始准确性至关重要,但降低ASR也是防御方法的重要评估指标。值得注意的是,几乎每种防御方法对特定类型后门攻击都存在局限性,例如,FP虽保持最高ACC,但整体ASR降幅仅为84.84%。EP在Blended和WaNet攻击下表现不足,可能因为这两种攻击鲁棒性较强,后门神经元与正常神经元分布差异较小,依靠样本预激活差异难以精确定位中毒神经元。在几乎所有类型的攻击中,所提方法均能显著降低ASR,且不影响模型的实用性,充分证实其在防御后门攻击方面的有效性。

表2展示了所提方法在GTSRB数据集上对6种后门攻击的防御结果。结果表明,该方法可以有效消除模型中的后门反应。相比于ANP、EP、FP、Spectral和I-BAU,DBR-PU在平均ASR方面表现最优,而ACC仅下降0.57%,仅次于FP的0.48%,对模型原始准确率的影响微乎其微。

综上所述,与5种基线防御方法相比,DBR-PU在多种攻击下表现出优越的防御性能。这得益于DBR-PU的两阶段防御策略:利用预激活分布熵来区分和移除可疑神经元,并结合对抗性后门遗忘以处理后门遗漏的风险,同时抑制无数据剪枝后的模型对触发器的潜在响应,实现更有效的防御。

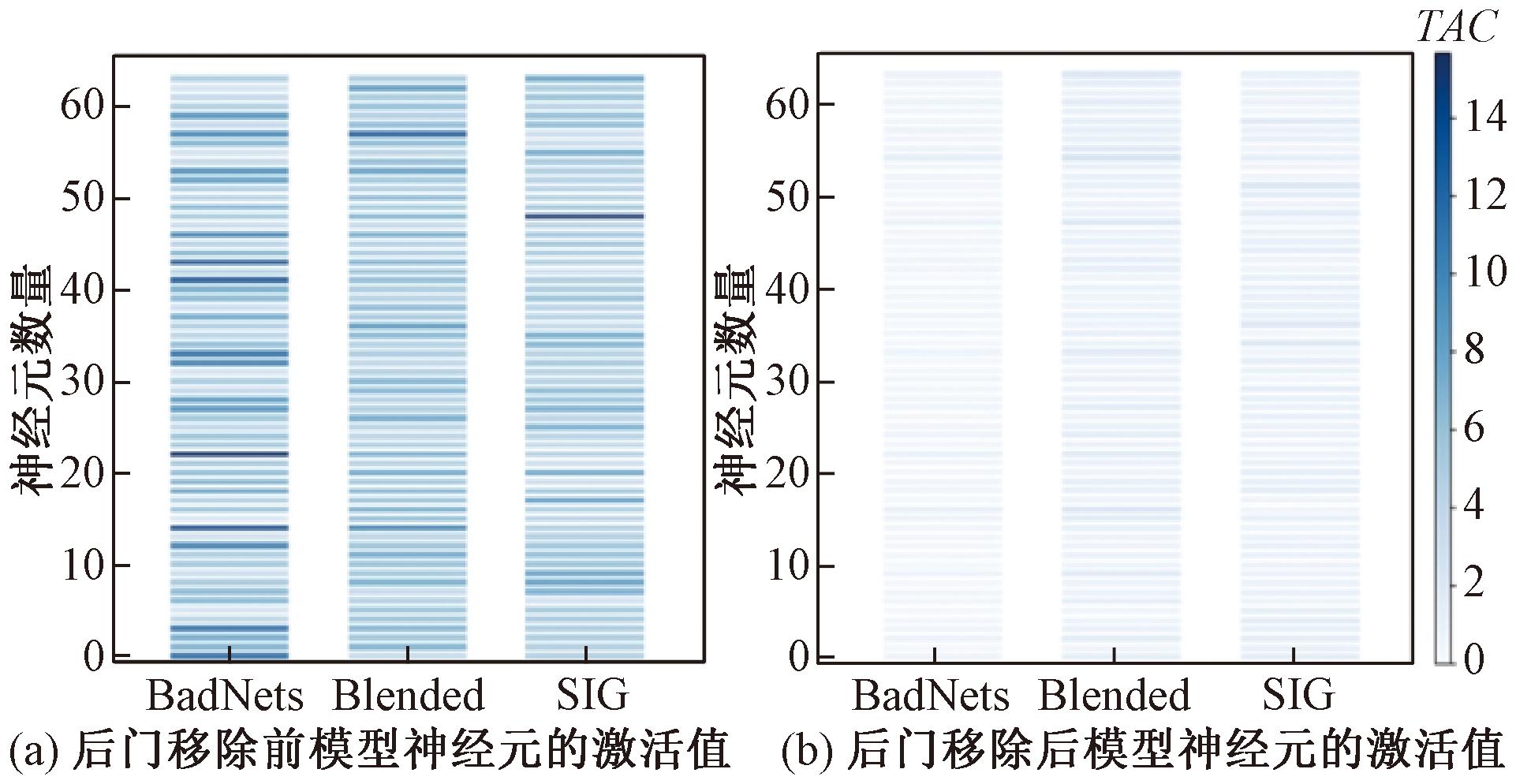

2.4 对抗性后门遗忘的有效性

为验证对抗性后门遗忘(ABU)在消除模型后门反应中的有效性,本文从干净测试数据集中抽取2 000张样本,并绘制了模型防御前后对干净输入与带有真实触发器的输入之间激活变化的分布图,如图2所示。实验随机选择了PreAct-Resnet18中的一个卷积层(layer1.1.conv2),通过计算模型在两组特征间的绝对差异的平均值来量化每个神经元的触发器激活变化(TAC)。TAC值越低,柱形条颜色越浅,表示模型对触发器的响应越小。如图2所示,ABU有效减少了模型对残留后门知识的响应,提高了模型对后门触发器的鲁棒性。

图2 模型对触发器的激活变化

Figure 2 Model activation change to trigger

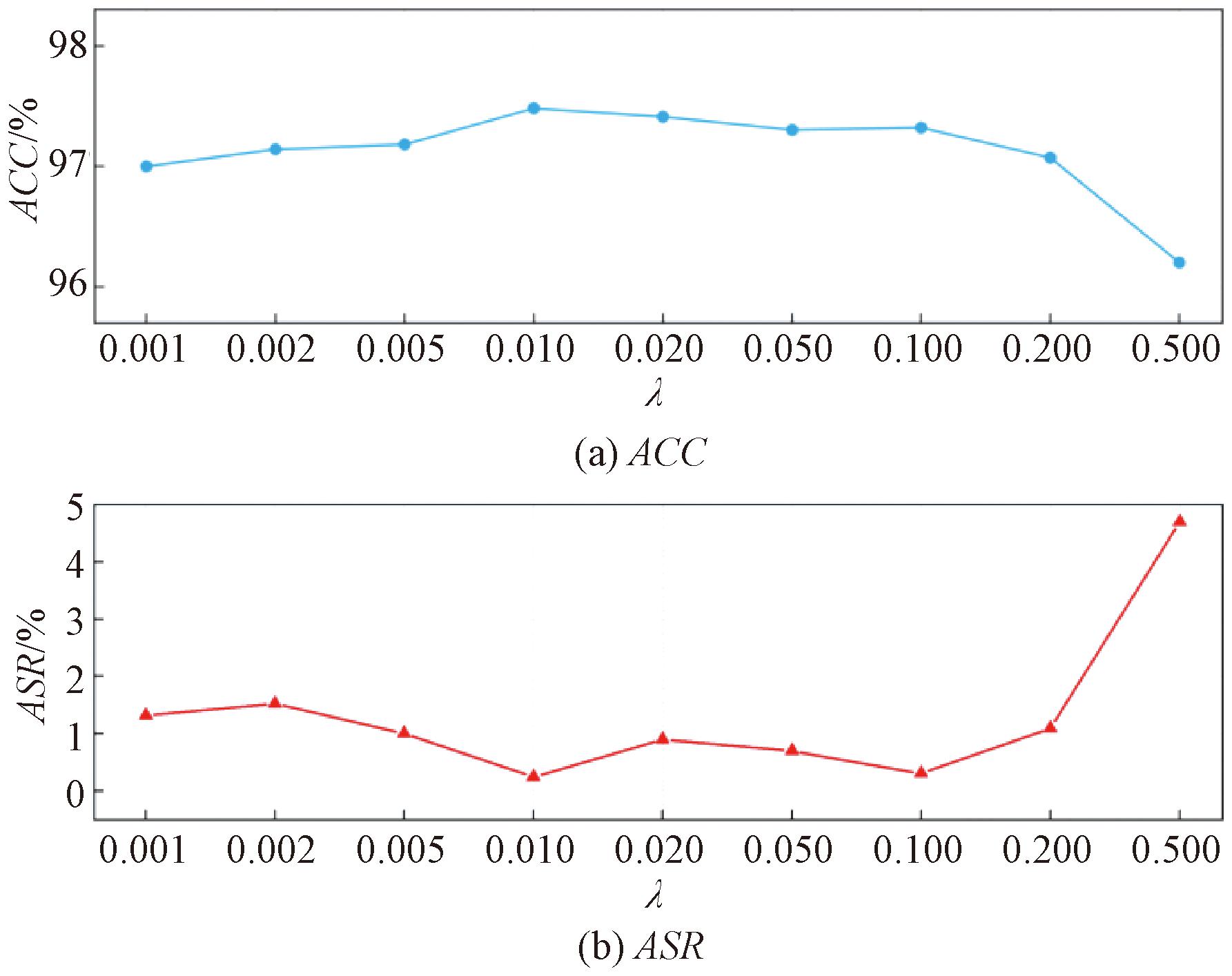

2.5 超参数的选择

本文所提方法的有效性由对抗性后门遗忘阶段的超参数λ控制, 图3展示了在不同的λ取值下,DBR-PU在GTSRB数据集中对BadNets攻击的防御性能。结果表明,在整个λ取值范围内(0.001~0.500),DBR-PU都可以有效降低中毒模型对后门触发器的响应,且不会损害模型的原始精度。

图3 超参数λ对所提方法防御性能的影响

Figure 3 Impact of hyperparameter λ on the defense performance of the proposed method

2.6 不同中毒率下的后门防御效果

中毒率是影响后门防御方法性能的关键因素之一。一般来说,中毒率越高,后门特征在后门模型中的稳固性越强,后门移除也会更加困难。一个好的后门防御方法能应对不同中毒率下的后门攻击。因此,通过对比防御方法在不同中毒率下的性能表现可以评估后门防御方法的有效性和鲁棒性。

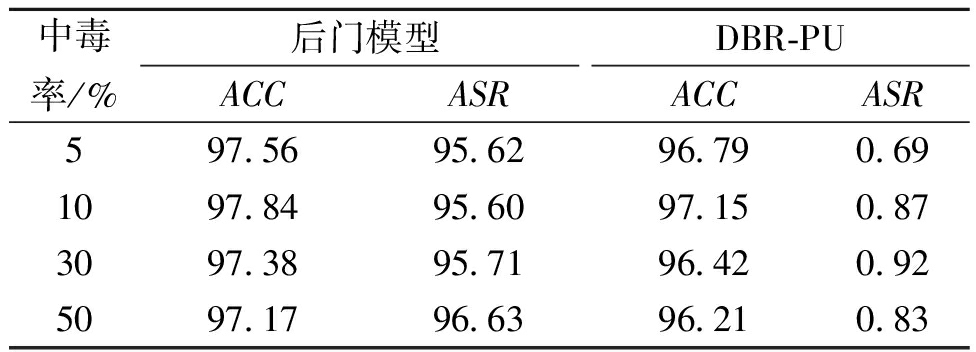

本节使用BadNets攻击,在GTSRB数据集上对ResNet-18模型使用5%、10%、30%和50% 4种不同的中毒率进行训练得到后门模型,然后使用所提方法对其进行后门移除工作,防御结果如表3所示。结果表明,在4种不同的中毒率情况下,DBR-PU仍可以将后门模型的攻击成功率降低到1%以下且ACC仍能维持在一个较高水平。

表3 在不同中毒率下后门模型和DBP-PU的防御性能对比

Table 3 Defense performance of DBR-PU at different poisoning rates 单位:%

中毒率/%后门模型DBR-PUACCASRACCASR597.5695.6296.790.691097.8495.6097.150.873097.3895.7196.420.925097.1796.6396.210.83

2.7 合成数据可视化

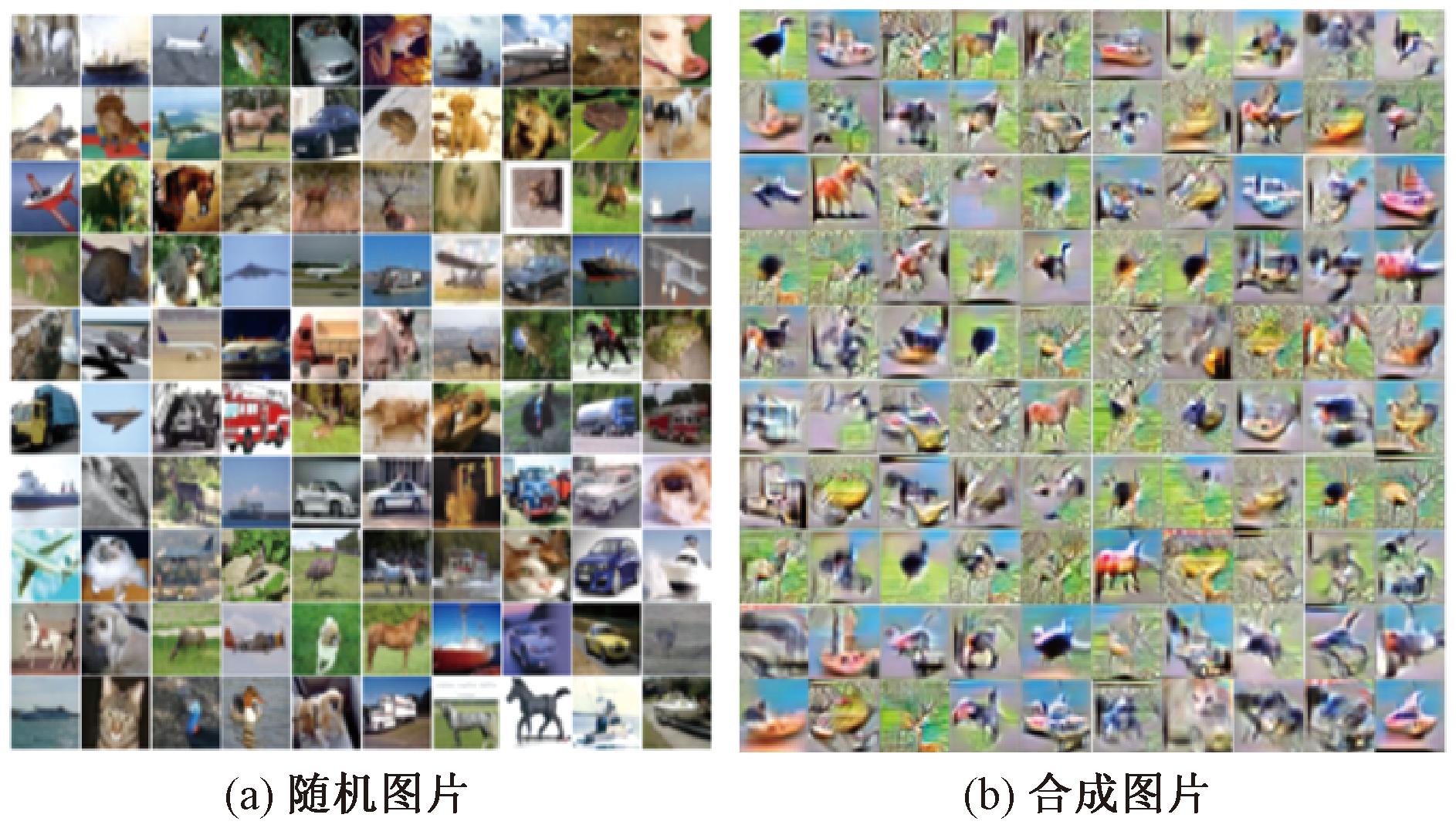

本节评估所提方法的生成器生成的合成数据和原始数据之间的质量差异和分布变化,结果如图4所示。在图4中,左侧图片代表从CIFAR10数据集中随机可视化的100张图片,右侧图片是生成器生成的合成图片。此外,实验通过计算原始数据和合成数据之间的FID分数[20]来衡量两者之间的分布差异。这是一种广泛用于评估生成图像质量的指标,FID分数用于根据预训练网络提取的特征,测量真实图像分布和生成图像分布之间的距离来衡量它们之间的差异。FID的值越低,说明生成图像与真实图像的分布越接近,生成图像的质量越高。本实验分别使用10 000张CIFAR10真实图像与合成图像计算FID的分数为138.56,可以表明合成图像有着与真实图像相似的特征分布。

图4 合成数据和原始数据可视化

Figure 4 Visualization of synthetic data and original data

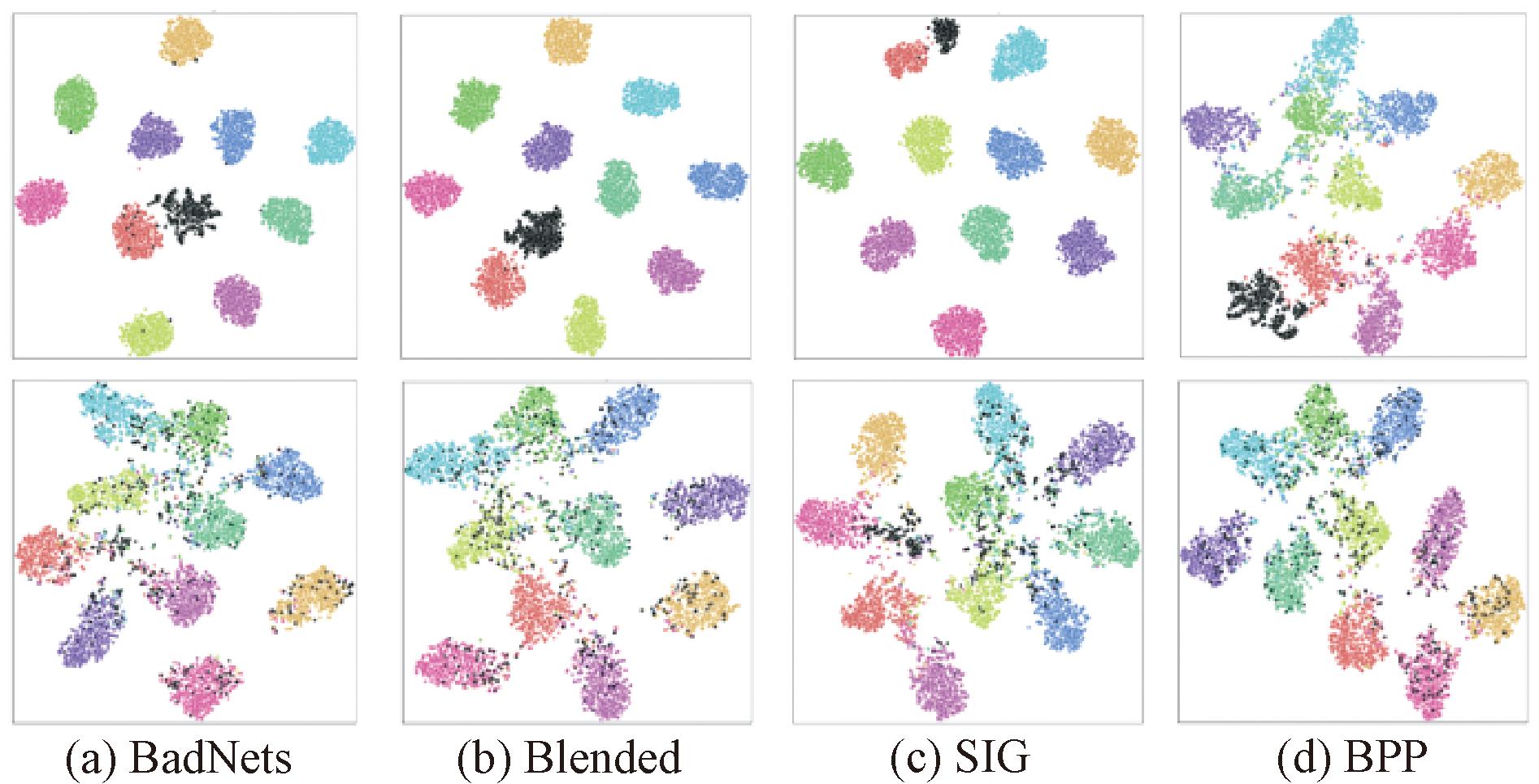

2.8 防御结果可视化

t-分布随机邻域嵌入(t-SNE)[21]是一种非线性降维技术,特别适合高维数据的可视化,它可以捕捉数据点之间的局部关系,并以较低的维度来呈现。

为验证所提防御方法的有效性,实验采用上述可视化技术,在图5中展示防御结果。图5 中第一行图片展示了通过t-SNE算法对PreAct-ResNet18模型的倒数第二个卷积层进行降维可视化,显示后门模型对干净图像和后门图像的特征表示。图5第二行展示了经过DBR-PU防御后的t-SNE图。若后门信息被有效清除,后门图像(黑色簇)将融入相应的干净图像簇中。图5显示,经过防御后,后门模型的t-SNE图中被污染的图像(黑色簇)从独立簇分散到对应的干净图像簇,证明了所提防御方法DBR-PU的有效性。

图5 DBR-PU在CIFAR10上的防御结果t-SNE可视化

Figure 5 t-SNE visualization of DBR-PU defense results on CIFAR10

3 结论

本文探索了在干净训练数据缺乏的情况下消除模型潜在的后门风险这一具有挑战性的场景,引入了一种新的基于剪枝和对抗性后门遗忘的无数据后门移除方法(DBR-PU)。该方法将基于分布熵的剪枝方法与无数据知识蒸馏相结合来克服缺乏干净训练数据这一条件限制,同时引入了对抗性后门遗忘模块来消除后门遗漏的风险。并在两个公开基准数据集中进行了大量的实验。实验结果显示,在缺乏原始训练数据的场景中,所提方法在模型准确率方面表现较好,在降低后门攻击成功率方面表现最好。此外,该方法对模型的原始精度的影响微乎其微,这表明本文所提方法在后门防御方面具有很好的性能。

[1] 罗荣辉,袁航,钟发海,等.基于卷积神经网络的道路拥堵识别研究[J].郑州大学学报(工学版), 2019,40(2):21-25.LUO R H, YUAN H, ZHONG F H, et al. Traffic jam detection based on convolutional neural network[J]. Journal of Zhengzhou University (Engineering Science), 2019,40(2):21-25.

[2] LI Y M, JIANG Y, LI Z F, et al. Backdoor learning: a survey[J]. IEEE Transactions on Neural Networks and Learning Systems, 2024, 35(1): 5-22.

[3] GU T Y, LIU K, DOLAN-GAVITT B, et al. BadNets: evaluating backdooring attacks on deep neural networks[J]. IEEE Access, 2019, 7: 47230-47244.

[4] NGUYEN A, TRAN A. WaNet: imperceptible warping-based backdoor attack[EB/OL]. (2021-02-20)[2025-08-16].https:∥doi.org/10.48550/arXiv.2102.10369.

[5] BARNI M, KALLAS K, TONDI B. A new backdoor attack in CNNS by training set corruption without label poisoning[C]∥2019 IEEE International Conference on Image Processing (ICIP). Piscataway: IEEE, 2019: 101-105.

[6] TRAN B, LI J, MADRY A. Spectral signatures in backdoor attacks[EB/OL]. (2018-11-01)[2025-08-16].https:∥doi.org/10.48550/arXiv.1811.00636.

[7] WU D X, WANG Y S. Adversarial neuron pruning purifies backdoored deep models[EB/OL]. (2021-10-27)[2025-08-16].https:∥doi.org/10.48550/arXiv.2110.14430.

[8] ZENG Y, CHEN S, PARK W, et al. Adversarial unlearning of backdoors via implicit hypergradient[EB/OL]. (2021-10-07)[2025-08-16].https:∥doi.org/10.48550/arXiv.2110.03735.

[9] ZHENG R K, TANG R J, LI J Z, et al. Pre-activation distributions expose backdoor neurons[J]. Advances in Neural Information Processing Systems, 2022, 35: 18667-18680.

[10] ZHANG X Y, ZHOU X Y, LIN M X, et al. ShuffleNet: an extremely efficient convolutional neural network for mobile devices[C]∥2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2018: 6848-6856.

[11] CAI R, ZHANG Z Y, CHEN T L, et al. Randomized channel shuffling: minimal-overhead backdoor attack detection without clean datasets[J]. Advances in Neural Information Processing Systems, 2022, 35: 33876-33889.

[12] CHEN H T, WANG Y H, XU C, et al. Data-free learning of student networks[C]∥2019 IEEE/CVF International Conference on Computer Vision (ICCV). Pisca-taway:IEEE, 2019: 3514-3522.

[13] FANG G F, SONG J, SHEN C C, et al. Data-free adversarial distillation[EB/OL]. (2019-12-23)[2025-08-16].https:∥arxiv.org/abs/1912.11006.

[14] SHI L C, JIAO Y Y, LU B L. Differential entropy feature for EEG-based vigilance estimation[C]∥2013 35th Annual International Conference of the IEEE Engineering in Medicine and Biology Society (EMBC). Piscataway:IEEE, 2013: 6627-6630.

[15] CHEN X Y, LIU C, LI B, et al. Targeted backdoor attacks on deep learning systems using data poisoning[EB/OL]. (2017-12-15)[2025-08-16].https:∥arxiv.org/abs/1712.05526.

[16] NGUYEN T A, TRAN A. Input-aware dynamic backdoor attack[J]. Advances in Neural Information Processing Systems, 2020, 33: 3454-3464.

[17] WANG Z T, ZHAI J, MA S Q. BppAttack: stealthy and efficient trojan attacks against deep neural networks via image quantization and contrastive adversarial learning[C]∥Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2022: 15074-15084.

[18] LIU K, DOLAN-GAVITT B, GARG S. Fine-pruning: defending against backdooring attacks on deep neural networks[C]∥Research in Attacks, Intrusions, and Defenses. Cham: Springer, 2018: 273-294.

[19] WU B Y, CHEN H R, ZHANG M D, et al. Backdoorbench: a comprehensive benchmark of backdoor learning[J]. Advances in Neural Information Processing Systems, 2022, 35: 10546-10559.

[20] HEUSEL M, RAMSAUER H, UNTERTHINER T, et al. GANs trained by a two time-scale update rule converge to a local Nash equilibrium[EB/OL]. (2017-06-26)[2025-08-16].https:∥arxiv.org/abs/1706.08500.

[21] VAN DER MAATEN L, HINTON G. Visualizing data using t-SNE[J]. Journal of Machine Learning Research, 2008, 9(11):2579-2605.