输电线路是国民经济社会发展的重要基础设施,随着中国经济不断增长,其规模也不断扩大,且覆盖地区越来越广,线路途经植被茂密区域的数量也随之增多[1]。人为、天气和部分自身因素的影响,输电线路走廊周围地区山火故障频发[2],山火发生会导致输电线路下方空气绝缘强度降低,进而发展为大规模停电事故,且重合闸成功率低[3]。停电对于国家的经济和人民的日常生活都有很大的不利影响,所以需要一种输电线路山火预警方法来尽可能地降低事故发生率。实现对输电线路山火烟雾实时、精确检测,对维护输电线路安全运行具有重要意义。

最初的火灾检测是通过雷达[4]、遥感卫星和传感器[5]等方法实现,但这些方法都尚未实现对山火或烟雾实时准确的检测。考虑到在火灾发生时,火焰烟雾在人体视觉上存在明显特征,开始有学者尝试基于图像或视频对输电线路走廊山火进行检测,基于火焰或烟雾的图像特征对火灾属性进行分类判别的方式取得了不错的效果[6]。相较于传统人工设计特征检测山火其泛化性能较差的特点,以卷积神经网络为代表的深度学习算法在图像领域有了深入的发展,强大的特征提取与学习能力是当前山火预警监测研究的热点[7]。

目前,深度学习网络模型主要分为以Faster R-CNN[8]为代表的基于候选区域的二阶段模型和YOLO[9-10]系列为代表的基于端到端的一阶段模型。近年来,针对火焰检测,学者主要围绕目标检测方法效率低和精度差的问题来改进不同算法,以提高算法的检测精度或速度。Li等[11]对比分析了基于Faster R-CNN、R-FCN、SSD和YOLOv3等深度学习神经网络模型对火灾识别的性能,结果表明,以SSD、YOLO系列为代表的一阶段模型在火灾识别中检测速度明显优于二阶段模型,且精度几乎无差别。张坚鑫等[12]提出了一种基于多尺度特征融合网络的火灾检测模型,该模型基于Faster R-CNN算法,引入特征金字塔网络融合多种尺度特征,再使用多种注意力机制强化模型对目标位置的特征提取能力,有效提升了模型检测精度。卢鹏等[13]针对复杂背景下的火灾检测,对模型的Backbone和Neck部分进行改进,不仅提高了检测速度,还增强了模型对火焰特征的学习能力。王一旭等[14]基于YOLOv5算法,将三尺度检测改为四尺度检测、加入了注意力网络,并利用遗传算法优化了网络超参数,有效提高了对图像中小目标火焰检测的精度。输电线路绝大多数都铺设在野外,但以野外为背景同时检测山火和烟雾的相关研究较少且存在精度不高等问题。主要原因是在山火发生时,火焰目标较小且容易被杂物遮挡,烟雾作为发生火灾的另一明显判据,很多时候被忽略,容易导致误检漏检。

现有大部分研究利用的火灾数据集场景各异,涉及市区、厂房等,无公开的输电线路走廊山火数据集,无法针对输电线路场景进行分析。针对上述问题,本文首先构建了以山林、荒地为背景的山火数据集,包括火焰和烟雾双目标,然后选取YOLOv8s为基础模型,引入多维动态卷积模块(omni-dimensional dynamic convolution,ODConv)[15]和基于动态卷积的检测头结构(dynamic head,DyHead)[16],在不过度增加模型复杂度的前提下,提高模型检测精度,并且在最后添加基于动态非单调聚焦机制的边界框损失函数(weighted intersection over union, WIoU)[17]来进一步提高模型对多种尺度的检测性能。

1 YOLOv8s模型与改进方法

1.1 YOLOv8目标检测模型

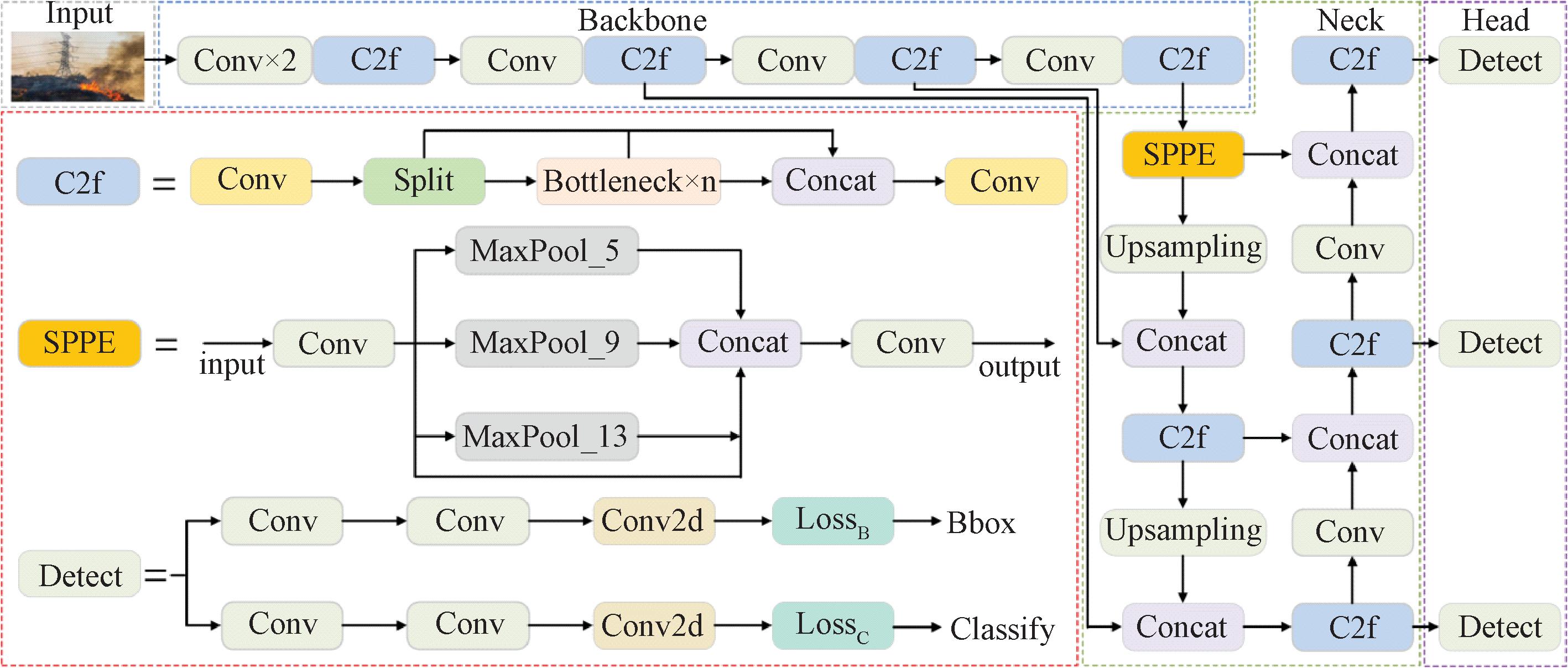

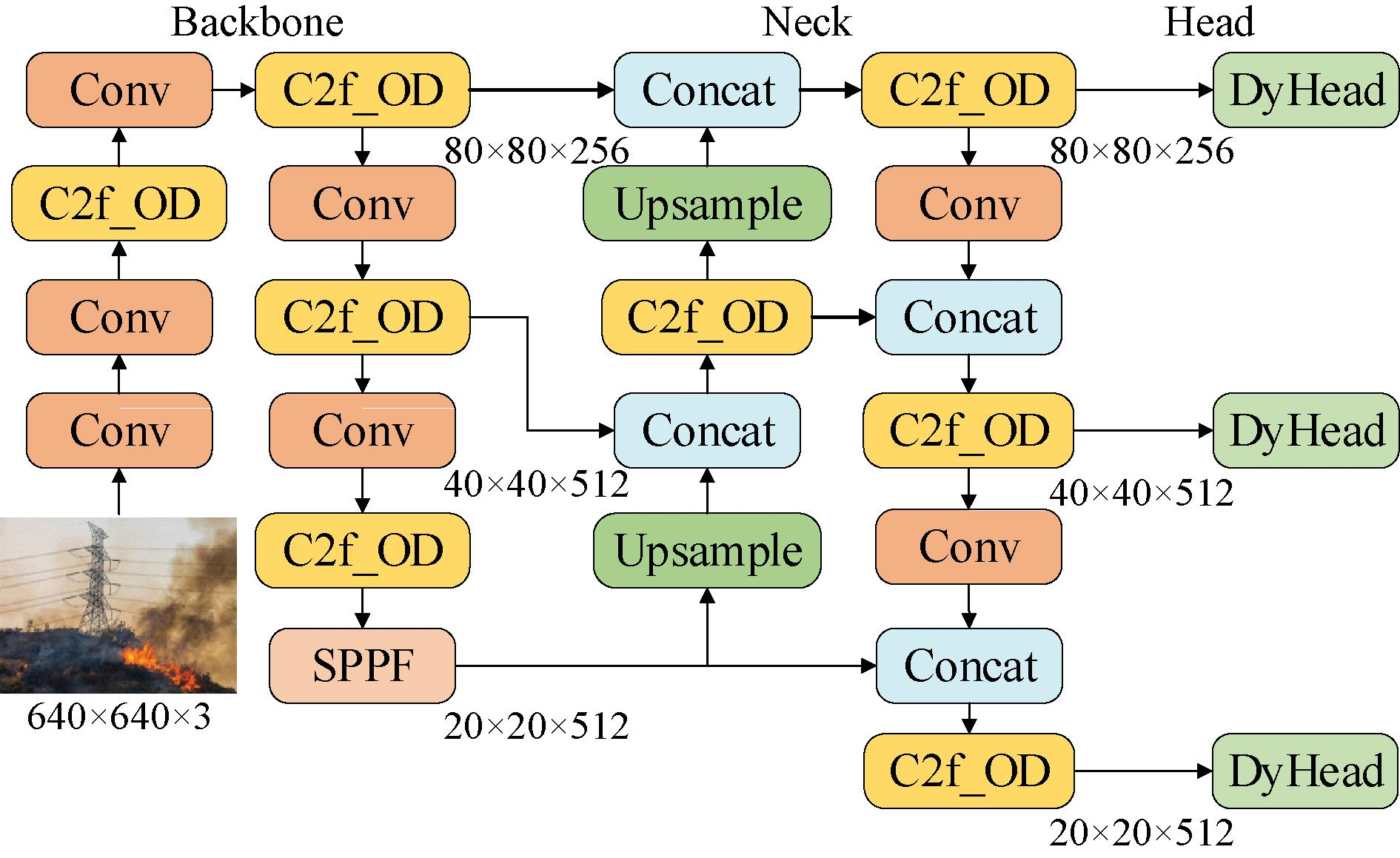

YOLOv8[18]是经典的单阶段目标检测算法,其网络结构包括主干特征提取网络(Backbone)、加强特征融合网络(Neck)和处理输出网络(Head) 3个部分构成,YOLOv8结构如图1所示。其中输入端采用Mosaic数据增强,随机对图片进行缩放、裁剪和排布;Backbone使用的是自YOLOv3就沿用的Darknet53结构,不同于原Darknet53结构内的残差卷积模块,YOLOv8采用了C2f模块来提高模型性能;在Neck部分,YOLOv8依然采用了路径聚合网络(path aggregation network,PANet)多尺度特征融合策略;在Head部分,YOLOv8在YOLOX解耦头的基础上,通过不同的卷积分别解决分类和回归问题,并使用无锚框(anchor free)策略来解决预测框回归问题。

图1 YOLOv8结构图

Figure 1 YOLOv8 structure diagram

1.2 多维动态卷积

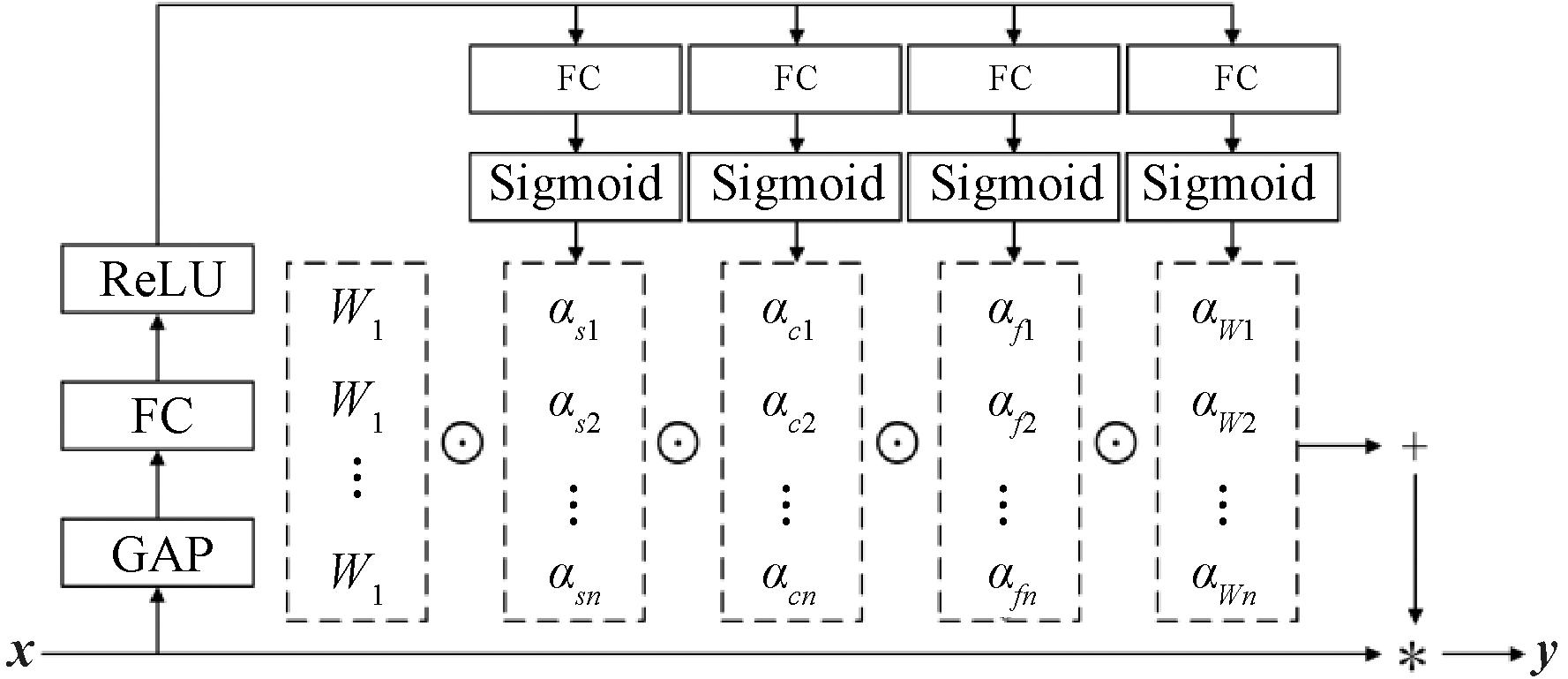

ODConv[15]是一种动态卷积算法,在卷积过程中可以根据输入数据的特征动态调整卷积核的形状和大小,以适应类似的输入数据,与传统卷积不同的是,ODConv不是通过堆叠卷积层的数量来提高模型性能,而是引入一个可学习模块,以并行的方式通过赋予空间维度,输入、输出通道维度,卷积核形状和大小维度不同的权重来提升卷积核提取特征能力,实现了以提升较少参数量的代价提升模型性能,其结构如图2所示。

图2 ODConv结构图

Figure 2 ODConv structure diagram

ODConv采用一种多维注意力机制,同时在4个维度下分别计算注意力权重,其定义为

y=(αW1⊙αf1⊙αc1⊙αs1⊙W1+…+

αWn⊙αfn⊙αcn⊙αsn⊙Wn)·xi。

(1)

式中:αW1为对卷积核W1形状和大小维度的注意力权重参数;αfn为对卷积核空间维度的注意力权重参数;αcn为对输入通道维度的注意力;αsn为对输出通道维度的注意力;⊙表示在核空间上不同维度的乘法运算,用于将不同的注意力加权到卷积核上;xi表示输入特征向量。

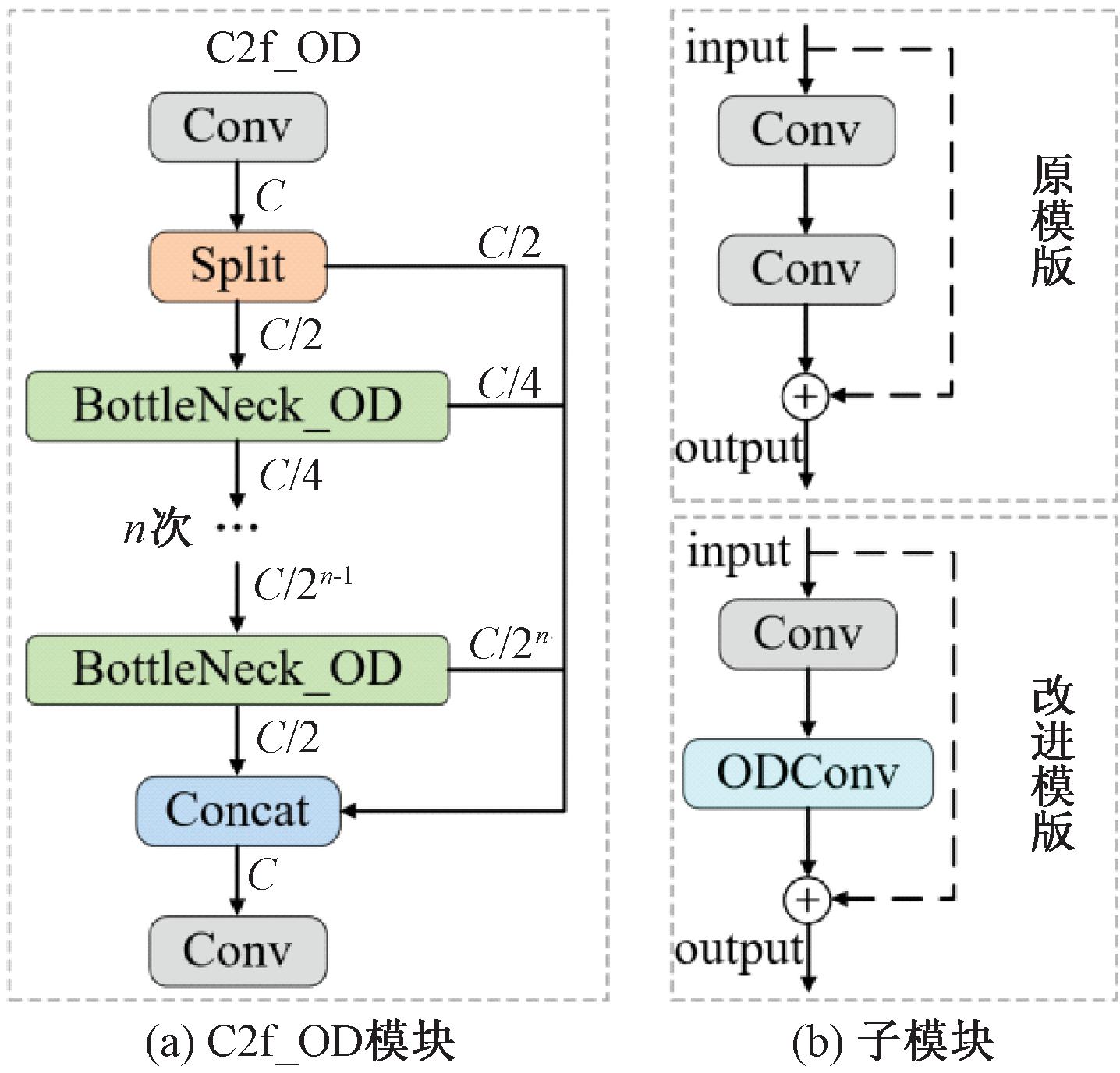

由于火焰动态特征的随机性和不固定性,为了应用于多变的现实场景,利用ODConv替换原C2f中BottleNeck内的卷积层,使得特征提取和融合模块能够更好地获得火焰或烟雾的特征信息。C2f_OD结构如图3所示。

图3 C2f_OD模块与子模块结构图

Figure 3 Structure diagram of C2f_OD and sub modules

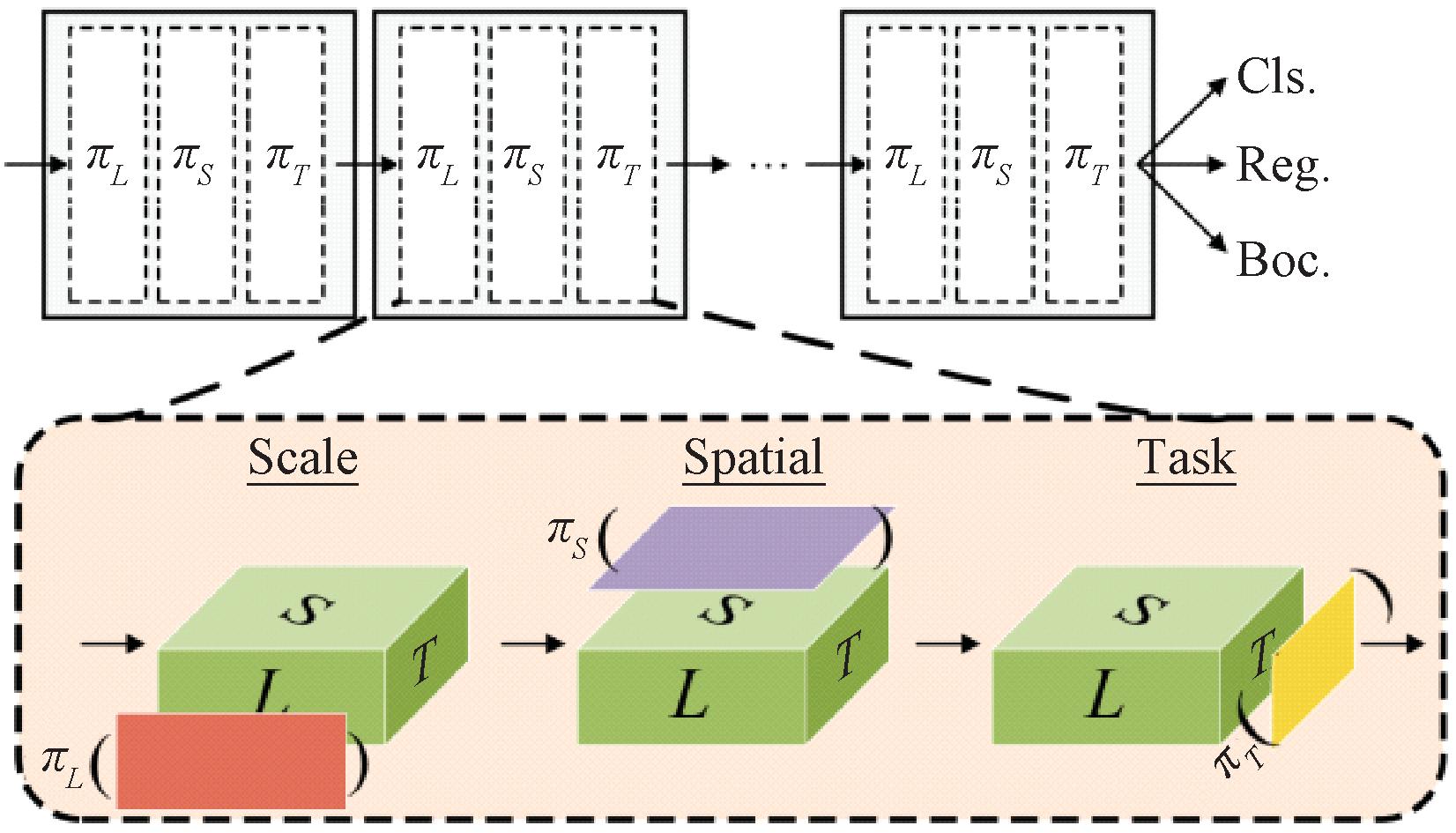

1.3 基于动态卷积的检测头结构

DyHead[16]使用了一种新的动态头部框架来统一关注目标最后预测处理部分的特征,分别逐步从尺度感知、空间感知和任务感知3个角度处理最后的图像特征并生成预测框,并且在3个感知角度上分别添加注意力机制,函数定义为

W(F)=πT(πS(πL(F)·F)·F)·F。

(2)

式中:πL(·)、πS(·)、πT(·)分别应用在尺度L、空间S、任务T的3个维度注意力函数。

DyHead结构图如图4所示。由图4可知,注意力函数以串联的形式对融合网络提取特征分别从3个不同维度进行感知,并在最后输出分类、定位、回归结果。在本文改进模型的设计中,根据实验结果最终使用了6组感知注意力模块依次叠加,让检测头具备更强的感知能力,可以进一步提升算法的山火烟雾检测性能。

图4 DyHead结构图

Figure 4 DyHead structure diagram

1.4 基于动态非单调聚焦机制的边界框损失

WIoU[17]是一种基于原有交并比并带有注意力机制的损失函数,在DIoU的基础上根据距离度量构建距离注意力,并利用动态非单调聚焦机制(focusing mechanism,FM)更好地解决了如何度量并构建距离注意力,并且针对质量较好和质量较差的火焰烟雾样本框之间的预测框回归(bounding box regression,BBR)的平衡问题,WIoU定义了离群度β以描述锚框的质量,β定义为![]() 表示单个预测框的损失值,

表示单个预测框的损失值,![]() 表示所有预测框损失均值,β∈[0,+∞)。

表示所有预测框损失均值,β∈[0,+∞)。

β小意味着锚框质量高,在β的基础上设计一个非单调聚焦系数,这样提供了更加优秀的梯度增益分配策略,该策略在降低高质量锚框的竞争力的同时,也减小了低质量预测框产生的不良梯度,使边界框回归聚焦到最多的普通质量预测框上,有效增强模型的泛化性能,WIoU损失函数计算公式为

(3)

式中:(xp,yp)表示预测框的中心点坐标;(xl、yl)表示标签框的中心点坐标;Hg、Wg分别表示预测框和标签框相交矩形的长和宽;δ、α均为学习参数,是随着每次IoU变化均动态变化的系数。

1.5 输电线路山火图像检测方法

改进后输电线路山火图像检测算法YOLOv8s_prove网络结构流程如图5所示,引入C2f_OD替换原有C2f特征提取卷积模块,提升模型特征提取能力;利用DyHead替换原有Head结构,增强模型对输电线路走廊山火火焰和烟雾的检测性能;引入WIoU损失函数提升模型对质量较差的火焰及烟雾样本的关注度。

图5 YOLOv8s_prove网络结构图

Figure 5 YOLOv8s_prove network struture diagram

2 实验结果与分析

2.1 山火图像数据集

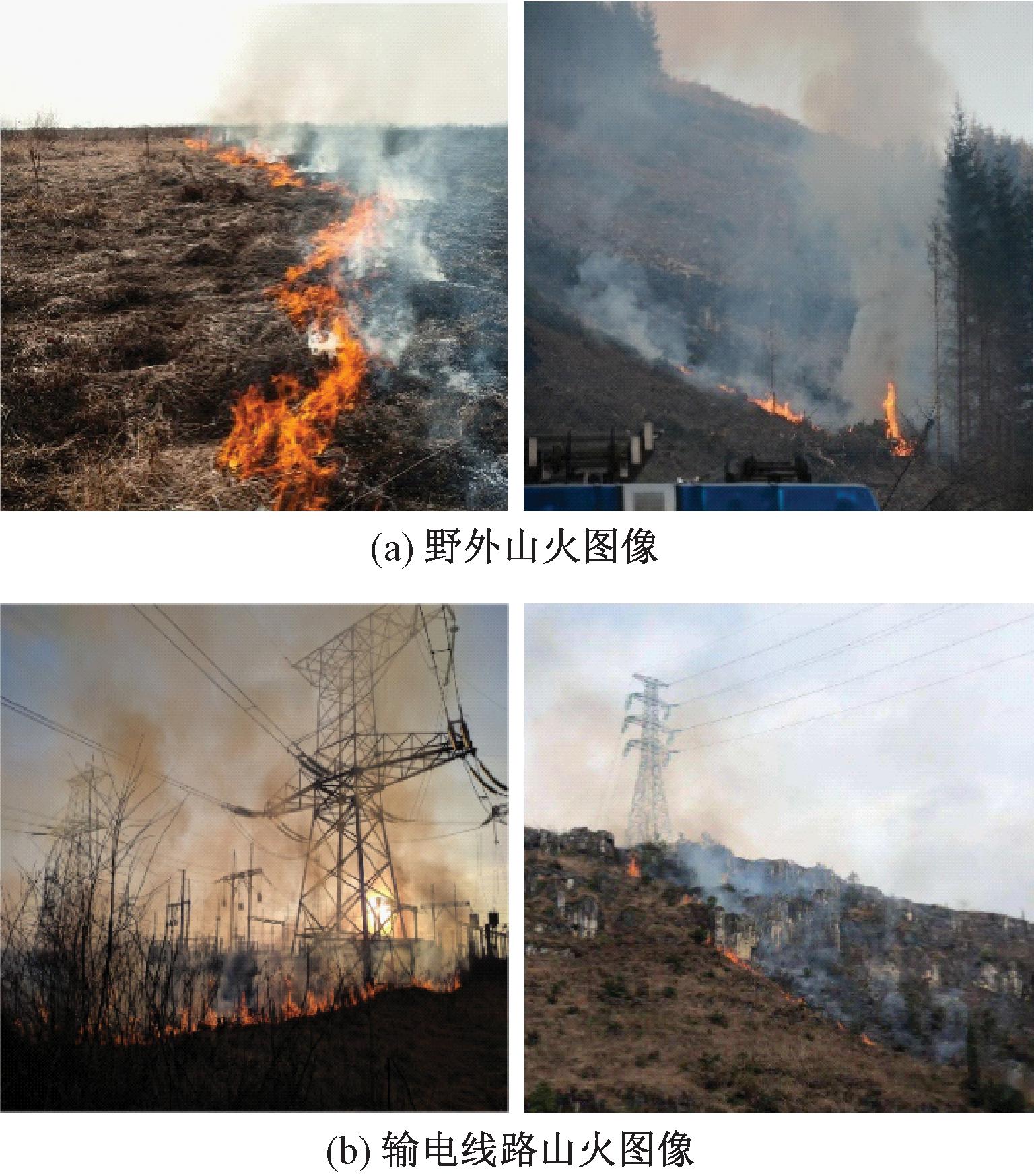

本文实验所用数据集基于自建数据集,图像数据源来自网络公开火焰烟雾图像和视频,得到总计拥有5 104张野外山火图像的山火数据集。考虑到输电线路大多铺设在农田、荒地、森林等野外区域,故本文自建数据集图像采集过程中选用以野外为背景的火灾图像和视频,模拟输电线路所处环境真实情况,为了保证样本的多样性和平衡性,涵盖了大量火势大小不同、光照条件不同的山火图像,以兼顾山火在各种环境下的特征,并且有针对性地保留带有输电线路的山火图像。山火图像实例如图6所示,野外山火图像如图6(a)所示,总计3 997张图像,其他火灾图像中均带有输电杆塔或输电线,输电线路山火图像如图6(b)所示,总计1 107张图像。由图6可知,野外山火图像与输电线路山火图像背景相似,有利于模型对类似环境下火焰烟雾目标的定位检测。

图6 山火图像实例

Figure 6 Example of wildfire image

参考PASCAL VOC数据集制作方式,使用LabelImg图像标注软件对图像进行标注,检测目标分别设置为fire和smoke,保存文件以xml为后缀。标注完成后共得到8 906个火焰标注框和5 200个烟雾标注框。将图像数据集以及标注数据集按照7∶2∶1的比例划分为训练集、测试集、验证集,分别有3 572,1 021,511张图像。

2.2 模型训练

本文在Pytorch深度学习框架上构建基于YOLOv8算法的输电线路山火检测模型,实验服务器选用12th Inter Core i5-12450F核心处理器和NVIDIA GeForce RTX 3060 12GB显卡,操作系统为Windows 11,测试代码所用程序编写软件为VS Code,训练使用cuda11.7与Python 3.8.0环境。

模型训练过程中,设置迭代批量大小为16,轮次为200,同时运行线程数量为4,图像归一化尺寸为640×640,随机梯度下降动量为0.937,初始学习率为0.01,最终学习率为0.000 1,置信度阈值为0.35,交并比阈值为0.5。

训练开始前,划分数据集,对输入图像进行预处理,包括缩放图像尺寸、归一化像素等操作;训练开始时,先将图像输入到模型的特征提取融合网络得到图像的特征图,再利用Head预测网络得到目标的预测类别、位置和得分信息,通过非极大抑制筛选预测框,得到最优的目标预测框和对应类别并计算当前轮次损失函数值,此时一轮训练完成,反向传播梯度,保存最新权重,直到损失函数值不再下降或者训练轮次大于设定轮次阈值,停止训练,最终得到最优模型权重。

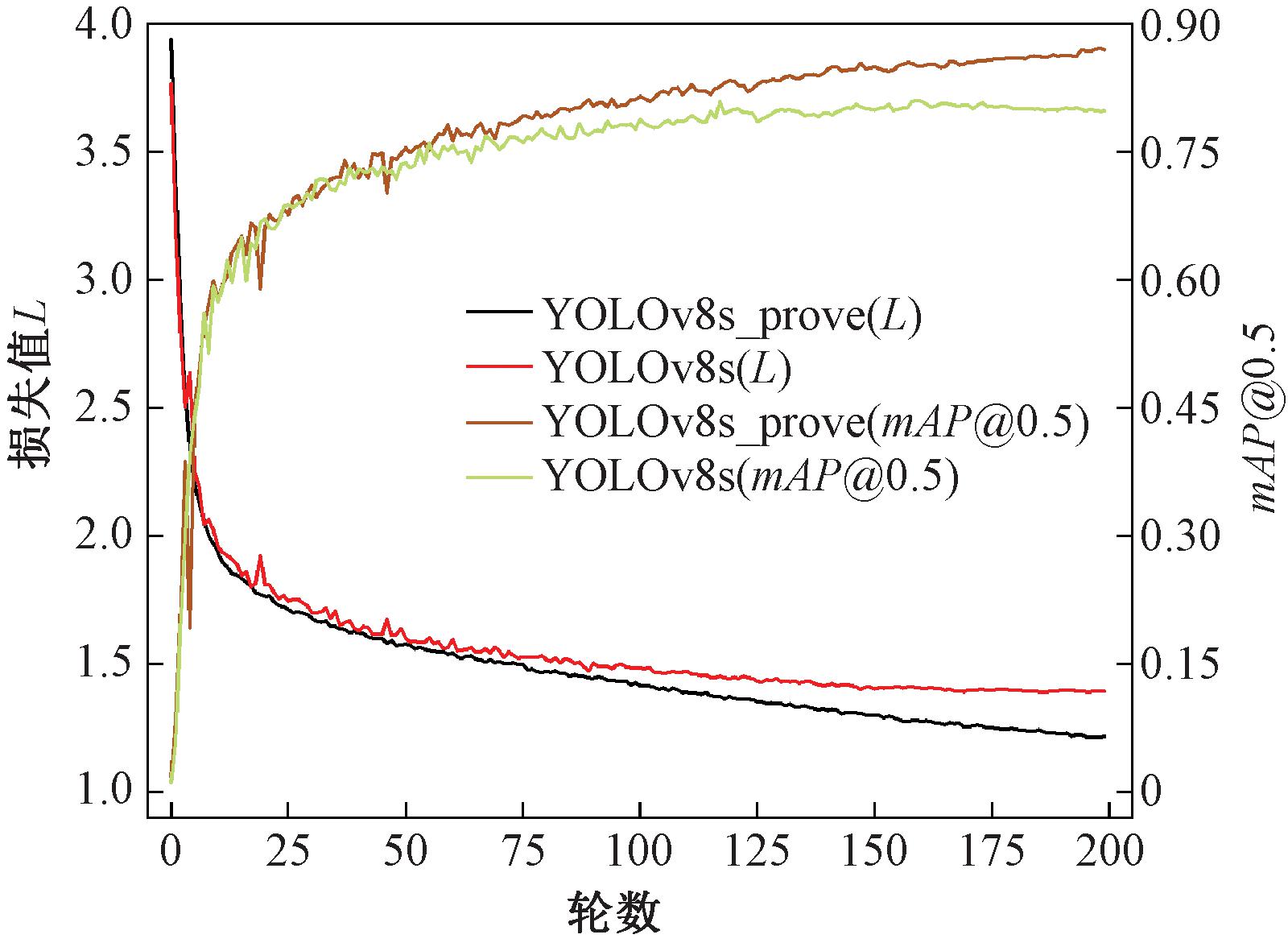

本文所提算法YOLOv8s_prove和原算法YOLOv8s的损失值和精度变化随训练轮数变化情况如图7所示,由图7可知,YOLOv8s_prove算法的训练过程中的损失值和平均精度均值mAP@0.5相较YOLOv8s都表现更好,YOLOv8s_prove相较于原算法损失值更低且不会出现振荡回升,表明引入WIoU后算法收敛效果更好;精度的提升也更多,并在最终达到了86.98%,表明了算法在训练过程中正常收敛,未出现过拟合现象。

图7 改进前后损失值与精度对比

Figure 7 Comparison of loss value and accuracy before and after improvement

2.3 实验结果对比

2.3.1 消融实验

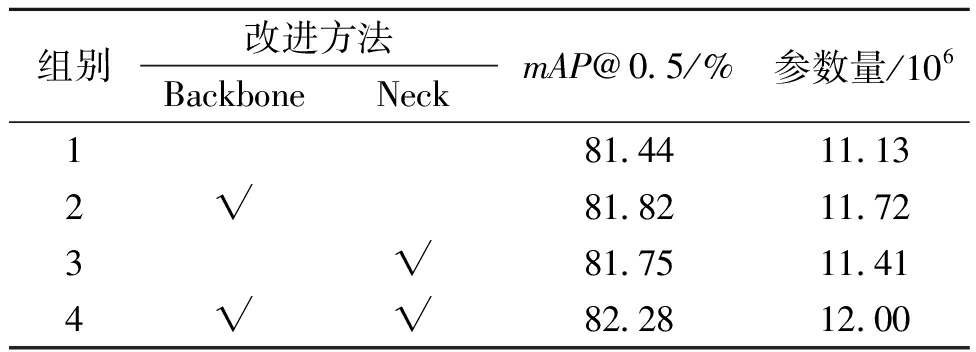

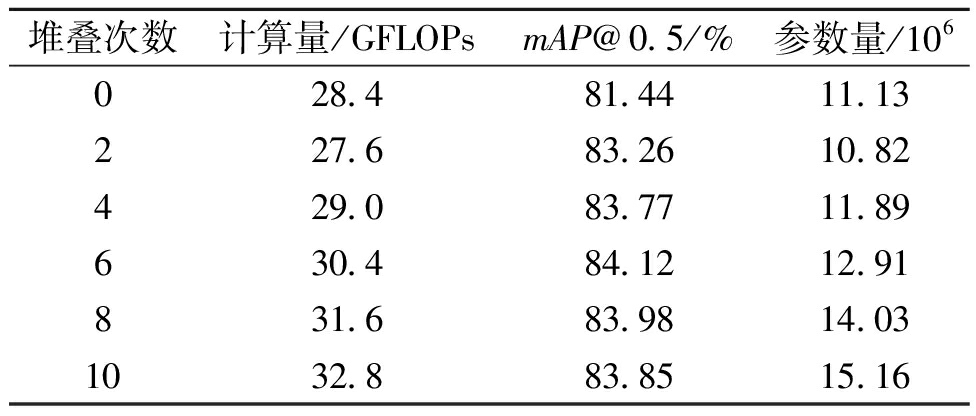

本文以精确率P、召回率R、平均精度AP、平均精度均值mAP等本领域通用指标来评价模型在山火检测任务中的检测性能。采用模型参数量和帧率来评估模型检测速度。为验证本文所提的3个改进方法在山火检测任务中的优势,基于本文构建的输电线路走廊山火数据集开展消融实验。首先针对ODConv改进位置进行消融实验,不同改进位置实验结果如表1所示。

表1 不同改进位置实验结果

Table 1 Test results of different improvement position

组别改进方法BackboneNeckmAP@0.5/%参数量/106181.4411.132√81.8211.723√81.7511.414√√82.2812.00

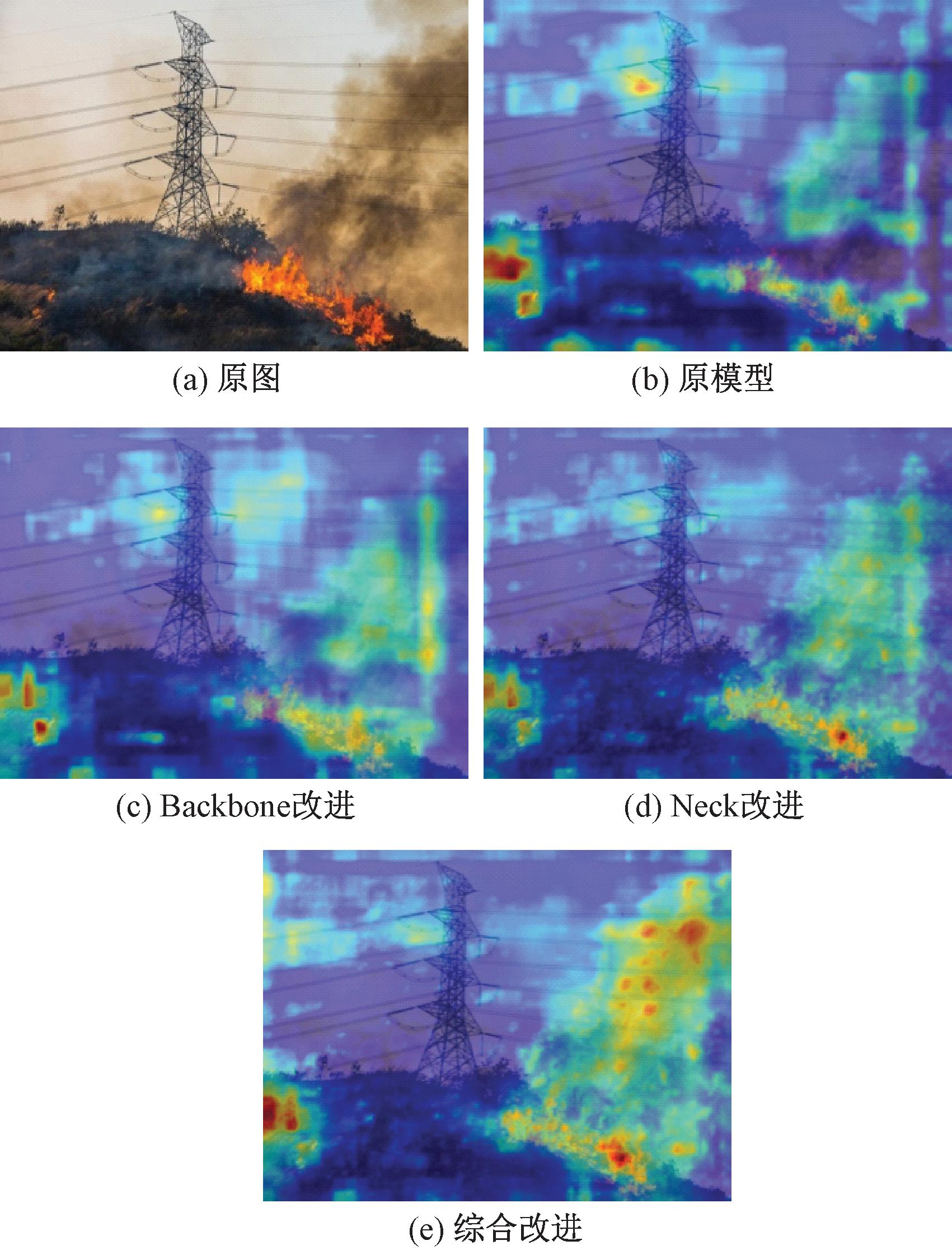

在表1中,组别1,2,3,4分别为原模型、仅对Backbone部分改进、仅对Neck部分改进和综合改进。由表2中组别1和组别2、3对比可知,分别对YOLOv8的Backbone和Neck部分进行改进后,精度分别提升0.38百分点和0.29百分点,验证了ODConv卷积块相较于原模型的BottleNeck中的Conv卷积块对于背景复杂的输电线路中火焰和烟雾的检测效果更好;组别4是对Backbone和Neck部分综合进行改进,相较于原模型前精度提升了0.84百分点,也表明了引入ODConv能够有效提升模型检测精度。为了更加直观地反映模型引入ODConv后在特征提取阶段对目标区域的关注情况,选取了模型特征提取过程中的特征图进行热力图展示,如图8所示。对比图8(b)、8(c)、8(d)、8(e)可知,分别在原模型的Backbone和Neck部分引入ODConv使得模型更加聚焦于火焰和烟雾区域,有效减少了模型对背景区域的错误关注度,综合Backbone和Neck部分改进后,模型对火焰、烟雾目标的语义信息提取能力最佳,对于不规则的火焰烟雾目标均有良好的识别能力,进一步验证了引入ODConv对提升模型特征提取能力的有效性。

表2 不同堆叠次数实验结果

Table 2 Test results of different stacking times

堆叠次数计算量/GFLOPsmAP@0.5/%参数量/106028.481.4411.13227.683.2610.82429.083.7711.89630.484.1212.91831.683.9814.031032.883.8515.16

图8 不同改进位置可视化对比

Figure 8 Visual comparison of different improved position

为了验证DyHead模块的有效性以及考量堆叠数量对模型性能的影响,本文对比了不同堆叠数量对模型检测精度结果的影响,结果如表2所示,堆叠次数为0时表示为原模型。

由表2中可知,替换DyHead模块后的模型计算量和参数量随着堆叠次数增加而增加,但并非叠加得越多模型对山火数据集适应得越好,堆叠次数过多会导致模型冗余,精度不升反降。根据实验验证,DyHead模块堆叠6次时,平均检测精度达到最高为84.12%,精度提升的同时参数量变化不大,表明6次为最优堆叠次数,引入DyHead模块能够有效提升模型检测性能。

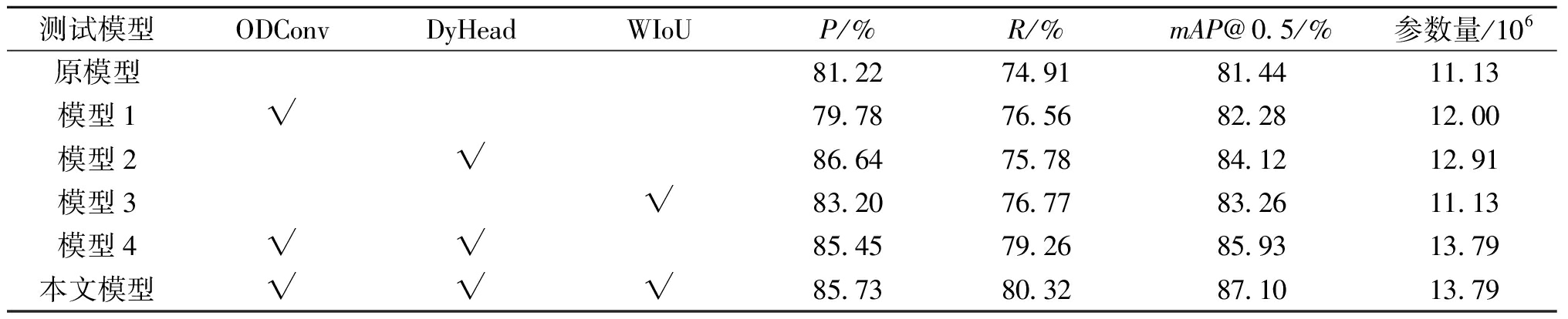

最后在YOLOv8s基础上,引入ODConv、DyHead、WIoU,并逐渐累加优化模块得到不同的组合策略,分别进行训练并测试,消融实验结果如表3所示。由表3可知,模型1、2、3分别是在原模型的基础上引入ODConv到Backbone和Neck部分进行改进,利用DyHead替换原模型检测头并堆叠6次Dy模块,引入WIoU替换原模型的损失函数。与YOLOv8s目标检测算法相比,这3种改进方法都对模型检测精度均值的提升均有效果,验证了本文所提3个方法的优越性。模型4是综合引入ODConv和DyHead,平均检测精度均值提升了3.49百分点,模型性能得到了进一步的改善。本文模型综合了3种改进方法,最终平均检测精度达到了87.10%,较原网络提升了5.66百分点,对输电线路走廊场景下山火烟雾的检测效果层层递进,验证了本文所提3种改进方式的合理性和有效性。

表3 YOLOv8s_prove消融实验结果

Table 3 YOLOv8s_prove ablation experiment results

测试模型ODConvDyHeadWIoUP/%R/%mAP@0.5/%参数量/106原模型81.2274.9181.4411.13模型1√79.7876.5682.2812.00模型2√86.6475.7884.1212.91模型3√83.2076.7783.2611.13模型4√√85.4579.2685.9313.79本文模型√√√85.7380.3287.1013.79

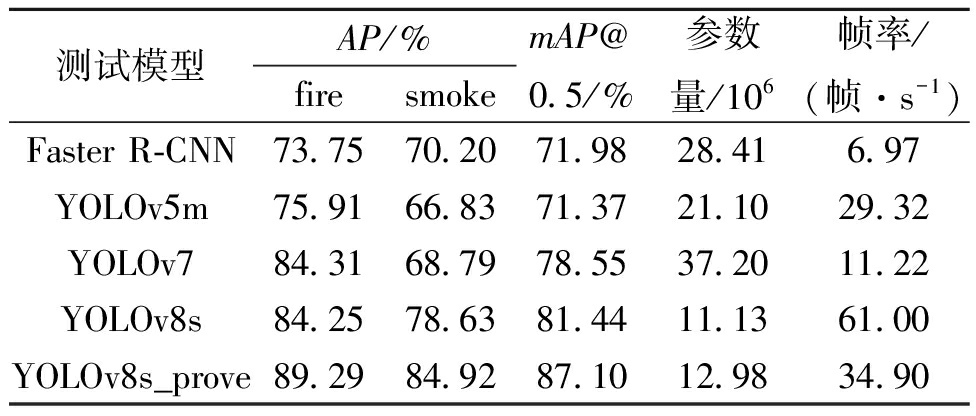

2.3.2 对比实验

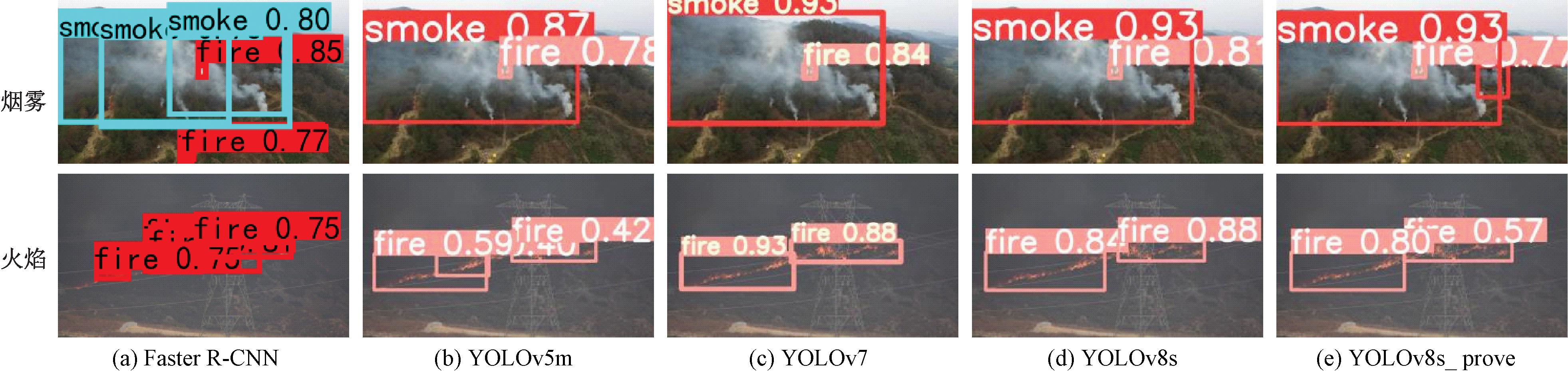

为了验证改进后YOLOv8s网络性能的优越性,在上述同一实验平台下,本文设置模型训练参数一致,将改进后的网络与主流基于锚框的单阶段目标检测网络YOLOv5m[18]、YOLOv7[19]及二阶段网络Faster R-CNN[20]分别进行对比,模型检测结果如表4所示。由表4可知,相较于其他算法,YOLOv8s_prove对火焰、烟雾检测的平均精度和平均精度均值皆为最高,远高于其他模型,结果表明在输电线路火焰烟雾的检测上YOLOv8s_prove检测性能最优。

表4 不同模型检测结果的对比

Table 4 Comparision of test results of different models

测试模型AP/%firesmokemAP@0.5/%参数量/106帧率/(帧·s-1)Faster R-CNN73.7570.2071.9828.416.97YOLOv5m75.9166.8371.3721.1029.32YOLOv784.3168.7978.5537.2011.22YOLOv8s84.2578.6381.4411.1361.00YOLOv8s_prove 89.2984.9287.1012.9834.90

为了更加直观方便地对比YOLOv8s_prove和其他主流算法的检测性能差异,模型检测效果对比如图9所示。由图9可以看出,Faster RCNN生成了很多对火焰和烟雾的预测框,召回率虽然高,但也导致了检测框与标注框重合度不高,致使精确率降低,说明Faster RCNN在针对火焰烟雾检测时没有很好地平衡精确率和召回率,造成精度较低;从YOLOv5的检测结果中可以看到,烟雾和火焰都或多或少存在漏检现象,导致其精度表现不理想;YOLOv7对火焰目标的检测效果很好,但是烟雾的检测性能表现较差,漏检了与天空特征相似的烟雾以及小目标烟雾;YOLOv8s算法表现较为均衡,仅存在小目标火焰、烟雾的漏检,且火焰和烟雾的检测框置信度都更高;而本文所提模型YOLOv8s_prove能够精确检测几乎所有的火焰和烟雾,且其置信度评分相较于YOLOv8s都更高,其预测框对目标的包裹度也更完美,对于小目标火焰、烟雾的检测相较于其他目标检测算法效果更好,验证了该模型能有效解决火焰、烟雾误检漏检问题。

图9 模型检测效果对比

Figure 9 Comparison of model detection effect

3 结论

本文在YOLOv8s的基础上进行改进,引入动态卷积理论,将ODConv替换BottelNeck中的Conv卷积,并将原有的YOLO Head替换为DyHead,实现了对火焰、烟雾等不规则目标的精确检测。通过实验验证ODConv改进位置以及DyHead模块堆叠次数对于整体模型性能的影响。引入WIoU损失函数提高模型的收敛效果,使模型的检测更注重于当前目标,将检测框回归聚焦于普通质量的预测框。实验结果表明,改进后的网络模型虽然损失了部分检测速度,但有效提升了对输电线路山火的检测精度,满足精确监测的需求。

在实际应用输电线路杆塔摄像头拍摄山火图像检测工作中,发现云雾、灯光等有时会误检为烟雾、火焰,在后续工作中可结合工程实际应用效果以及存在的问题开展针对性研究,解决误检问题。

(本文受到南方电网公司科技项目(GDKJXM20222564)的支持。)

[1] 黄道春, 黎鹏, 阮江军, 等. 山火引发输电线路间隙放电机理与击穿特性综述[J]. 高电压技术, 2015, 41(2): 622-632.

HUANG D C, LI P, RUAN J J, et al. Review on discharge mechanism and breakdown characteristics of transmission line gap under forest fire condition[J]. High Voltage Engineering, 2015, 41(2): 622-632.

[2] 胡毅, 刘凯, 吴田, 等. 输电线路运行安全影响因素分析及防治措施[J]. 高电压技术, 2014, 40(11): 3491-3499.

HU Y, LIU K, WU T, et al. Analysis of influential factors on operation safety of transmission line and countermeasures[J]. High Voltage Engineering, 2014, 40(11): 3491-3499.

[3] 陆佳政, 周特军, 吴传平, 等. 某省级电网220 kV及以上输电线路故障统计与分析[J]. 高电压技术, 2016, 42(1): 200-207.

LU J Z, ZHOU T J, WU C P, et al. Fault statistics and analysis of 220 kV and above power transmission line in province-level power grid[J]. High Voltage Engineering, 2016, 42(1): 200-207.

[4] 张敏, 戴栋, 谢从珍, 等. 基于激光雷达技术的输电线路山火监测方法研究[J]. 电测与仪表, 2015, 52(15): 101-107.

ZHANG M, DAI D, XIE C Z, et al. Study on monitoring wildfire around power transmission line based on lidar[J]. Electrical Measurement &Instrumentation, 2015, 52(15): 101-107.

[5] 叶立平, 陈锡阳, 何子兰, 等. 山火预警技术在输电线路的应用现状[J]. 电力系统保护与控制, 2014, 42(6): 145-153.

YE L P, CHEN X Y, HE Z L, et al. Present situation of forest fire early warning technology used for transmission line[J]. Power System Protection and Control, 2014, 42(6): 145-153.

[6] 陈钦柱, 赵海龙, 余阳. 基于无人机的电力传输线山火灾害监测技术研究[J]. 自动化与仪器仪表, 2019(4): 242-245, 250.

CHEN Q Z, ZHAO H L, YU Y. Research on monitoring technology of mountain fire disaster based on UAV′s power transmission line[J]. Automation &Instrumentation, 2019(4): 242-245, 250.

[7] 杨传凯, 吴兵, 孔敏儒, 等. 基于输电巡检图像的山火智能识别方法[J]. 电力信息与通信技术, 2021, 19(1): 66-72.

YANG C K, WU B, KONG M R, et al. Intelligent identification method of mountain fire based on the inspection image of power transmission[J]. Electric Power Information and Communication Technology, 2021, 19(1): 66-72.

[8] REN S Q, HE K M, GIRSHICK R, et al. Faster R-CNN: towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149.

[9] REDMON J, FARHADI A. YOLOv3: an incremental improvement[EB/OL]. (2020-04-23)[2024-12-26].https:∥doi.org/10.48550/arXiv.2004.10934.

[10] BOCHKOVSKIY A, WANG C Y, LIAO H M. YOLOv4: optimal speed and accuracy of object detection[EB/OL].(2020-04-23)[2024-12-26].https:∥doi.org/10.48550/arXiv.2004.10934.

[11] LI P, ZHAO W D. Image fire detection algorithms based on convolutional neural networks[J]. Case Studies in Thermal Engineering, 2020, 19: 100625.

[12] 张坚鑫, 郭四稳, 张国兰, 等. 基于多尺度特征融合的火灾检测模型[J]. 郑州大学学报(工学版), 2021, 42(5): 13-18.

ZHANG J X, GUO S W, ZHANG G L, et al. Fire detection model based on multi-scale feature fusion[J]. Journal of Zhengzhou University (Engineering Science), 2021, 42(5): 13-18.

[13] 卢鹏, 赵亚琴, 陈越, 等. 复杂背景环境下基于SSDMobileNet深度学习模型的火焰图像识别研究[J]. 火灾科学, 2020, 29(3): 142-149.

LU P, ZHAO Y Q, CHEN Y, et al. Flame recognition in complex environment based on deep learning model SSDMobileNet[J]. Fire Safety Science, 2020, 29(3): 142-149.

[14] 王一旭, 肖小玲, 王鹏飞, 等. 改进YOLOv5s的小目标烟雾火焰检测算法[J]. 计算机工程与应用, 2023, 59(1): 72-81.

WANG Y X, XIAO X L, WANG P F, et al. Improved YOLOv5s small target smoke and fire detection algorithm[J]. Computer Engineering and Applications, 2023, 59(1): 72-81.

[15] LI C, ZHOU A, YAO A. Omni-dimensional dynamic convolution[EB/OL].(2022-09-16)[2024-12-26]. https:∥doi.org/10.48550/arXiv.2209.07947.

[16] DAI X Y,CHEN Y P,XIAO B,et al.Dynamic head: unifying object detection heads with attentions[EB/OL].(2021-06-15) [2024-12-26].https:∥doi.org/10.48550/arXiv.2106.08322.

[17] TONG Z J, CHEN Y H, XU Z W, et al. Wise-IoU: bounding box regression loss with dynamic focusing mechanism[EB/OL]. (2023-01-24)[2024-12-26]. https:∥arxiv.org/abs/2301.10051.

[18] Ultralytics. YOLOv5[EB/OL]. (2020-06-26) [2024-12-26]. https:∥g ithub.com/ultralytics/YOLOv5.

[19] WANG C Y, BOCHKOVSKIY A, LIAO H Y M. YOLOv7: trainable bag-of-freebies sets new state-of-the-art for real-time object detectors[C]∥Proceedings of the IEEE/CVF conference on computer vision and pattern recognition.Piscataway:IEEE, 2023: 7464-7475.

[20] REN S,HE K,GIRSHICK R,et al.Faster R-CNN:towards real-time object detection with region proposal networks[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2017,39(6):1137-1149.