在数字化时代背景下,非结构化文本数据的积累达到了前所未有的规模。研究者借助自然语言处理(natural language processing,NLP)技术对文本数据进行处理和分析,并从中抽取具有特定意义和价值的关键信息,为人们提供高质量的智能知识服务,如智能问答、机器翻译和个性化推荐等。面对庞大的文本数据,如何进行数据分类、关键词定位和深层语义关系挖掘是实现智能问答和知识图谱构建技术的关键[1]。

信息抽取旨在通过命名实体识别(named entity recognization,NER)和关系抽取(relation extraction,RE)任务识别非结构化文本中特定的信息,并以结构化的形式来表示。其中命名实体识别旨在从非结构化文本中标注特定的词汇或短语;关系抽取专注于识别实体间的关系。通常关系抽取是基于命名实体识别展开,多任务学习将这两个任务融合,将文本中的实体和关系抽取为主体(subject)、关系(relation)、客体(object)三元组。此类方法能更有效促进命名实体识别和关系抽取任务间信息的传递与理解,从而显著提高实体关系联合抽取的性能。

针对实体关系联合抽取任务没有充分考虑实体识别与关系抽取两个子任务之间的关联信息以及三元组重叠和任务间信息错误传播的问题,本文提出一种基于RoBERTa(robustly optimized BERT pretraining approach)和指针网络(pointer network,Ptr-Net)的中文实体与关系联合抽取方法[2],主要研究内容如下:

(1)构建基于RoBERTa和指针网络的中文实体与关系联合抽取模型(RoBPtr),采用五元组的形式对文本中的实体与关系进行联合抽取,与管道方法相比,该方法能够有效解决实体识别和关系抽取任务间的关联信息未能充分考虑的问题,避免信息错误传播。

(2)借助指针网络将实体识别任务转化为识别token-pair的问题,通过确定实体的起始与终止位置,提取所有潜在实体。

(3)利用指针网络与多头注意力机制为每一组实体对的多个关系建立专属的概率子空间,实现同一实体对的不同关系被非互斥的识别和提取,解决三元组重叠问题。

1 相关工作

传统的基于神经网络的实体关系抽取方法大多是基于管道方法。管道方法首先使用命名实体识别模型抽取文本中的实体,再使用关系抽取模型预测每个抽取到的实体间的关系[3]。该类方法没有考虑命名实体识别和关系抽取之间存在的紧密联系,同时还会导致信息的错误传播。为解决上述问题,研究者开始在命名实体识别和关系抽取之间设计各种桥梁,以此融合两个任务之间的信息[4-5]。然而,目前大多数方法依然采用参数共享的方式,而非通过联合解码来实现实体和关系的统一学习,仍然需要依赖管道式的处理模式。上述方法将关系抽取视为给实体对分配具体标签的问题,当同一实体存在于多个关系中时,关系分类器通常会产生困扰,无法判断实体参与到哪个关系中,导致抽取到的关系三元组不完整和不准确。

Miwa等[6]提出一种基于历史信息的结构化实体与关系联合抽取学习方法,引入实体与关系表,用于表示句子中整个实体和关系的结构,将实体和关系联合抽取问题视为表格填充问题。Wei等[7]提出一种用于关系三元组抽取的级联二进制标注框架,将关系建立为句子中主语映射到宾语的函数,并结合预训练语言模型,解决了传统方法中因实体共享导致的三元组重叠问题。Wang等[8]提出一种名为TPLinker的单阶段模型,通过创新的令牌对链接机制,将实体识别与关系分类统一,建立3个矩阵的链接操作模型,有效解决传统方法中的暴露偏差和重叠关系难题。Yan等[9]提出一种分区过滤网络(partition filter network,PFN)方法,用于正确建立NER与RE两个任务之间的双向交互关系,缓解了联合抽取中NER与RE任务之间特征交互不平衡的问题。Zheng等[10]基于潜在关系和全局对应的关系三元组抽取框架PRGC,首先筛选文本中的候选关系,然后针对每个潜在关系独立进行主客实体序列标注,最后通过构建字符级相关矩阵来快速匹配并组合主客实体对,从而组成三元组。Li等[11]提出了一种用于实体和关系联合抽取的高效翻译解码模式TDEER,通过将关系建立为主体到宾语的翻译操作,自然地处理重叠三元组问题,并通过引入负样本来增强模型的鲁棒性。Sui等[12]提出了集合预测网络(set prediction networks,SPNs),以BERT(bidirectional encoder representation from transformers)[13]作为编码器,利用基于Transformer的非自回归解码器作为集合生成器,可以一次性预测所有的三元组,避免了三元组排序的问题,并提出了受运筹学中分配问题启发的二分匹配损失函数。Gao等[14]提出了一种新颖的轻量级联合抽取模型,通过基于仿射变换的全局实体匹配策略、候选关系注意力机制及负采样策略,在很大程度上简化了模型结构,并在一定程度上解决了三元组重叠的问题。Li等[15]提出了一种基于分解策略的联合抽取框架,通过引入指针机制提高边界特征提取效率,增强边界感知与分类能力。

上述方法通过参数共享和联合解码等机制,为实体识别和实体关系抽取两个子任务建立了协同关联,从而实现两个子任务之间的交互信息建模,在一定程度上缓解了传统管道方法无法考虑实体识别与实体关系抽取的关联信息以及任务间信息错误传播的问题。然而,对于包含大量三元组嵌套的句子,这些方法的抽取性能仍有较大的提升空间。

2 RoBPtr模型

2.1 模型结构

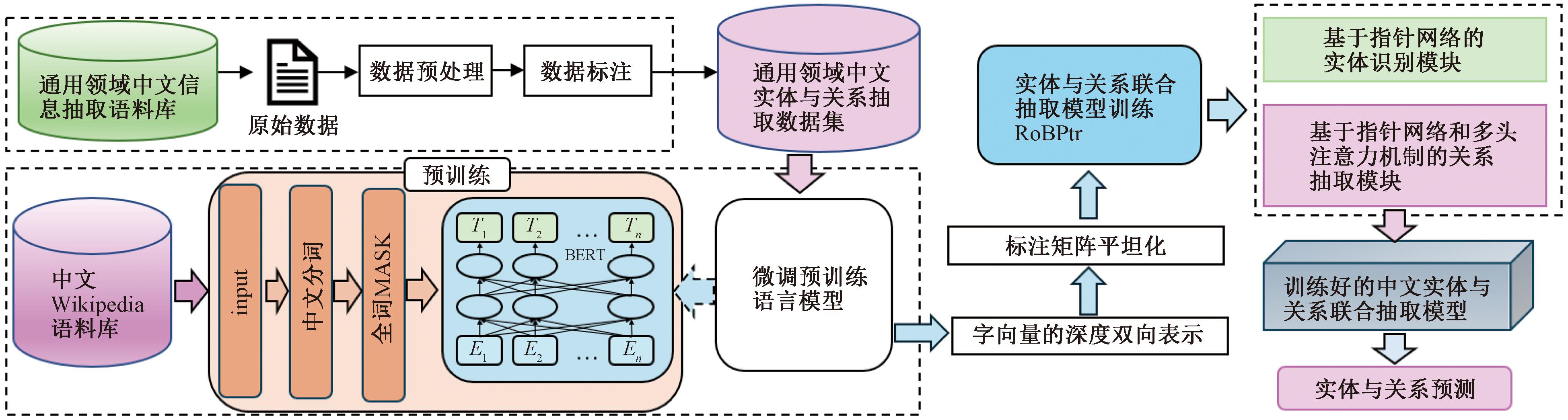

本文提出一种基于RoBERTa和指针网络的中文实体与关系联合抽取方法,将实体与关系联合抽取任务构建为token-pair识别问题,即把三元组(s, r, o)抽取任务重构为五元组(sh, st, r, oh, ot)识别任务。该方法主要分为通用领域中文实体与关系抽取数据集构建模块、预训练模块和下游实体与关系联合抽取模型训练3个部分,本文方法流程如图1所示。

图1 本文方法流程图

Figure 1 Flowchart of proposed method

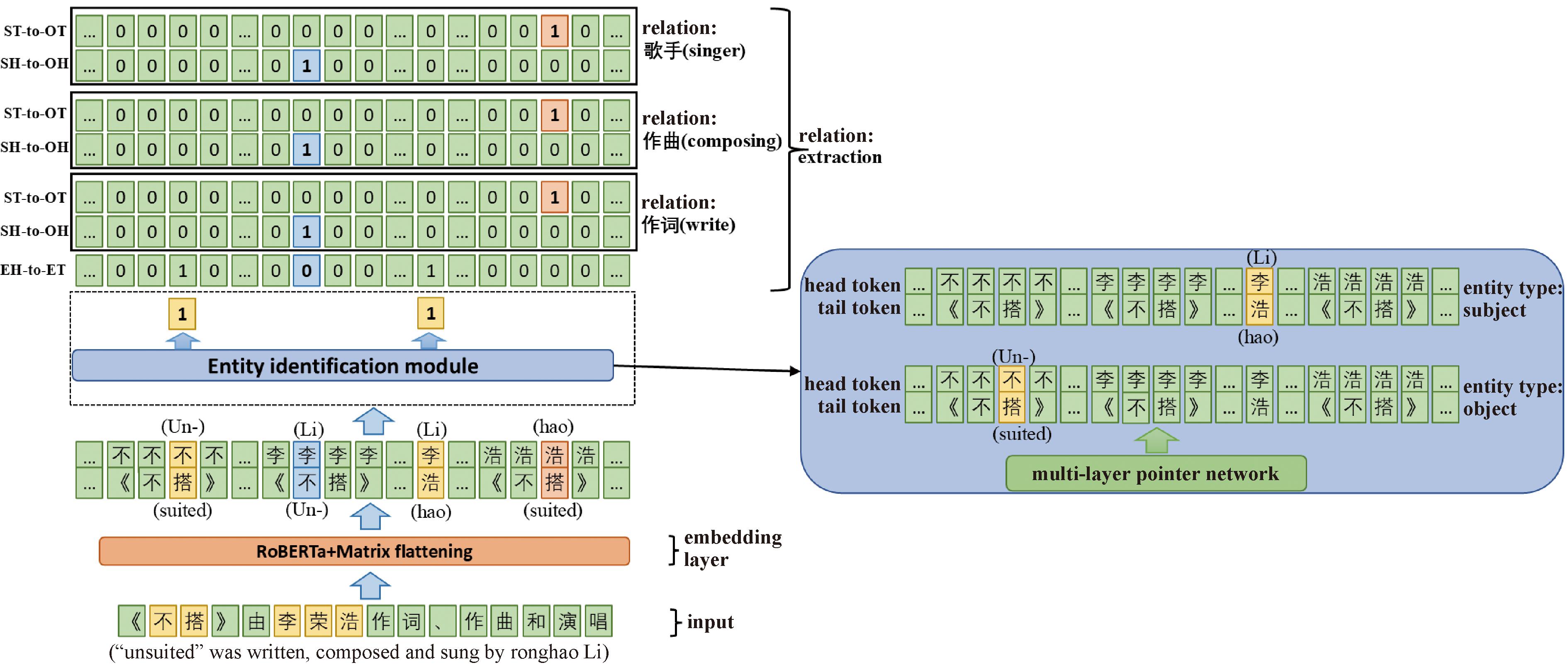

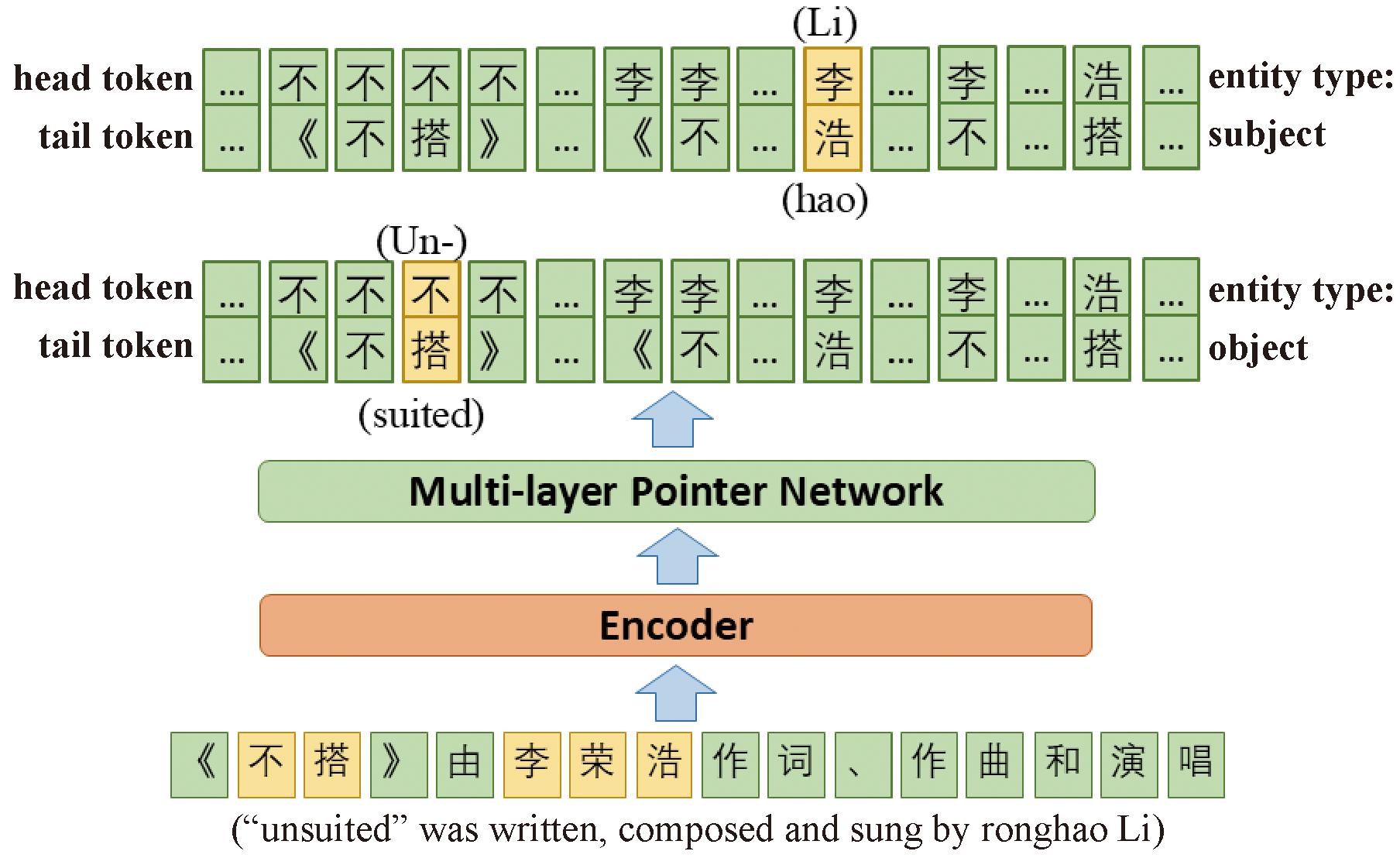

RoBPtr模型实现了实体与关系联合抽取。模型框架主要分为3部分:编码层、实体识别模块和关系抽取模块。首先,使用RoBERTa获得字符的深度双向表示;其次,利用实体识别模块提取文本中所有潜在的主体和客体,形成候选实体集合;最后,使用关系抽取模块解析所有可能的实体关系三元组。模型结构如图2所示,图2中黄色标注表示实体开始和结束位置的token-pair,蓝色标注表示subject和object开始位置的token-pair,粉色标注表示subject和object结束位置的token-pair。

图2 RoBPtr模型结构

Figure 2 Model architecture of RoBPtr

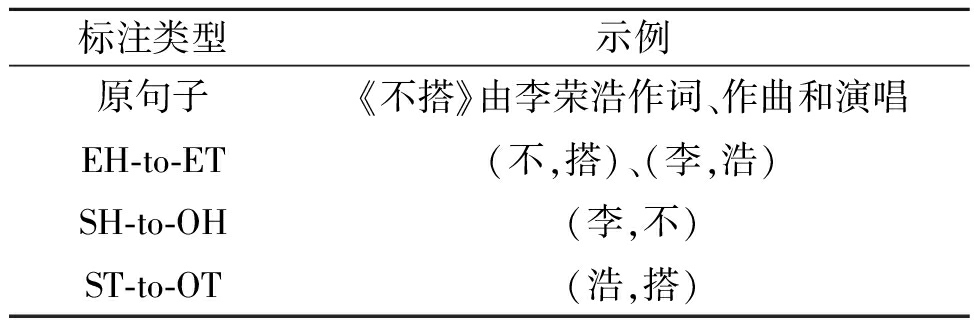

2.2 矩阵平坦化

使用连接标签方式对token-pair进行标注,然后借助连接矩阵对不同的标注结果进行解码,得到所有实体及其对应的嵌套关系。传统连接矩阵标注方法难以用一个矩阵表示同一实体对的多个关系,即不能有效解决实体对重叠(entity pair overlap,EPO)问题。为此,本文依据关系对实体边界进行对齐,以序列的方式将每种关系的连接矩阵平坦化,并设计了3种不同的连接标签方式来标注token-pair,实现使用同一个矩阵将每种关系都进行标注[16]。3种连接标签方式如下。

(1)EH-to-ET(entity head to entity tail):token-pair表示单个实体在文中的起始和结束位置。

(2)SH-to-OH(subject head to object head):token-pair表示subject和object在文中的起始位置。

(3)ST-to-OT(subject tail to object tail):token-pair表示subject和object在文中的结束位置。

token-pair标注示例如表1所示。

表1 token-pair标注示例

Table 1 Tagging examples of token-pair

标注类型示例原句子《不搭》由李荣浩作词、作曲和演唱EH-to-ET(不,搭)、(李,浩)SH-to-OH(李,不)ST-to-OT(浩,搭)

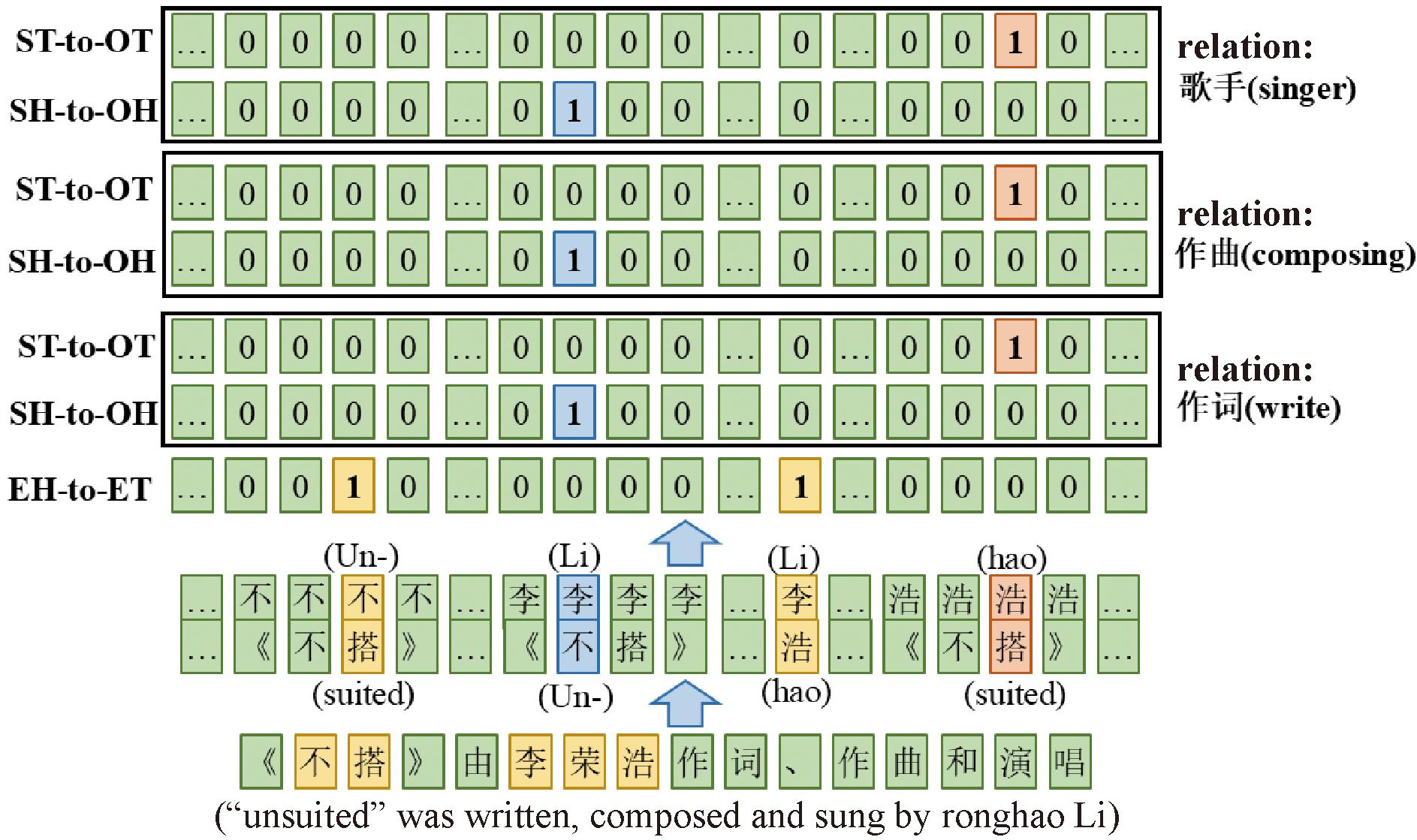

在传统的token-pair标注方法中,为了表示同一实体对间的不同关系,需要对应多个独立的连接矩阵,如图3所示。图3中黄色标注表示实体开始和结束的token,蓝色标注表示subject和object的开始token,粉色标注表示subject和object的结束token。

图3 传统token-pair标注矩阵

Figure 3 Traditional token-pair tagging matrix

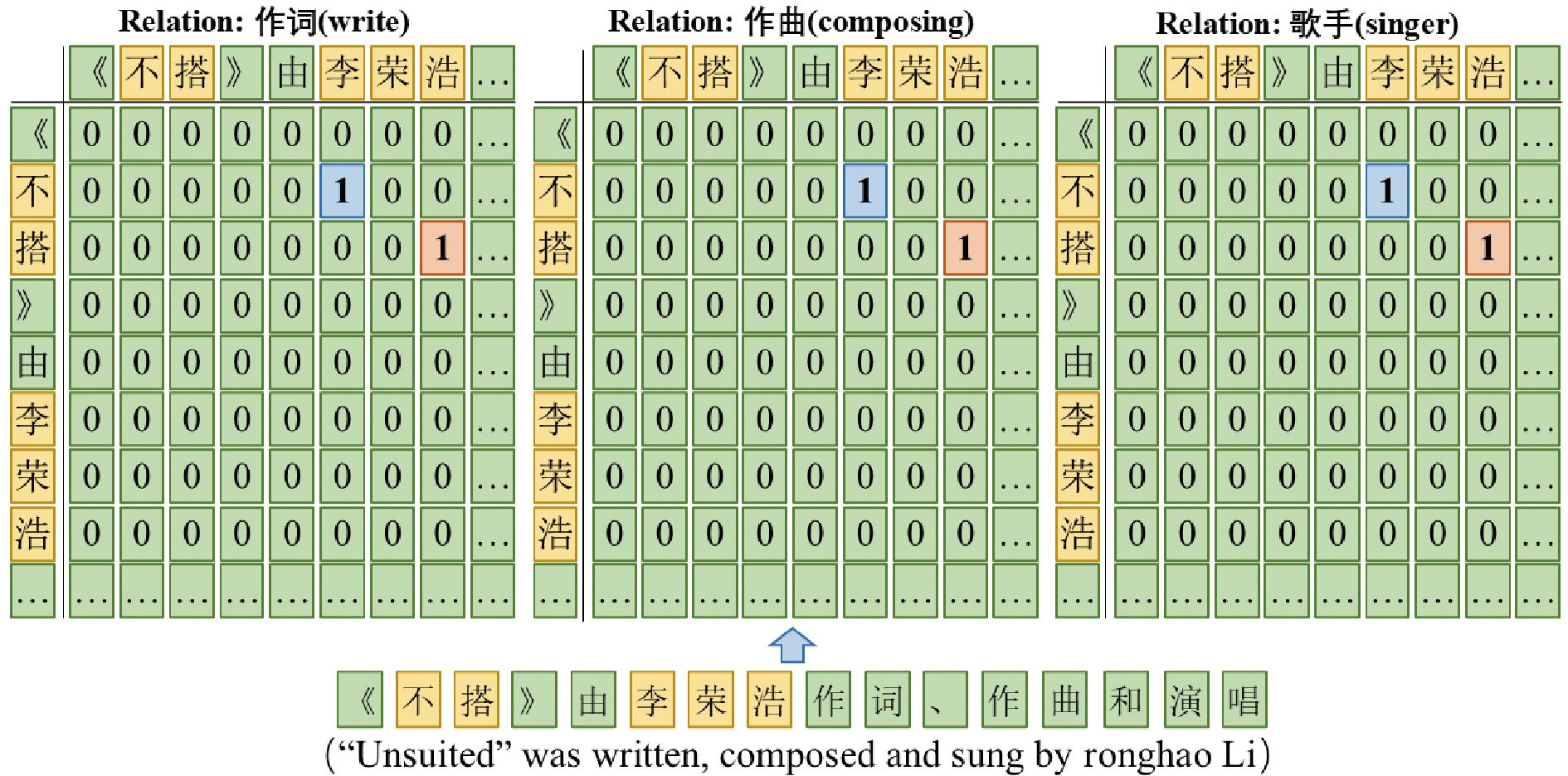

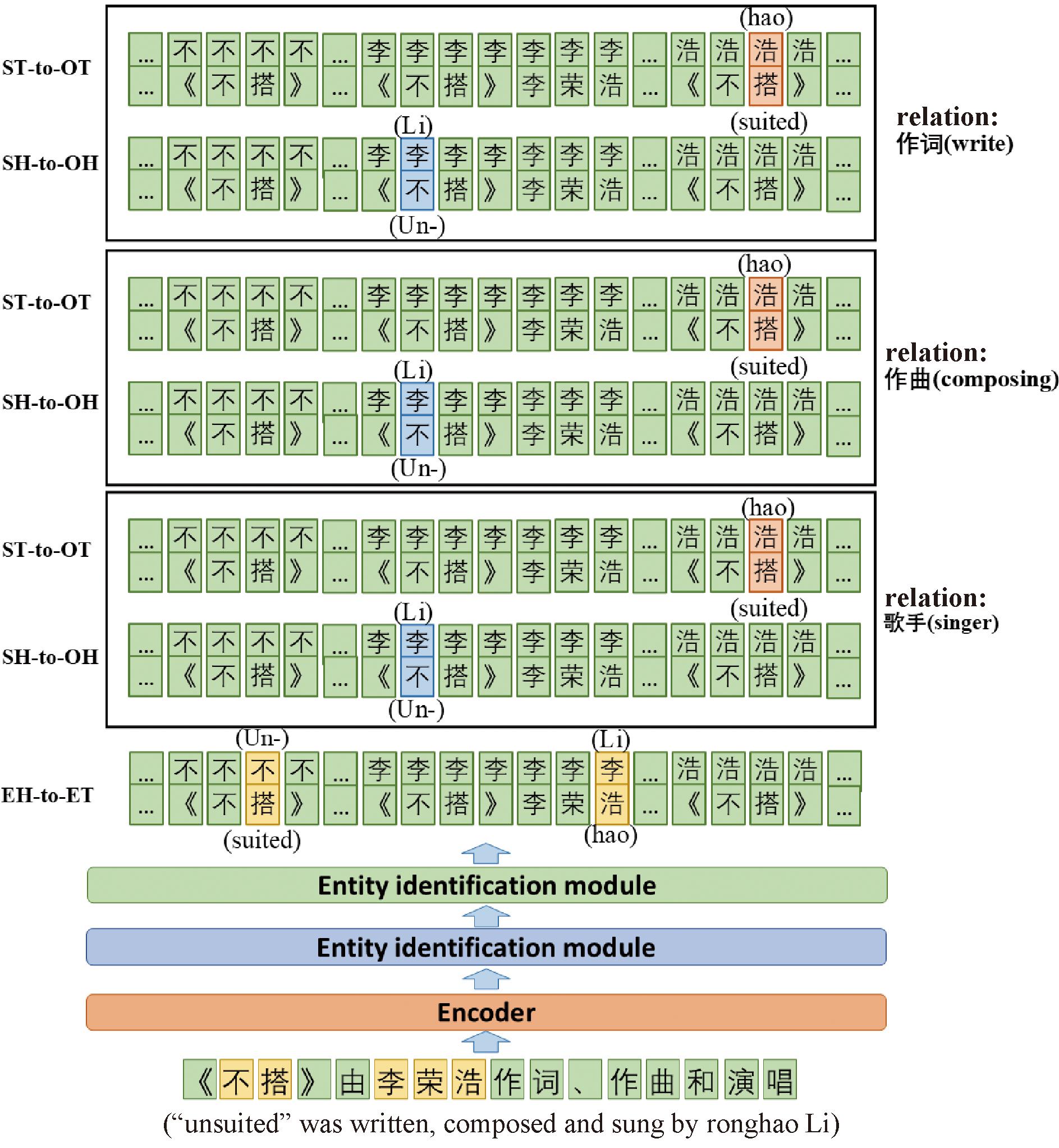

经过矩阵平坦化处理后,同一实体对3种不同关系标记只需一个连接矩阵,具体参见图4。图4中黄色标注表示实体在文中的起始和结束位置的token-pair,蓝色标注表示subject和object在文中的起始位置的token-pair,粉色标注表示subject和object在文中的结束位置的token-pair。

图4 矩阵平坦化后的token-pair标注矩阵

Figure 4 Token-pair tagging matrix after matrix flattening

2.3 RoBERTa层

本文采用RoBERTa作为嵌入层学习字符的深度双向表示,从而充分考虑上下文语义和位置信息的字符嵌入。RoBERTa使用分词器对输入文本进行分词操作,随后从得到的分词结果中随机选择多个连续词汇实施全词遮蔽(whole word masking,WWM)[17],进而使模型依据上下文来推测被遮蔽的单词,以此增强模型对上下文及词语的理解与表征能力。此外,RoBERTa还将位置嵌入与字符嵌入相融合,使其最终输出的嵌入能够涵盖上下文语义和位置信息,从而充分表征字符的特征。得到的嵌入向量将在下游实体识别任务与关系抽取任务中共用。

2.4 实体识别模块

传统基于指针网络的实体识别方法常分别识别实体的head-token和tail-token,容易引起训练阶段与预测阶段的不匹配问题。本文将head-token与tail-token统一考虑来进行实体识别,从而将该任务转换为token-pair的连接问题。通过构建多层指针网络,高效地识别实体边界,其中每一层指针网络专注于一种特定类型的实体识别,基于多层指针网络的实体识别方法的结构如图5所示。

图5 基于多层指针网络的实体识别方法的结构

Figure 5 Structure of entity recognition method based on multi-layer pointer network

对于一个具有n个token的序列,每个实体都是该序列中的一个或多个连续片段,其长度不固定,并允许嵌套结构存在。在该序列中共有n(n+1)/2个可能的子序列,每一个都可被视为潜在的实体。模型的任务是在这些候选实体中精确地确定实体边界。当需要识别m种不同类型的实体时,则将问题构建为从m·n(n+1)/2个实体中选择k的多标签分类任务。算法如式(1)~式(3)所示:

qi,a=Wq,ahi+bq,a;

(1)

Ki,a=Wk,ahi+bk,a;

(2)

(3)

式中:hi表示第i个token的向量表示;W和b分别指代模型训练过程中可学习的权重参数和偏置;Pa(i, j)指代从序列中第i个到第j个token所组成的连续片段属于类型a实体的概率。

2.5 关系抽取模块

借助多头注意力机制与指针网络[18]实现关系抽取模块,实体对的各类关系通过多头注意力机制分配独立的概率子空间,实现对同一实体对可能存在的多种关系进行非互斥的识别,进而有效地处理EPO问题。关系抽取模块如图6所示。

图6 关系抽取模块

Figure 6 Module of relation extraction

将三元组(s, r, o)识别任务构建为五元组(sh, st, r, oh, ot)识别问题。其中h表示实体的开头位置,t表示实体的结尾位置。对于实体识别模块中抽取的所有subject和object,利用预定义的relation作为条件对齐subject和object实体的边界以实现关系抽取,即在relation条件下对(sh, oh)和(st, ot)进行打分,其中所有关系共享EH-to-ET序列。算法将计算三元组(s, r, o)的得分重构为计算五元组(sh, st, r, oh, ot)的得分,由式(1)~式(3)可推导得到token-pair的打分函数,算法如式(4)~式(8)所示:

(4)

(5)

(6)

(7)

S(sh,st,r,oh,ot)=S(sh,st)+S(oh,ot)+S(sh,oh|r)+S(st,ot|r)。

(8)

式中:S(sh, st)表示以sh和st作为开始和结束token的subject的得分;S(oh, ot)表示以oh和ot作为开始和结束token的object的得分;S(sh, oh|r)表示分别以sh和oh作为开头token的subject和object之间的关系为r的得分;S(st, ot|r)表示分别以st和ot作为结束token的subject和object之间的关系为r的得分;S(sh, st, r, oh, ot)表示五元组的得分。

模型训练目标为让真实五元组满足条件S(sh, st, r, oh, ot)>0、S(sh, st)>0、S(oh, ot)>0、S(sh, oh|r)>0、S(st, ot|r)>0,其余五元组S(sh, st, r, oh, ot)<0。预测阶段当且仅当S(sh, st, r, oh, ot)>0 &S(sh, st)>0 &S(oh, ot)>0 &S(sh, oh|r)>0 &S(st, ot|r)>0为真时,将对应的五元组作为输出。

2.6 损失函数

本文联合训练实体识别模块和关系抽取模块,在训练期间优化组合目标函数。损失函数使用多标签交叉熵[19]。

实体识别模块损失函数为

(9)

式中:Pa表示所有类型为a的实体首尾集合;Na表示所有类型为非a的实体首尾集合或非实体;![]() 表示第i到第j个token组成的片段为类型a的实体的得分。

表示第i到第j个token组成的片段为类型a的实体的得分。

关系抽取模块损失函数为

(10)

式中:P表示真实五元组的集合;N表示非真实五元组的集合或非五元组;Si表示五元组的得分。

模型总体损失函数为

LTOTAL=LNER+LRE。

(11)

3 数据集与评价指标

3.1 数据集

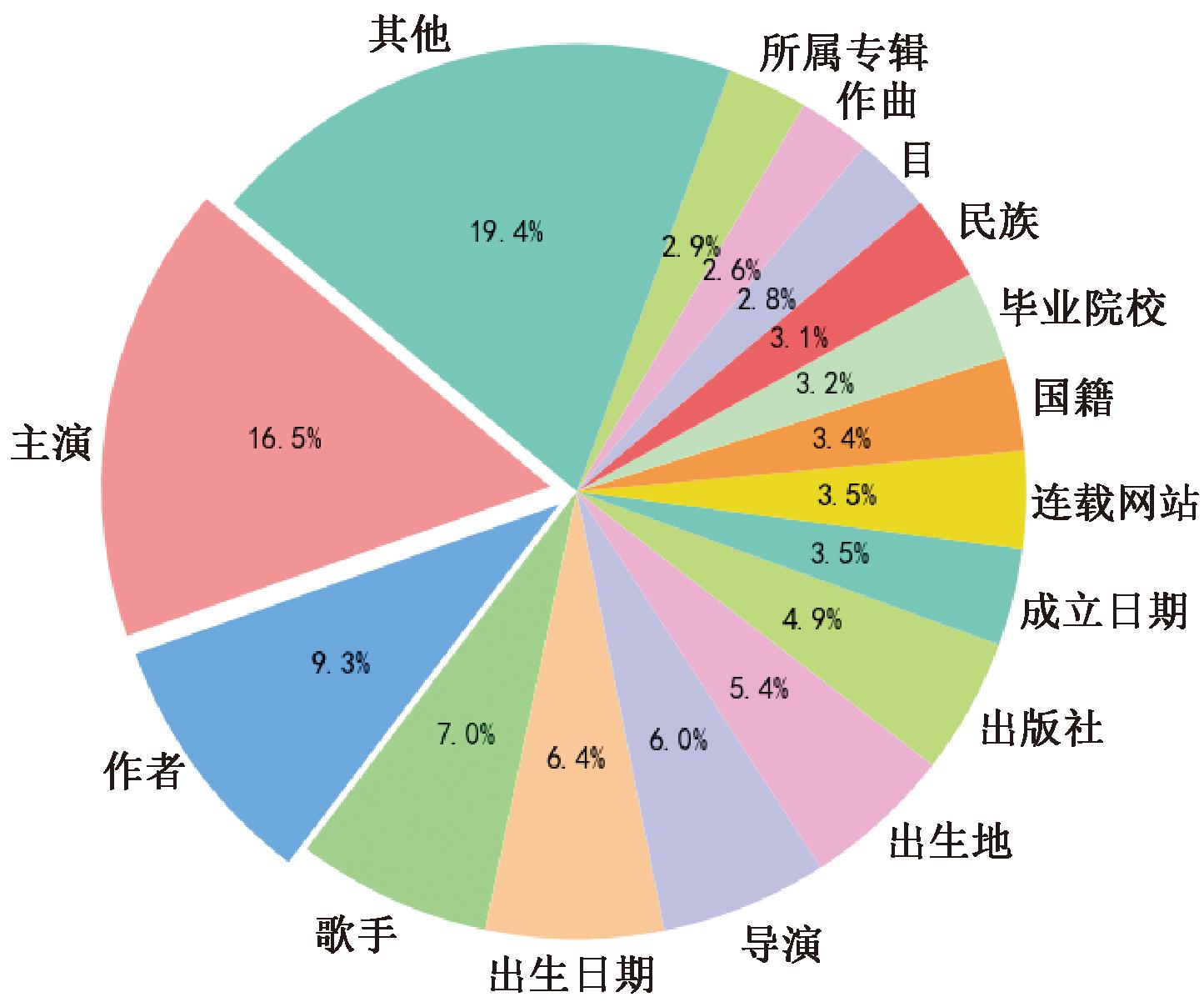

本文使用DuIE数据集[20],该数据集是当前中文信息抽取领域内依据Schema构建的最大规模的公开可用数据集。数据集中包含50种常见关系类型,例如作曲、目和民族等。图7展示了前15种占比最高的关系类型分布情况。

图7 DuIE数据集关系类型分布

Figure 7 Relationship type distribution of DuIE dataset

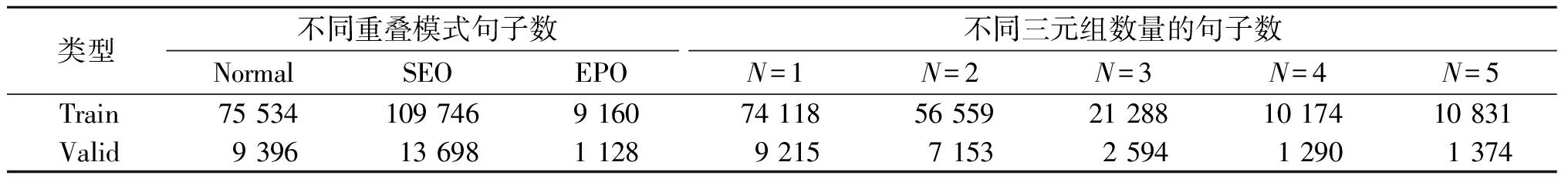

DuIE数据集包括214 590个中文句子和457 886个实例,每个实例包含原始句子(“text”)、主体(“subject”)、主体类型(“subject_type”)、客体(“object”)、客体类型(“object_type”)、关系列表(“spo_list”)及谓词(“predicate”)。统计数据见表2。

表2 DuIE数据集统计信息

Table 2 Statistics of DuIE datasets

类型不同重叠模式句子数不同三元组数量的句子数NormalSEOEPON=1N=2N=3N=4N=5Train75 534109 7469 16074 11856 55921 28810 17410 831Valid9 39613 6981 1289 2157 1532 5941 2901 374

注:Normal表示无重叠;SEO表示单实体重叠;EPO表示实体对重叠;N表示三元组数量。

3.2 数据预处理

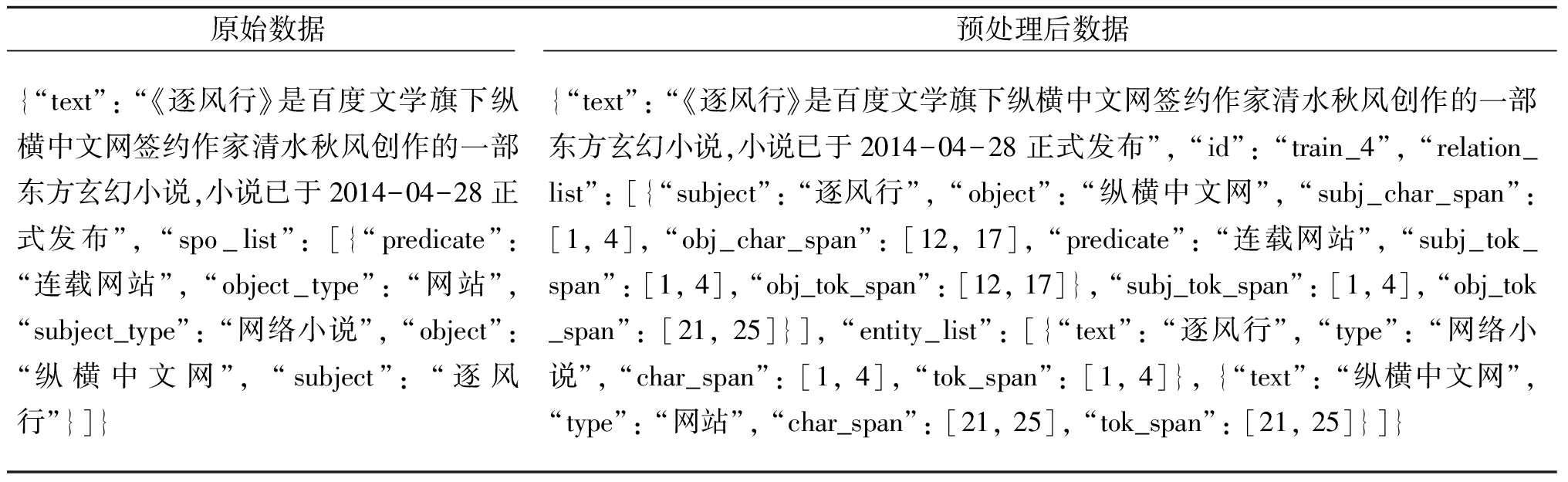

对DuIE数据集进行预处理操作,将原始语料转化为以文本、实体列表和三元组列表形式的数据结构,同时以token-pair形式标注实体的开始和结束位置,DuIE数据示例如表3所示。

表3 DuIE数据预处理示例

Table 3 Data preprocessing example of DuIE

原始数据预处理后数据{“text”: “《逐风行》是百度文学旗下纵横中文网签约作家清水秋风创作的一部东方玄幻小说,小说已于2014-04-28正式发布”, “spo_list”: [{“predicate”: “连载网站”, “object_type”: “网站”, “subject_type”: “网络小说”, “object”: “纵横中文网”, “subject”: “逐风行”}]}{“text”: “《逐风行》是百度文学旗下纵横中文网签约作家清水秋风创作的一部东方玄幻小说,小说已于2014-04-28正式发布”, “id”: “train_4”, “relation_list”: [{“subject”: “逐风行”, “object”: “纵横中文网”, “subj_char_span”: [1, 4], “obj_char_span”: [12, 17], “predicate”: “连载网站”, “subj_tok_span”: [1, 4], “obj_tok_span”: [12, 17]}, “subj_tok_span”: [1, 4], “obj_tok_span”: [21, 25]}], “entity_list”: [{“text”: “逐风行”, “type”: “网络小说”, “char_span”: [1, 4], “tok_span”: [1, 4]}, {“text”: “纵横中文网”, “type”: “网站”, “char_span”: [21, 25], “tok_span”: [21, 25]}]}

3.3 模型评估指标

实验以召回率R、精确率P及F1值作为评价标准,用于评估模型的性能,对应计算公式见式(12)~式(14):

(12)

(13)

(14)

式中:TruePositive为准确识别的五元组数量;ActualPositive为数据集中实际存在的五元组总数;PredictPositive为识别出的五元组总数。

4 实验与结果分析

4.1 实验参数设置

基于数据集DuIE进行实验,并将数据集按8∶2的比例划分为训练集与验证集。所用的RoBERTa-large模型包含24层网络,多头注意力机制中自注意力头数量为16,隐藏层维度为1 024。学习率为2e-5,批处理大小为32,训练的迭代次数为30,模型的优化器选择AdamEMA。整个模型的参数量约为3.55e-8。

4.2 对比实验结果与分析

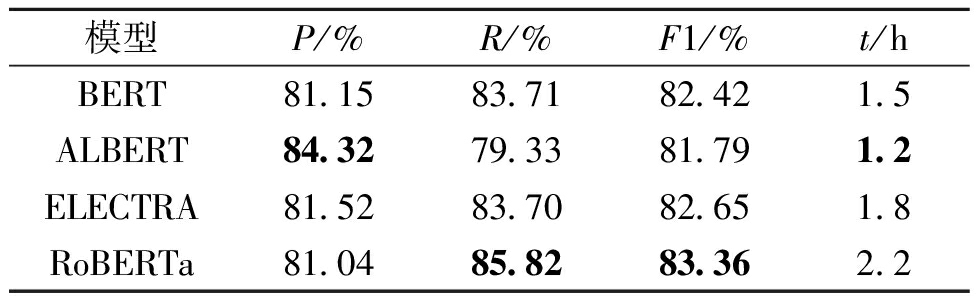

4.2.1 不同编码器的性能分析

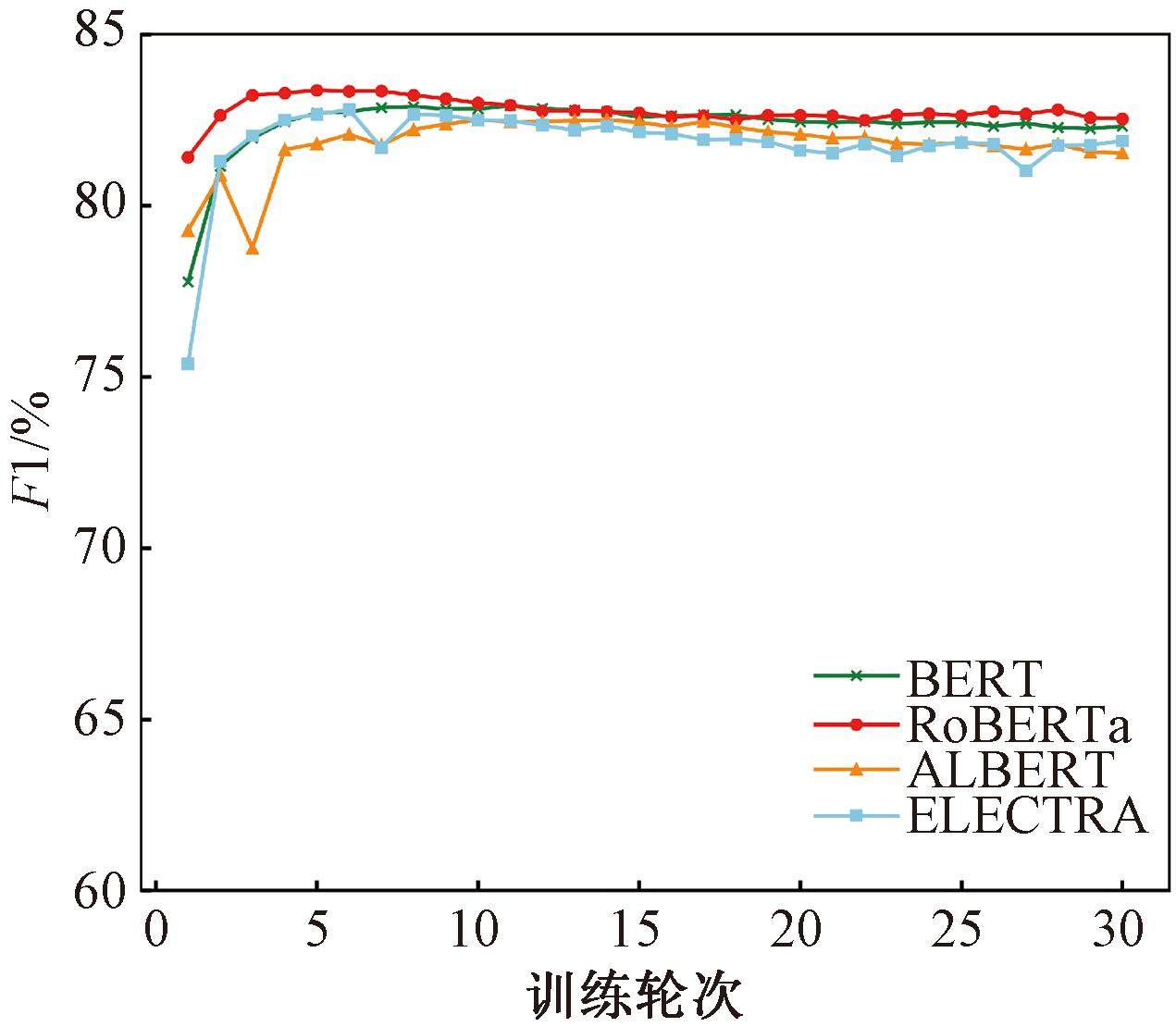

用BERT[13]、RoBERTa[2]、ALBERT[21]和ELECTRA[22]4种预训练语言模型作为编码器时的联合模型性能进行了比较,选择性能最佳的预训练模型作为模型的编码器。实验结果如表4所示。

表4 不同预训练语言模型对比实验

Table 4 Experimental results of the different pre-trained language models

模型P/%R/%F1/%t/hBERT81.1583.7182.421.5ALBERT84.3279.3381.791.2ELECTRA81.5283.7082.651.8RoBERTa81.0485.8283.362.2

注:t表示模型训练时长,下同。

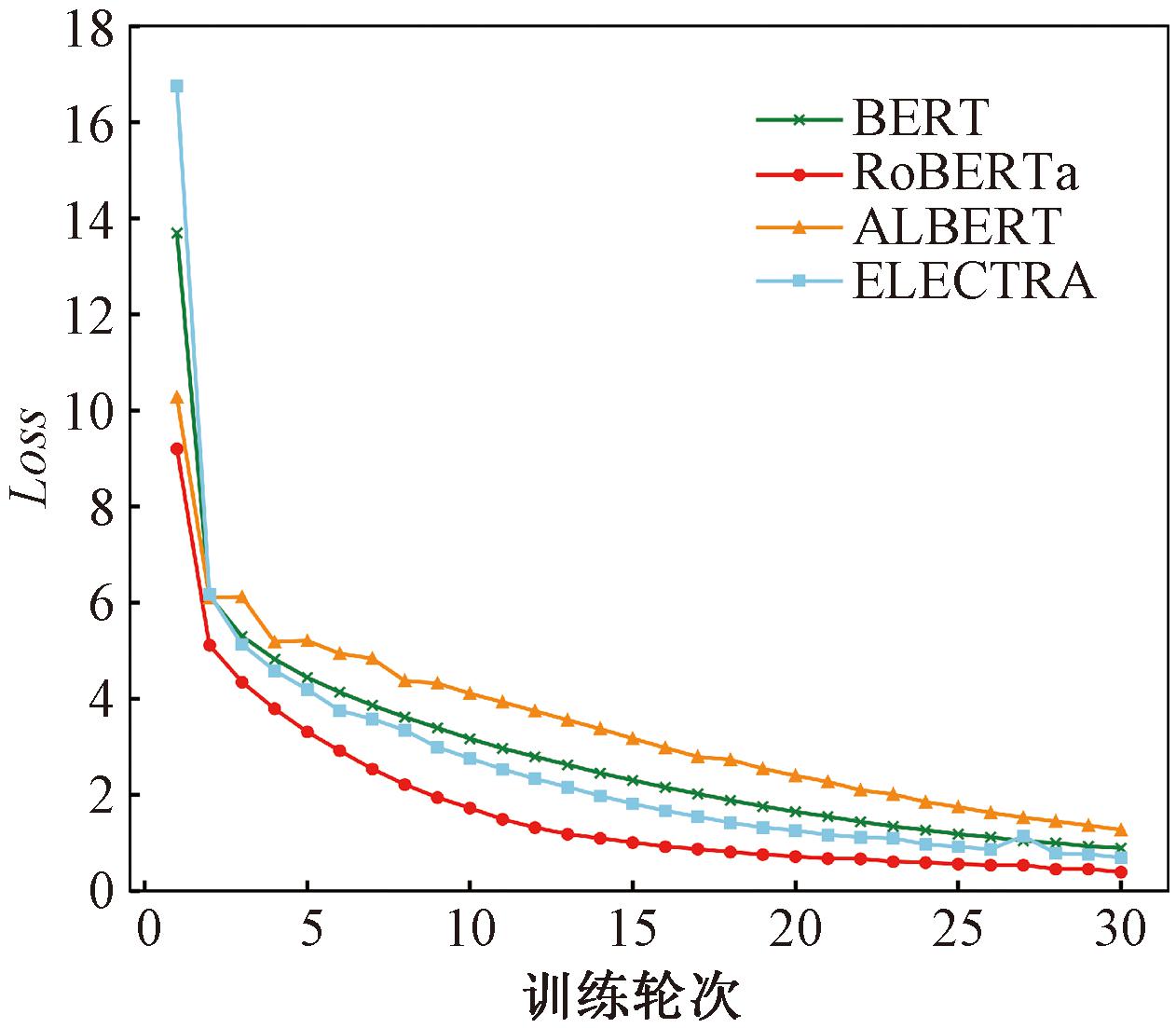

实验结果显示,编码层为RoBERTa时,RoBPtr模型性能表现最佳,F1值为83.36%。ALBERT、ELECTRA和RoBERTa均为在BERT基础上进行优化的衍生版本,故选用BERT作为参照标准来对比这4个模型的性能表现。ALBERT通过显著减少参数数量提高训练效率,但性能也随之下降,F1值较BERT降低了0.63百分点。ELECTRA通过引入RTD(replaced token detection)任务代替BERT原有的MLM(masked language model)机制,从而增强了模型学习到的表示能力,F1值相比BERT提升了0.23百分点。RoBERTa则通过使用更广泛的数据集、增加批处理大小以及更长的输入序列,并结合动态掩码策略来深化对语义信息的理解,从而在上述3种模型中脱颖而出。使用不同预训练模型作为RoBPtr模型嵌入层的性能对比分别如图8与图9所示。

图8 联合抽取模型使用不同语言模型作为编码器在损失曲线的性能对比

Figure 8 Performance comparison of joint extraction model using different LM as encoders in loss curve

图9 联合抽取模型使用不同语言模型作为编码器在F1值曲线的性能对比

Figure 9 Performance comparison of joint extraction model using different LM as encoders inF1 score curve

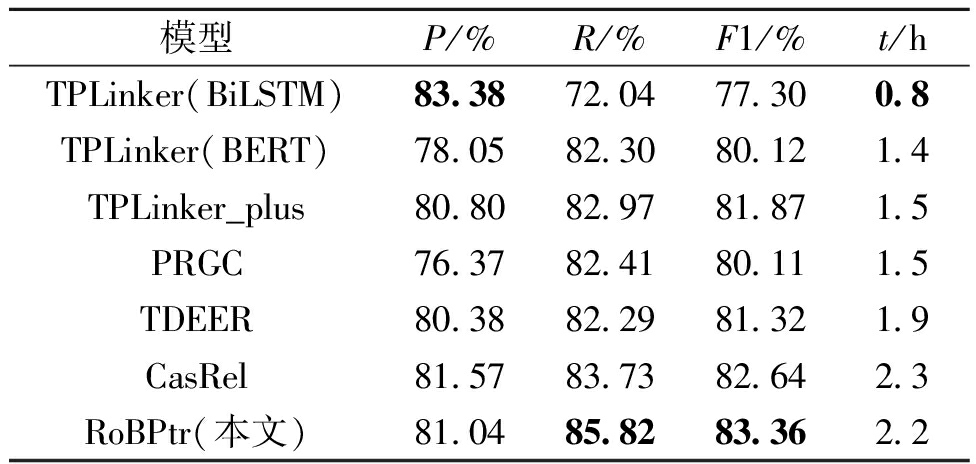

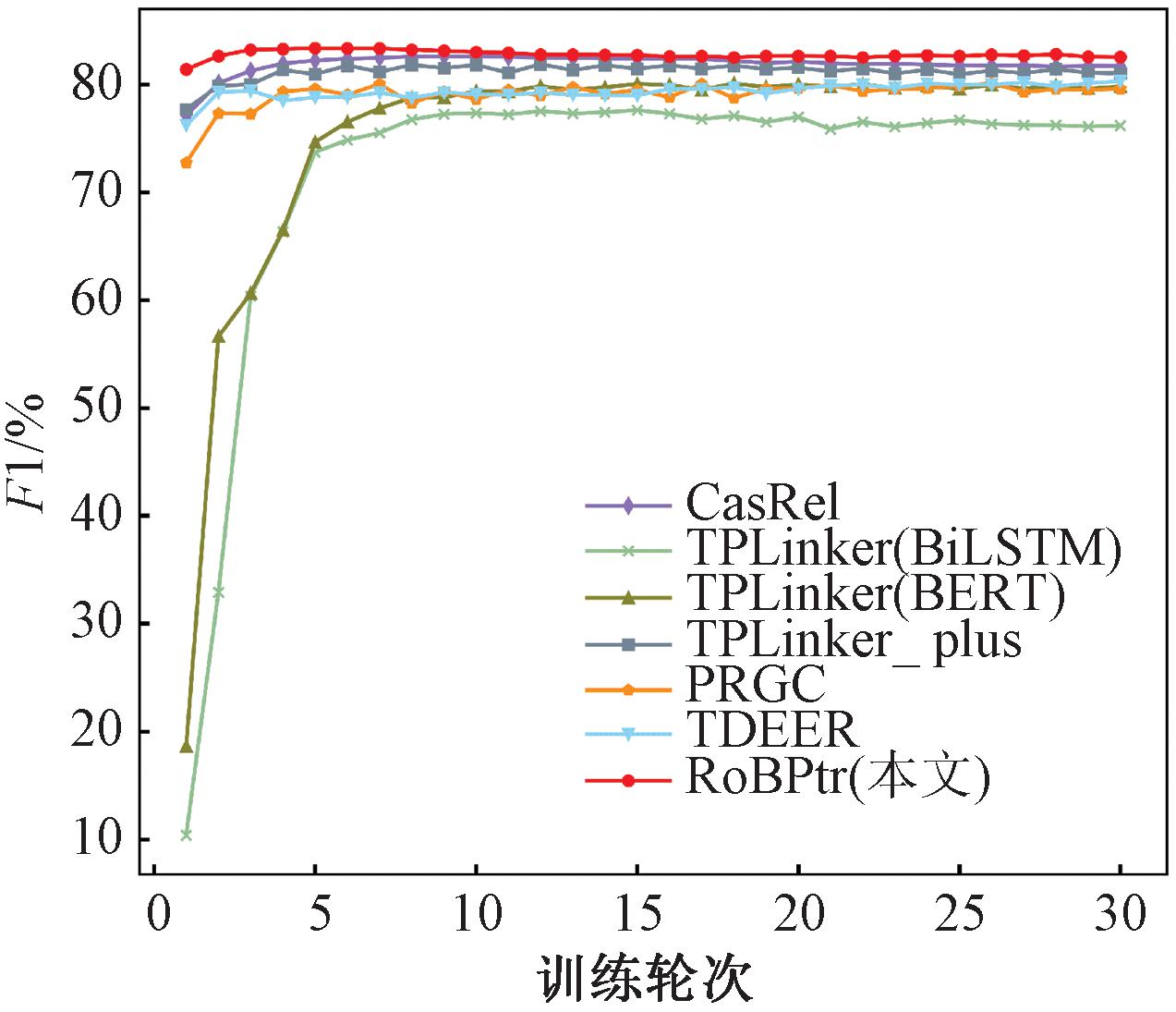

4.2.2 不同模型性能的对比分析

为了评估RoBPtr模型在实体关系联合抽取任务上的性能表现,挑选5个经典模型(TPLinker[8]、TPLinker_plus[8]、PRGC[10]、TDEER[11]和CasRel[7])为基线进行比较,对比实验结果如表5所示。实验结果显示,与所有基线模型相比,RoBPtr模型在DuIE数据集上的表现较佳,其精确率、召回率及F1值分别为81.04%、85.82%和83.36%。在对比的基准模型中,CasRel的F1值达到82.64%,但其两阶段抽取方法在训练过程中容易受到信息错误传播的影响。TDEER模型引入负样本以减少错误累积,但仍未能完全消除阶段间的信息暴露偏差和错误传播问题,模型的精确度、召回率和F1值分别为80.38%、82.29%和81.32%。RoBPtr模型通过联合建模有效解决信息错误传播和暴露偏差等问题,性能表现优于CasRel和TDEER模型。相较于专门为处理复杂句式和三元组重叠问题而设计的TPLinker(BERT)、TPLinker_plus、PRGC及TDEER模型,RoBPtr展现出极具竞争力的性能,相较于上述4个基线模型,RoBPtr模型F1值分别提升了3.24百分点、1.49百分点、3.25百分点和2.04百分点。图10展示了各模型在整个训练过程中F1变化趋势。

表5 不同模型对比实验结果

Table 5 Experimental results of different models

模型P/%R/%F1/%t/hTPLinker(BiLSTM)83.3872.0477.300.8TPLinker(BERT)78.0582.3080.121.4TPLinker_plus80.8082.9781.871.5PRGC76.3782.4180.111.5TDEER80.3882.2981.321.9CasRel81.5783.7382.642.3RoBPtr(本文)81.0485.8283.362.2

图10 不同模型的F1值曲线

Figure 10 F1 values curve of different models

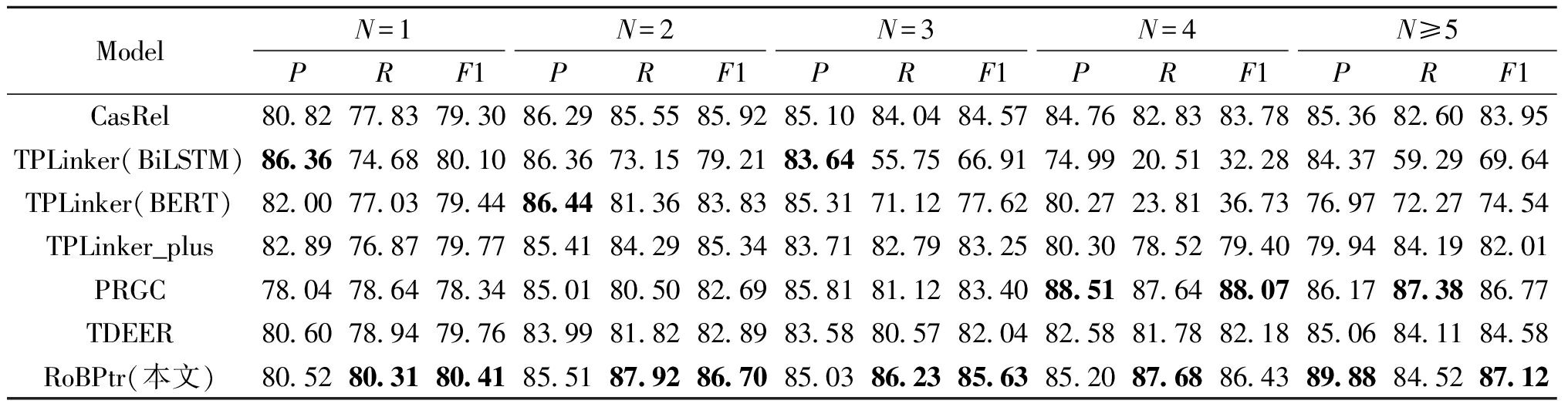

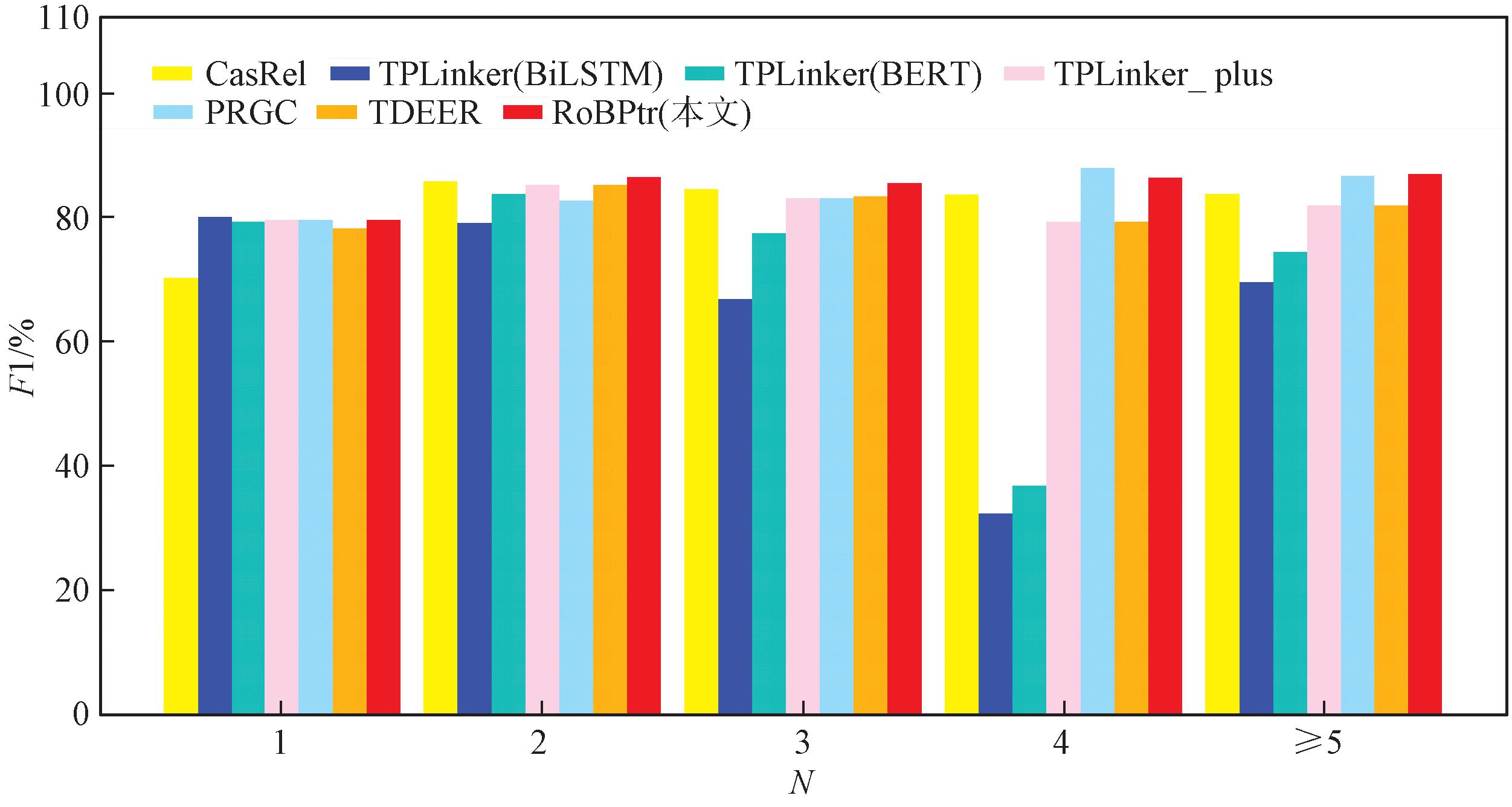

4.2.3 不同复杂度句子下模型性能的比较分析

为评估模型在处理复杂句子方面的性能,对包含不同数量三元组的句子进行实验,以分析模型从不同复杂度句子中抽取三元组的能力。通常,句子中三元组数量越多,其复杂度越高。实验结果如表6所示。实验结果表明,在处理具有不同数量三元组(N=1,2,3,4和N≥5)的语句时,RoBPtr模型的性能超过了所有对比基准模型,F1值分别为80.41%、86.70%、85.63%、86.43和87.12%。针对不同复杂度级别的比较(N=1~5),RoBPtr模型展现了其优越性:当N=1时,与TPLinker(BiLSTM)相比,RoBPtr的F1值提高0.31百分点;对于N=2和N=3的情形,RoBPtr相对于CasRel,F1值分别提高了0.78百分点和1.06百分点;而对于N=4情形,RoBPtr的性能表现略逊于表现最佳的PRGC模型;但当N≥5时,与PRGC模型相比,RoBPtr的F1值提升了0.35百分点。同时,实验结果表明,在文中存在多个三元组时,RoBPtr模型性能表现最优,并随着三元组个数的增加呈上升趋势,具体变化趋势参考图11。由图11可知,RoBPtr模型能有效处理复杂句子,并在复杂场景下的实体与关系联合抽取任务中优于基线模型。

表6 不同模型对包含不同三元组数量的句子的抽取性能

Table 6 Extraction performance of different models for sentences containing different number of triple 单位:%

ModelN=1N=2N=3N=4N≥5PRF1PRF1PRF1PRF1PRF1CasRel80.8277.8379.3086.2985.5585.9285.1084.0484.5784.7682.8383.7885.3682.6083.95TPLinker(BiLSTM)86.3674.6880.1086.3673.1579.2183.6455.7566.9174.9920.5132.2884.3759.2969.64TPLinker(BERT)82.0077.0379.4486.4481.3683.8385.3171.1277.6280.2723.8136.7376.9772.2774.54TPLinker_plus82.8976.8779.7785.4184.2985.3483.7182.7983.2580.3078.5279.4079.9484.1982.01PRGC78.0478.6478.3485.0180.5082.6985.8181.1283.4088.5187.6488.0786.1787.3886.77TDEER80.6078.9479.7683.9981.8282.8983.5880.5782.0482.5881.7882.1885.0684.1184.58RoBPtr(本文)80.5280.3180.4185.5187.9286.7085.0386.2385.6385.2087.6886.4389.8884.5287.12

图11 包含不同三元组数的句子的F1值对比

Figure 11 Comparison of F1 values for sentences containing different number of triple

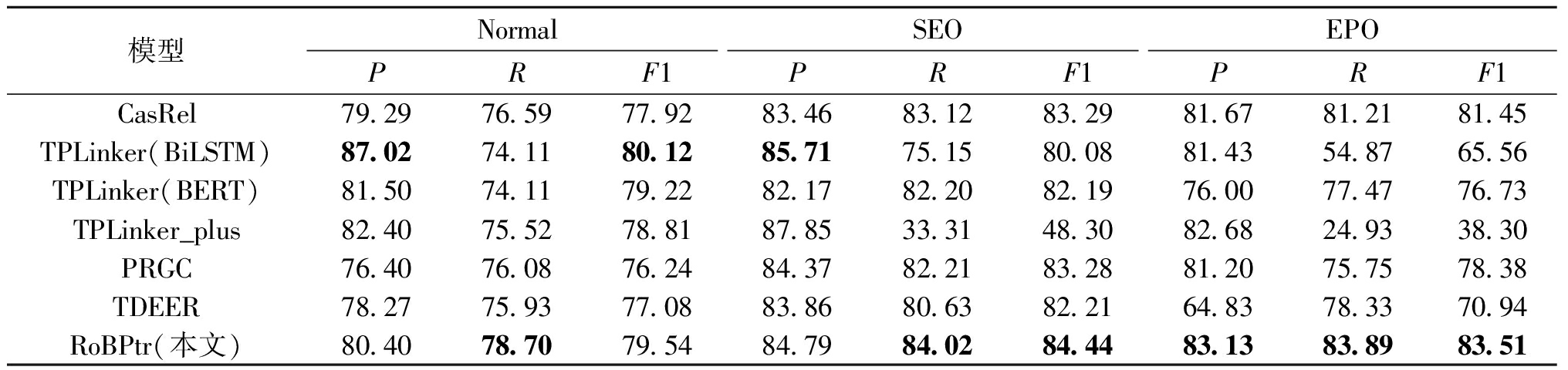

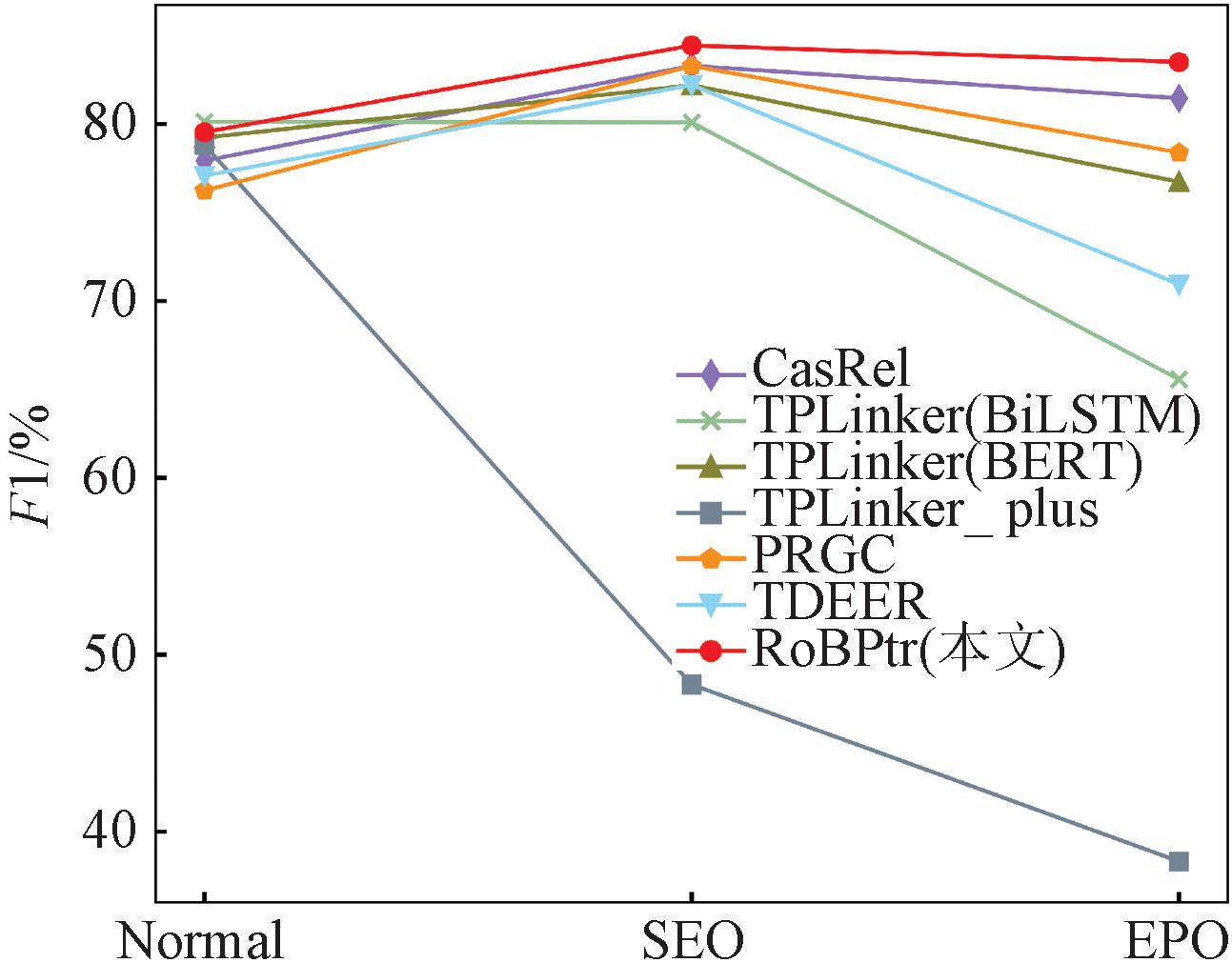

4.2.4 不同重叠模式下模型性能的比较分析

为评估模型在不同重叠模式下的性能,对包含不同重叠模式的句子展开实验,分析模型在不同模式下的性能表现。实验结果如表7所示,不同重叠模式下三元组抽取的F1如图12所示。表7的实验结果表明,在SEO和EPO模式下,RoBPtr模型的性能均优于其他基线模型,精确率分别为84.79%和83.13%,召回率分别为84.02%和83.89%,F1值分别为84.44%和83.51%。由图12可以看出,RoBPtr模型在处理包含重叠三元组的句子时,F1值相比所有基线模型都有显著提高,证明RoBPtr模型在实体关系联合抽取任务中,能够高效地识别并正确处理包含重叠现象的三元组。

表7 不同重叠模式的三元组抽取性能

Table 7 Performance of triple extraction with different overlap patterns 单位:%

模型NormalSEOEPOPRF1PRF1PRF1CasRel79.2976.5977.9283.4683.1283.2981.6781.2181.45TPLinker(BiLSTM)87.0274.1180.1285.7175.1580.0881.4354.8765.56TPLinker(BERT)81.5074.1179.2282.1782.2082.1976.0077.4776.73TPLinker_plus82.4075.5278.8187.8533.3148.3082.6824.9338.30PRGC76.4076.0876.2484.3782.2183.2881.2075.7578.38TDEER78.2775.9377.0883.8680.6382.2164.8378.3370.94RoBPtr(本文)80.4078.7079.5484.7984.0284.4483.1383.8983.51

注:Normal表示无重叠;SEO表示单实体重叠;EPO表示实体对重叠。

图12 不同重叠模式下三元组抽取的F1值

Figure 12 F1 values for triple extraction in different overlap patterns

5 结论

本文针对中文实体与关系联合抽取任务中存在的三元组重叠问题,提出一种基于RoBERTa和指针网络的中文实体与关系联合抽取方法。首先,利用预训练语言模型RoBERTa作为嵌入层,以获取充分考虑上下文语义和位置信息的字符嵌入;其次,使用基于多层指针网络的实体识别模块,将实体识别任务建模为token-pair识别问题,通过识别实体的开始和结束位置来解析出所有可能的实体;最后,使用基于指针网络和多头注意力机制的关系抽取模块,把三元组(s, r, o)抽取任务建模为五元组(sh, st, r, oh, ot)识别问题。借助多头注意力机制为每个实体对的不同关系分配独立的概率子空间,实现对同一实体对多个关系的不互斥抽取。在DuIE数据集上,与所有基线模型相比,RoBPtr模型的性能较佳,其精确率、召回率和F1值分别达到81.04%、85.82%和83.36%。此外,本文还针对重叠模式(SEO、EPO)和不同复杂度的句子展开实验。实验结果显示,与基线模型相比,RoBPtr模型在处理不同重叠模式和高复杂度的句子时,性能表现出色,进一步证明RoBPtr模型能够有效应对复杂场景和重叠模式下的实体与关系联合抽取任务。

[1] 陈宏, 陈新财, 巩晓赟, 等. 基于知识图谱的风电机组诊断系统构建与应用[J]. 郑州大学学报(工学版), 2023, 44(6): 54-60, 98.CHEN H, CHEN X C, GONG X B, et al. Construction and application of wind turbine diagnosis system based on knowledge graph[J]. Journal of Zhengzhou University (Engineering Science), 2023, 44(6): 54-60, 98.

[2] LIU Y H, OTT M, GOYAL N, et al. RoBERTa: a robustly optimized BERT pretraining approach [EB/OL].(2019-07-26)[2025-07-08]. https:∥doi.org/10.48550/arXiv.1907.11692.

[3] ZELENKO D, AONE C, RICHARDELLA A. Kernel methods for relation extraction[C]∥Proceedings of the ACL-02 Conference on Empirical Methods in Natural Language Processing.Stroudsburg:ACL,2002:71-78.

[4] YU X F, LAM W. Jointly identifying entities and extracting relations in encyclopedia text via a graphical model approach[C]∥Proceedings of the 23rd International Conference on Computational Linguistics. Stroudsburg:ACL,2010: 1399-1407.

[5] LI Q, JI H. Incremental joint extraction of entity mentions and relations[C]∥Proceedings of the 52nd Annual Meeting of the Association for Computational Linguistics (Volume 1: Long Papers). Stroudsburg:ACL, 2014: 402-412.

[6] MIWA M, SASAKI Y. Modeling joint entity and relation extraction with table representation[C]∥Proceedings of the 2014 Conference on Empirical Methods in Natural Language Processing. Stroudsburg:ACL, 2014: 1858-1869.

[7] WEI Z P, SU J L, WANG Y, et al. A novel cascade binary tagging framework for relational triple extraction[EB/OL]. (2019-09-07)[2025-07-08].https:∥doi.org/10.48550/arXiv.1909.03227.

[8] WANG Y C, YU B W, ZHANG Y Y, et al. TPLinker: single-stage joint extraction of entities and relations through token pair linking[EB/OL]. (2020-10-26)[2025-07-08].https:∥doi.org/10.48550/arXiv.2010.13415.

[9] YAN Z H, ZHANG C, FU J L, et al. A partition filter network for joint entity and relation extraction[C]∥Proceedings of the 2021 Conference on Empirical Methods in Natural Language Processing. Stroudsburg:ACL,2021,185-197.

[10] ZHENG H Y, WEN R, CHEN X, et al. PRGC: potential relation and global correspondence based joint relational triple extraction[EB/OL]. (2021-06-18)[2025-07-08].https:∥doi.org/10.48550/arXiv.2106.09895.

[11] LI X M, LUO X T, DONG C H, et al. TDEER: an efficient translating decoding schema for joint extraction of entities and relations[C]∥Proceedings of the 2021 Conference on Empirical Methods in Natural Language Processing. Stroudsburg: ACL, 2021: 8055-8064.

[12] SUI D B, ZENG X R, CHEN Y B, et al. Joint entity and relation extraction with set prediction networks[J]. IEEE Transactions on Neural Networks and Learning Systems, 2024, 35(9): 12784-12795.

[13] DEVLIN J, CHANG M W, LEE K, et al. BERT: pre-training of deep bidirectional transformers for language understanding[EB/OL]. (2018-10-11)[2025-07-08].https:∥doi.org/10.48550/arXiv.1810.04805.

[14] GAO C, ZHANG X, LI L Y, et al. ERGM: a multi-stage joint entity and relation extraction with global entity match[J]. Knowledge-Based Systems, 2023, 271: 110550.

[15] LI R, LA K J, LEI J S, et al. Joint extraction model of entity relations based on decomposition strategy[J]. Scientific Reports, 2024, 14(1): 1786.

[16] 宋玲, 韦紫君, 陈燕, 等. 基于RoBERTa和指针网络的中文实体与关系联合抽取方法及系统: CN116663539A[P]. 2023-08-29.SONG L,WEI Z J,CHEN Y,et al. Joint extraction me-thod and system of Chinese entities and relations based on RoBERTa and pointer network:CN116663539A[P].2023-08-29.

[17] CUI Y M, CHE W X, LIU T, et al. Pre-training with whole word masking for Chinese BERT[J]. IEEE/ACM Transactions on Audio, Speech, and Language Processing, 2021, 29: 3504-3514.

[18] VINYALS O, FORTUNATO M, JAITLY N. Pointer networks[EB/OL]. (2015-06-09)[2025-07-08].https:∥doi.org/10.48550/arXiv.1506.03134.

[19] 张强, 曾俊玮, 陈锐. 基于对比学习与梯度惩罚的实体关系联合抽取模型[J]. 吉林大学学报(理学版), 2024, 62(5): 1155-1162.ZHANG Q, ZENG J W, CHEN R. Entity-relation joint extraction model based on contrastive learning and gradient penalty[J]. Journal of Jilin University (Science Edition), 2024, 62(5): 1155-1162.

[20] LI S J, HE W, SHI Y B, et al. DuIE: a large-scale Chinese dataset for information extraction[C]∥Natural Language Processing and Chinese Computing Natural Language Processing and Chinese Computing: 8th CCF International Conference. Cham: Springer, 2019: 791-800.

[21] LAN Z Z, CHEN M D, GOODMAN S, et al. ALBERT: a lite BERT for self-supervised learning of language representations[EB/OL]. (2019-09-26)[2025-07-08].https:∥doi.org/10.48550/arXiv.1909.11942.

[22] CLARK K, LUONG M T, LE Q V, et al. ELECTRA: pre-training text encoders as discriminators rather than generators[EB/OL]. (2020-03-23)[2025-07-08].https:∥doi.org/10.48550/arXiv.2003.10555.