多普勒天气雷达在短时降水预报中扮演着重要的角色,提高雷达回波外推精度对强对流天气预警和经济稳定发展具有重要意义[1]。传统的雷达回波外推方法[2-4]大多是基于线性的方法,忽略了中小尺度天气系统中雷达回波的非线性运动特征,存在局限性。近年来,深度学习和气象学之间的结合日益紧密,可以从海量数据中揭示潜在的复杂关系,对雷达回波的时空动态变化进行高效建模。

循环神经网络(recurrent neural network,RNN)是一种通过引入时间概念来处理序列数据的神经网络,能够在雷达序列外推中发挥重要的作用。卷积长短期记忆网络(convolutional long short-term memory,ConvLSTM)[5]的提出极大地推动了RNN在雷达回波外推领域的应用,其通过结合卷积神经网络(convolutional neural networks,CNN)和RNN的特性,能够捕捉到雷达数据中的内在规律和模式。Wang等[6-7]先后推出预测循环神经网络(predictive recurrent neural network,PredRNN)和预测循环神经网络改进模型(predictive recurrent neural network plus plus,PredRNN++),引入更高效的时空记忆单元来捕捉时空信息,但随着预报时间的延长,捕捉动态变化的能力逐渐降低。方巍等[8]在ConvLSTM的基础上提出了时空融合网络,将瞬态变化与运动趋势同时融合。

尽管目前很多基于RNN的雷达回波外推模型被提出,但其串行处理方式限制了计算效率,导致预测结果的不稳定性和误差累积[9]。随后,研究者们将经典卷积网络模型U-Net[10]引入雷达回波外推领域观察它的适用性,取得了不错的效果[11]。Trebing等[12]在UNet的编码器和解码器中嵌入注意力机制,提出了SmaAt-UNet,具有更高的运算效率和更低的资源需求。Gao等[13]提出了SimVP模型,它完全建立在CNN的基础上,以较低的计算成本在雷达回波外推领域取得了出色的效果,但CNN主要关注于图像的空间特征提取,缺乏处理时间序列数据的天然机制,无法充分建立雷达序列的时间依赖关系模型[14]。随着Transformer[15]在自然语言处理领域的出现,其提取长序列信息的潜力促使众多研究者将其应用于雷达回波外推。方巍等[16]将Swin Transformer模型[17]和UNet模型相结合来更好地应对雷达回波的非线性变化,提高预测结果的鲁棒性。Bi等[18]设计出了盘古气象大模型,其主要思想就是使用ViT(vision transformer)[19]的3D变体来处理各种复杂的气象要素,在ERA5再分析数据的中长期气象预报上首次超过了传统数值方法。基于Transformer的雷达回波外推模型领域虽然序列处理能力强,但也面临计算成本高和空间建模能力不足的问题。

为了克服现有深度学习雷达回波外推模型在时空特征提取上的局限性,本文提出了一种融合时空重构单元(spatiotemporal reconstruction unit,SRU)和Transformer的外推模型SRU-Former,该模型融合CNN和Transformer的特性,充分发挥CNN在雷达图像特征提取和局部细节感知方面的优势,以及Transformer在捕捉长时雷达回波序列依赖关系的能力。本文应用SRU-Former网络模型在江苏省气象雷达数据集和上海市气象雷达数据集上与现有主流深度学习模型进行了实验对比,实验证明,SRU-Former在多个评价指标上都能够取得很好的效果。

1 SRU-Former模型

1.1 整体网络架构

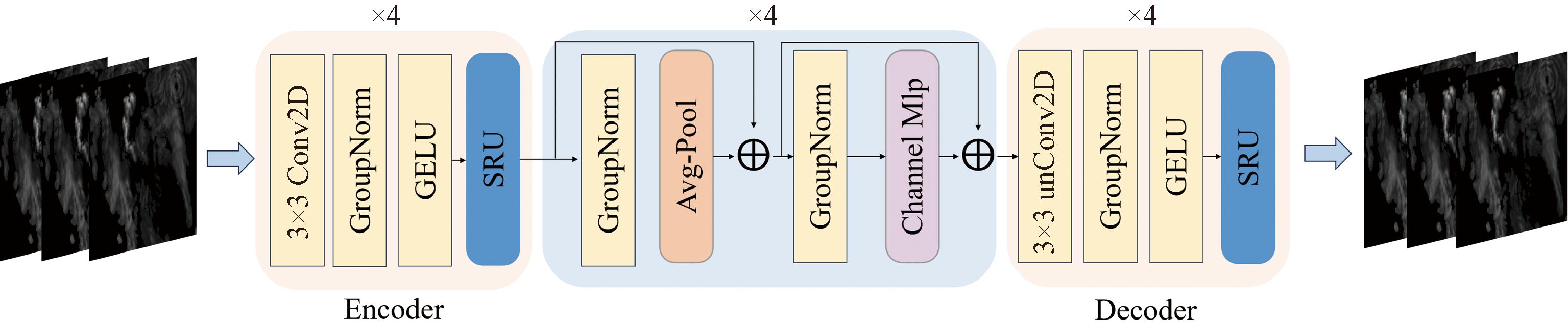

本文提出的SRU-Former网络模型是一种编码器和解码器架构,编码器堆叠了4个模块,每个模块包括1个卷积核大小为3×3的卷积层、1个组归一化层、GELU激活函数和1个SRU。解码器同样也堆叠了4个模块,每个模块包括1个卷积核大小为3×3的转置卷积层、1个组归一化层、GELU激活函数和1个时空重构单元SRU。其中编码器和解码器的4个卷积层步长序列均为[2,1,2,1],即分别包括2个下采样层和2个上采样层。SRU用来加强模型对雷达图的时空特征提取能力。此外,在编码器和解码器之间,本文融合了Transformer的变体架构模型Poolformer[20]来捕捉雷达回波序列的时间依赖关系和动态变化信息,将Poolformer模块的个数设为4。考虑到雷达图具有较高的分辨率,本文通过Patch操作将雷达图划分为若干个小块作为模型的输入单元,Patch操作可以使得模型捕捉到更多的图像细节和局部变化,并且能够降低计算复杂度。图1为SRU-Former的网络模型结构图。

图1 SRU-Former网络模型结构图

Figure 1 Structure diagram of SRU-Former network model

1.2 时空重构单元SRU

雷达数据中存在着大量的非平稳信息,例如云层的堆积、变形和消散等,这就使得雷达回波序列的时空特征提取变得尤为困难。近年来,研究者们通常在模型中嵌入注意力机制[21]来自适应地关注较关键的雷达回波区域,但是注意力机制的效果在很大程度上依赖雷达数据的质量,且往往需要大量的计算资源来训练和优化模型。本文受SCConv模块[22]的启发,设计并提出了SRU,能够很好地改善这个问题,在增强时空特征提取能力的同时,可以更高效地处理雷达数据。

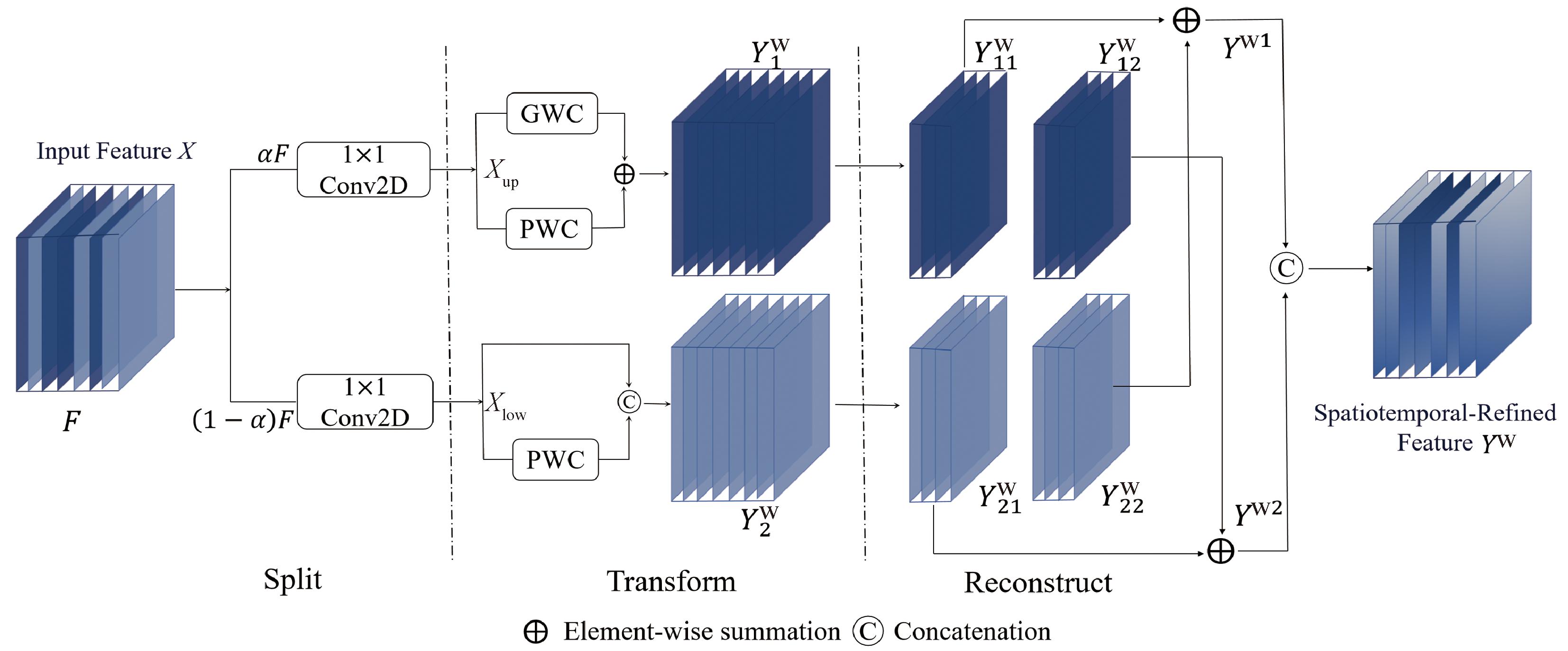

特征提取时的信息冗余在很大程度上是导致雷达回波外推精度不高的重要因素。SRU采用分离、变换和重构的策略来减少时空信息冗余并促进特征学习,图2为SRU模块结构。SRU-Former模型的输入形状是五维张量B×T×C×H×W,其中B为批次大小,T为序列长度,C为通道数,H和W分别为输入图像的高和宽。本文将输入张量重新塑造成形状为B×(T×C)×H×W的四维张量,将时间和通道维度进行了合并,把这个新的维度叫作F,SRU的输入特征X维度为B×F×H×W。首先将X的F通道按照比例因子α拆分为两部分α×F和(1-α)×F,本文将α设为0.5。随后对这两部分分别进行1×1卷积,来压缩通道数从而降低计算复杂度。经过分离操作,得到上半部分特征Xup和下半部分特征Xlow,用分组卷积GWC和逐点卷积PWC分别对Xup进行特征提取,并将结果直接相加得到![]() 而对Xlow则是直接用PWC进行特征提取,将其结果与Xlow在F维度上进行拼接得到

而对Xlow则是直接用PWC进行特征提取,将其结果与Xlow在F维度上进行拼接得到![]() 相比于

相比于![]() 特征信息要较丰富些,上述操作如式(1)和式(2)所示。GWC和PWC是深度学习中两种不同的卷积方式,相比于标准卷积而言,可以更好地捕捉输入数据的特征。GWC将输入特征图按照F维度分为若干个组,每个组内分别进行独立的卷积操作,PWC就是1×1卷积,主要用来减少特征图维度。

特征信息要较丰富些,上述操作如式(1)和式(2)所示。GWC和PWC是深度学习中两种不同的卷积方式,相比于标准卷积而言,可以更好地捕捉输入数据的特征。GWC将输入特征图按照F维度分为若干个组,每个组内分别进行独立的卷积操作,PWC就是1×1卷积,主要用来减少特征图维度。

(1)

(2)

图2 SRU模块结构

Figure 2 SRU module structure

式中:MG为PWC卷积操作,本文将分组数设为2;MP1和MP2两个1×1卷积分别应用在上半部分特征Xup和下半部分特征Xlow上,输入F维度数受分离操作中的比例因子α影响,由于α设置为0.5,MP1和MP2完全相同;![]() 和

和![]() 为得到的上下部分新的特征;+和∪分别为变量求和与F维度叠加操作。

为得到的上下部分新的特征;+和∪分别为变量求和与F维度叠加操作。

为了进一步减少时空特征冗余,本文并没有将特征信息较丰富的![]() 和特征信息较少的

和特征信息较少的![]() 直接相加,而是采取交叉重构的操作,充分地融合这两部分特征,如式(3)~(5)所示:

直接相加,而是采取交叉重构的操作,充分地融合这两部分特征,如式(3)~(5)所示:

(3)

(4)

Yw1∪Yw2=Yw。

(5)

具体而言,![]() 和

和![]() 在F维度上平均分割分别得到特征

在F维度上平均分割分别得到特征![]() 和

和![]() 和

和![]() 交叉地将

交叉地将![]() 与

与![]() 相加得到

相加得到![]() 与

与![]() 相加得到Yw2,最后将Yw1和Yw2在F维度上进行拼接得到时空精细化特征Yw。

相加得到Yw2,最后将Yw1和Yw2在F维度上进行拼接得到时空精细化特征Yw。

1.3 Poolformer模块

雷达回波数据动态且复杂,RNN虽能处理序列数据,但易梯度消失,而Transformer架构灵活,更适合时间序列处理。因此,本文在SRU-Former网络模型的编码器和解码器之间融合Transformer的变体模型Poolformer[20],帮助建立信息更加完整的长距离依赖关系。Poolformer的提出证明了Transformer的成功主要归因于其通用架构,而非特定于自注意力机制的Token Mixer模块。在Token Mixer模块的选取上,自注意力机制和多层感知机都能够取得很好的效果。

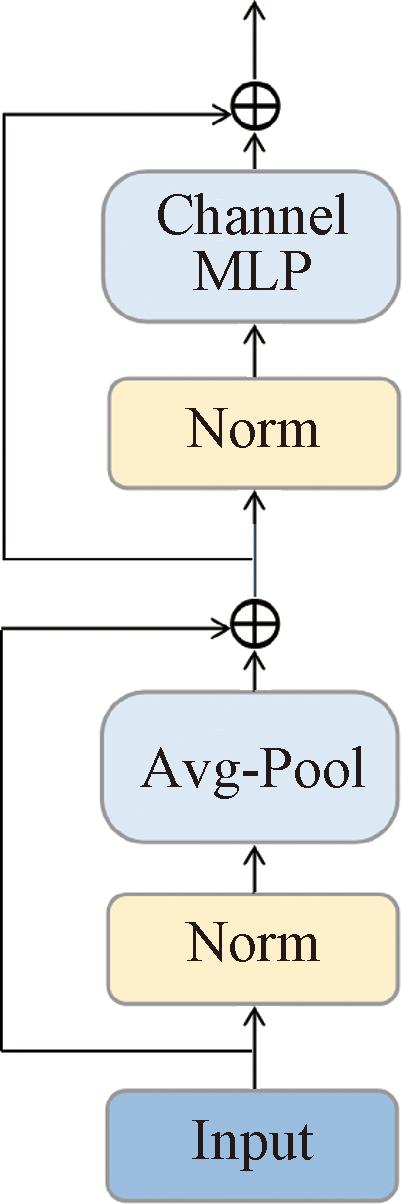

图3为Poolformer模型结构。如图3所示,Poolformer直接使用全局平均池化作为Token Mixer模块,更加高效地整合雷达图的时空信息。相较于自注意力机制用庞大的参数去存储和计算注意力权重,池化层不需要学习额外的参数,极大地减少了计算成本,提升了模型的鲁棒性和灵活性。具体流程如式(6)和式(7)所示:

Y=TokenMixer(Norm(X))+X;

(6)

Z=MLP(Norm(Y))+Y。

(7)

图3 Poolformer模型结构

Figure 3 Poolformer model structure

式中:TokenMixer为对输入特征全局平均池化操作的结果再减去输入特征,这样有助于原始特征和池化特征的信息交互;Norm为组归一化操作;MLP为多层感知机,由两个全连接层和GELU激活函数构成;+为变量求和操作;X为输入特征,Y为经过第一个残差模块后输出的特征;Z为经过Poolformer整个模块后输出的特征;输入和输出张量形状保持为B×F×H×W不变。本文共堆叠4个Poolformer模块,有效地增强了模型在F维度(时空维度)上的特征表示能力。

将Poolformer的输出张量输入到解码器中,并将得到的输出张量重新塑造成形状为B×T×C×H×W的五维张量,保持模型初始输入和最终输出结果大小不变。

2 实验结果与分析

2.1 实验数据集

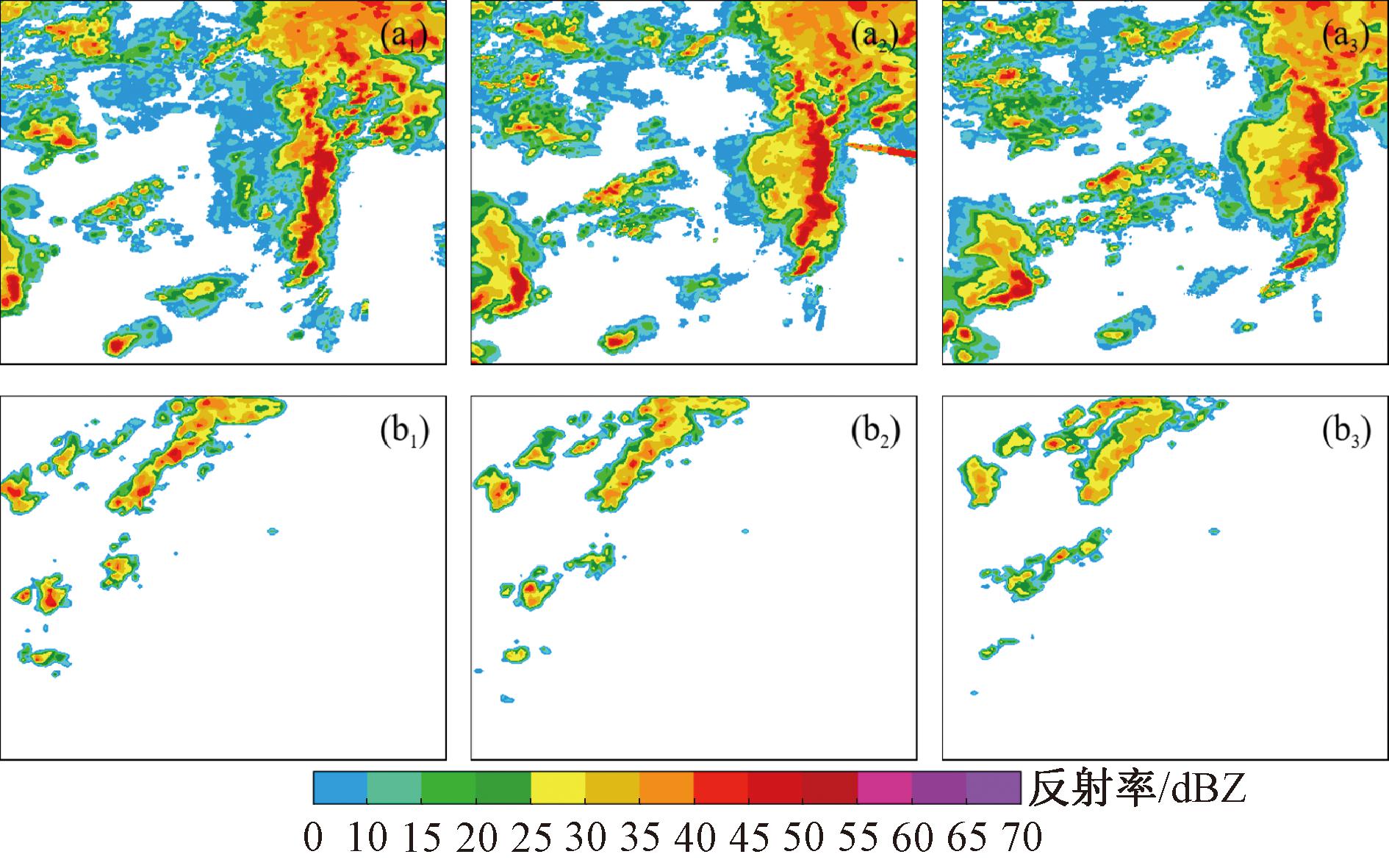

研究所使用的江苏省雷达回波数据集(见图4(a1~a3))来源于江苏省气象台,共包含31 892个样本,265个降水过程,每个样本是以PNG格式存储的灰度图。覆盖时间为2019—2021 年4—9月份,覆盖空间范围为116°18′E—121°57′E,30°45′N—35°20′N。数据样本的时间间隔为6 min,图像分辨率为480×560。使用步长为3的样本,长度为30的滑动窗口生成10 000个不重叠的雷达回波序列,能够降低样本重复率。顺序选取9 000个序列作为训练集,剩余1 000个序列作为测试集,10帧长度用于输入,20帧长度用于预测。

图4 江苏省和上海市多普勒雷达反射率拼图示意

Figure 4 Example of the reflectivity mosaic of doppler radar in Jiangsu Province and Shanghai City

上海市雷达回波数据集(见图4(b1~b3))由上海市气象台制作。资料共包含40 000个样本序列,243个降水过程,每个样本是以PNG格式存储的灰度图。覆盖时间为2017—2020 年6—9月份,覆盖空间范围为120°51′E—122°12′E,30°40′N—31°53′N,图像分辨率为460×460。顺序选取32 000个序列作为训练集,剩余8 000个序列作为测试集,10帧长度用于输入,时间间隔为6 min,后10帧用于预测,时间间隔为12 min。

2.2 实验环境和训练策略

本研究使用PyTorch开源神经网络框架,所用服务器搭载Linux操作系统,运行内存为125 G,显卡为GeForce RTX 4090 GPU。在模型训练过程中,本文将Batch Size设为16,Patch Size设为4,即将原始图像分割为若干个大小为4×4的小块。使用Adam优化器,采用余弦退火策略[23]将学习率从10-3降低到10-4,总共训练200个轮次。损失函数为均方误差MSE,如式(8)所示:

(8)

式中:yn,h,w为雷达回波图像的预测值;xn,h,w为真实观测值;N为外推序列长度;H和W分别为图像的高和宽。

2.3 评价指标

实验采用气象业务中常用的临界成功指数CSI、空报率FAR和命中率POD作为评估标准,如式(9)~(11)所示。雷达回波图中的反射率值表示单位体积内降水粒子的后向散射截面之和,根据反射率值的大小可以间接推断出降水粒子的密度、大小和分布情况。一般来说,当反射率值超过15 dBZ时,就可以认为与降水有关。因此。在本文中,计算阈值为15 dBZ下的CSI、FAR和POD。在此之前要把模型预测的像素值转换成基本反射率,根据指定阈值将真实观测值和预测值分别进行0-1二值化处理。

(9)

(10)

(11)

式中:nhits、nmisses和nfalsealarms分别表示命中点、漏报点和空报点的数量。CSI和POD越高、FAR越低,外推算法效果越好。此外,本文还采用结构相似性SSIM作为评价指标,如式(12)所示。SSIM可以衡量预测雷达图像与标签雷达图像的相似程度。

(12)

式中:x和y表示真实观测值和预测值;μx和μy分别为x和y的平均值;![]() 和

和![]() 分别为x和y的方差;σxy为x和y的协方差;c1和c2为两个维持除式稳定的常数。

分别为x和y的方差;σxy为x和y的协方差;c1和c2为两个维持除式稳定的常数。

2.4 实验结果分析

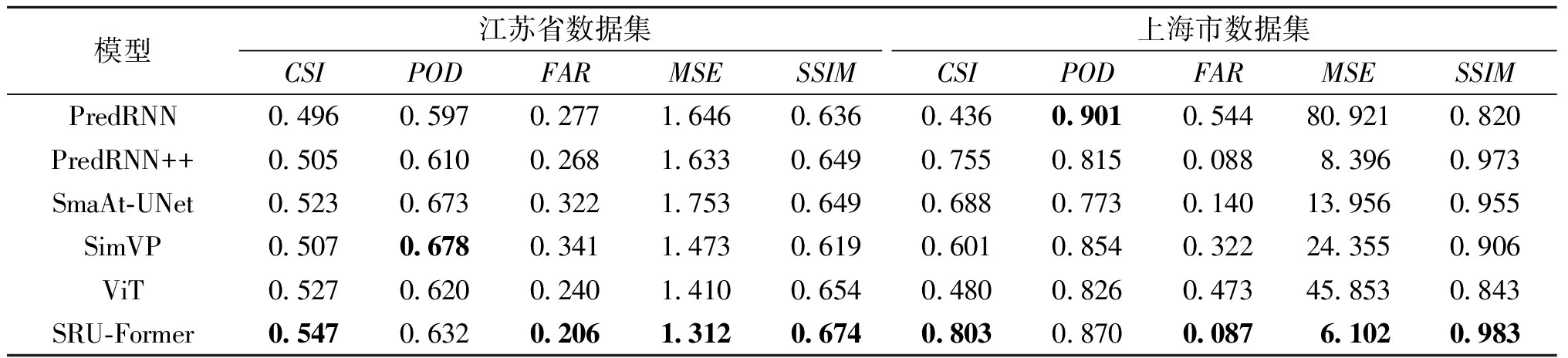

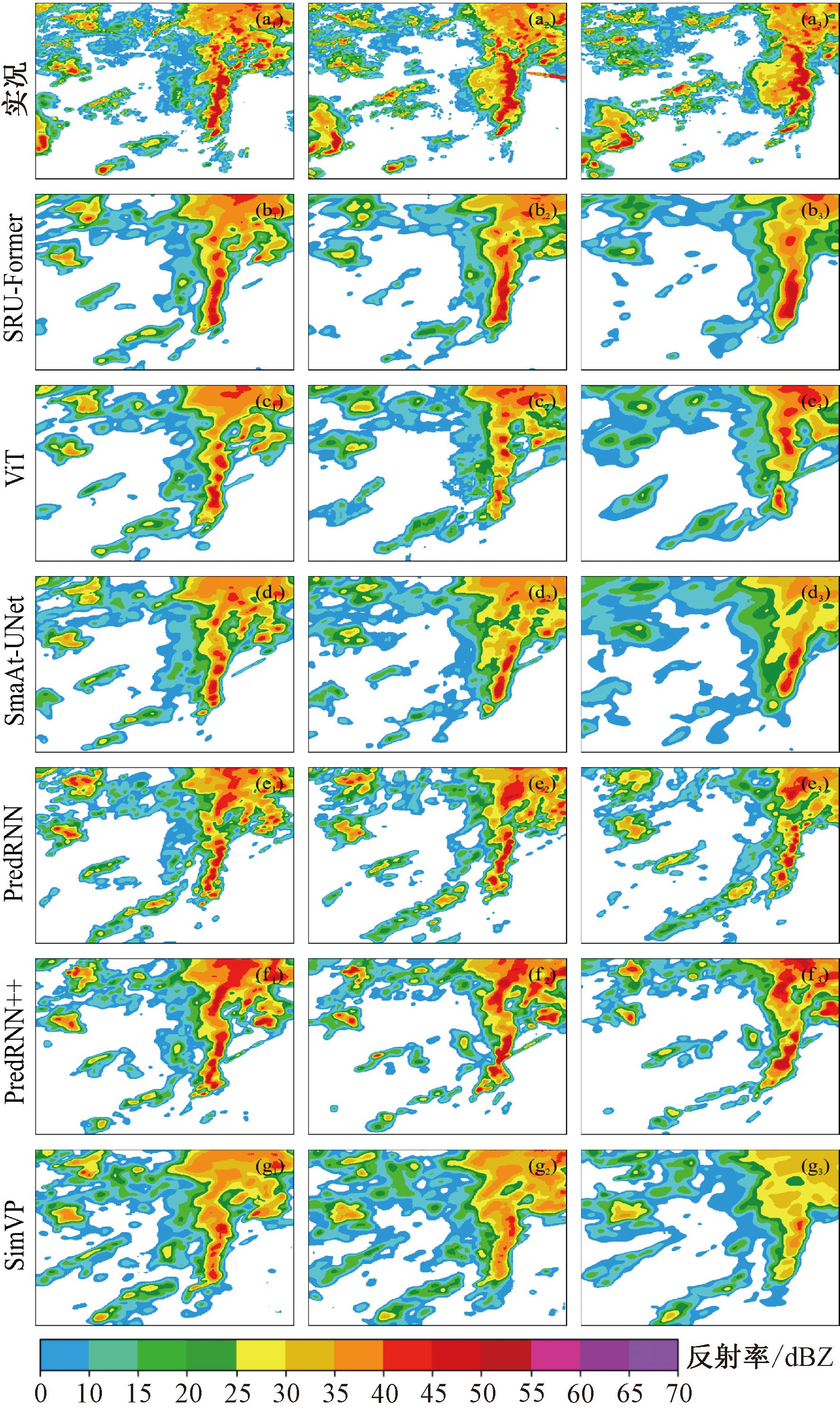

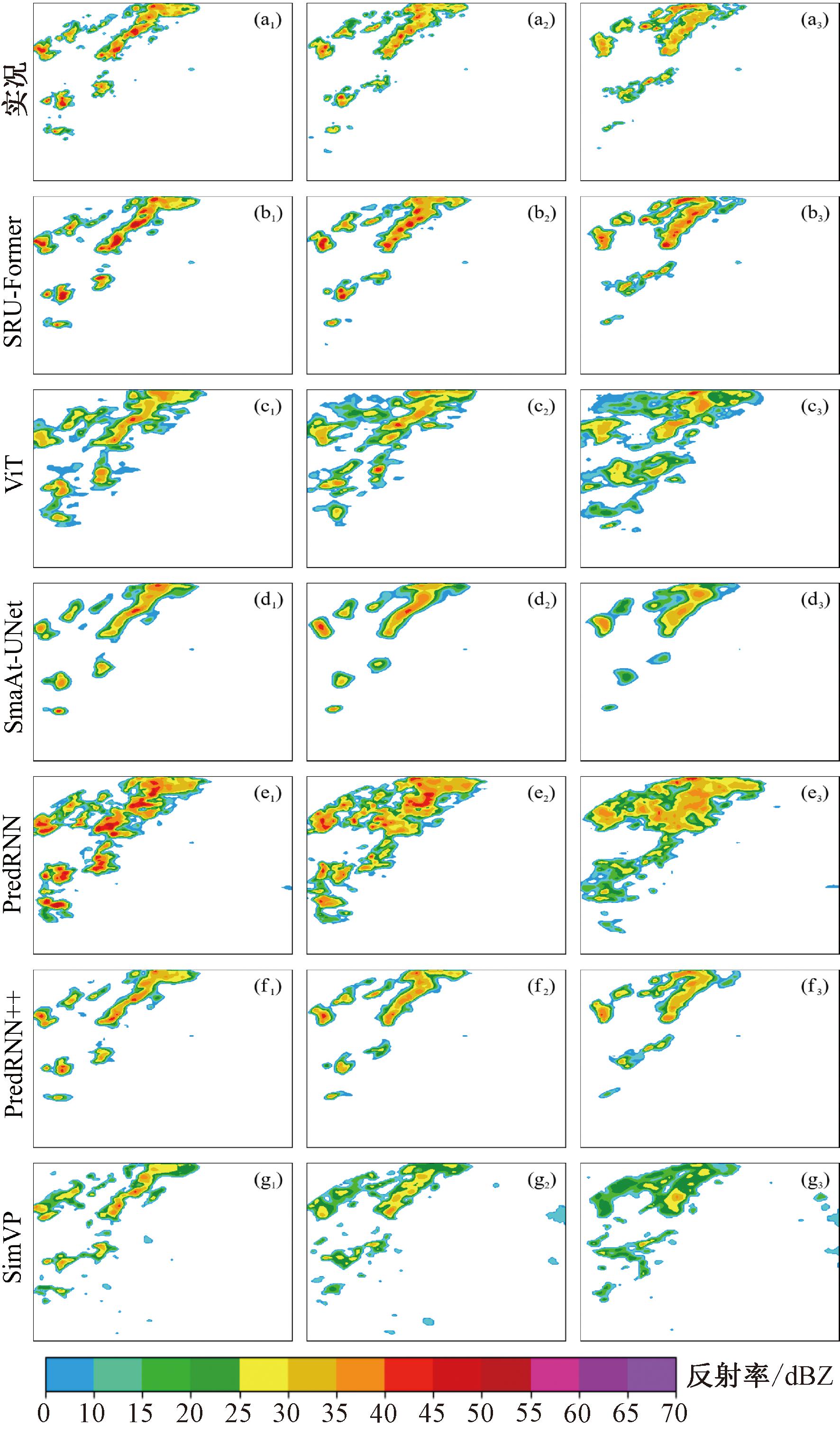

本文应用PredRNN[6]、PredRNN++[7]、SmaAt-UNet[12]、SimVP[13]、ViT[19]和SRU-Former共6个深度学习模型在两个数据集中分别进行训练和测试。表1为两个数据集上的定量指标结果对比。图5为江苏省雷达数据集外推可视化结果图,测试样本时间为2021年7月21日00时06分—03时00分。图6为上海市雷达数据集外推可视化结果图,测试样本时间为2020年8月4日01时06分—04时00分。

表1 定量指标结果对比

Table 1 The comparison of quantitative indicator results

模型江苏省数据集上海市数据集CSIPODFARMSESSIMCSIPODFARMSESSIMPredRNN0.4960.5970.2771.6460.6360.4360.9010.54480.9210.820PredRNN++0.5050.6100.2681.6330.6490.7550.8150.0888.3960.973SmaAt-UNet0.5230.6730.3221.7530.6490.6880.7730.14013.9560.955SimVP0.5070.6780.3411.4730.6190.6010.8540.32224.3550.906ViT0.5270.6200.2401.4100.6540.4800.8260.47345.8530.843SRU-Former0.5470.6320.2061.3120.6740.8030.8700.0876.1020.983

图5 江苏省雷达反射率拼图外推结果对比

Figure 5 Comparison of extrapolation results of radar reflectivity puzzle in Jiangsu Province

图6 上海市雷达反射率拼图外推结果对比

Figure 6 Comparison of Extrapolation Results of Radar Reflectivity Puzzle in Shanghai City

由表1可知,本文提出的SRU-Former网络模型在两个数据集的所有指标中都取得了较好或者最好的结果。在两个数据集中,SRU-Former的POD指标均未达到最优,这主要是因为本文为了捕捉更多较弱的雷达回波信号,将反射率阈值设为15 dBZ,在一定程度上弱化了SRU-Former在预报精度上的优势,CSI作为一个综合考虑命中率和空报率的指标,更能有效地用于评估预报模型的准确性。从图5和图6中可以看出,SRU-Former在对强回波区域的动态变化捕捉上优势显著,尤其在上海市雷达数据集中,精准地预测了强回波的演变趋势,在2 h外推后期(图6(a3))依然能够保持对强回波区域的识别和预测。对比模型中,只有SmaAt-UNet和PredRNN++在两个数据集中预报性能较为稳定,但仍落后于SRU-Former;ViT和PredRNN在江苏省雷达数据集中对回波区域尚能有效预测,但在上海市雷达数据集中外推图像细节丢失严重,空报率较高;SimVP对于强回波区域的预测能力较弱,预测值过于保守,在两个数据集中都存在较为明显的回波削弱问题。

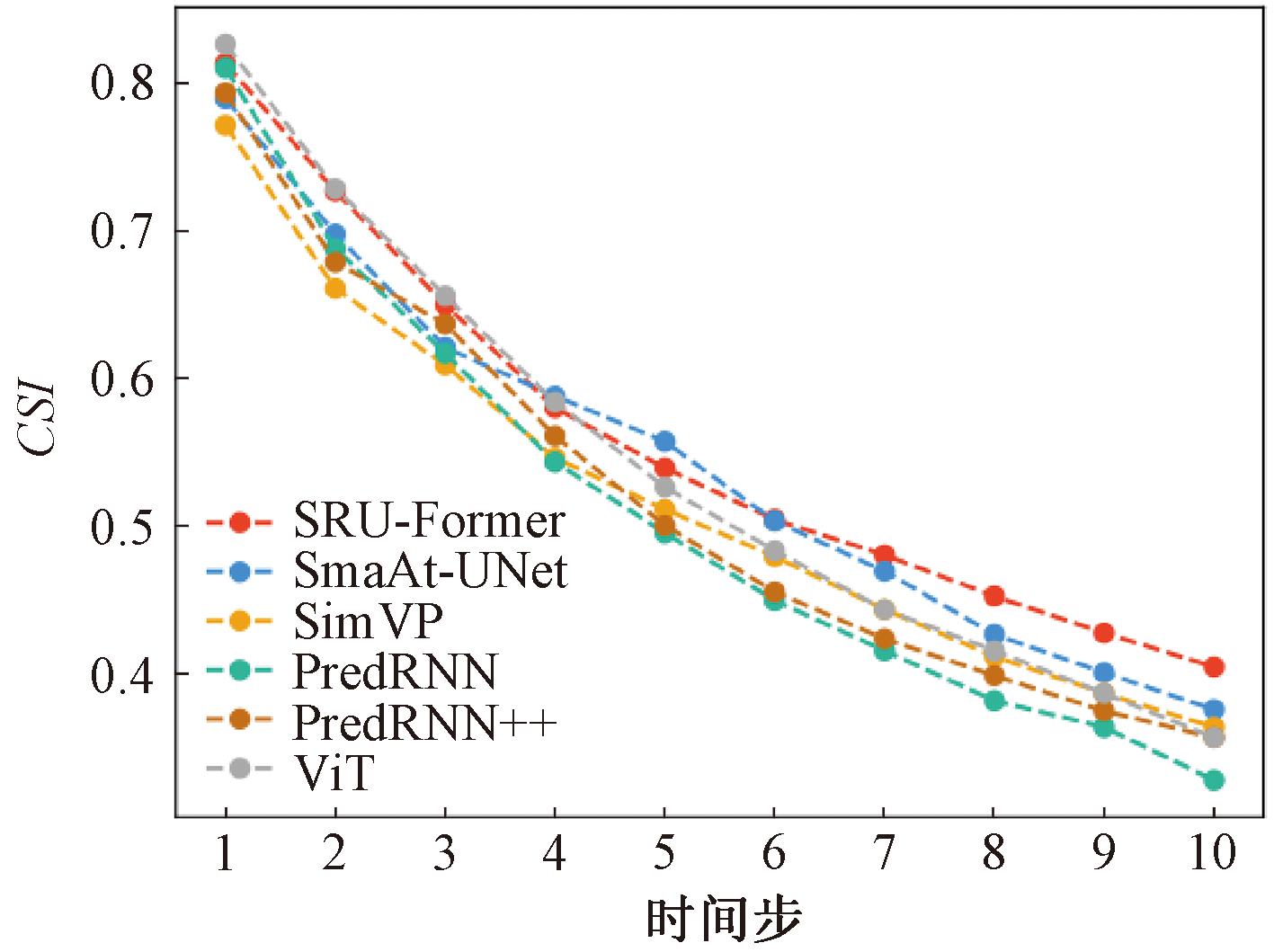

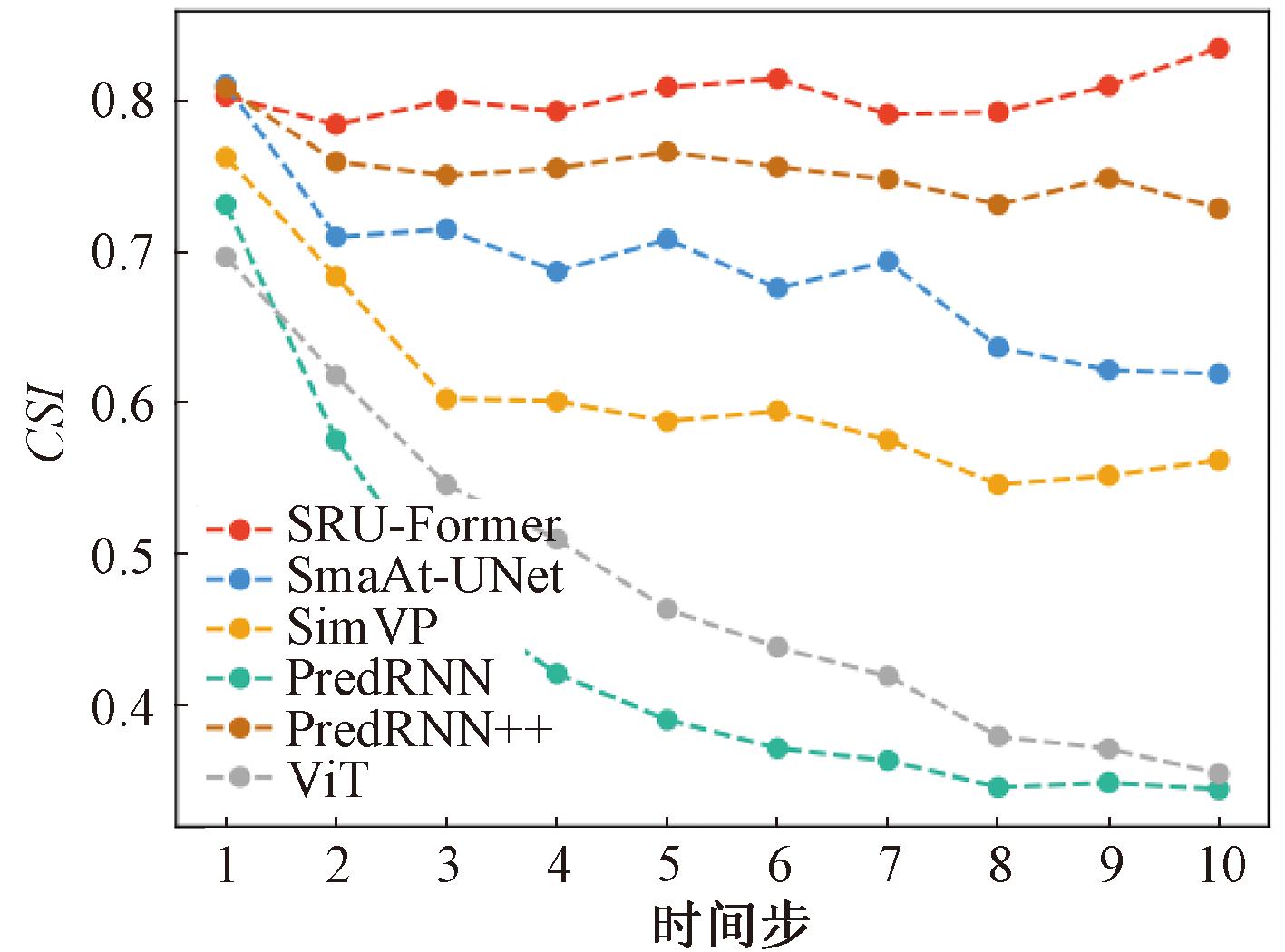

本文在实验中发现了不同雷达数据集之间的差异。江苏省雷达数据集质量相对较低,包含了大量的非均质性和不确定性。图7和图8展示了SRU-Former网络模型在两个数据集测试样本10个时间步上CSI评价指标的变化过程,每个时间步间隔12 min。从图7可以看出,在数据质量较低的江苏省雷达数据集中,所有模型的预报能力均显著下降,SRU-Former的下降趋势相较其他模型要稍缓慢些;从图8可以看出,在数据质量较高的上海市雷达数据集中,SRU-Former表现得非常出色,CSI有逐渐升高的趋势,表明SRU-Former网络模型在不断地学习和优化中可以更好地模拟雷达回波的变化规律,并且在更高质量的数据中可以实现更加精准的预报。

图7 江苏省雷达数据集CSI变化

Figure 7 Changes in CSI of Jiangsu Province radar dataset

图8 上海市雷达数据集CSI变化

Figure 8 Changes in CSI of Shanghai City radar dataset

2.5 消融实验

2.5.1 Poolformer模块的计算效率分析

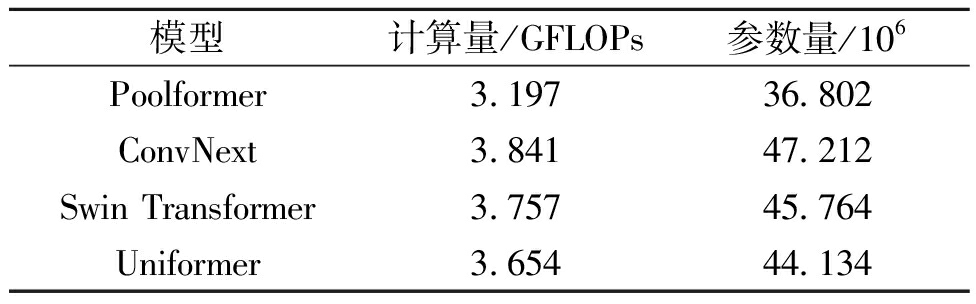

为了证明引入的Poolformer模块能够有效地提高模型的计算效率,本文在模型编码器和解码器之间融合其他3种时序依赖关系建模模型:ConvNext[24]、Swin Transformer[17]、Uniformer[25],比较计算量和参数量这两个指标。计算量和参数量越大,表示该模型的计算复杂度越高,而较低的计算量和参数量则表明模型具有较低的计算复杂度和较少的参数,不同时序依赖关系建模模型对比如表2所示。

表2 不同时序依赖关系建模模型对比

Table 2 Comparison of different sequential dependency modeling modules

模型计算量/GFLOPs参数量/106Poolformer3.19736.802ConvNext3.84147.212Swin Transformer3.75745.764Uniformer3.65444.134

从表2中可以看出,相对其他3种模型而言,在编码器和解码器之间融合Poolformer模块能够取得最低的计算量和参数量,具有更快的训练速度和推理速度,计算资源消耗较少,便于模型的部署,在不同的预报任务中具有很好的鲁棒性。

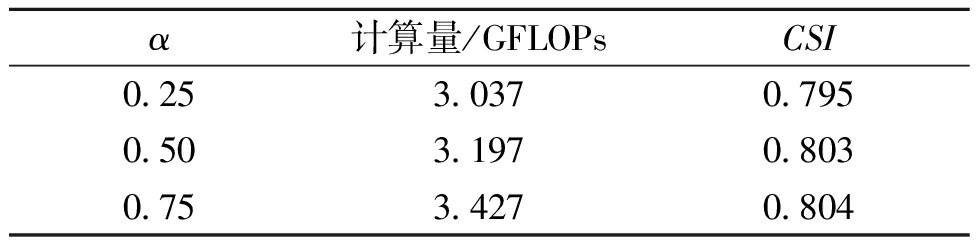

2.5.2 比例因子α的影响

为了探讨时空重构单元中不同α对模型效果的影响,本文选取3个不同的α值进行对比。表3显示了不同α在上海市雷达数据集中计算量和CSI指标上的对比。

表3 不同α因子值指标对比

Table 3 Comparison of indicators with different

α factor values

α计算量/GFLOPsCSI0.253.0370.7950.503.1970.8030.753.4270.804

从表3中可以看出,随着α值升高,计算量和CSI也逐渐增加,这主要是因为模型对输入张量在F通道按照比例因子α拆分得到的上半部分特征应用分组卷积和逐点卷积操作,能够提取到更丰富的特征信息,但同时也会带来更高的计算复杂度,当α取0.50时,模型在保持较高预报准确率的同时,计算效率也相对较高,二者达到一个很好的平衡,综合效果最佳。

3 结论

本文提出了一种融合时空重构单元和Transformer的雷达回波外推模型SRU-Former。实验结果表明,本文在模型编码器和解码器中设计的时空重构单元模块SRU,能够增强对雷达图像的时空特征提取能力,有效解决现有深度学习模型对复杂天气变化的特征表示不足的问题;在编码器和解码器之间融合的Poolformer模块,在捕捉序列依赖的同时,提升了模型的计算效率和鲁棒性。在未来工作中,将融合风场和温度等气象要素,进一步提高预报准确率。

[1] 薛丰昌, 章超钦, 王文硕, 等. 基于自注意力和门控循环神经网络的雷达回波外推算法研究[J]. 气象学报, 2024, 82(1): 127-135.

XUE F C, ZHANG C Q, WANG W S, et al. Improving radar echo extrapolation algorithms based on selfattention and gated recurrent neural networks[J]. Acta Meteorologica Sinica, 2024, 82(1): 127-135.

[2] 黄旋旋, 朱科锋, 赵坤. 改进后TREC外推方法在台风临近降雨预报中的应用[J]. 气象科学, 2017, 37(5): 610-618.

HUANG X X, ZHU K F, ZHAO K. The improved TREC algorithm and its application to the precipitation now-casting for landfall typhoon[J]. Journal of the Meteorological Sciences, 2017, 37(5): 610-618.

[3] DEL MORAL A, RIGO T, LLASAT M C. A radar-based centroid tracking algorithm for severe weather surveillance: identifying split/merge processes in convective systems[J]. Atmospheric Research, 2018, 213: 110-120.

[4] 吴剑坤, 陈明轩. 基于雷达回波区域跟踪算法的临近预报技术进展[J]. 气象科技, 2018, 46(5): 899-909.

WU J K, CHEN M X. Advances in nowcasting techniques based on radar echo area tracking algorithm[J]. Meteorological Science and Technology, 2018, 46(5): 899-909.

[5] SHI X J, CHEN Z R, WANG H, et al. Convolutional LSTM network: a machine learning approach for precipitation nowcasting[J]. Advances in Neural Information Processing Systems, 2015, 2015: 802-810.

[6] WANG Y B, WU H X, ZHANG J J, et al. PredRNN: recurrent neural networks for predictive learning using spatiotemporal LSTMs[C]∥ Proceedings of the 31st International Conference on Neural Information Processing Systems. Long Beach: Curran Associates,2017: 879-888.

[7] WANG Y B, GAO Z F, LONG M S, et al. PredRNN++: towards a resolution of the deep-in-time dilemma in spatiotemporal predictive learning[EB/OL]. (2018-04-17)[2024-10-16].https:∥doi.org/10.48550/arXiv.1804.06300.

[8] 方巍, 庞林, 易伟楠. 基于深度时空融合网络的雷达回波外推模型[J]. 电子学报, 2023, 51(9): 2526-2538.

FANG W, PANG L, YI W N. Radar echo extrapolation model based on deep spatio-temporal fusion neural network[J]. Acta Electronica Sinica, 2023, 51(9): 2526-2538.

[9] 刘颖, 杨鹏飞, 张立军, 等. 前馈神经网络和循环神经网络的鲁棒性验证综述[J]. 软件学报, 2023, 34(7): 3134-3166..

LIU Y, YANG P F, ZHANG L J, et al. Survey on robustness verification of feedforward neural networks and recurrent neural networks[J]. Journal of Software, 2023, 34(7): 3134-3166.

[10] RONNEBERGER O, FISCHER P, BROX T. U-Net: convolutional networks for biomedical image segmentation[C]∥Lecture Notes in Computer Science. Cham: Springer, 2015: 234-241.

[11] 王善昊, 胡志群, 王福增, 等. 基于ConvLSTM融合RMAPS-NOW数据的雷达回波外推研究[J]. 气象学报, 2024, 82(4): 554-567.

WANG S H, HU Z Q, WANG F Z, et al. Extrapolation of radar echo based on ConvLSTM with fusion of RMAPS-NOW data[J]. Acta Meteorologica Sinica, 2024, 82(4): 554-567.

[12] TREBING K, ![]() T, MEHRKANOON S. SmaAt-UNet: precipitation nowcasting using a small attention-UNet architecture[J]. Pattern Recognition Letters, 2021, 145: 178-186.

T, MEHRKANOON S. SmaAt-UNet: precipitation nowcasting using a small attention-UNet architecture[J]. Pattern Recognition Letters, 2021, 145: 178-186.

[13] GAO Z Y, TAN C, WU L R, et al. SimVP: simpler yet better video prediction[C]∥2022 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Piscataway: IEEE, 2022: 3160-3170.

[14] 李卫军, 张新勇, 高庾潇, 等. 基于门控时空注意力的视频帧预测模型[J]. 郑州大学学报(工学版), 2024, 45(1): 70-77, 121.

LI W J, ZHANG X Y, GAO Y X, et al. Video frame prediction model based on gated spatio-temporal attention[J]. Journal of Zhengzhou University (Engineering Science), 2024, 45(1): 70-77, 121.

[15] VASWANI A, SHAZEER N, PARMAR N, et al. Attention is all you need[EB/OL].(2017-07-12)[2024-10-16].https:∥doi.org/10.48550/arXiv.1706.03762.

[16] 方巍, 齐媚涵. 基于深度学习的高时空分辨率降水临近预报方法[J]. 地球科学与环境学报, 2023, 45(3): 706-718.

FANG W, QI M H. Precipitation nowcasting method with high spatio-temporal resolution based on deep learning[J]. Journal of Earth Sciences and Environment, 2023, 45(3): 706-718.

[17] LIU Z, LIN Y T, CAO Y, et al. Swin Transformer: hierarchical vision Transformer using shifted windows[C]∥2021 IEEE/CVF International Conference on Computer Vision. Piscataway: IEEE, 2021: 9992-10002.

[18] BI K F, XIE L X, ZHANG H H, et al. Pangu-weather: a 3D high-resolution model for fast and accurate global weather forecast[EB/OL]. (2022-11-03)[2024-10-16]. https:∥doi.org/10.48550/arXiv.2211.02556.

[19] DALMAZ O, YURT M, CUKUR T. ResViT: residual vision transformers for multimodal medical image synthesis[J]. IEEE Transactions on Medical Imaging, 2022, 41(10): 2598-2614.

[20] YU W H, LUO M, ZHOU P, et al. MetaFormer is actually what you need for vision[C]∥2022 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Piscataway:IEEE, 2022: 10809-10819.

[21] 魏明军, 王镆涵, 刘亚志, 等. 基于特征融合和混合注意力的小目标检测[J]. 郑州大学学报(工学版), 2024, 45(3): 72-79.

WEI M J, WANG M H, LIU Y Z, et al. Small object detection based on feature fusion and mixed attention[J]. Journal of Zhengzhou University (Engineering Science), 2024, 45(3): 72-79.

[22] LI J F, WEN Y, HE L H. SCConv: spatial and channel reconstruction convolution for feature redundancy[C]∥2023 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Piscataway: IEEE, 2023: 6153-6162.

[23] SMITH L N. Cyclical learning rates for training neural networks[C]∥2017 IEEE Winter Conference on Applications of Computer Vision. Piscataway: IEEE, 2017: 464-472.

[24] LIU Z, MAO H Z, WU C Y, et al. A ConvNet for the 2020s[C]∥2022 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2022: 11966-11976.

[25] LI K C, WANG Y L, ZHANG J H, et al. UniFormer: unifying convolution and self-attention for visual recognition[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2023, 45(10): 12581-1260.