推荐系统(recommendation system, RS)中普遍使用的协同过滤(collaborative filtering, CF)[1]方法根据用户的共同兴趣偏好进行推荐,但存在着用户与项目交互数据稀疏和冷启动等问题[2]。为此,研究人员通常利用辅助信息来解决上述问题,其中知识图谱(knowledge graph, KG)因其富含大量语义信息和结构信息,可以有效辅助提升推荐准确率、增强推荐的可解释性[3-4]而受到人们关注。现有的基于KG的推荐系统大致可以分为基于嵌入的方法[5]、基于路径的方法[6]和基于传播的方法[7-9]。

基于传播的方法同时结合基于嵌入方法和基于路径方法的优点,已经成为基于KG的推荐系统中的主流方法。其不仅采用嵌入传播机制,同时充分利用KG中的语义信息和结构信息,沿着KG中的关系路径传播并聚合多跳的邻居信息,从而增强用户和项目的表示[10],典型的方法有RippleNet[11]、KGAT[12]、CKAN[13]、LKGR[14]等。但上述的基于KG的推荐方法只专注于对KG中包含知识的挖掘,没有考虑多模态信息的语义知识可能包含着用户的个性偏好[15]。例如,用户在点餐时可能会因为菜品图片或美食文字介绍对菜品产生兴趣。将多模态信息[16]引入KG中,可以丰富图谱中实体的知识表示,有助于实现更精准的个性化推荐。MKGCN[17]提取了音乐相关的7种模态信息,通过使用多模态聚合器处理各模态信息的融合,增强实体表示,提高推荐性能。MKGAT[18]将多模态信息经过预处理后直接作为实体并引入新的关系整合进KG中,采用改进后的图注意力网络来聚合多模态邻居实体,并扩展到多跳来获取多模态知识图谱的高阶信息。

将多模态信息引入KG可以增强图谱中的实体表示,从而提升推荐性能,但上述的多模态的方法仍存在着多模态语义信息挖掘不完全和融合各模态信息时引入大量噪声等问题。多模态语义信息挖掘不完全是指未能充分挖掘多模态信息所具有的语义互补性和语义关联性,这些信息对于探究用户的深层兴趣偏好有重要意义。融合各模态信息时引入大量噪声问题是指在进行模态信息融合时未将各模态信息中的无用信息或干扰信息进行丢弃,而是直接融合进特征表示中,影响推荐的准确性。为此,本文提出了一种融合多模态信息的知识感知推荐方法 (knowledge-aware recommendation method integrating multi-modal information,KRIM),在KG传播的基础上,整合与KG中实体相关的多模态信息,分析多模态数据特点,采用模态间注意力关注各模态交互信息的细粒度融合,挖掘多模态数据的深层语义信息;同时设计门控注意力来动态控制多模态信息与图谱中实体信息之间的数据融合,减少融合过程中的噪声数据干扰,进而丰富实体表示,提高推荐性能。

1 KRIM方法架构

KRIM将用户和项目交互图、KG和多模态信息作为输入,首先,通过异构传播得到具有协同信号的多跳实体嵌入集,采用模态间注意力融合不同模态数据之间的语义信息,获得多模态嵌入特征集;其次,利用门控注意力将实体嵌入与多模态嵌入进行融合,在多跳实体嵌入集上沿着KG中的关系进行多跳传播来捕获高阶邻居信息,得到最终的嵌入表示;最后,通过内积计算最终的用户表示和项目表示,输出用户对项目的偏好得分,KRIM模型结构如图1所示。

图1 KRIM模型结构图

Figure 1 KRIM model architecture diagram

KRIM由异构传播、模态间信息融合、模态外信息融合与传播、预测与学习4个模块构成。异构传播模块旨在将协同信号与图谱的结构信息相结合,获取反映用户偏好的多阶实体集。模态间信息融合模块使用预处理模型提取各模态的特征,采用模态间注意力整合多模态特征,实现多模态语义信息的深层挖掘。模态外信息融合与传播模块使用门控注意力来减少实体信息和多模态信息融合时的噪声数据影响,并通过知识感知注意力多跳传播聚合邻居实体信息,捕获图谱的高阶语义信息。预测与学习模块主要实现用户偏好的预测。

1.1 异构传播

异构传播模块由交互传播和知识传播两部分组成。交互传播考虑将协作信号显式地编码到用户和项目表示中,挖掘用户潜在偏好。知识传播是实体沿着KG中的关系路径多跳传播挖掘图谱中的语义信息和结构信息。

1.1.1 交互传播

点击同一个项目的不同用户之间可能存在着相同的兴趣偏好,这种现象称之为协作信号。通过交互传播可以捕捉用户和项目之间的协作信号,根据用户的历史交互数据构建用户和项目交互图,若用户和项目存在交互,则它们之间有连接,反之,则没有。对于用户u,通过在用户-项目交互图上进行一次传播(即用户-项目),获得用户的初始种子集![]()

(1)

式中:E为KG中的实体集;yui=1指用户和项目之间有交互,否则yui值为0。类似地,项目端也考虑协作信号,在交互图上进行二次传播(即项目-用户-项目),获得项目的初始种子集![]()

Ii={iu|{u|yui=1},yuiu=1};

(2)

(3)

式中:Ii为项目-用户-项目所得到的项目集。初始种子集会通过知识传播获取高阶的实体集。

1.1.2 知识传播

知识图谱中富含大量的语义信息和结构信息,可以增强用户表示和项目表示。知识传播是通过用户初始种子集和项目初始种子集在图谱上沿着不同关系路径进行多跳传播来扩展用户实体集和项目实体集。获取每一跳的实体表示:

(4)

式中:l表示与初始实体集之间存在l跳的距离,l=1,2,…,L;下标符号o为用户u或者项目i的占位符。定义用户u和项目i的第l个三元组:

(5)

扩展后的用户实体集和项目实体集进行嵌入,得到用户和项目的多跳实体嵌入集,将送入模态外信息融合与传播模块进行下一步处理。

1.2 模态间信息融合

多模态数据由图片、文本、音频等不同类型模态数据组成,富含多模态数据特有的语义信息和用户潜在的个性偏好。模态间信息融合模块处理多模态信息,设计模态间注意力来融合各模态信息,挖掘多模态数据中的深层语义信息。多模态数据由图片和文本两个模态数据进行表示,也可扩展到不同模态。对获取的项目图片通过VGG16[19]进行预处理并经过嵌入层,得到项目图片嵌入特征。文本信息通过BERT[20]进行预处理并经过嵌入层,得到项目文本嵌入特征。

首先,将图片嵌入特征和文本嵌入特征映射到同一空间中:

(6)

式中:![]() 和

和![]() 分别为图片和文本的映射矩阵;Wv和Wr均为可以学习到的参数矩阵。

分别为图片和文本的映射矩阵;Wv和Wr均为可以学习到的参数矩阵。

其次,计算不同模态之间交互信息的重要性:

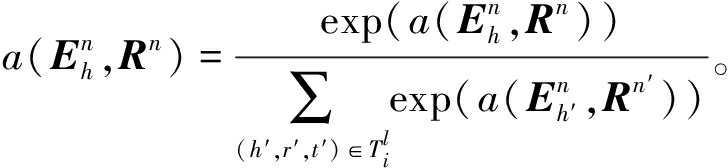

(7)

式中:att为模态间注意力得分。采用Softmax函数进行归一化,计算加权后的图片嵌入特征Vi和文本嵌入特征Bi:

(8)

最后,二者相加得到多模态嵌入特征Mi,将送入模态外信息融合与传播模块进行下一步处理。

Mi=Vi+Bi。

(9)

1.3 模态外信息融合与传播

模态外信息融合与传播模块由模态外信息融合和多模态实体高阶传播组成。模态外信息融合主要针对实体与多模态的特征融合,多模态实体高阶传播聚合不同关系权重的高阶邻居信息。

1.3.1 模态外信息融合

设计门控注意力将多模态嵌入特征与实体嵌入进行融合,门控机制可以自适应地融合不同特征,关注重要信息,过滤噪声数据的干扰。门控信号保留有用信息,去除无用信息,计算如下:

gi=σ(Wg(Concat(Ei,Mi))+bg)。

(10)

式中:gi为门控信号;Ei和Mi分别为实体嵌入和其实体相关的多模态嵌入特征;σ表示Sigmoid激活函数;Wg和bg分别为可训练的权重矩阵和偏差。使用门控信号来控制不同特征的权重,以便有选择地关注更重要的特征,注意力得分为

(11)

式中:Wa和ba分别为可训练的权重矩阵和偏差。

计算加权后的特征向量:

(12)

式中:E′i和M′i分别为加权后的实体嵌入和多模态嵌入特征。将加权后的特征进行相加,得到多模态实体嵌入EM,i:

EM,i=E′i+M′i。

(13)

多模态实体嵌入EM,i可以通过多模态实体高阶传播进行处理获取高阶信息。

1.3.2 多模态实体高阶传播

聚合实体的高阶信息可以探究用户的深层兴趣偏好,挖掘用户和项目之间的潜在关系。考虑每个多模态尾实体在不同多模态头实体和关系中具有不同的含义,采用知识感知注意力[13]来捕捉邻居的语义信息。设第l层邻居中,第i个三元组知识感知注意力Zn嵌入,计算公式如下:

(14)

式中:![]() 为第n个多模态头实体嵌入;

为第n个多模态头实体嵌入;![]() 为第n个多模态尾实体嵌入;Rn为第n个多模态头实体和第n个多模态尾实体之间的关系;

为第n个多模态尾实体嵌入;Rn为第n个多模态头实体和第n个多模态尾实体之间的关系;![]() 表示多模态头实体和关系产生的注意力权重,表达式为

表示多模态头实体和关系产生的注意力权重,表达式为

(15)

式中:σ为Sigmoid激活函数;ReLU为非线性激活函数;W1,W2,W3为可训练的权重矩阵;b1,b2,b3为偏差。此外,采用Softmax函数对知识感知注意力权重进行归一化,以防止梯度爆炸问题,计算如下:

(16)

式中:![]() 为项目的l层邻居,获得项目的第l层邻居表示

为项目的l层邻居,获得项目的第l层邻居表示![]()

(17)

获得项目l层的表示集:

(18)

用户端采用相同的计算方式,获取用户l层的表示集:

(19)

将用户l层的表示集和项目l层的表示集送入预测与学习模块进行下一步处理。

1.4 预测与学习

为了预测用户的个性化偏好和优化模型。在知识图谱上进行多次迭代传播后,得到用户l层的表示集Nu和项目l层的表示集Ni,采用Sum聚合器聚合每层的嵌入表示,计算如下:

(20)

式中:o为占位符,表示用户或项目,得到最终的用户表示![]() 和项目表示

和项目表示![]() 使用内积来预测用户对项目的偏好分数:

使用内积来预测用户对项目的偏好分数:

(21)

定义损失函数[21]进行模型优化,公式如下:

(22)

式中:O={(u,i,j)|(u,i)∈O+,(u,j)∈O-}表示训练集;σ为Sigmoid函数;θ为模型参数集;λ为学习率。

2 实验及结果分析

2.1 实验设计

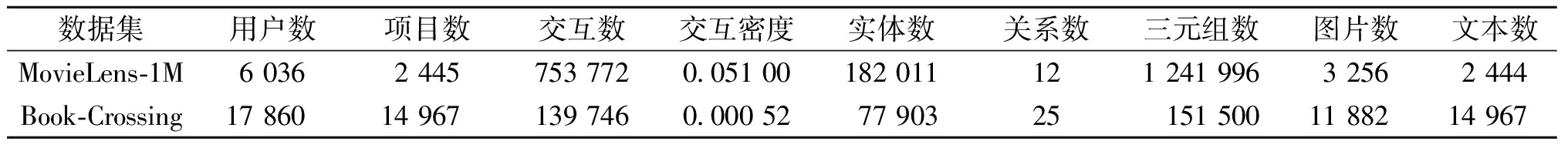

为了评估KRIM方法的有效性,在Movielens-1M和Book-Crossing两个数据集上进行实验。Movielens-1M数据集中包含用户与项目的交互信息、电影相关的知识图谱信息、图片信息和文本信息,其中图片信息是指电影的封面信息,文本信息是指电影的文本简介内容。Book-Crossing数据集中包含用户与项目的交互信息、书籍相关的知识图谱信息、图片信息和文本信息,其中图片信息是指书籍的封面信息、文本信息是指书籍的作者、出版社等文本内容。具体的数据集统计信息如表1所示。

表1 数据集信息统计

Table 1 Statistics of datasets

数据集用户数项目数交互数交互密度实体数关系数三元组数图片数文本数MovieLens-1M6 0362 445753 7720.051 00182 011121 241 9963 2562 444Book-Crossing17 86014 967139 7460.000 5277 90325151 50011 88214 967

由表1可知,MovieLens-1M数据集中用户和项目交互相对稠密,KG实体丰富,但多模态信息相对较少。Book-Crossing数据集中用户和项目交互相对稀疏,KG实体相对较少,但多模态信息相对较多。实验选取用户交互稀疏程度不同、KG中实体数量不同、多模态信息多少不同的两个数据集对本方法性能进行验证,可以体现方法在不同数据集上的有效性。

实验中训练集、验证集和测试集数据比例设置为6∶2∶2,采用Adam优化器进行模型优化,使用Xavier初始化模型参数。

参数设置值均为在Movielens-1M和Book-Crossing两个数据集中实验性能最佳时的数值。其中,两个数据集的嵌入维度均为64,正则化损失权重L2均为10-5,,学习率λ均为0.002。对于实体传播层数、用户的邻居数、项目的邻居数的参数设置,在两个数据集上有所不同,因Movielen-1M数据集中的实体更为丰富,实体传播层数设为2层能达到更好的性能,Book-Crossing选取3层能达到最佳性能。用户的邻居数、项目的邻居数在Movielens-1M数据集上分别设置为128和256,在Book-Crossing数据集上为256和32,参数选取为多次实验中性能最佳的数值。

2.2 方法性能分析

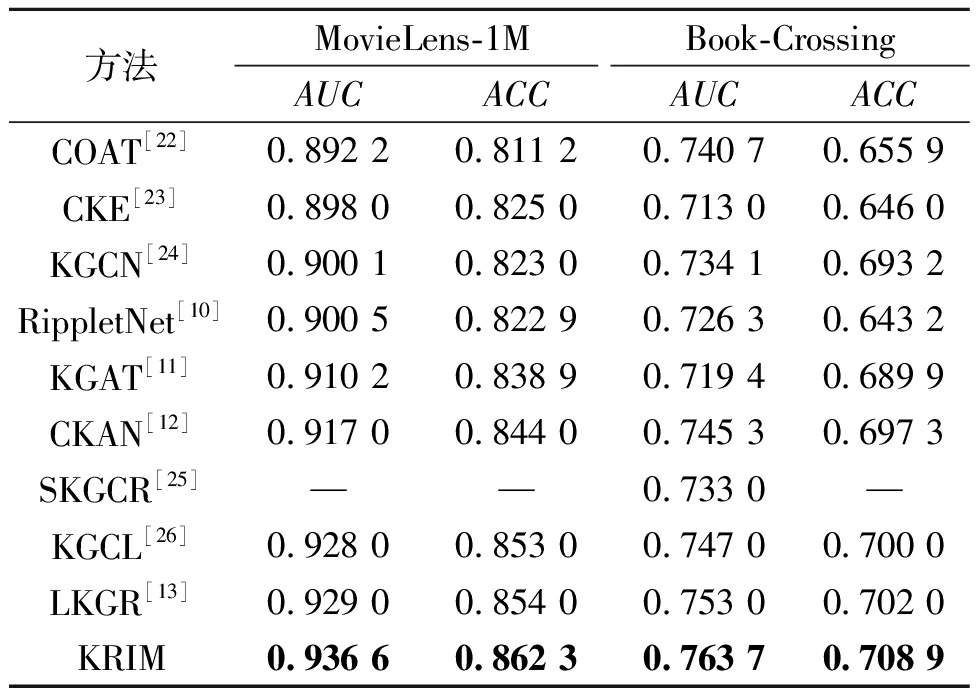

为验证本文方法的有效性,与RippletNet、KGCN、CKAN等9种主流方法进行对比分析,采用AUC和ACC作为点击率(CTR)的性能评价指标。具体的性能对比结果如表2所示。

表2 不同方法在数据集上的实验结果

Table 2 Experimental results of the method on the different datasets

方法MovieLens-1MBook-CrossingAUCACCAUCACCCOAT[22]0.892 20.811 20.740 70.655 9CKE[23]0.898 00.825 00.713 00.646 0KGCN[24]0.900 10.823 00.734 10.693 2RippletNet[10]0.900 50.822 90.726 30.643 2KGAT[11]0.910 20.838 90.719 40.689 9CKAN[12]0.917 00.844 00.745 30.697 3SKGCR[25]——0.733 0—KGCL[26]0.928 00.853 00.747 00.700 0LKGR[13]0.929 00.854 00.753 00.702 0KRIM0.936 60.862 30.763 70.708 9

注:表中横线意味着相应的实验结果未显示。

由表2可知,本文方法在两个数据集上都具有较优的性能。在MovieLens-1M 和Book-Crossing 数据集上,KRIM方法的AUC分别为0.936 6 和0.763 7,与其他模型的平均值相比,增幅为0.027 2和0.029 1;与LKGR方法相比,增幅分别为0.007 6和0.010 7。在MovieLens-1M 和Book-Crossing 数据集上,KRIM方法的ACC分别为0.862 3和0.708 9,与其他模型的平均值相比,增幅为0.028 3和0.030 5;与LKGR方法相比,增幅分别为0.008 3和0.006 9。结果表明,将多模态信息引入KG中,能够补充实体的语义信息,增强其表示,可以细粒度地捕捉用户潜在的兴趣偏好,提高推荐性能。而且KRIM采用的模态间注意力关注多模态数据的交互信息,可以挖掘各模态数据的深层语义信息,使用的门控注意力也可以降低融合与实体相关的多模态信息时的噪声数据干扰。仔细观察实验结果可以发现,本文方法在Book-Crossing数据集上性能提升相对更加明显。原因是Book-Crossing数据集相较MovieLens-1M数据集用户和项目交互更稀疏,KG中的实体也相对较少,但实体相关的多模态信息多。本文方法通过多模态信息来丰富实体表示,增强实体的语义信息,可以缓解用户和项目交互少和KG中实体稀疏的问题,性能提升明显。

KRIM模型的计算复杂度主要来自知识高阶传播、模态间注意力和门控注意力3个部分。知识高阶传播是指知识图谱中的实体根据图谱中的关系路径进行高阶知识传播的过程,其计算复杂度为O(2GndL),其中:L为传播层数;Gn为知识图谱的三元组样本数;d为特征嵌入维度。模态间注意力是针对多模态信息之间的特征融合,其计算复杂度为O(PTd),其中:P为图片特征样本数;T为文本特征样本数;d为特征嵌入维度。门控注意力是为了融合实体信息和多模态信息,其计算复杂度为O(MNd),其中:M为融合后的多模态特征样本数;N为与之对应的实体特征样本数;d为特征嵌入维度。因此,KRIM模型的总体计算复杂度为O(2GndL+PTd+MNd)。基于上述分析,在相同的实验设置下,KRIM虽然因为引入多模态信息导致计算成本有所增加,但仍在大多数推荐方法所允许的计算复杂度范围之内。

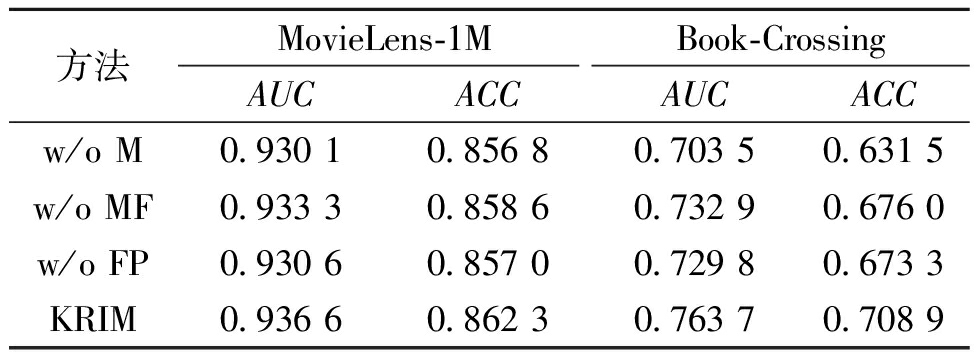

2.3 消融实验

为了证明引入多模态信息和多模态融合模块的有效性以及对于推荐性能的影响,进行了消融实验。消融实验结果如表3所示。w/o M表示去除多模态信息,只保留KG信息;w/o MF表示消去模态间信息融合模块,即在融合多模态信息时只使用拼接操作;w/o FP表示消去模态外信息融合与传播模块,即只使用拼接操作融合多模态信息和实体信息,不进行高阶信息传播。

表3 消融实验结果

Table 3 Ablation experiment results

方法MovieLens-1MBook-CrossingAUCACCAUCACCw/o M0.930 10.856 80.703 50.631 5w/o MF0.933 30.858 60.732 90.676 0w/o FP0.930 60.857 00.729 80.673 3KRIM0.936 60.862 30.763 70.708 9

从表3的实验结果可知,w/o M、w/o MF和w/o FP在两个数据集上性能下降明显,证明了利用多模态信息来增强相关实体表示的必要性,也证明模态间信息融合模块中所采用的模态间注意力的有效性,模态外信息融合与传播模块中使用的门控注意力以及高阶传播的有效性。在Book-Crossing数据集上w/o M、w/o MF和w/o FP性能降低尤其明显,分析原因是Book-Crossing数据集相较于MovieLens-1M数据集,KG中实体较少同时用户和项目的交互稀疏。w/o M去除多模态信息,仅通过图谱中的实体信息来增强表示,实验性能下降,这表明了利用多模态信息可以有效增强稀疏KG中实体的表示和缓解用户交互少的问题。Book-Crossing数据集中多模态信息多,w/o MF性能下降,分析原因是只使用拼接操作是无法挖掘多模态信息之间的语义关联性和互补性的,没有探究用户的多模态潜在兴趣偏好,导致推荐性能下降。w/o FP性能下降明显,说明去除门控注意力影响多模态信息与实体信息的有效融合,会将各模态数据中的噪声数据引入特征表示中,同时不进行高阶传播则无法聚合高阶的邻居信息,导致特征表示不充分,影响推荐的准确性。

综上,通过消融实验证明了添加多模态信息和方法中所设计的融合模块对于模型的重要性,去除任意技术和模块都会导致推荐性能的下降。

2.4 融合信息的噪声分析实验

融合信息的噪声问题是指多模态信息和实体信息融合时容易将一些不必要的噪声数据引入融合后特征中。实际上,多模态信息与实体信息本身就含有噪声数据,在实验中所使用的Movielen-1M数据集和Book-Crossing数据集中,多模态的噪声数据包含图片噪声和文本噪声。其中,图片噪声是指图片中与主体无关的背景信息、图片模糊等,文本噪声是指在文本信息中会存在的拼写错误、错误表述等。这些噪声数据会影响特征表示,降低推荐的准确性。本文方法KRIM可以减少多模态信息与知识图谱实体信息融合时的噪声数据影响。

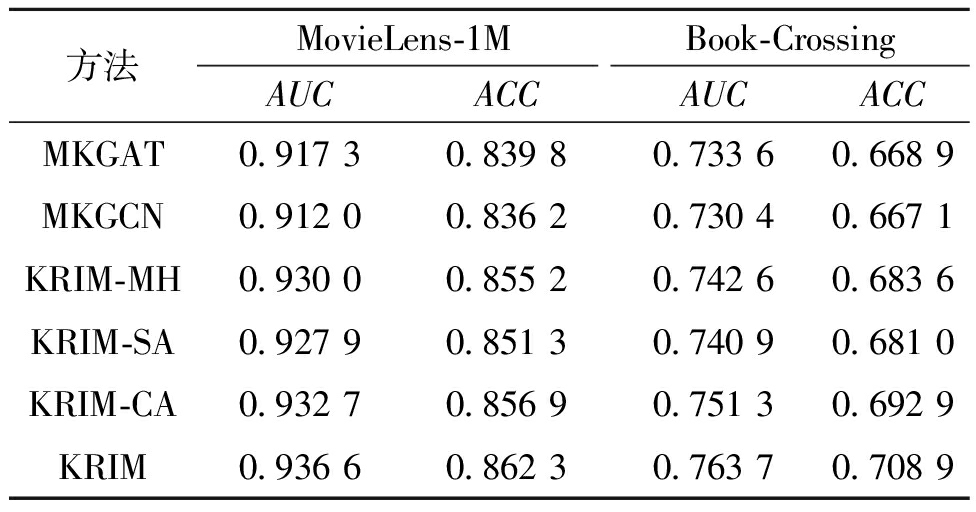

为验证不同方法在减少噪声数据干扰的有效性,进行融合信息的噪声分析实验。通过KRIM与未采用噪声处理机制的基线方法MKGAT、MKGCN以及采用不同噪声处理策略的KRIM变体方法KRIM-MH、KRIM-SA、KRIM-CA这5种方法进行对比。KRIM-MH是采用多头注意力来融合多模态信息和实体信息;KRIM-SA是采用自注意力来处理多模态信息和实体信息的融合问题;KRIM-CA是使用跨模态注意力来融合多模态信息和实体信息。具体结果如表4所示。

表4 噪声实验结果

Table 4 Noise experiment results

方法MovieLens-1MBook-CrossingAUCACCAUCACCMKGAT0.917 30.839 80.733 60.668 9MKGCN0.912 00.836 20.730 40.667 1KRIM-MH0.930 00.855 20.742 60.683 6KRIM-SA0.927 90.851 30.740 90.681 0KRIM-CA0.932 70.856 90.751 30.692 9KRIM0.936 60.862 30.763 70.708 9

由表4可知,KRIM的性能结果最佳,证明本文方法可以有效减少多模态信息与知识图谱实体信息融合时的噪声数据影响。通过与未采用噪声处理机制的基线方法MKGAT、MKGCN对比,KRIM的性能增加明显,证明了噪声处理机制的重要性。与KRIM-MH、KRIM-SA、KRIM-CA对比,KRIM方法性能始终优于上述变体方法,证明在处理信息融合所产生的噪声问题时,本文方法所采用的门控注意力机制更有优势。

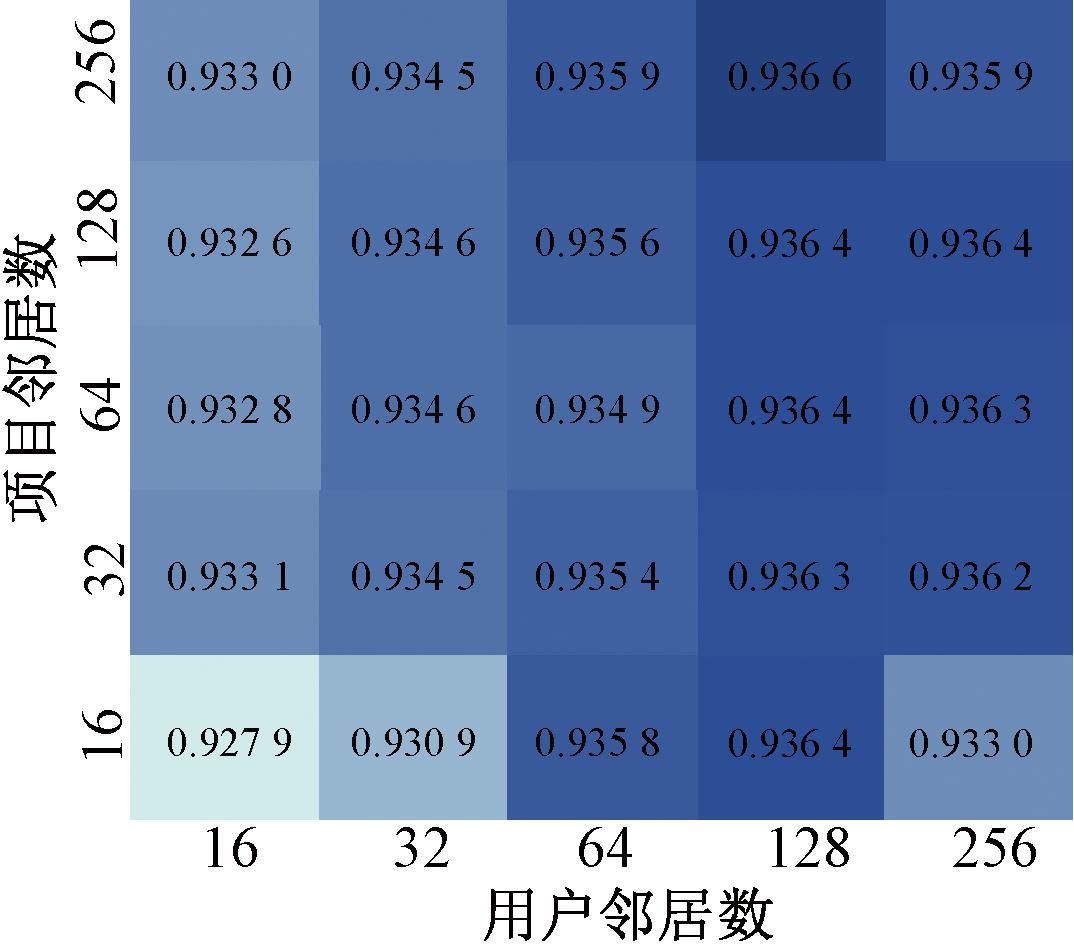

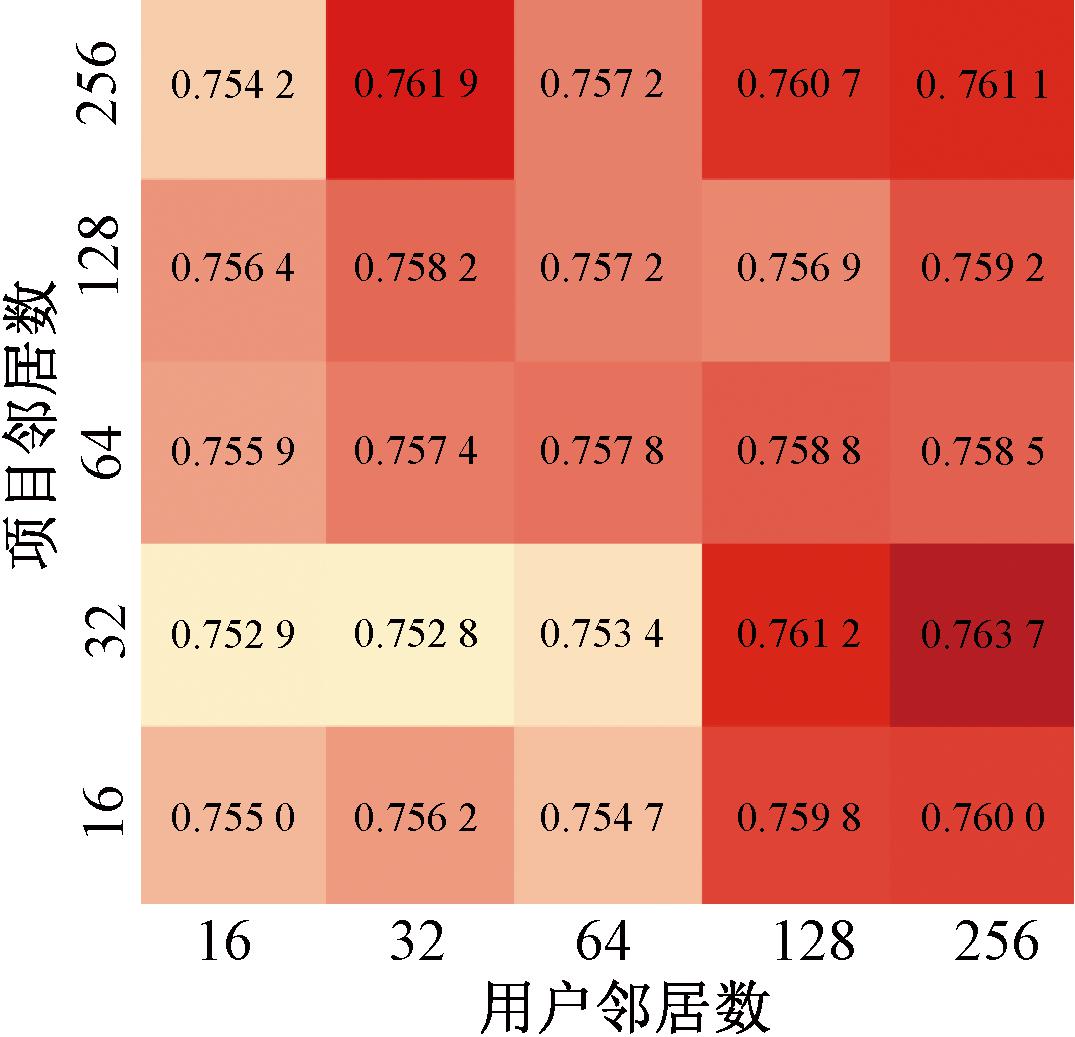

2.5 不同用户数和项目数实验

为了探索用户和项目在知识图谱中聚合邻居信息时不同的邻居数对方法性能的影响,在MovieLens-1M和Book-Crossing数据集上采用不同的用户邻居数和项目邻居数进行多次实验,在MovieLens-1M数据集中的实验结果如图2所示。在Book-Crossing数据集中的实验结果如图3所示。

图2 在MovieLens-1M中的AUC结果

Figure 2 AUC results in MovieLens-1M

图3 在Book-Crossing中的AUC结果

Figure 3 AUC results in Book-Crossing

分析图2可知,当用户邻居数取128、项目邻居数取256时,AUC获得最佳值0.936 6。原因可能是MovieLens-1M数据集中多模态信息较少,所以较多邻居数可以获取更多的多模态信息来丰富表示。但当邻居数过多时会引入噪声,导致推荐性能反而下降。

由图3可以看出,当用户邻居数和项目邻居数分别设置为256、32时,AUC将达到最佳值0.763 7。分析原因是当邻居数越大时,模型能捕捉到更多的KG实体信息和多模态信息,这将丰富用户和项目的表示,同时提高推荐性能。但设置较大邻居数将会引入更多的噪声数据,从而导致性能下降。因此,在设置用户数和项目数时要考虑丰富的邻居信息和可能会同时产生的干扰数据。

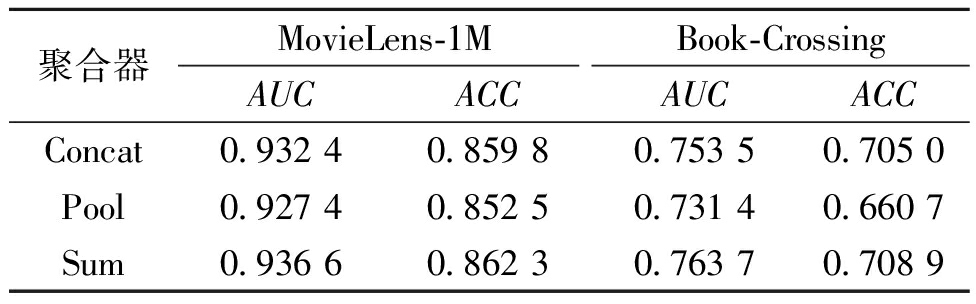

2.6 聚合器性能分析

为了探索不同聚合器对方法性能的影响,采用Sum、Pool和 Concat聚合器进行多次实验。聚合器性能对比实验结果如表5所示。

表5 不同聚合器实验结果

Table 5 Experimental results of different aggregators

聚合器MovieLens-1MBook-CrossingAUCACCAUCACCConcat0.932 40.859 80.753 50.705 0Pool0.927 40.852 50.731 40.660 7Sum0.936 60.862 30.763 70.708 9

分析表5结果可知,Sum聚合器始终优于Concat聚合器和Pool聚合器,原因在于Sum聚合将各阶邻居信息进行累加来得到最终的用户表示和项目表示,邻居信息保留完整。Concat聚合器虽然也将各阶邻居信息进行拼接来保留邻居信息,但同时可能会引入一些噪声干扰,而Sum聚合器对噪声数据不敏感。Pool聚合器采用最大池化聚合的邻居信息导致严重缺少,性能不佳。综上,相较于Concat聚合器和Pool聚合器,Sum聚合器能够更好地捕获各阶的信息,推荐性能最优。

3 结论

本文提出的KRIM方法在KG传播的基础上集成与KG中实体语义相关的多模态信息,并将其与对应的实体进行特征融合,丰富实体表示,进而增强用户和项目的表示。

从本文方法的实验结果可以发现,利用多模态信息来增强实体表示从而提升推荐性能是有效的,但如何更好地对多模态数据进行降噪处理,同时获取更多有用信息来丰富表示是需要解决的难题。此外,对多模态信息所隐含的用户偏好的挖掘还处于单一层面。针对上述问题,未来可以考虑分层提取多模态特征,挖掘多模态信息中包含的浅层特征和深层特征,并通过模态注意力等融合技术减少融合过程中所产生的大量噪声问题。

[1] GUO H, YANG C Y, ZHOU L Q, et al. A novel knowledge graph recommendation algorithm based on graph convolutional network[J]. Connection Science, 2024, 36(1): 2327441.

[2] LIU T Y, SHEN H J, CHANG L, et al. Iterative heterogeneous graph learning for knowledge graph-based recommendation[J]. Scientific Reports, 2023, 13(1): 6987.

[3] LI D Z, QU H B, WANG J Q. A survey on knowledge graph-based recommender systems[C]∥2023 China Automation Congress (CAC).Piscataway: IEEE, 2023: 2925-2930.

[4] GAO C, ZHENG Y, LI N, et al. A survey of graph neural networks for recommender systems: challenges, methods, and directions[J]. ACM Transactions on Recommender Systems, 2023, 1(1): 1-51.

[5] WANG H W, ZHANG F Z, XIE X, et al. DKN[C]∥Proceedings of the 2018 World Wide Web Conference. New York: ACM, 2018: 1835-1844.

[6] HU B B, SHI C, ZHAO W X, et al. Leveraging meta-path based context for top-N recommendation with a neural co-attention model[C]∥Proceedings of the 24th ACM SIGKDD International Conference on Knowledge Discovery &Data Mining. New York: ACM, 2018: 1531-1540.

[7] WANG F, LI Y S, ZHANG Y J, et al. KLGCN: knowledge graph-aware light graph convolutional network for recommender systems[J]. Expert Systems with Applications, 2022, 195: 116513.

[8] RUAN S Q, YANG C, LI D S. Knowledge-enhanced personalized hierarchical attention network for sequential recommendation[J]. World Wide Web, 2024, 27(1): 2.

[9] CHEN F K, YIN G S, DONG Y X, et al. KHGCN: knowledge-enhanced recommendation with hierarchical graph capsule network[J]. Entropy, 2023, 25(4): 697.

[10] TAO S H, QIU R H, CAO Y, et al. Intent with knowledge-aware multiview contrastive learning for recommendation[J]. Complex &Intelligent Systems, 2024, 10(1): 1349-1363.

[11] WANG H W, ZHANG F Z, WANG J L, et al. RippleNet: propagating user preferences on the knowledge graph for recommender systems[C]∥Proceedings of the 27th ACM International Conference on Information and Knowledge Management. New York: ACM, 2018: 417-426.

[12] WANG X, HE X N, CAO Y X, et al. KGAT: knowledge graph attention network for recommendation[C]∥Proceedings of the 25th ACM SIGKDD International Conference on Knowledge Discovery &Data Mining. New York: ACM, 2019: 950-958.

[13] WANG Z, LIN G Y, TAN H B, et al. CKAN[C]∥Proceedings of the 43rd International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM, 2020: 219-228.

[14] CHEN Y K, YANG M L, ZHANG Y X, et al. Modeling scale-free graphs with hyperbolic geometry for knowledge-aware recommendation[C]∥Proceedings of the Fifteenth ACM International Conference on Web Search and Data Mining. New York: ACM, 2022: 94-102.

[15] 王海荣, 徐玺, 王彤, 等. 多模态命名实体识别方法研究进展[J]. 郑州大学学报(工学版), 2024, 45(2): 60-71.

WANG H R, XU X, WANG T, et al. Research progress of multimodal named entity recognition[J]. Journal of Zhengzhou University (Engineering Science), 2024, 45(2): 60-71.

[16] BAI H Y, WU L, HOU M, et al. Multimodality invariant learning for multimedia-based new item recommendation[C]∥Proceedings of the 47th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM, 2024: 677-686.

[17] CUI X H, QU X L, LI D M, et al. MKGCN: multi-modal knowledge graph convolutional network for music recommender systems[J]. Electronics, 2023, 12(12): 2688.

[18] SUN R, CAO X Z, ZHAO Y, et al. Multi-modal knowledge graphs for recommender systems[C]∥Proceedings of the 29th ACM International Conference on Information &Knowledge Management. New York: ACM, 2020: 1405-1414.

[19] SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[EB/OL].(2015-04-10)[2024-06-11]. https:∥arxiv.org/abs/1409.1556v6.

[20] DEVLIN J, CHANG M W, LEE K, et al. BERT: pre-training of deep bidirectional transformers for language understanding[EB/OL]. (2019-05-24)[2024-06-11]. https:∥arxiv.org/abs/1810.04805v2.

[21] MA T, HUANG L T, LU Q Q, et al. KR-GCN: knowledge-aware reasoning with graph convolution network for explainable recommendation[J]. ACM Transactions on Information Systems, 2023, 41(1): 1-27.

[22] DAI Q Y, WU X M, FAN L, et al. Personalized knowledge-aware recommendation with collaborative and attentive graph convolutional networks[J]. Pattern Recognition, 2022, 128: 108628.

[23] ZHANG F Z, YUAN N J, LIAN D F, et al. Collaborative knowledge base embedding for recommender systems[C]∥Proceedings of the 22nd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York: ACM, 2016: 353-362.

[24] WANG H W, ZHAO M, XIE X, et al. Knowledge graph convolutional networks for recommender systems[C]∥The World Wide Web Conference. New York: ACM, 2019: 3307-3313.

[25] LIU X K, YANG B, XU J Y. SKGCR: self-supervision enhanced knowledge-aware graph collaborative recommendation[J]. Applied Intelligence, 2023, 53(17): 19872-19891.

[26] YANG Y H, HUANG C, XIA L H, et al. Knowledge graph contrastive learning for recommendation[C]∥Proceedings of the 45th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM, 2022: 1434-1443.