0 引言

太极拳是一项有益于身心健康的传统武术运动,站桩是其核心基本功,其要领看似简单却内涵深厚,加上涉及外形及内在诸多因素,初学者往往不得要领,更难于坚持,影响了训练时间和效果。而随着现代生活节奏加快,学习和工作压力加大,颈椎病、腰椎病、睡眠障碍等影响身心健康的疾病越来越年轻化,站桩作为一种有效的身心修复运动越来越受到重视。研究站桩要领的数字化表达及评估体系,对于科学训练和反馈、提高训练效能具有重要意义。

目前针对站桩过程数字化表达和评估的文献还鲜有报道,而对太极拳训练有相关研究。蔡建平等[1]设计太极拳考评系统,采用Xsens Moven运动捕捉系统获取数据,通过对比专家和学员的速度、位置等特征参数,辅助学员进行自我学习与评估。Hashimoto等[2]利用Kinect传感器捕捉数据,提出两种太极拳评估方法。其中一种方法将太极拳运动轨迹视为审美曲线,通过曲率对数分布图将曲线划分为5种模式,从而客观评估太极拳的手臂运动;另外一种则是基于互相关函数,通过测量人体手臂和身体的相位差来评估太极拳动作的技术水平。漆才杰等[3]设计太极推手感知互动系统,使用多种不同类型的传感器识别手和脚的运动,通过判断参与者脚步位移状态、倒地状态以及手上动作来客观评估太极推手。薛智宏等[4]设计原地太极拳辅助训练系统,利用Kinect传感器采集数据,建立标准太极拳动作数据库,提取角度、速度等特征参数,使用动态时间规整算法对比学员动作和标准动作的特征给出反馈。此外,该系统还使用Unity 3D人体模型实现对原地太极拳的辅助训练。

虽然对太极拳的研究已经取得初步成果,但仍存在一些问题需要解决。如动作捕捉设备昂贵复杂,且佩戴时影响太极拳练习等。近年来,人体姿态估计技术的快速发展[5-7],为这些问题提供新的解决方案。此外,利用智能方法对站桩进行数字化表达与评估有助于初学者直观理解站桩要领,提高学习效率,为站桩的科学化做出初步探索。因此,本文以站桩为研究对象,以两台摄像机为检测工具,邀请6名太极拳教练和长期练习者为专家组,22名初练者为学员组,重点分析其站桩过程数据,提取人体关键点,创建专家模板特征参数,通过对比学员与专家数据特征差异,建立评估体系,以期在站桩要领数字表达和训练效能评估上创建科学有效的智能分析系统。

1 方法

1.1 人体姿态估计

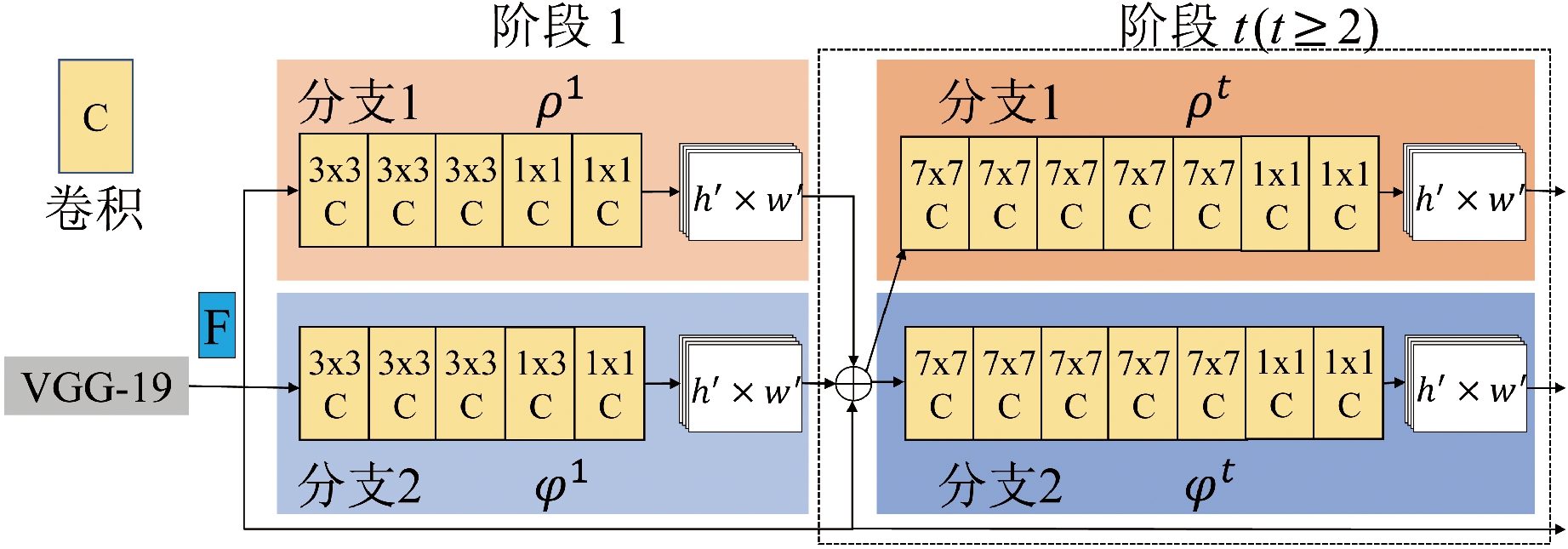

人体关键点定位是人体姿态估计首要解决的问题。为捕捉站桩姿态,本文使用OpenPose[8]识别人体关键点。OpenPose是一种二维人体姿态估计算法。该算法基于深度学习,采用自下而上的方法,利用双分支多阶段神经网络模型对人体关键点进行识别,并通过计算关键点之间的相关性来估计最佳姿态。OpenPose的结构如图1所示。该结构首先基于VGG-19[9]网络提取图像特征;然后第一个分支生成人体关键点置信图,第二个分支生成关键点亲和场;最后连接图像特征、关键点置信图和关键点亲和场,通过多阶段预测生成精细的人体关键点。OpenPose为多种动作分析提供有用信息,如自卫训练[10]、瑜伽识别以及评估[11-12]、康复训练[13]等,可以在不影响识别精度的前提下,降低传统被动标记动作捕捉的复杂性和成本[14]。

图1 OpenPose网络结构

Figure 1 Architecture of OpenPose network

1.2 站桩数字化表达

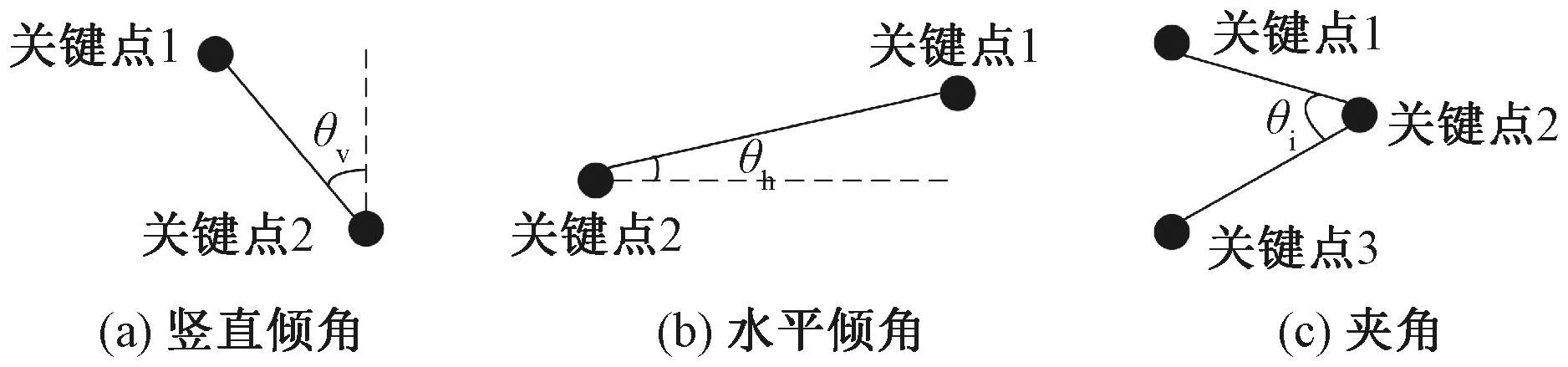

人体姿态估计完成后,确定特征参数对站桩进行数字化表达。特征参数要能直观准确地反映站桩要领。本文选取角作为表达站桩要领的特征参数,可以降低由于个体体型不一致造成的影响,如图2所示。角包含倾角和夹角:倾角分为竖直倾角(关键点1和2连线的向量和竖直方向之间的角度)和水平倾角(关键点1和2连线的向量和水平方向之间的角度);夹角为关键点1、3和关键点2连线形成的以关键点2为顶点的角度。

图2 倾角和夹角

Figure 2 Inclination and included angle

设关键点1、2、3坐标分别为P1=(x1,y1)、P2=(x2,y2)、P3=(x3,y3),关键点之间的向量为l1,2=[x1-x2,y1-y2]T、l3,2=[x3-x2,y3-y2]T。竖直方向的向量用单位向量e1=[0,-1]T表示,水平方向向量为e2=[1,0]T。竖直倾角θv、水平倾角θh、夹角θi由式(1)~(3)计算。

(1)

(2)

(3)

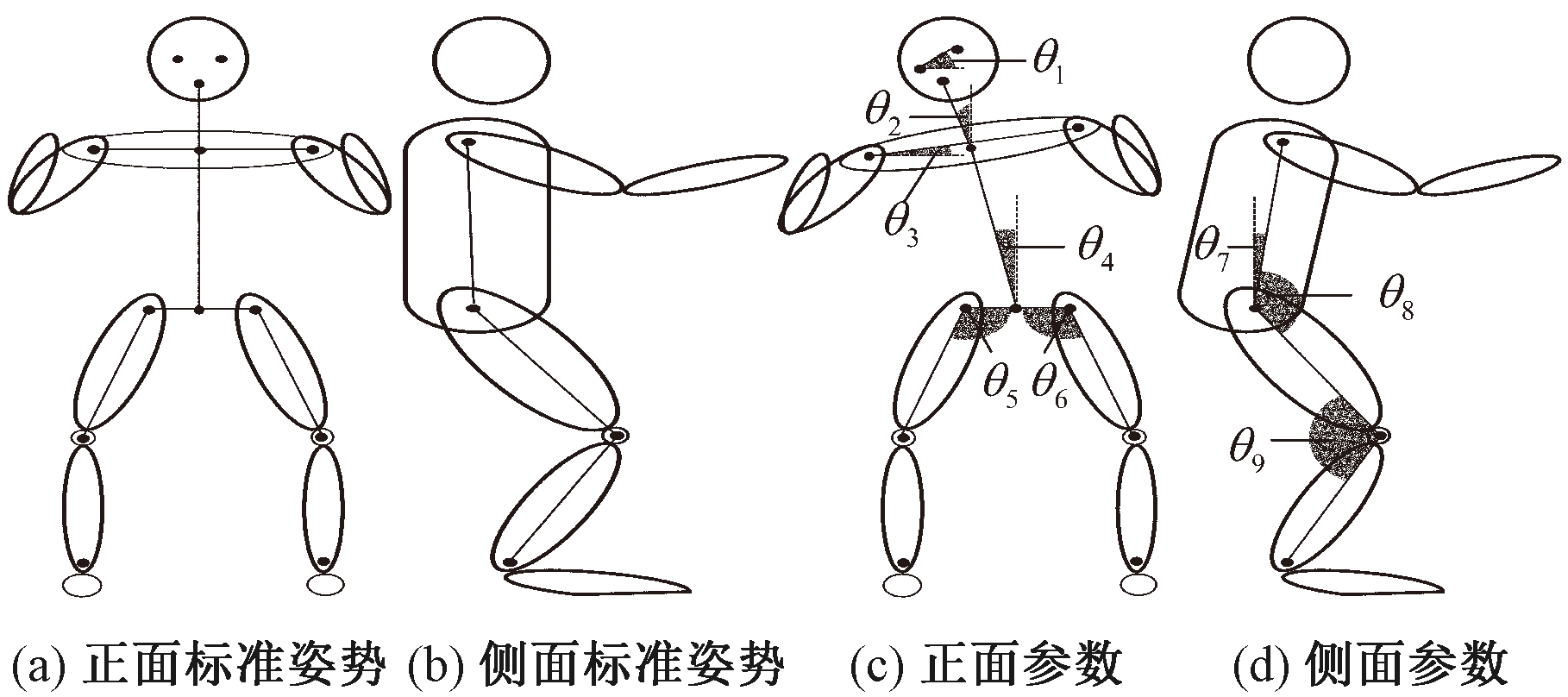

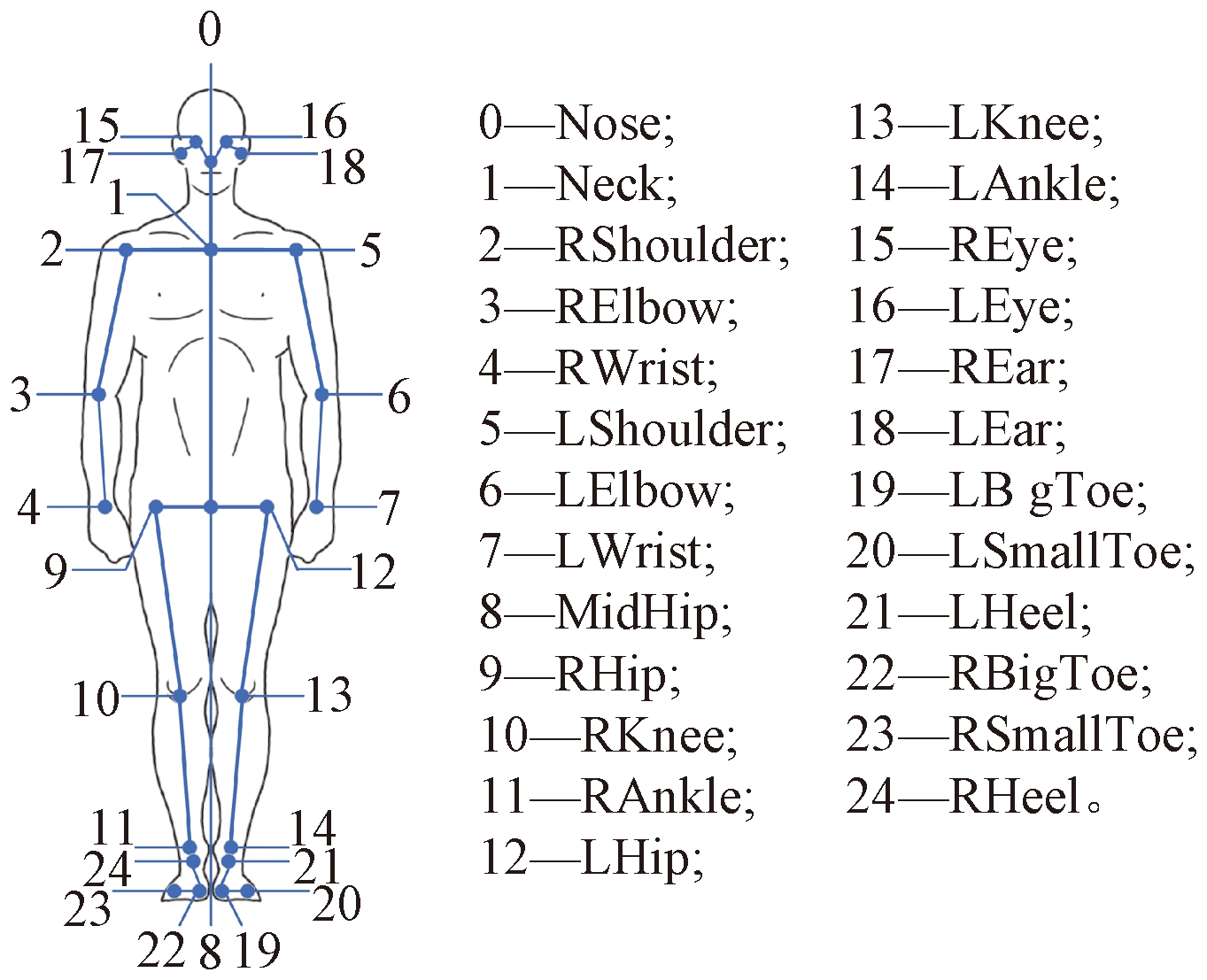

本文以站桩的3个要领立身中正、屈膝坐胯、松胯圆裆为例,从正面和侧面两个视角确定特征参数。站桩要求立身中正,即头、颈、肩、躯干等要不偏不倚,不能前俯后仰、左右歪斜。根据上述要求确定正面头部水平倾角、正面头部竖直倾角、正面肩膀水平倾角、正面躯干竖直倾角、侧面躯干竖直倾角作为表达立身中正的特征参数。站桩要求屈膝坐胯,表达此要领的特征参数从侧面确定。侧面躯干大腿夹角、侧面膝关节夹角被确定为表达屈膝坐胯的特征参数。站桩还要求松胯圆裆,其做法为:两胯分开,略呈拱形。正面髋关节夹角被确定为表达松胯圆裆的特征参数。各特征参数定义如表1所示,标准站桩姿势及参数示意如图3所示,关键点的名称和顺序如图4所示。

图3 标准站桩姿势和特征参数示意图

Figure 3 Schematic diagram of standard posture of standing stake and characteristic parameters

图4 关键点的名称和顺序

Figure 4 Names and order of keypoints

表1 特征参数的定义

Table 1 Definition of characteristic parameters

视角参数定义正面头部水平倾角θ1右眼睛(REye)到左眼睛(LEye)的向量与水平向量之间的角度头部竖直倾角θ2颈部(Neck)到鼻子(Nose)的向量与竖直向量之间的角度肩膀水平倾角θ3右肩膀(RShoulder)到左肩膀(LShoulder)的向量与水平向量之间的角度躯干竖直倾角θ4脊椎底部点(MidHip)到颈部(Neck)的向量与竖直向量之间的角度左/右髋关节夹角θ6/θ5左/右髋关节(L/RHip)到脊柱底部点(MidHip)的向量与左/右髋关节(L/RHip)到左/右膝关节(L/RKnee)的向量之间的角度侧面躯干竖直倾角θ7右髋关节(RHip)到右肩膀(RShoulder)的向量与竖直向量之间的角度躯干大腿夹角θ8右髋关节(RHip)到右肩膀(RShoulder)的向量与右髋关节(RHip)到右膝关节(RKnee)的向量之间的角度膝关节夹角θ9右膝关节(RKnee)到右髋关节(RHip)的向量与右膝关节(RKnee)到右踝关节(RAnkle)的向量之间的角度

1.3 评估指标的确定

1.3.1 特征参数评估指标

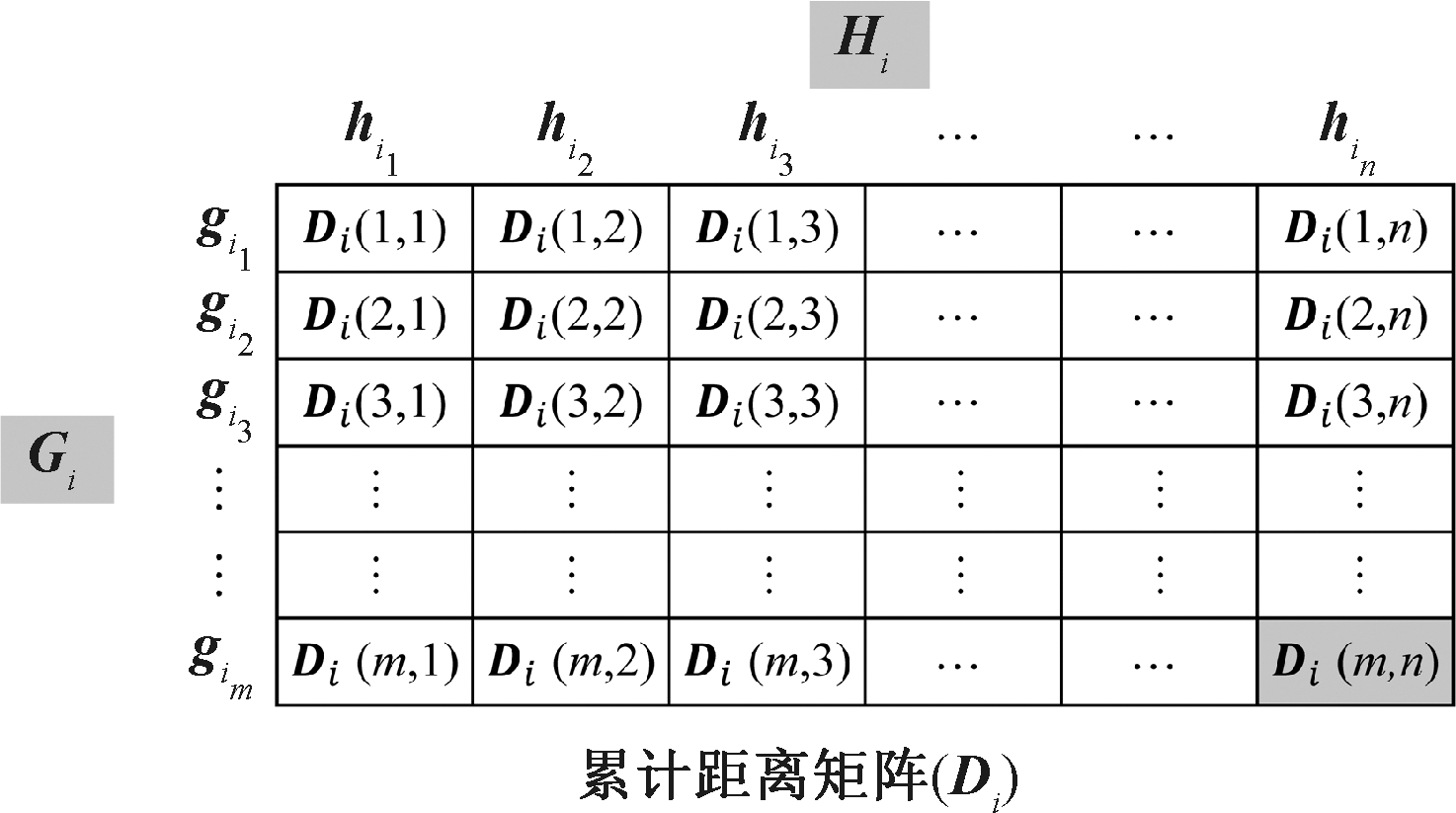

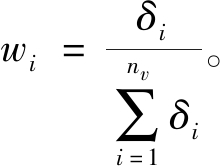

偏离度是评估学员与专家之间参数相似程度的指标,采用动态时间规整算法(dynamic time warping,DTW)计算。DTW[15-16]是一种模板匹配算法,通过伸缩时间序列,计算测试样本和标准样本之间的匹配度,将匹配过程中两个样本间累计距离最短的路径视为最优路径,用最短累计距离评估两个样本的相似性。本文以专家特征参数序列为标准样本,学员特征参数序列为测试样本。设专家特征参数序列为Gi=[gi1,gi2,…,gip,…,gim-1,gim],学员特征参数序列为Hi=[hi1,hi2,…,hiq…,hin-1,hin]。首先创建累计距离矩阵,如图5所示,矩阵中的元素由式(4)~(7)计算。

图5 累计距离矩阵

Figure 5 Cumulative distance matrix

Di(1,1)=|gi1-hi1| ;

(4)

Di(1,q)=|gi1-hiq|+Di(1,q-1),q∈[2,n];

(5)

Di(p,1)=|gip-hi1|+Di(p-1,1),p∈[2,m];

(6)

p∈[2,m],q∈[2,n]。

(7)

式中:m为专家特征参数序列的长度;n为学员特征参数序列的长度。累计距离矩阵最后一个元素Di(m,n)即为两个参数序列之间的距离。偏离度di如式(8)所示:

di=Di(m,n),i∈[1,nv]。

(8)

式中:nv为特征参数的数目。

非标准站桩姿态会导致参数出现极值,各参数在阈值内的时间占比可以评估参数效率。首先统计专家的特征参数,采用百分位阈值法确定各参数的上下界Tit、Til,然后通过判别分析法[17]将学员各特征参数分为阈值内和阈值外两类。假设学员的参数为Hi=[hi1,hi2,…,hiq,…,hin-1,hin]。如果Til≤hiq≤Tit,则hiq属于阈值内参数ci1;否则hiq属于阈值外参数ci2。最后参数阈值内时间占比ri通过式(9)得出。

![]()

(9)

式中:count为计数符号;n为学员特征参数序列的长度;nv为特征参数的数目。

1.3.2 站桩质量评估指标

为探究各特征参数对站桩的重要性以及全面评估站桩,定义两个站桩质量评估指标:整体偏离度dsum和整体效率rsum,由式(10)、(11)计算。

(10)

(11)

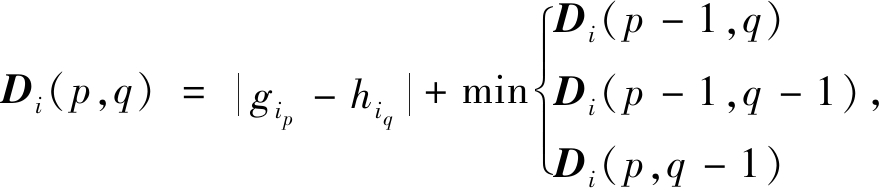

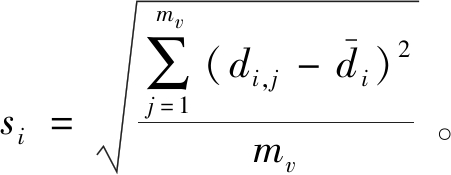

式中:nv为特征参数的数目;di为偏离度评估指标;ri为站桩效率评估指标;权重wi、ki通过变异系数法确定。变异系数法是对多个指标进行综合评估的一种客观赋权法,该方法利用各指标的变异程度来确定权重。以偏离度di为例,设每个偏离度指标包含mv次结果,则偏离度矩阵为Dd=(di,j)nv×mv。偏离度di的平均值![]() 和标准差si由式(12)、(13)计算。

和标准差si由式(12)、(13)计算。

(12)

(13)

变异系数δi由式(14)计算,权重wi由式(15)计算。权重ki计算过程和wi一致。

(14)

(15)

2 实验与结果

2.1 参与者筛选

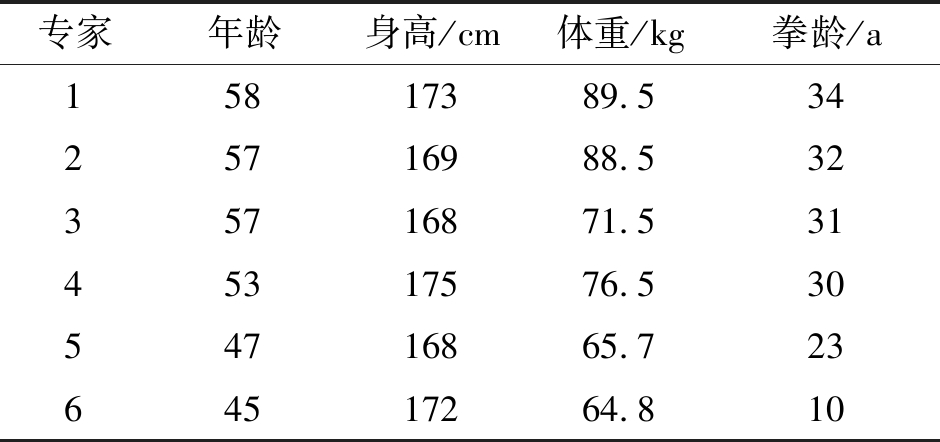

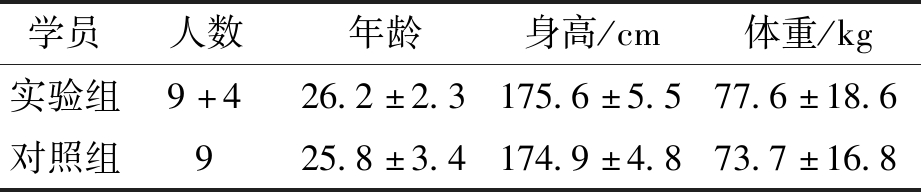

6名太极拳专家和22名学员被邀请参与这项研究。其中13名学员是在研究开始时受邀作为实验组参与研究。在研究期间,跟踪实验组学员的站桩数据,每月采集一次数据,为期8个月,并使用数字化评估方法辅助站桩训练,其中实验组中的4人由于个人原因,只参与5个月的数据采集,其余9人参与8个月的数据采集。对照组的学员是在研究结束时受邀参与研究,且对照组学员均采用传统方式进行练习。为控制变量,对照组共邀请9名学员且学员练习站桩的平均时间为8个月,对照组学员的数据不进行跟踪。所有参与者在过去一年中没有受伤史。参与者的基本信息如表2、表3所示。

表2 专家的基本信息

Table 2 Basic information of experts

专家年龄身高/cm体重/kg拳龄/a15817389.53425716988.53235716871.53145317576.53054716865.72364517264.810

表3 学员的基本信息

Table 3 Basic information of students

学员人数年龄身高/cm体重/kg实验组9+426.2±2.3175.6±5.577.6±18.6对照组925.8±3.4174.9±4.873.7±16.8

2.2 视频采集和人体姿态估计

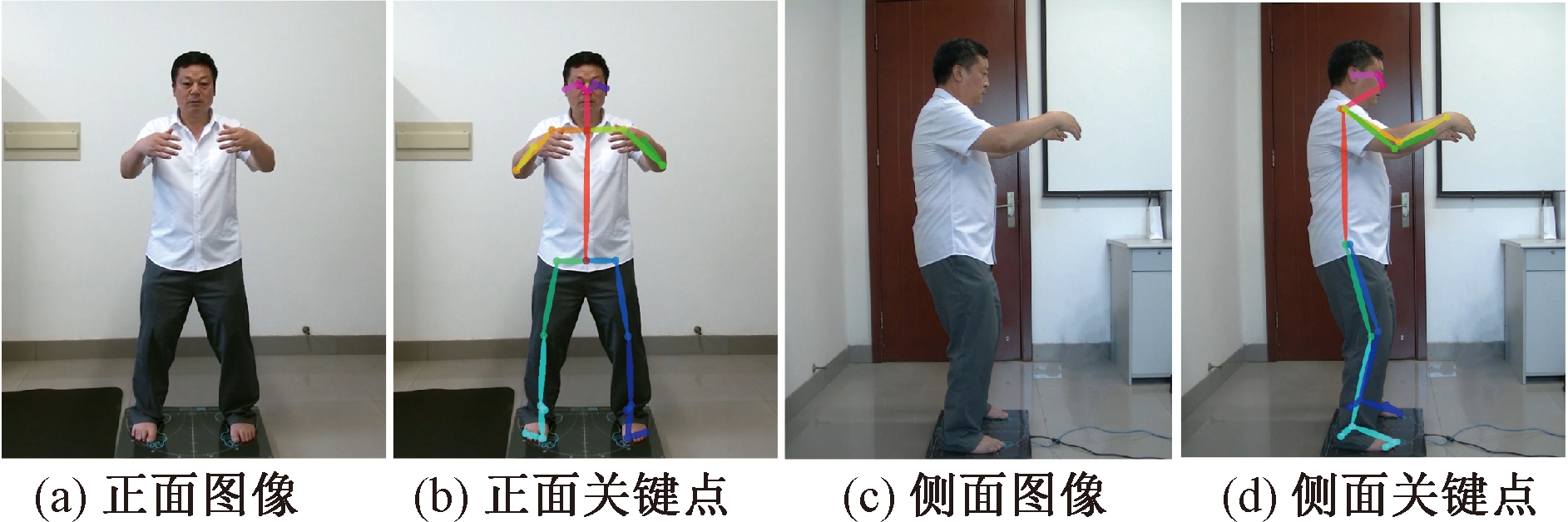

视频采集实验场景由两台固定摄像机组成。两台摄像机分别放置在参与者的正面和侧面,分辨率为1 920×1 080像素,帧率为30帧/s,确保两台摄像机的光轴线互相垂直并且其视野能充分捕捉到参与者的全身。视频采集完成后,两个视角的视频在时间轴上对齐。图6(a)、6(c)为两种不同视角下的站桩图像,图6(b)、6(d)为OpenPose处理后的图像。由于人体关键点是通过OpenPose从视频中逐帧提取,本研究通过仿射变换将得到的关键点进行转换,得到同一基准下的视频关键点序列。

图6 站桩图像和姿态估计

Figure 6 Standing stake images and pose estimation

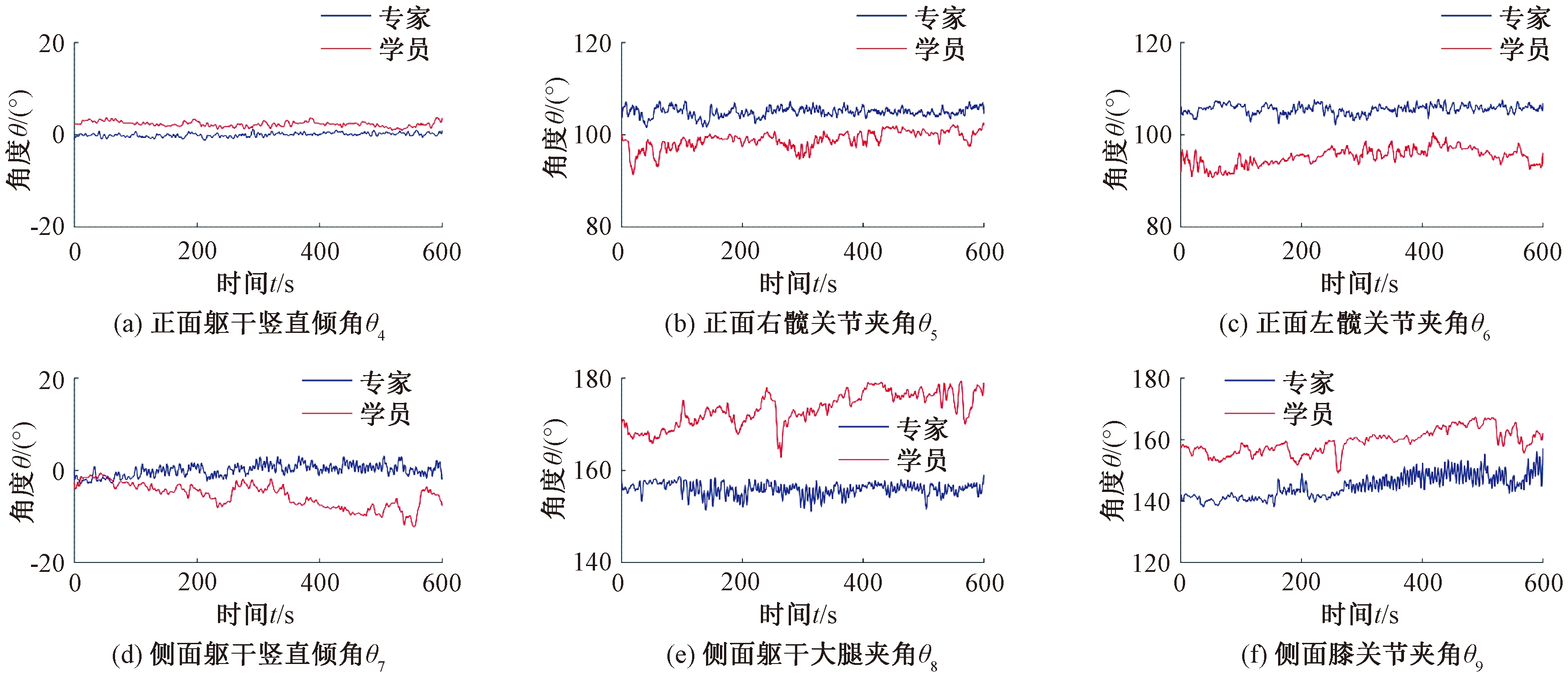

2.3 特征参数分析

本文展示部分专家和学员的特征参数变化曲线,如图7所示,倾角角度为正,说明倾角的方向为顺时针,反之为逆时针。可以看出,在站桩过程中,专家的参数较平稳,而学员的参数波动较大。如图7(a)所示,在正面,相对于专家,学员在站桩过程中有向一侧倾斜的趋势;如图7(b)、7(c)所示,在正面,该学员站桩过程中髋关节夹角要小于专家,说明在站桩时,学员的两胯没有充分展开;如图7(d)所示,学员在侧面有向后倾的趋势,且程度逐渐加深;如图7(e)、7(f)所示,在侧面,该学员站桩过程中的躯干大腿夹角和膝关节夹角大于专家,说明站桩过程中该学员屈膝坐胯的程度有待提高。

图7 专家和学员站桩过程中部分特征参数的变化曲线

Figure 7 Variation curve of some characteristic parameters of expert and student during standing stake

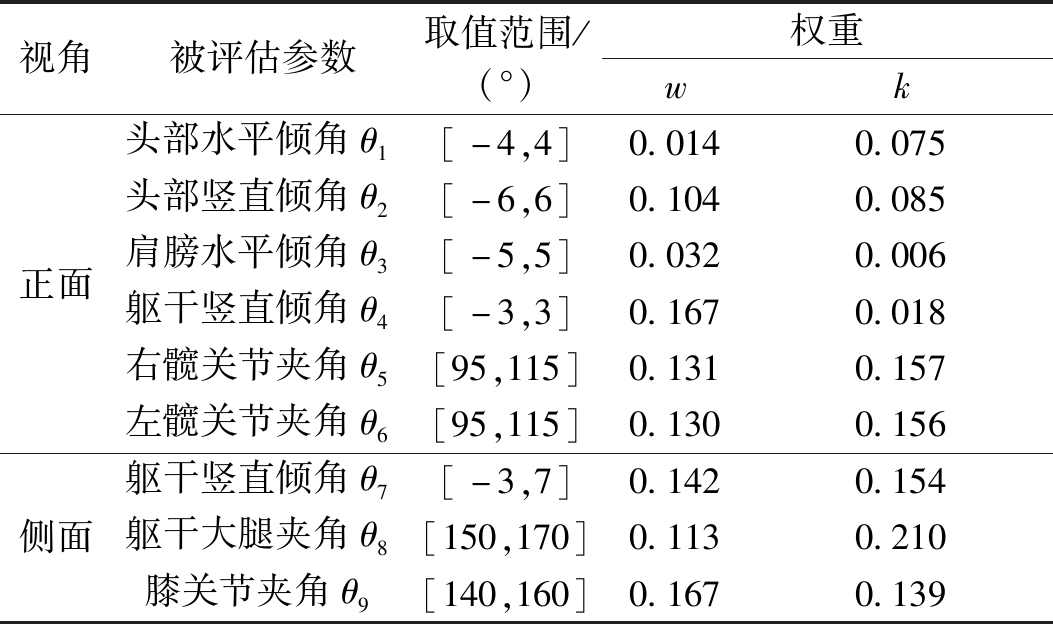

将所有专家特征参数按数值从小到大排序,取5%~95%的特征参数结合人体正面身体部位是对称的这一事实来定义各参数的标准范围,如表4所示。

表4 特征参数的范围以及权重

Table 4 Range and weight of characteristic parameters

视角被评估参数取值范围/(°)权重wk正面头部水平倾角θ1[-4,4]0.0140.075头部竖直倾角θ2[-6,6]0.1040.085肩膀水平倾角θ3[-5,5]0.0320.006躯干竖直倾角θ4[-3,3]0.1670.018右髋关节夹角θ5[95,115]0.1310.157左髋关节夹角θ6[95,115]0.1300.156侧面躯干竖直倾角θ7[-3,7]0.1420.154躯干大腿夹角θ8[150,170]0.1130.210膝关节夹角θ9[140,160]0.1670.139

2.4 特征参数长期评估

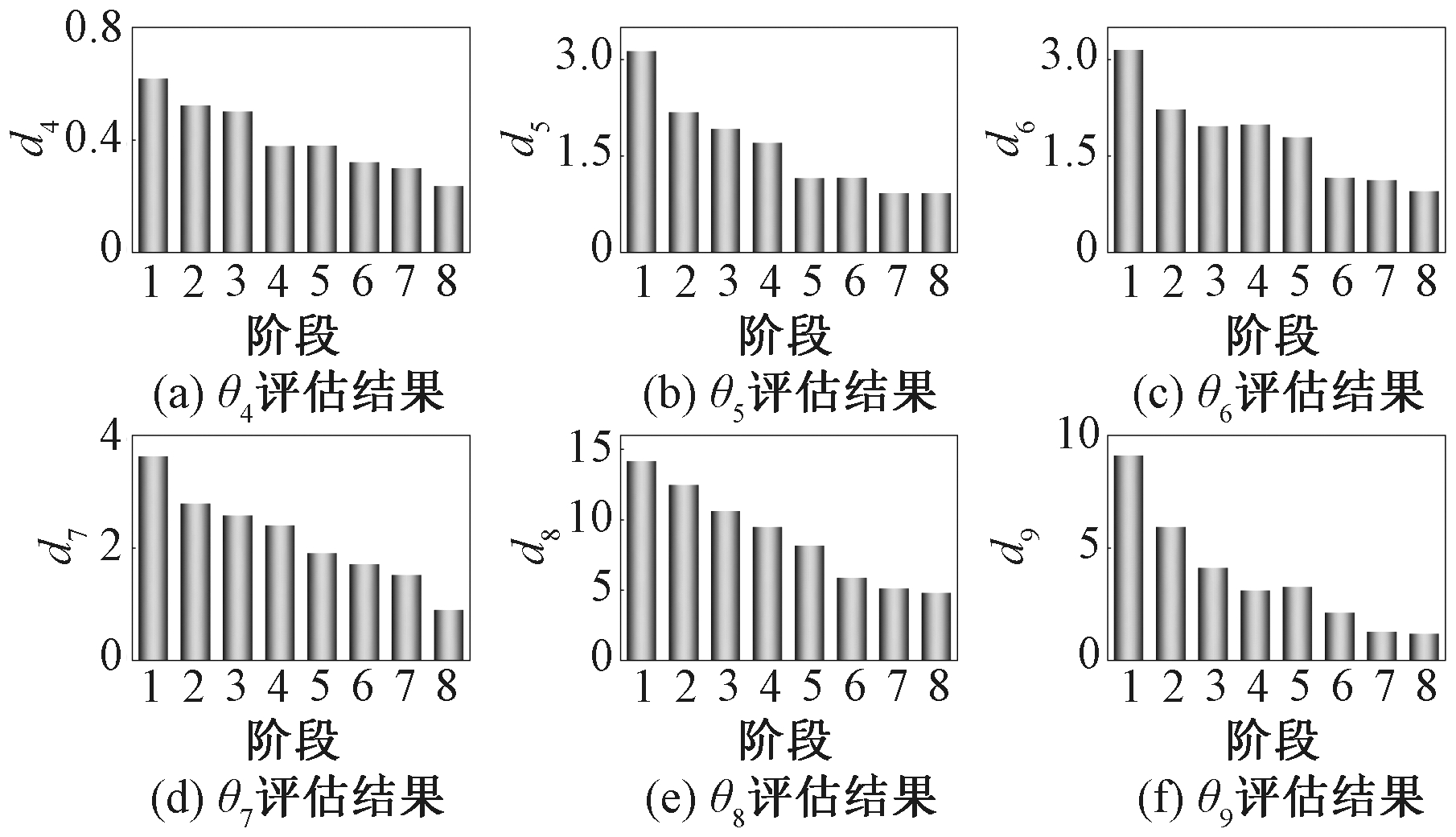

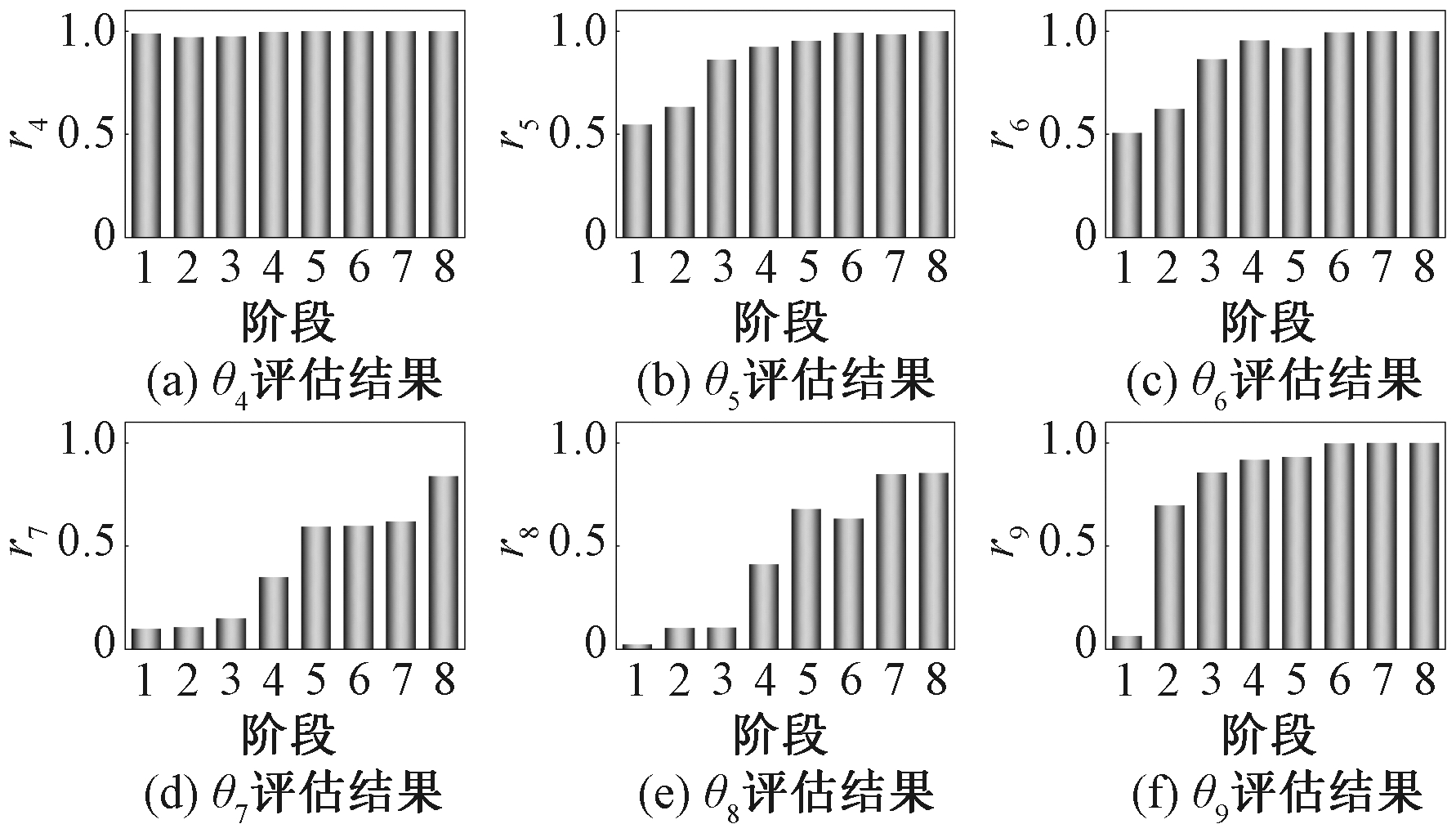

本文展示某名学员特征参数的长期评估结果如图8、9所示。每张分图中的横轴为阶段数,纵轴为每个阶段对应参数的评估结果。偏离度评估结果如图8所示,d越小,学员与专家特征参数的相似性越高。当作为标准指导学员训练时,应特别关注同一特征参数偏离度较大的阶段,说明这一阶段学员的特征参数与专家有较大的偏差。站桩效率评估结果如图9所示,r越大,表明站桩效率越高。当作为结果指导学员训练时,应特别注意同一特征参数效率值较小的阶段,说明学员这一阶段特征参数极端值的占比较大。根据偏离度和效率的评估结果可以有针对性地分析学员的特征参数并给出合理建议。

图8 某学员部分参数偏离度的长期评估结果

Figure 8 Long-term evaluation result of some parameter deviation of a student

图9 某学员部分参数效率的长期评估结果

Figure 9 Long-term evaluation result of some parameter efficiency of a student

基于全部学员所有阶段的特征参数评估结果以及变异系数法计算的各特征参数权重,得到的两类权重如表4所示。权重越大,变异程度越高,代表所评估的特征参数越重要,反之亦然。结合两种权重可以发现侧面躯干大腿夹角、侧面膝关节夹角、侧面躯干竖直倾角、正面髋关节夹角是更为重要的特征参数,意味着初学者在站桩训练过程中要更加注意躯干、大腿、膝关节、髋关节等身体部位的变化情况。

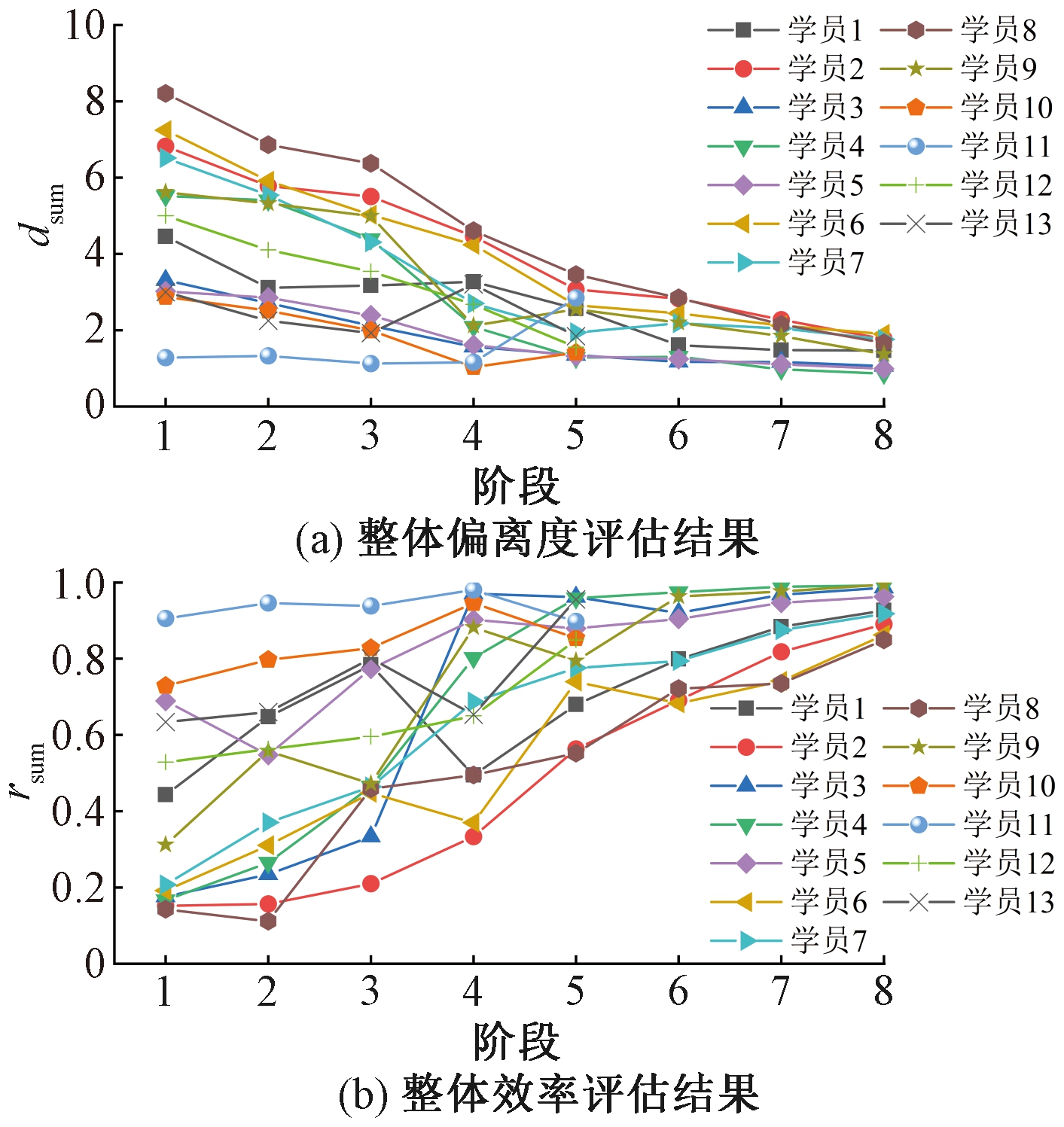

实验组学员站桩质量的评估结果如图10所示。横轴代表阶段数,纵轴为每阶段的站桩质量评估结果。整体偏离度评估结果如图10(a)所示,dsum越小,学员与专家整体相似性越高;整体效率评估结果如图10(b)所示,rsum越大,代表学员站桩的整体效率越高。可以看出,学员特征参数的整体偏离度呈下降趋势,整体效率呈上升趋势,学员的站桩质量在不断提高,说明构建的站桩数字化表达与评估体系能够有效地辅助初学者进行站桩的训练。

图10 实验组学员站桩质量长期评估结果

Figure 10 Long-term evaluation results of standing stake quality of students in the experimental group

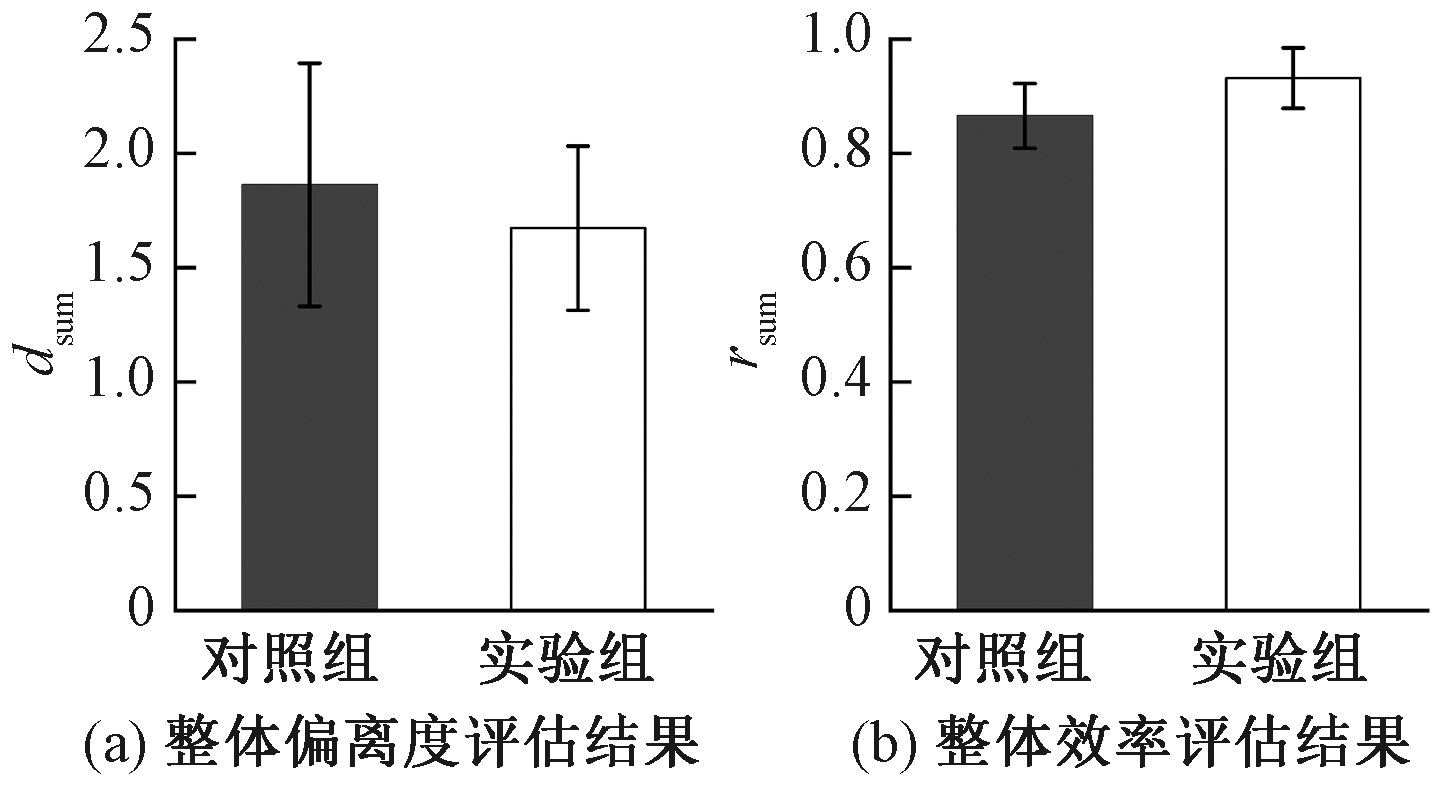

2.5 对比实验结果分析

由以上结果可知,实验组学员的站桩质量得到了明显提升,为探究数字化表达与评估体系在指导学员站桩训练效果方面与传统方法的差异,本文设计了对照实验。分别统计对照组学员的站桩质量评估结果和实验组成员最后一个阶段的站桩质量评估结果,并通过对比两组学员的站桩质量,探究两种方式对于站桩的有效性。统计方式用均值和标准差表示,如图11所示。从图11(a)中可以看出,实验组学员的整体偏离度评估结果要低于对照组,说明实验组学员的参数和专家参数整体上的相似度更高,动作更标准;从图11(b)中可以看出,实验组学员的整体效率评估结果要高于对照组,说明实验组学员参数出现极端值的情况在总体上好于对照组。综上所述,数字化表达与评估方式的训练效果要优于传统方式,说明构建的数字化表达与评估体系可以有效地代替传统辅助训练方式。

图11 两组学员的站桩质量评估结果统计

Figure 11 Statistics of standing stake quality evaluation results of two groups of students

3 结论

本文基于人体姿态估计技术构建的站桩数字化表达与评估体系可以弥补传统站桩表达评估方式的抽象性和主观性等缺陷,科学辅助站桩训练。该体系无须使用昂贵的动作捕捉设备和复杂的标记,OpenPose用于从视频中估计人体姿态,根据站桩要领确定用于数字化表达的关键特征参数,动态时间规整算法和判别分析法用于计算各特征参数评估指标。此外,变异系数法用于探索各特征参数的重要性并计算站桩质量评估指标。通过跟踪反馈学员的站桩数据以及对比实验,验证了数字化表达与评估体系对于辅助训练的有效性。

站桩是一个相对复杂的过程,还需要更深入的挖掘。如髋关节是站桩过程中非常重要的身体部位,是身体放松的关键。本文得到4个重要身体部位依次是躯干、大腿、膝关节和髋关节,一方面与髋关节活动范围小有关,另一方面也由检测方式的特点所致。为更全面分析站桩过程,后续还做了关于足底压力检测和肌电检测的实验及分析,对站桩特征进行更深入的描述和表达,这些工作会陆续总结和呈现。

[1] 蔡建平,淮湛欣.太极拳运动考评软件的设计与实现[J].软件,2012,33(3):60-63.

CAI J P,HUAI Z X.Design &implementation of Taiji motion appraisal system[J].Software,2012,33(3):60-63.

[2] HASHIMOTO H,NAKAJIMA M,KAWATA S,et al.Skill level evaluation of Taijiquan based on 3D body motion analysis[C]//2014 IEEE International Conference on Industrial Technology.Piscataway:IEEE,2014:712-717.

[3] 漆才杰,戴国斌.太极(定步)推手动作识别系统的设计与研制[J].武汉体育学院学报,2015,49(8):52-56.

QI C J,DAI G B.Design and development of Taichi pushing hands (with fixed-foot stance) movements recognition system[J].Journal of Wuhan institute of physical education,2015,49(8):52-56.

[4] 薛智宏,张利英,程振华,等.基于Kinect的原地太极拳辅助训练系统[J].河北科技大学学报,2017,38(2):183-189.

XUE Z H,ZHANG L Y,CHENG Z H,et al.Research of Tai-Chi-Chuan auxiliary training system based on Kinect[J].Journal of Hebei university of science and technology,2017,38(2):183-189.

[5] TOMPSON J J,JAIN A,LECUN Y,et al.Joint training of a convolutional network and a graphical model for human pose estimation[EB/OL].(2014-09-17)[2021-11-08].https://arxiv.org/abs/1406.2984.

[6] NING G H,ZHANG Z,HE Z Q.Knowledge-guided deep fractal neural networks for human pose estimation[J].IEEE transactions on multimedia,2018,20(5):1246-1259.

[7] 陈梦婷,王兴刚,刘文予.基于密集深度插值的3D人体姿态估计方法[J].郑州大学学报(工学版),2021,42(3):26-32.

CHEN M T,WANG X G,LIU W Y.Dense depth interpolation for 3D human pose estimation[J].Journal of Zhengzhou university (engineering science),2021,42(3):26-32.

[8] CAO Z,HIDALGO G,SIMON T,et al.OpenPose:realtime multi-person 2D pose estimation using part affinity fields[J].IEEE transactions on pattern analysis and machine intelligence,2021,43(1):172-186.

[9] SIMONYAN K,ZISSERMAN A.Very deep convolutional networks for large-scale image recognition[EB/OL].(2015-04-10)[2021-11-08].https://arxiv.org/abs/1409.1556.

[10] KHAN A,HARIS M,NADEEM S S,et al.Virtual self defense trainer-analyzing and scoring user pose[C]//2020 International Congress on Human-Computer Interaction,Optimization and Robotic Applications.Piscataway:IEEE,2020:1-5.

[11] YADAV S K,SINGH A,GUPTA A,et al.Real-time Yoga recognition using deep learning[J].Neural computing and applications,2019,31(12):9349-9361.

[12] THAR M C,WINN K Z N,FUNABIKI N.A proposal of Yoga pose assessment method using pose detection for self-learning[C]//2019 International Conference on Advanced Information Technologies (ICAIT).Piscataway:IEEE,2019:137-142.

[13] 唐心宇,宋爱国.人体姿态估计及在康复训练情景交互中的应用[J].仪器仪表学报,2018,39(11):195-203.

TANG X Y,SONG A G.Human pose estimation and its implementation in scenario interaction system of rehabilitation training[J].Chinese journal of scientific instrument,2018,39(11):195-203.

[14] TAKEDA I,YAMADA A,ONODERA H.Artificial Intelligence-assisted motion capture for medical applications:a comparative study between markerless and passive marker motion capture[J].Computer methods in biomechanics and biomedical engineering,2021,24(8):864-873.

[15] GIORGINO T.Computing and visualizing dynamic time warping alignments in R:the dtw package[J].Journal of statistical software,2009,31(7):1-24.

[16] YU X Q,XIONG S P.A dynamic time warping based algorithm to evaluate Kinect-enabled home-based physical rehabilitation exercises for older people[J].Sensors,2019,19(13):2882.

[17] 张勇,党兰学.线性判别分析特征提取稀疏表示人脸识别方法[J].郑州大学学报(工学版),2015,36(2):94-98.

ZHANG Y,DANG L X.Sparse representation-based face recognition method by LDA feature extraction[J].Journal of Zhengzhou university (engineering science),2015,36(2):94-98.