0 引言

遥感图像超分辨率重建是对具有互补信息的低分辨率遥感图像进行处理,来获得高分辨率遥感图像的技术[1]。遥感图像是遥感技术的数据支撑和应用基础[2],为监视地球表面提供了丰富的信息,在灾害监控、城市经济水平评估、资源勘探等领域具有广泛的应用。目前从卫星获得的遥感图像质量无法满足地物目标识别、土地检测等应用的需求[3-4],并且从硬件上着手提升遥感图像成本高、难度大,因此尝试从软件上通过图像处理技术使遥感影像分辨率得以提升,以较小的经济代价改善影像分辨率,提高影像利用效益。由此可见,遥感图像超分辨率重建技术的研究具有重要的研究意义。

随着深度学习的发展,人们将深度学习方法用于图像超分辨率重建,该方法提升了超分辨率算法的重建效果并且克服了传统算法的缺点。深度学习方法在自然图像超分辨率重建上的成功让很多遥感领域的学者将它应用在遥感图像超分辨率重建中,并且取得了不错的效果。

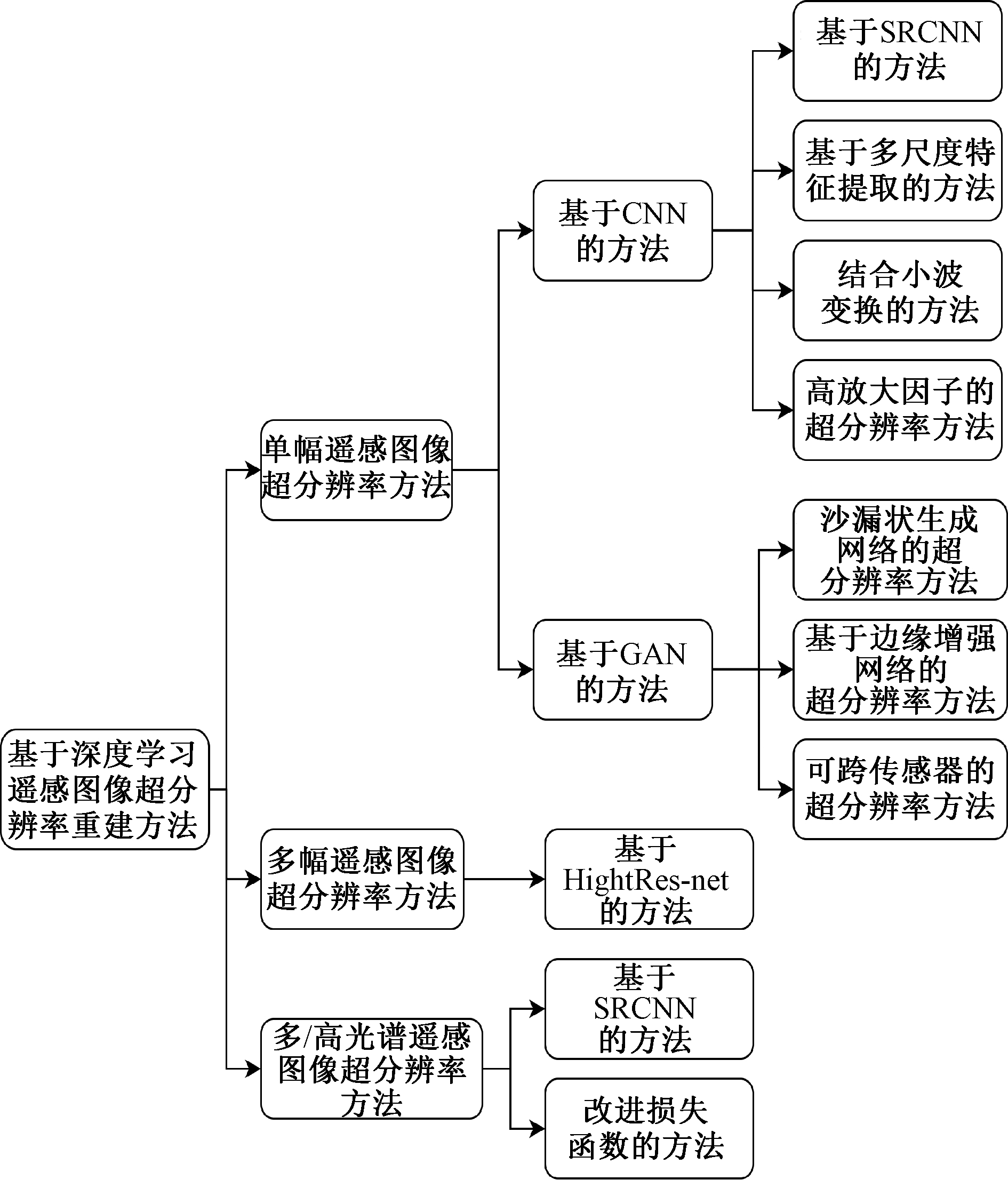

随着基于深度学习的遥感图像超分辨率重建问题研究的深入,大量方法不断出现。一些学者对该领域工作进行了综述[5-6],但涉及算法种类少,分类不够全面。因此,本文在前人工作的基础上,对基于深度学习的遥感图像超分辨率重建方法进行系统总结,总体框架如图1所示。

图1 基于深度学习的遥感图像超分辨率重建方法框架图

Figure 1 Fram diagram classification of super-resolution reconstruction method of remote sensing image based on deep learing

1 基于深度学习的遥感图像超分辨率重建方法渊源

传统的遥感图像超分辨率重建方法主要有3类:频域法、空域法和频域-空域结合的方法。频域法主要分为频谱解混叠算法、递归最小二乘法等,基于的理论前提过于理想化,不能有效地应用于多个场合,所以目前这类方法已不再成为研究的主流;空域法虽然灵活性好,但是涉及帧内运动模糊、光学模糊以及其他复杂的降质模型等诸多因素,导致其优化方法复杂,计算的代价大,不能成为主流的方法;频域-空域结合的方法虽然结合了频域法和空域法的优势,但运算复杂,计算量大,也不能成为主流的方法[7]。

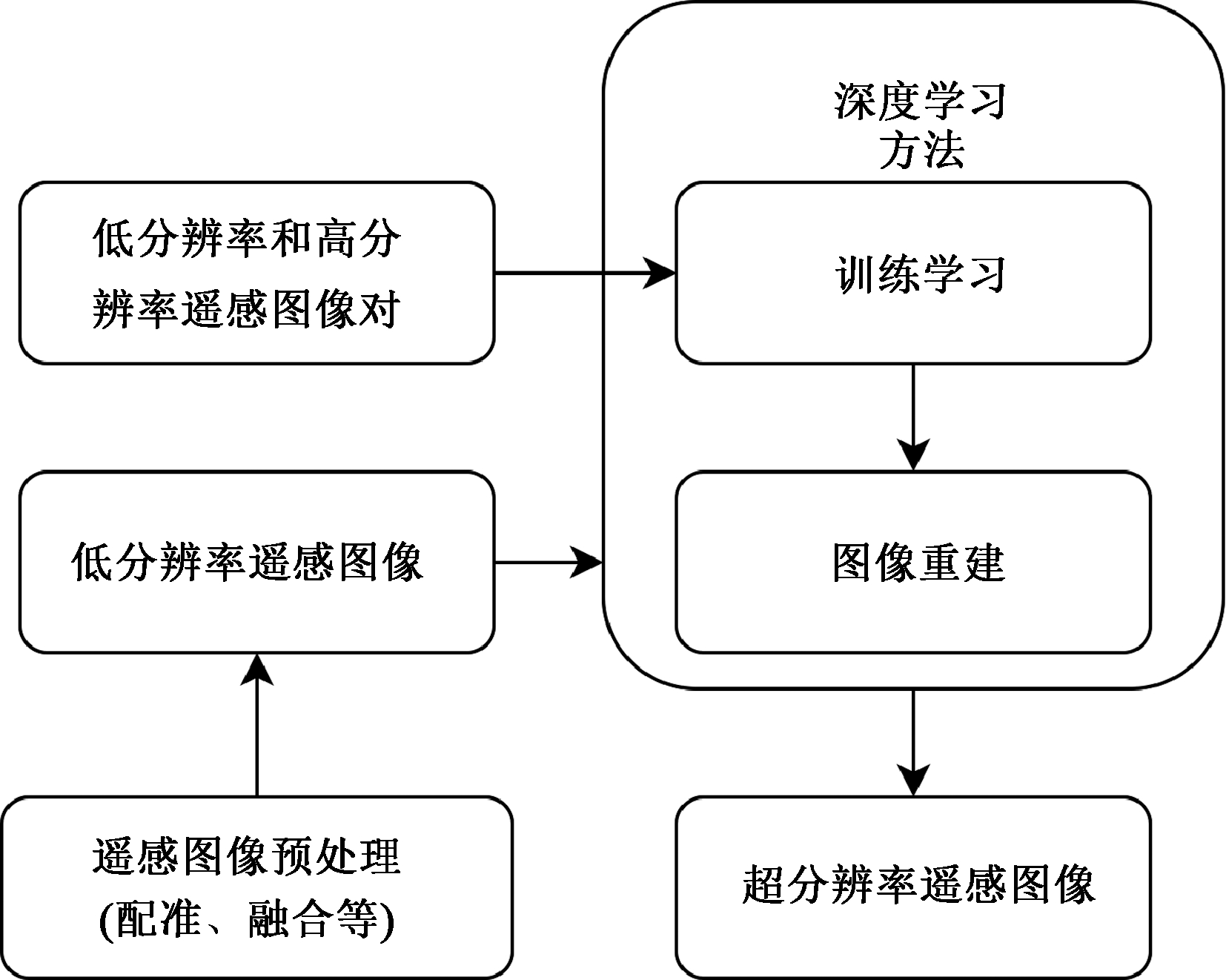

基于深度学习的图像超分辨率重建方法最先由Dong等[8]于2016年提出,深度学习方法打破了频域法、空域法和频域-空域法的局限性,在重建效果上有了很大的提升,该方法步骤如图2所示。先将低分辨率和高分辨率遥感图像对送入深度学习方法中进行学习训练,得到低分辨率和高分辨率遥感图像之间的关系,再将低分辨率遥感图像送入训练好的深度模型中,得到重建后的超分辨率遥感图像。目前,最常用的基于深度学习的遥感图像超分辨率重建方法主要有2种架构,分别是基于CNN(convolutional neural networks)的方法和基于GAN(generative adversarial network)的方法,在这些架构基础上,研究者们根据遥感图像的不同特点,设计、组合不同的模块来提高遥感图像的超分辨率重建效果[9]。

图2 基于深度学习的遥感图像超分辨率重建步骤

Figure 2 Steps of super-resolution reconstruction of remote sensing image based on deep learning

2 基于深度学习的单幅遥感图像超分辨率重建

单图像超分辨率重建方法可以有效地用于一般的分类、目标检测和对象提取等计算机视觉任务的预处理操作。目前单幅遥感图像超分辨率重建常常采用CNN和GAN两种网络。

2.1 基于CNN的单幅遥感图像超分辨率重建

在遥感图像超分辨率重建领域,有3种最常用的CNN架构,分别为SRCNN(deep convolutional networks for super-reselution)、VDSR[10](very deep convolutional networks for super-reselution)和EDSR[11](enhanced deep residual networks for super-reselution),这3种方法在自然图像的超分辨率重建上均取得了不错的效果。SRCNN是第一个将CNN应用于超分辨率问题的方法;VDSR在SRCNN的基础上引入了残差网络,扩展了SRCNN的功能;EDSR是目前通用图像超分辨率重建性能最好的方法之一。在这些架构的基础上,根据各种遥感图像超分辨率重建任务的独特性,研究者们设计出了不同模型,本节将给出其中具有代表性的几种网络模型。

2.1.1 基于SRCNN的遥感图像超分辨率重建

Liebel等[12]首次提出将SRCNN用于单幅遥感图像超分辨率重建。在这项工作中,使用专门设计的由Sentinel-2遥感图像组成的数据集来训练SRCNN。结果表明,该方法比传统的双三次插值方法取得的效果好,并且速度快、易于训练,这也说明了基于深度学习方法的有效性。但是该方法没有考虑遥感图像尺度多样性的特点,所以重建效果不太明显,于是人们根据遥感图像的尺度多样性特点,提出了许多基于多尺度特征提取的方法。

2.1.2 基于多尺度特征提取的遥感图像超分辨率重建

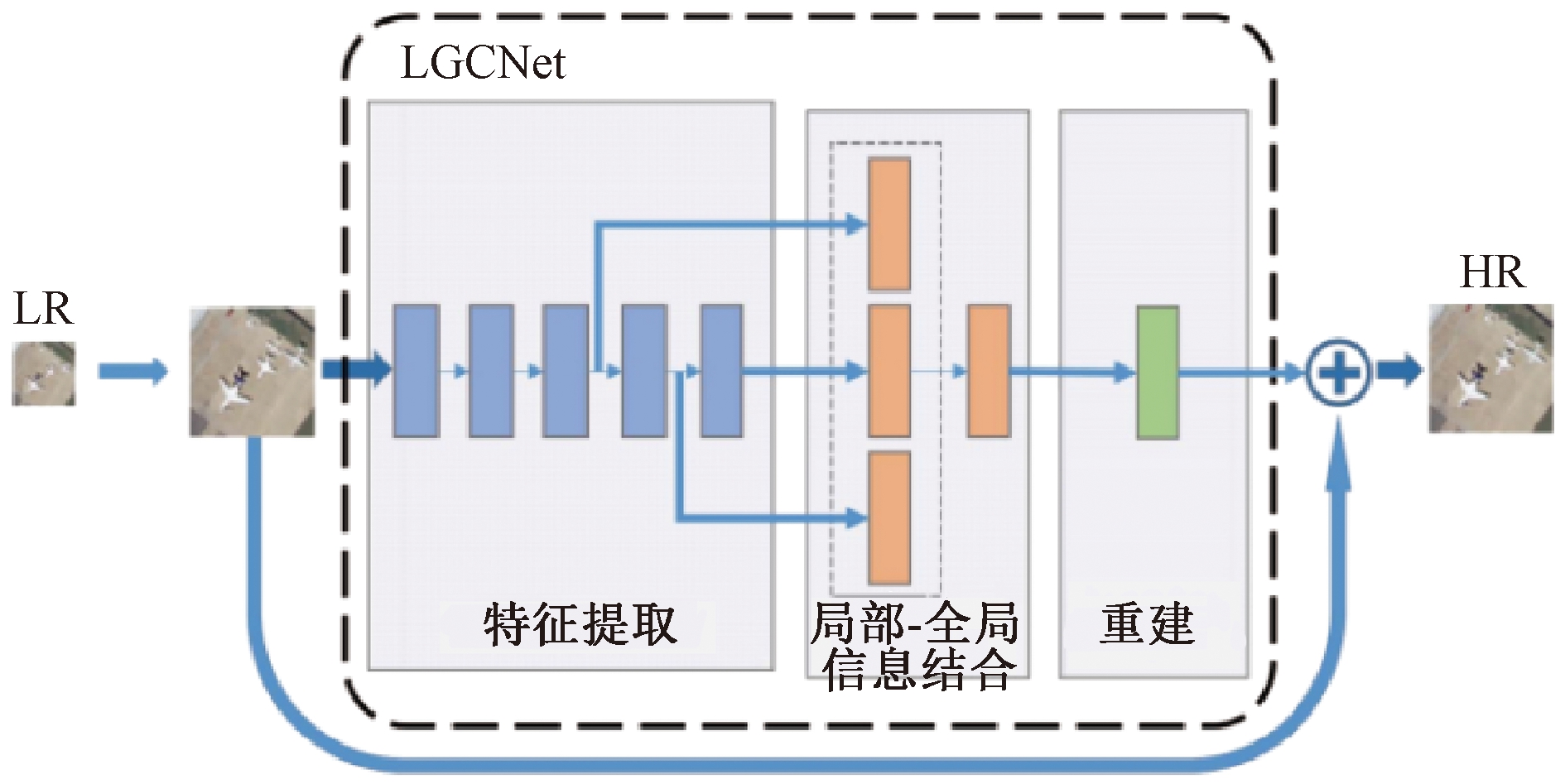

由于遥感图像和自然图像有很大的不同,遥感图像中包含的物体和环境常常耦合在一起,而且图像尺度跨度较大,但是目前大部分网络都是在单个对象范围内构建字典或者先验知识,忽略了环境信息。于是Lei等[13]提出一种基于VDSR[10]的网络,称为局部-全局结合网络(local-global combined networks,LGCNet)。如图3所示,该网络包括3个部分:①特征提取部分,利用L层卷积,获取不同层的特征表示;②局部-全局信息结合部分,这部分也是整个LGCNet的核心部分,主要将不同层的结果级联起来,也就是所谓的“多叉结构”;③重建部分,重建出高分辨率的遥感图像。该方法在UC Merced数据集的上进行实验,结果表明,和SRCNN相比,可以实现更高质量的重建效果。

图3 LGCNet网络结构

Figure 3 Structure of LGCNet network

Xu等[14]也针对多个尺度特征提取的问题,提出深度记忆连接网络(deep memory connected network,DMCN)。DMCN是一种对称的沙漏结构CNN,具有多个跳跃连接。该网络在NWPU-RESISC45、UC Merced和GaoFen1数据集上的实验结果表明,与LGCNet[13]相比,虽然它的重建效果只有略微的提升,但是内存占用量和测试时间都大大减少了。

上述研究虽然都使用了多尺度特征提取的方法,但是网络较深且结构单一,不能灵活适应多尺度特征,于是Wang等[15]提出了一种用于遥感图像的超分辨率重建的自适应多尺度特征融合网络。该方法提出了一种自适应多尺度特征提取模块,该模块结合了挤压激励网络和自适应门控机制。通过该模块可以自适应地将提取的多尺度信息进行融合,该方法优于SRCNN、ESPCN[16](efficient sub-pixel convolutional neural network for super-reselution)、MSRN[17](multi-scale residual network for image super-resolution)等经典方法。

2.1.3 结合小波变换的遥感图像超分辨率重建

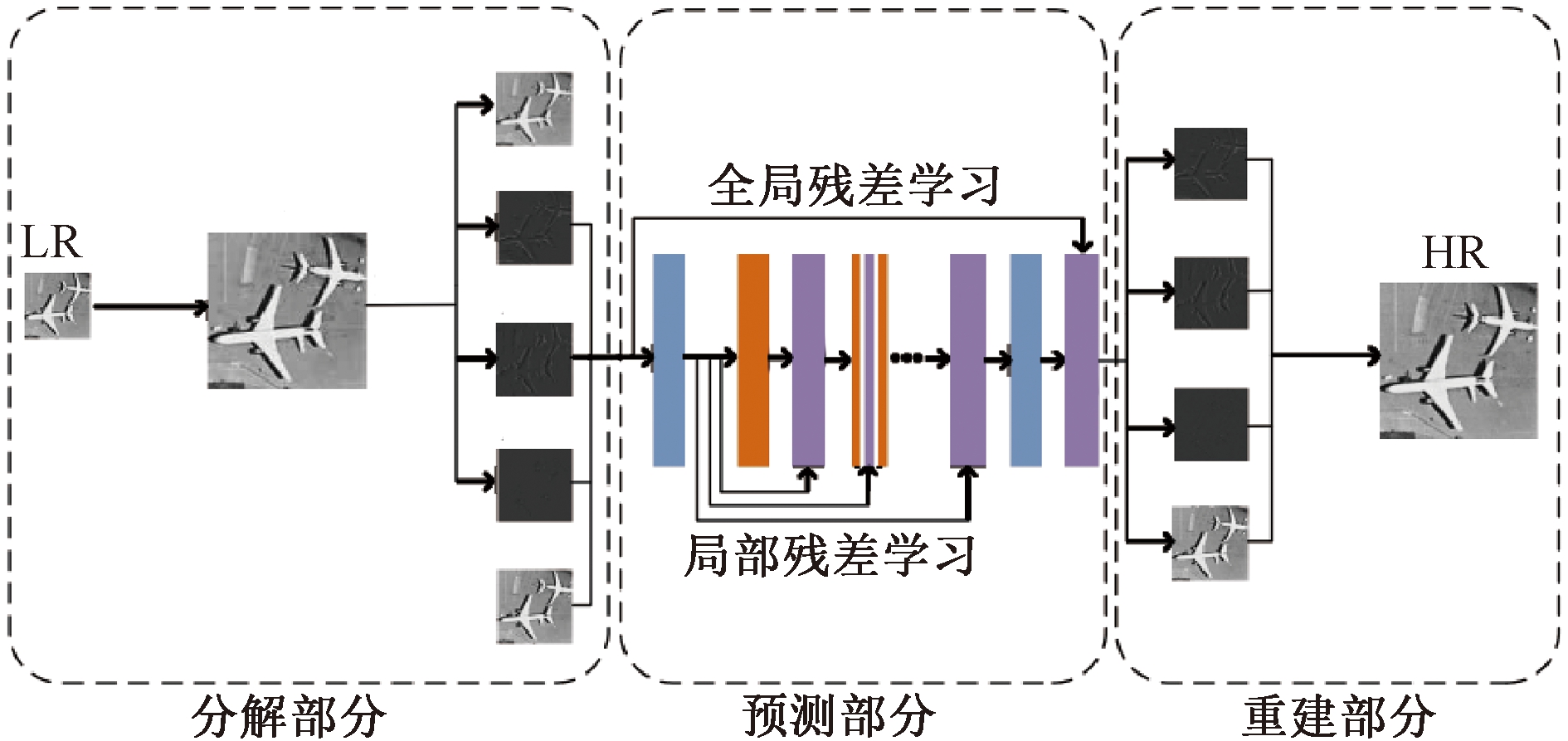

Ma等[18]提出另外一种结合小波变换和带有局部、全局残差连接的CNN超分辨率重建网络结构(wavelet transform combined with the recursire res-net, WTCRR)。如图4所示,该网络带有局部和全局的残差连接,通过关注频域来解决超分辨率重建问题。该网络包含3个部分:分解、预测和重建。分解部分就是将经过双三次插值的图像通过2D离散小波变换分解为4张低分辨率图像;预测部分指的是把上一步分解出的4张图像输入到具有递归和残差网络的CNN网络结构中,得到初步的预测结果;重建部分将预测部分得到的图片通过逆离散小波变换进行组合,重建出最终的高分辨率图像。该方法在NWPU-RESISC45数据集上的实验结果表明,与DRNN[19](deep recurrent neural network)相比,该方法重建后的图片边缘有所改进。

图4 WTCRR网络结构

Figure 4 Structure of WTCRR network

2.1.4 高放大因子的遥感图像超分辨率重建

目前,适度放大单幅遥感图像空间分辨率(例如×2、×3)的问题得到了有效的解决,但是高放大因子(例如×4、×8)的遥感图像超分辨率重建仍是个难题。Pan等[20]针对上述问题提出快速残差密集反投影网络(fast residual dense backprojection network,FRDBPN),该方法受文献[21]中自然图像超分辨率重建方法的启发,采用上投影和包含特定卷积和扩张卷积序列的下采样单元以及全局和局部残差连接。该方法在UC Merced数据上的实验表明,与其他基于深度学习的自然图像超分辨率重建方法相比,该方法在重建效果上有所提升。

2.2 基于GAN的单幅遥感图像超分辨率重建

生成对抗网络(GAN)是一种深度模型,模型中至少包含2个模块:生成模型和判别模型,通过这2个模型的相互博弈学习产生好的结果。基于生成对抗网络的图像超分辨率重建方法是由Ledig等[22]提出。随后研究者们将GAN用于遥感图像的超分辨率重建,针对不同的遥感图像超分辨率任务设计出不同模块组合。本小节主要介绍几种具有代表性的基于GAN网络的单幅遥感图像超分辨率重建模型。

2.2.1 沙漏状生成网络的遥感图像超分辨率重建

Haut等[23]聚焦于生成模型,提出一种沙漏状的生成网络架构。该网络以无监督的方式进行训练。生成网络将随机噪声作为输入,通过下采样生成低空间分辨率数据,并传递给上采样结构,如此反复优化,最终生成高分辨率图片。与目前最新的无监督方法相比,该模型在UC Merced、RSCNN7和NWPU-RESIS45数据集上取得了不错的效果,尤其当图像放大4倍时,效果更好。

2.2.2 边缘增强网络的遥感图像超分辨率重建

由于受噪声的污染,遥感图像恢复高频边缘细节方面仍然需要改善。于是,Jiang等[24]提出一种基于生成对抗网络的边缘增强网络,该网络的生成网络由两个子网络超密集子网(ultra dense sub network,UDSN)和边缘增强子网(edge-enhancement sub network,EESN)组成。当UDSN用于重建图像时,重建结果看上去很锐化,边缘受噪声污染严重,因此,专门设计了EESN通过学习噪声掩码来增强边缘。该方法相比经典的SRCNN、VDSR[10]和SRGAN[22]方法的重建效果有很大提升。

2.2.3 可跨传感器的遥感图像超分辨率重建

用于遥感图像超分辨率重建的数据通常局限于特定的位置和特定的传感器,导致不同位置和传感器之间推广模型的能力有限。于是Xiong等[25]修改了SRGAN的损失函数和网络结构,并提出改进的SRGAN方法(improved SRGAN,ISRGAN)。ISRGAN方法使得模型训练更加稳定,并增强了泛化能力,实现遥感图像一次训练,就可以用于任何地方和不同的传感器。实验结果表明,使用ISRGAN超分辨率重建之后的土地覆盖分类的准确性可以得到显著提高,尤其在具有高分辨率纹理道路和建筑物上,准确率提高了15%。

3 基于深度学习的多幅遥感图像超分辨率重建

单幅遥感图像的超分辨率重建技术引起了计算机视觉和深度学习社区的广泛关注,但是对于更通用的多幅遥感图像超分辨率重建方法却没有太多的研究,特别是基于深度学习的方法。与单幅遥感图像超分辨率重建相比,多幅遥感图像超分辨率重建中包含有更多的互补信息,过程也更具有挑战性,需要解决多个低分辨率图像之间联合配准和融合等额外问题。

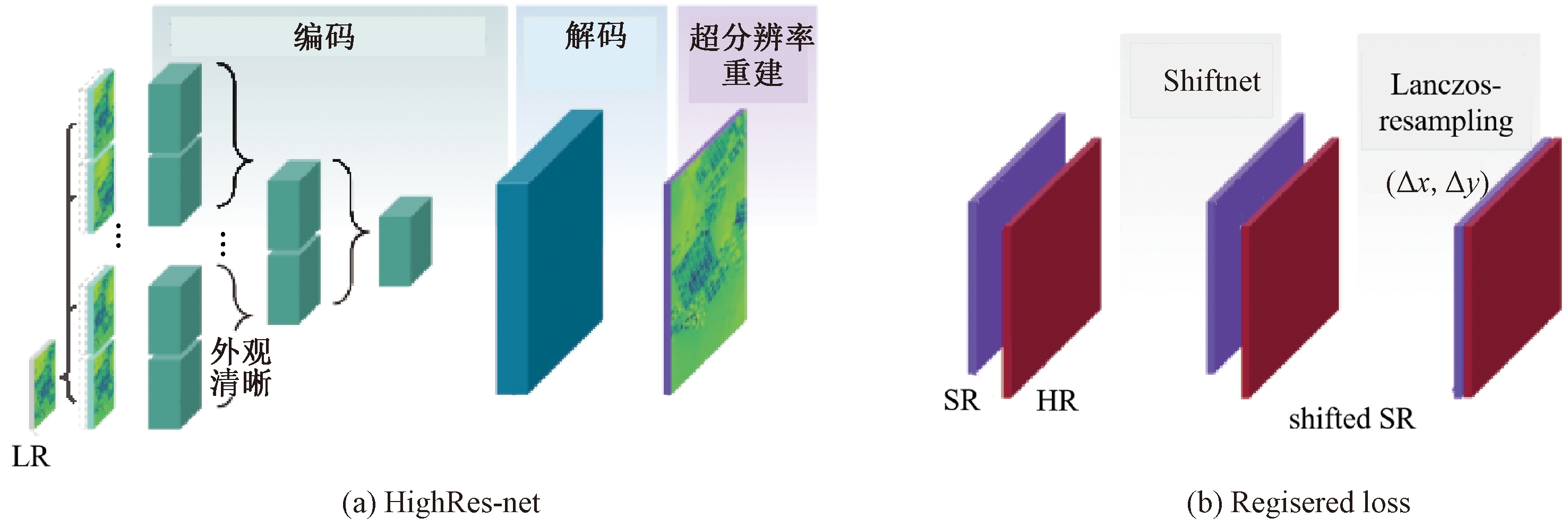

针对上述提出的挑战,Deudon等[26]提出了HightRes-net网络,首次将深度学习的方法引用到多幅遥感图像超分辨率重建中,该方法以端到端的方式学习子任务,子任务包括:①图像配准;②图像融合;③上采样;④配准损失函数。图5为HightRes-net网络结构图。如图5(a)所示,HightRes-net是一种深层结构,通过参考帧通道,学习将任意数量的低分辨率图像进行联合配准,然后进行上采样和超分辨率重建。如图5(b)所示,将得到的Shiftnet损失反馈到HightRes-net模型中,得到重建图片。Shiftnet损失ISRGAN函数保证了多幅遥感图像的超分辨率重建不会因为配准不足、亚像素偏移等导致输出结果模糊。结果表明,该方法达到很好的超分辨率效果并且在欧洲航天局的真实遥感图像的多幅超分辨率重建比赛中取得较好的成绩。

图5 HightRes-net网络结构图

Figure 5 Structure of HightRes-net network

4 基于深度学习的多/高光谱遥感图像超分辨率重建

本文还总结了多/高光谱遥感图像的空间分辨率和光谱分辨率的重建方法。光谱图像包含数百个波段,提供了丰富的光谱特征,每张图像代表不同电磁波段下场景的反射率和辐射率,这种物理表示在许多应用中起着至关重要的作用,例如遥感分类、目标检测和异常检测。但是由于硬件限制,收集高质量的高光谱图像比全色图像困难,并且分辨率也较低,因此超分辨率重建技术也被引入到该领域。Li等[27]和Wang等[28]将深度学习的方法用于多/高光谱遥感图像超分辨率重建,随后学者们积极地探索基于深度学习的多/高光谱图像超分辨率重建方法,下面将介绍几种有代表性的方法。

4.1 基于SRCNN的多/高光谱图像超分辨率重建

Yuan等[29]将用在自然图像上预先训练的单图像超分辨率重建方法SRCNN用来独立增强多/高光谱遥感图像的每个频段,并借鉴转移学习思想将其转化为高光谱图像。另外,为了研究低分辨率和多/高分辨率高光谱图像之间的光谱性质,还提出了协作非负矩阵分解来增强低分辨率和高分辨率光谱之间的关联。实验结果表明,所提方法不需要相同场景的任何辅助图像就可以达到不错的超分辨率效果。He等[30]也考虑了Yuan等[29]的方法,首先,用自然图像训练拉普拉斯金字塔网络[31];其次,利用预训练好的网络对多/高光谱遥感图像的每个波段进行超分辨率重建;最后,利用编码光谱在低空间分辨率多/高光谱图像上进行训练,来提高多/高光谱分辨率。

4.2 改进损失函数的多/高光谱图像超分辨率重建

大多数基于CNN的图像超分辨率重建网络,都是使用默认的L2损失函数,但是对于高光谱图像,该损失函数可能会导致光谱不一致。对多/高光谱图像的超分辨率重建,损失函数不仅应该关注空间信息,还要关注光谱信息。于是Zheng等[32]提出一种同时考虑空间和光谱信息的多损失函数网络,它由串联密集残差网络(concatenate dense residual network,CDRN)和损失网络(loss network,LN)组成。CDRN是图像重建部分;LN包括像素的空间损失和光谱损失,它驱动整个模型的学习。该方法与VDSR和EDSR相比,峰值信噪比分别提高了1.8 dB和0.5 dB。

5 相关实验对比和分析

5.1 数据集

目前前沿的基于深度学习的遥感图像超分辨率重建方法的常见数据集如下。

(1)UC Merced数据集[33],它是一个用于研究土地利用的数据集,一共有2 100张图片,包含21类场景,每类100张,每张图片的像素大小为256×256。

(2)RSCNN7数据集[34],一共包含2 800幅遥感图像,分别来自7个不同的场景类别,每个类别包含400张图像。

(3)NWPU-RESISC45[35]数据集,来自西北工业大学,一共含有31 500张图片,分为45个场景类别,每类有700张,每张图像的像素大小为256×256。

(4)Kaggle开源数据集,该数据集中Draper卫星图像包含了1 000多张在南加州拍摄的高分辨率航空照片。

(5)Sentinel-2数据集,它是Sentinel系列里的一个系列,数据免费,主要有效载荷是多光谱成像仪,共有13个波段,光谱在0.4~2.4 μm,涵盖了可见光、近红外和短波红外,并且该数据集作为Landsat系统在对地观测领域的补充,目前应用越来越多。

5.2 实验结果对比

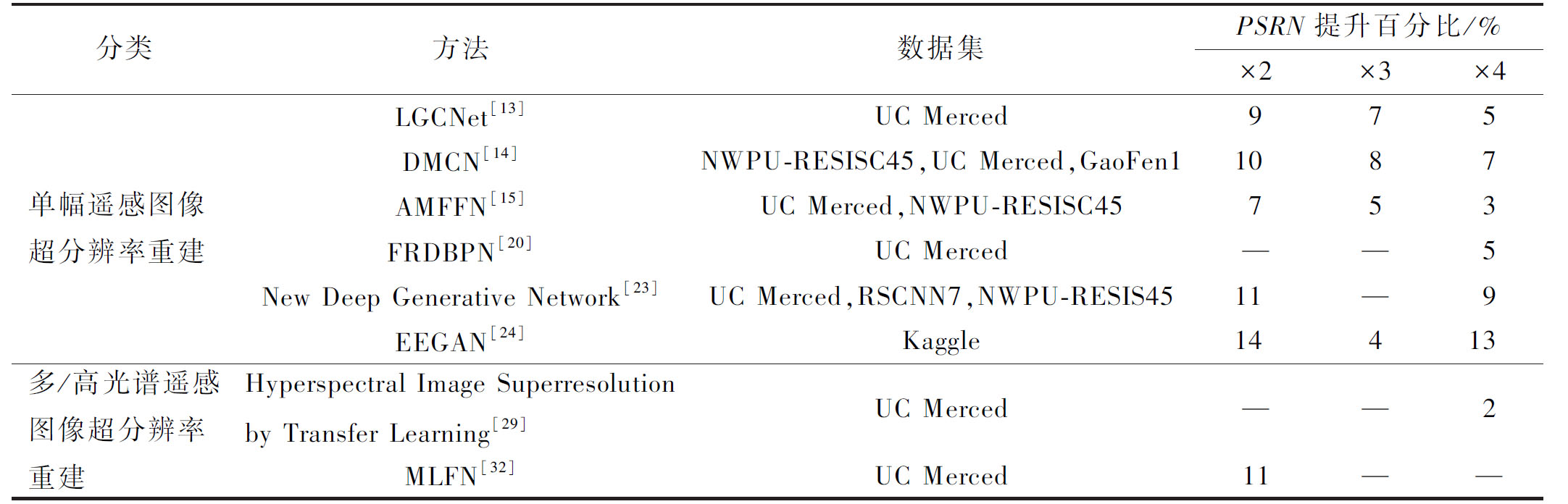

表1展示了在×2、×3、×4放大因子下,不同的遥感图像超分辨率重建方法与双三次插值相比,峰值信噪比PSNR提升的百分比。单幅遥感图像超分辨率重建方法的结果表明,使用基于GAN的结构,并在通用图像上进行预训练,PSNR提升得更高,可以取得目前最好的重建效果。对于多/高光谱遥感图像超分辨率重建方法,PSNR提升明显较低,这主要是由于多/高光谱遥感图像的特殊性造成的,这一结果表明,同时利用空间和光谱信息,可以获得更好的性能。

表1 不同的遥感图像超分辨率重建方法与双三次插值相比的PSRN提升百分比

Table 1 The PSRN improvement performance of different remote sensing image super-reconstruction methods compared with bicubic

分类方法数据集PSRN提升百分比/%×2×3×4单幅遥感图像超分辨率重建LGCNet[13]UC Merced975DMCN[14]NWPU-RESISC45,UC Merced,GaoFen11087AMFFN[15]UC Merced,NWPU-RESISC45753FRDBPN[20]UC Merced——5New Deep Generative Network[23]UC Merced,RSCNN7,NWPU-RESIS4511—9EEGAN[24]Kaggle14413多/高光谱遥感图像超分辨率重建Hyperspectral Image Superresolu-tionby Transfer Learning[29]UC Merced——2MLFN[32]UC Merced11——

5.3 分析与讨论

自从SRCNN被用于遥感图像的超分辨率重建以来,各种基于深度学习的方法被用于遥感图像的超分辨率重建,总结上述具有代表性的遥感图像超分辨率重建算法,可以发现:

(1)从模型类型来看,基于CNN的方法仍然是目前基于深度学习的遥感图像超分辨率重建中的主流方法,但也有少部分学者将其他的深度模型应用于遥感图像的超分辨率重建中。

(2)从单幅遥感图像重建方法及其效果来看,基于GAN的方法可以取得目前最好的重建效果,这与在自然图像上的方法结果是一致的。

(3)对于多幅遥感图像超分辨率重建而言,需要考虑图像配准和融合等额外问题,所以重建模型会比较大,并且目前基于深度学习的多幅遥感图像超分辨率重建方法较少,主要都是针对单幅遥感图像重建的方法。

(4)对于多/高光谱遥感图像超分辨率重建的情况,性能最好的方法是同时注意提高空间分辨率和光谱分辨率,而不是像早期的方法那样只是独立地考虑光谱通道。

(5)大部分的基于深度学习的遥感图像超分辨率重建网络使用的是L1和L2损失函数,这两个损失函数都是基于像素差异。对于多/高光谱遥感图像进行光谱分辨率重建时,需要设计合适的光谱信息损失函数,这样才能生成高质量的多/高光谱遥感图像。

6 结论及展望

遥感图像的超分辨率重建是近几年来计算机视觉和图像处理领域的研究热点,具有重要的研究意义和应用价值。在农业遥感领域[36],可以利用遥感技术进行种植土地分析、农业资源调查等。在生态环境和应急管理领域,可以通过超分辨率遥感图像检测大气污染、监测生态红线、获取灾情信息等。在公共安全领域,可以利用超分辨率遥感图像进行目标检测[37]、目标识别[38-39]和目标跟踪等。遥感图像超分辨率重建相关技术的发展和成熟,全面促进了其在各个计算机视觉领域的深入应用[40-44],同时也给未来的研究工作提出了更高更新的要求。结合目前基于深度学习的遥感图像超分辨率重建方法中存在的不足[45-48],认为基于深度学习的遥感图像超分辨率重建方法未来还可以从以下几个方面着手进行深入研究。

(1)研究针对遥感图像特点的神经网络结构。尽管现有基于深度学习的遥感图像超分辨率重建方法已经取得了不错成果,但是遥感图像具有尺度多样性、视角特殊性、多方向和背景复杂度高等特点,所以如何利用现有技术(如注意力机制、多尺度特征融合、强化学习等)构建更高效的和适应遥感图像特点的超分辨率网络仍然是一个值得探索的问题。

(2)研究无监督学习的遥感图像超分辨率重建方法。遥感图像在同一场景下的不同分辨率的图像很难获取,所以缺乏训练样本,而且目前主要的研究是有监督的遥感图像超分辨率重建方法,但是有监督学习的超分辨率重建方法训练出来的模型不能很好地应对一些实际场景的超分辨率重建任务,所以无监督的遥感图像超分辨率重建模型具有重要的研究价值。

(3)研究多源遥感图像的超分辨率重建方法。融合同一场景不同传感器的图像信息(包括空间信息、时间信息、光谱信息和位置信息等),目前基于深度学习的遥感图像超分辨率重建方法中,大多只是根据一种信息来进行重建,模型学习到的信息较少,重建效果有限,所以研究多源遥感图像信息的融合问题,充分挖掘这些互补信息,以提高遥感图像重建效果,这也是未来一个十分重要的研究方向。

[1] YANG J C, WRIGHT J, HUANG T S, et al. Image super-resolution via sparse representation[J]. IEEE transactions on image processing, 2010, 19(11): 2861-2873.

[2] PERONA P, BRANSON S J, WEGNER J D, et al. System and method for locating and performing fine grained classification from multi-view image data: US10534960[P]. 2020-01-14.

[3] ZHANG L P, ZHANG L F, DU B. Deep learning for remote sensing data: a technical tutorial on the state of the art[J]. IEEE geoscience and remote sensing magazine, 2016, 4(2): 22-40.

[4] JI H, GAO Z, MEI T C, et al. Vehicle detection in remote sensing images leveraging on simultaneous super-resolution[J]. IEEE geoscience and remote sensing letters, 2020, 17(4): 676-680.

[5] YANG D Q, LI Z M, XIA Y T, et al. Remote sensing image super-resolution: challenges and approaches[C]//2015 IEEE International Conference on Digital Signal Processing. Piscataway:IEEE, 2015: 196-200.

[6] 张震洲, 高昆, 李维, 等. 光学遥感图像的超分辨率处理技术综述[J]. 航天返回与遥感, 2020, 41(6): 21-33.

ZHANG Z Z, GAO K, LI W, et al. A survey on the optical remote sensing image super-resolution technology[J]. Spacecraft recovery & remote sensing, 2020, 41(6): 21-33.

[7] 钦桂勤, 耿则勋, 徐青. 利用频谱解混叠方法实现超分辨率影像重建[J]. 测绘学报, 2003, 32(2): 143-147.

QIN G Q, GENG Z X, XU Q. Super-resolution image restoration by spectral de-aliasing[J]. Acta geodaetica et cartographic sinica, 2003, 32(2): 143-147.

[8] DONG C, LOY C C, HE K M, et al. Image super-resolution using deep convolutional networks[J]. IEEE transactions on pattern analysis and machine intelligence, 2016, 38(2): 295-307.

[9] 刘颖, 朱丽, 林庆帆, 等. 图像超分辨率技术的回顾与展望[J]. 计算机科学与探索, 2020, 14(2): 181-199.

LIU Y, ZHU L, LIN Q F, et al. Review and prospect of image super-resolution technology[J]. Journal of frontiers of computer science and technology, 2020, 14(2): 181-199.

[10] KIM J, LEE J K, LEE K M. Accurate image super-resolution using very deep convolutional networks[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2016: 1646-1654.

[11] LIM B, SON S, KIM H, et al. Enhanced deep residual networks for single image super-resolution[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition Workshops. Piscataway:IEEE, 2017: 1132-1140.

[12] LIEBEL L, K![]() M. Single-image super resolution for multispectral remote sensing data using convolutional neural networks[EB/OL]. (2016-06-06)[2021-09-28].https://doi.org/10.5194/isprs-archives-XLI-B3-883-2016.

M. Single-image super resolution for multispectral remote sensing data using convolutional neural networks[EB/OL]. (2016-06-06)[2021-09-28].https://doi.org/10.5194/isprs-archives-XLI-B3-883-2016.

[13] LEI S, SHI Z W, ZOU Z X. Super-resolution for remote sensing images via local-global combined network[J]. IEEE geoscience and remote sensing letters, 2017, 14(8): 1243-1247.

[14] XU W J, XU G L, WANG Y, et al. High quality remote sensing image super-resolution using deep memory connected network[C]//2018 IEEE International Geoscience and Remote Sensing Symposium. Piscataway:IEEE, 2018: 8889-8892.

[15] WANG X Y, WU Y D, MING Y, et al. Remote sensing imagery super resolution based on adaptive multi-scale feature fusion network[J]. Sensors, 2020, 20(4): 1142-1157.

[16] SHI W Z, CABALLERO J, ![]() F, et al. Real-time single image and video super-resolution using an efficient sub-pixel convolutional neural network[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2016: 1874-1883.

F, et al. Real-time single image and video super-resolution using an efficient sub-pixel convolutional neural network[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2016: 1874-1883.

[17] LI J, FANG F, MEI K, et al. Multi-scale residual network for image super-resolution[C]//2018 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2018: 517-532.

[18] MA W, PAN Z X, GUO J Y, et al. Achieving super-resolution remote sensing images via the wavelet transform combined with the recursive res-net[J]. IEEE transactions on geoscience and remote sensing, 2019, 57(6): 3512-3527.

[19] TAI Y, YANG J, LIU X M. Image super-resolution via deep recursive residual network[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2017: 2790-2798.

[20] PAN Z X, MA W, GUO J Y, et al. Super-resolution of single remote sensing image based on residual dense backprojection networks[J]. IEEE transactions on geoscience and remote sensing, 2019, 57(10): 7918-7933.

[21] HARIS M, SHAKHNAROVICH G, UKITA N. Deep back-projection networks for super-resolution[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2018: 1664-1673.

[22] LEDIG C, THEIS L, HUSZ![]() F, et al. Photo-realistic single image super-resolution using a generative adversarial network[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2017: 105-114.

F, et al. Photo-realistic single image super-resolution using a generative adversarial network[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2017: 105-114.

[23] HAUT J M, FERNANDEZ-BELTRAN R, PAOLETTI M E, et al. A new deep generative network for unsupervised remote sensing single-image super-resolution[J]. IEEE transactions on geoscience and remote sensing, 2018, 56(11): 6792-6810.

[24] JIANG K, WANG Z Y, YI P, et al. Edge-enhanced GAN for remote sensing image superresolution[J]. IEEE transactions on geoscience and remote sensing, 2019, 57(8): 5799-5812.

[25] XIONG Y F, GUO S X, CHEN J S, et al. Improved SRGAN for remote sensing image super-resolution across locations and sensors[J]. Remote sensing, 2020, 12(8): 1263.

[26] DEUDON M, KALAITZIS A, GOYTOM I, et al. HighRes-net: recursive fusion for multi-frame super-resolution of satellite imagery[EB/OL].(2020-02-15)[2021-10-13].https://doi.org/10.48550/arXiv.2002.06460.

[27] LI Y S, HU J, ZHAO X, et al. Hyperspectral image super-resolution using deep convolutional neural network[J]. Neurocomputing, 2017, 266: 29-41.

[28] WANG C, LIU Y, BAI X, et al. Deep residual convolutional neural network for hyperspectral image super[C]//International Conference on Image and Graphics. Cham: Springer, 2017: 370-380.

[29] YUAN Y, ZHENG X T, LU X Q. Hyperspectral image superresolution by transfer learning[J]. IEEE journal of selected topics in applied earth observations and remote sensing, 2017, 10(5): 1963-1974.

[30] HE Z, LIU L. Hyperspectral image super-resolution inspired by deep Laplacian pyramid network[J]. Remote sensing, 2018, 10(12): 1939-1946.

[31] LAI W S, HUANG J B, AHUJA N, et al. Deep Laplacian pyramid networks for fast and accurate super-resolution[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2017: 5835-5843.

[32] ZHENG K, GAO L R, ZHANG B, et al. Multi-losses function based convolution neural network for single hyperspectral image super-resolution[C]//2018 Fifth International Workshop on Earth Observation and Remote Sensing Applications (EORSA). Piscataway:IEEE, 2018: 1-4.

[33] YANG Y, NEWSAM S. Bag-of-visual-words and spatial extensions for land-use classification[C]//GIS′10: Proceedings of the 18th SIGSPATIAL International Conference on Advances in Geographic Information Systems. New York:ACM,2010: 270-279.

[34] ZOU Q, NI L H, ZHANG T, et al. Deep learning based feature selection for remote sensing scene classification[J]. IEEE geoscience and remote sensing letters, 2015, 12(11): 2321-2325.

[35] CHENG G, HAN J W, LU X Q. Remote sensing image scene classification: benchmark and state of the art[J]. Proceedings of the IEEE, 2017, 105(10): 1865-1883.

[36] SHI Z, CHEN C, XIONG Z W, et al. HSCNN+: advanced CNN-based hyperspectral recovery from RGB images[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops (CVPRW). Piscataway: IEEE, 2018: 1052-10528.

[37] RABBI J, RAY N, SCHUBERT M, et al. Small-object detection in remote sensing images with end-to-end edge-enhanced GAN and object detector network[J]. Remote sensing, 2020, 12(9): 1432-1441.

[38] QIN M J, HU L S, DU Z H, et al. Achieving higher resolution lake area from remote sensing images through an unsupervised deep learning super-resolution method[J]. Remote sensing, 2020, 12(12): 1937-1946.

[39] 肖创柏, 禹晶, 薛毅. 一种基于MAP的超分辨率图像重建的快速算法[J]. 计算机研究与发展, 2009, 46(5): 872-880.

XIAO C B, YU J, XUE Y. A novel fast algorithm for MAP super-resolution image reconstruction[J]. Journal of computer research and development, 2009, 46(5): 872-880.

[40] ZHAO B, DAI M R, LI P, et al. Defect detection method for electric multiple units key components based on deep learning[J]. IEEE access, 2020, 8: 136808-136818.

[41] BHUSAL S, BHATTARAI U, KARKEE M. Improving pest bird detection in a vineyard environment using super-resolution and deep learning[J]. IFAC-PapersOnLine, 2019, 52(30): 18-23.

[42] HAN X B, HE T T, ONG Y S, et al. Precise object detection using adversarially augmented local/global feature fusion[J]. Engineering applications of artificial intelligence, 2020, 94(1): 103710.

[43] KOESTER E, SAHIN C S. A comparison of super-resolution and nearest neighbors interpolation applied to object detection on satellite data [EB/OL].(2019-07-08)[2021-09-23].https://doi.org/10.48550/arXiv.1907.05283.

[44] ZHANG Y Q, BAI Y C, DING M L, et al. Multi-task generative adversarial network for detecting small objects in the wild[J]. International journal of computer vision, 2020, 128(6): 1810-1828.

[45] SHERMEYER J, VAN ETTEN A. The effects of super-resolution on object detection performance in satellite imagery[C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops (CVPRW). Piscataway:IEEE, 2019: 1432-1441.

[46] DONG X Y, XI Z H, SUN X, et al. Transferred multi-perception attention networks for remote sensing image super-resolution[J]. Remote sensing, 2019, 11(23): 2857-2870.

[47] PAN Z X, MA W, GUO J Y, et al. Super-resolution of single remote sensing image based on residual dense backprojection networks[J]. IEEE transactions on geoscience and remote sensing, 2019, 57(10): 7918-7933.

[48] HE H Q, CHEN T, CHEN M Q, et al. Remote sensing image super-resolution using deep-shallow cascaded convolutional neural networks[J]. Sensor review, 2019, 39(5): 629-635.