0 引言

教与学优化算法(teaching-learning-based optimization,TLBO)是Rao等[1-2]于2011年提出的一种新的智能优化算法,它主要模拟老师的“教”过程和学生的“学”过程。由于教与学算法具有参数少、算法易于实现、寻优性能好等优点,受到学者的关注和研究[3]。目前,教与学优化算法已被成功地应用于多个领域。

一般来说,小的种群规模(微种群)会加速优化算法收敛,但会使其全局探索能力下降[4],即易陷入局部最优。因此,为提高微种群优化算法的全局探索能力,众多学者对其进行研究。例如,Ren等[5]提出一种小种群的差分进化算法(differential evolution using smaller population,DESP)。在该算法中,变异策略使用额外的扰动来提高其全局搜索能力,并使用一种自适应调整策略来控制扰动的强度。Brown等[6]提出一种微种群的JADE(adaptive differential evolution with optional external archive)算法。该算法在Rcr-JADE算法[7]的基础上进行改进,并加入了新的差分变异策略来提高算法的全局搜索能力。Marquez-Grajales等[8]提出了μJADEε算法。该算法将ε约束方法用于μJADE算法,以此来提高μJADE算法求解约束优化问题的能力。Salehinejad等[9]提出一种向量化随机变异因子的微种群差分进化算法(micro-differential evolution with vectorized random mutation factor,MDEVM)。在该算法中,每个个体均有各自的差分变异因子F,以此来提高种群多样性。上述研究表明,提高微种群启发式算法的全局搜索能力是避免算法“早熟收敛”的有效方式之一。

博弈论又称对策论,是研究具有冲突和对抗性质现象的数学理论和方法,在很多科学领域中得到了广泛的应用。在博弈问题中,非合作博弈纳什均衡是其最核心的研究内容。1951年,Nash[10]在提出的“纳什定理”中揭示并证明了博弈纳什均衡解的存在,但是Nash并没有给出求解纳什均衡的一般性方法。传统方法在求解纳什均衡问题时均存在一定的局限性,特别是对于高维的博弈模型(如3维及以上的矩阵策略),传统算法计算复杂且求解成本较高。最近几十年来,随着元启发式算法的迅速发展,诸多学者开始使用遗传算法[11]、免疫算法[12]、粒子群算法[13]、蚁群算法[14]等来求解博弈纳什均衡问题,并取得较好结果,这为求解非合作博弈问题提供了一种新的有效途径和方法。

为进一步提高微种群TLBO算法的全局搜索能力并有效地求解非合作博弈问题,笔者提出一种OBL-μTLBO算法。在该算法中,微种群有利于加快TLBO算法的收敛速度,而反向学习有助于提高TLBO算法的全局探索能力。实验结果表明,OBL-μTLBO 算法的整体性能明显优于其他所比较微种群和非微种群算法。最后,将改进的算法应用于非合作博弈问题的求解,所得结果明显好于其他比较算法。

1 反向学习

反向学习(opposition-based learning,OBL)是Tizhoosh [15]于2005年提出的一种应用于计算智能领域的机器学习方法。因为反向学习策略具有较强的探索能力[16],所以被广泛地用于提高元启发式算法的搜索性能。一些术语介绍如下。

反向数(opposite number):设存在实数x∈[a,b],则与其对应的反向数xo被定义为:

xo=a+b-x,x∈[a,b]。

(1)

反向点(opposite point):对于D维的搜索空间,设Xi=(xi,1,xi,2,…,xi,D)为其解向量空间内的一个点,且xij∈ [aj,bj](j=1,2,…,D),则与其对应的反向点表示为:

(2)

另外,Wang等[17]于2011年提出一种广义的反向学习策略(generalized opposition-based learning,GOBL),其反向个体生成如下:

(3)

式中:r是被用来控制反向解的搜索范围。研究表明,GOBL策略可以有效地使算法跳出局部最优[18]。

2 基于反向学习的微种群教与学优化算法

2.1 基于反向学习的“教”阶段

对于微种群而言,由于种群规模较小,因此种群多样性更容易迅速丢失。故笔者将结合GOBL策略,在教学阶段使用反向学习个体XGO来指导种群进化,从而提高微种群教与学优化算法的探索能力。其反向个体更新方式如下:

(4)

式中:![]() 表示反向个体,xij∈[xj,min,xj,max]。

表示反向个体,xij∈[xj,min,xj,max]。

Xi,new=Xi,old+N(0.5,0.2)·(XT-TF·XM)+

N(0.5,0.2)·(XGO-Xi,old),

(5)

式中:N表示正态分布函数。若Xi,new的适应度值优于Xi,old,则更新个体;否则,不更新。

2.2 OBL-μTLBO算法的实现步骤

Step 1 初始化。设定微种群规模NP,最大评价次数FES;初始化种群。

Step 2 教学阶段。根据式(5)对个体进行更新,并对个体进行选择。

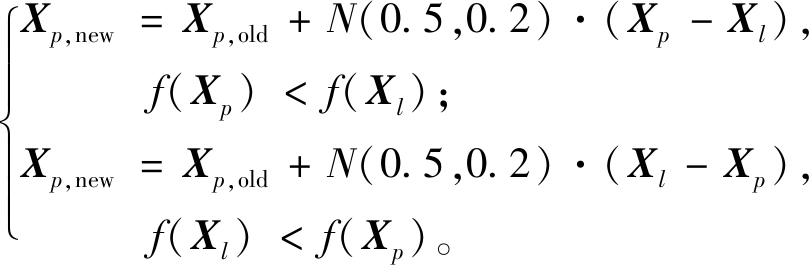

Step 3 学习阶段。根据文献[19]利用正态分布随机数代替式(2)的均匀随机数,其更新公式如下:

(6)

Step 4 判定算法是否达到最大适应度评价次数,若没有达到,则跳转至Step 2继续执行;如达到,则执行Step 5。

Step 5 输出结果。

3 仿真测试

为验证OBL-μTLBO算法的有效性,笔者选取文献[6]中13个30维的测试函数。其中f1~f7为单峰函数,f8~f13为多峰函数。OBL-μTLBO算法性能分别与TLBO[1-2]、DESP[5]、μJADE[6]、Rcr-JADE-s4[7]、MDEVM[9]、TLBO-CSWL[19]、FSADE[20]、ODE[21]以及MDEVM-Fajfar[22]等微种群或非微种群算法进行对比。对于每个测试函数,所有比较算法均独立运行50次。同时,为保证所得结论的可靠性,仿真结果采用Friedman[23]、Bonferroni-Dunn[24]、Iman-Davenport[25]、Holm和 Hochberg[25]检验进行统计分析。显著性水平设定为5%。此外,所得最好结果在表中用黑体表示。

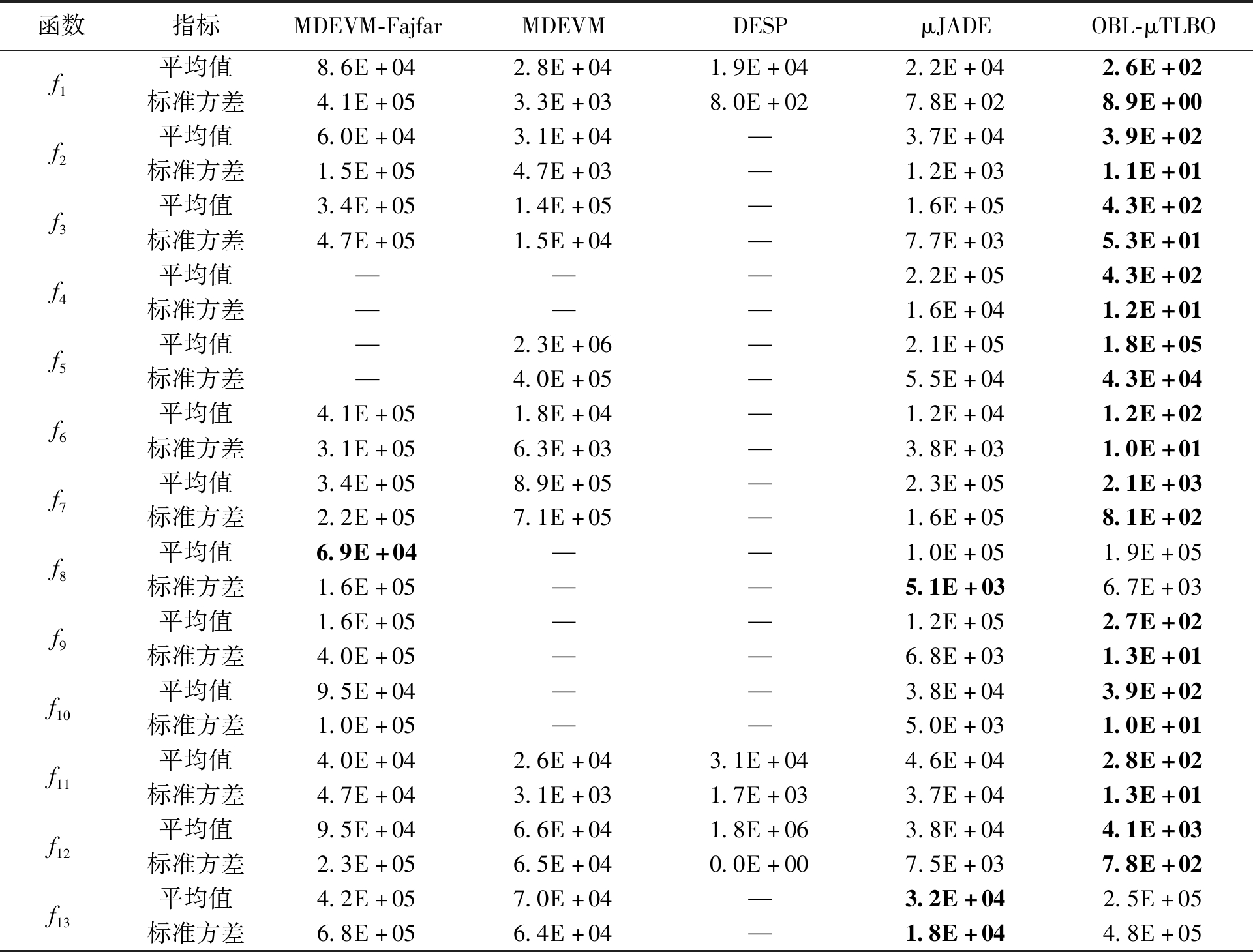

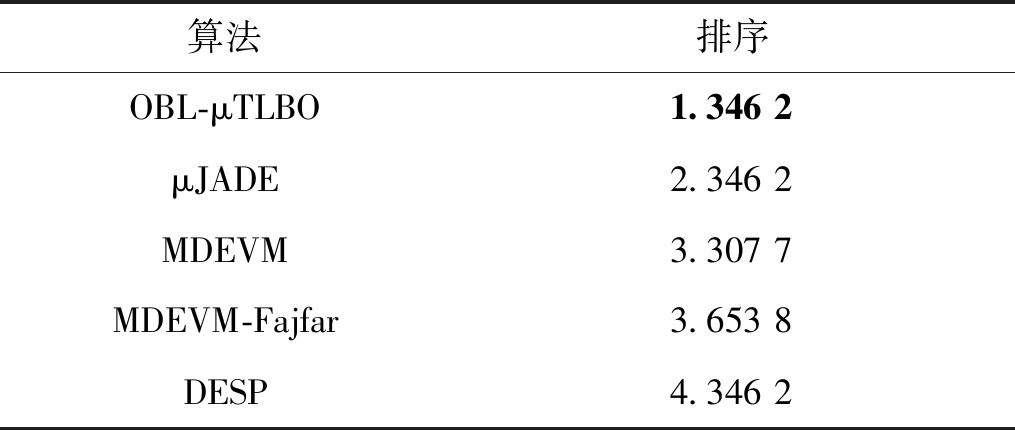

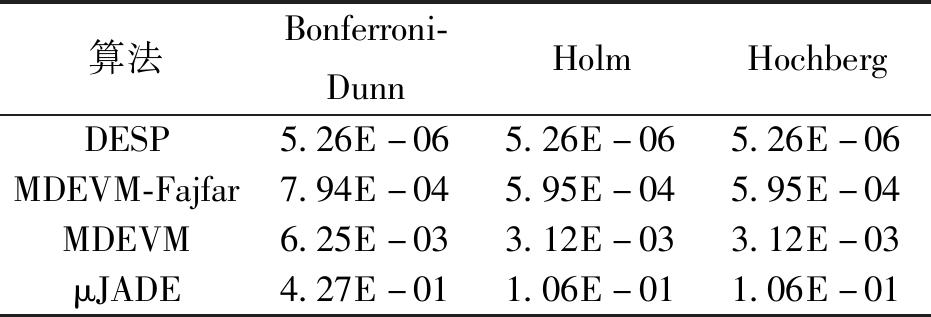

3.1 与微种群算法的比较

在该实验中,本文算法OBL-μTLBO与其他5种微种群算法进行比较,并通过设定的求解精度来比较哪种算法所使用的适应度函数评价次数最小。对于所有比较算法,实验参数设置均与文献[19]一致。即种群规模设定为8,对于f7,函数的结果精度设定为1.0E-02,其余测试函数的寻优精度设定为1.0E-08,最大适应度函数评价次数为3 000 000。若算法在达到终止条件时仍然没有求解到设定的求解精度,则认为算法在该函数上寻优失败,用“—”表示。仿真结果如表1所示。由表1可知,OBL-μTLBO算法在计算f1、f2、f3、f4、f5、f6、f7、f8、f9、f10、f11、f12上使用的函数评价次数最少,寻优效率明显优于其他所比较算法。这说明OBL-μTLBO算法不仅可以加速收敛,还可以提高寻优性能。对于函数f8和f13,μJADE算法的仿真结果略优于OBL-μTLBO算法。其主要原因可能是:虽然反向学习能够有效地帮助TLBO提高全局搜索能力,但是差分进化算法的全局搜索能力要好于TLBO算法。除以上比较外,还使用非参数的统计分析方法来对实验结果进行进一步分析,所得统计分析结果见表2和表3。从表2中可知,OBL-μTLBO算法在所有算法中的寻优效率是最高的。从表3可以看出,OBL-μTLBO算法的寻优效率要显著优于DESP、MDEVM、MDEVM-Fajfar算法,OBL-μTLBO算法的整体性能要比μJADE好。综上所得,OBL-μTLBO算法的收敛速度在所有比较算法中是最快的,且可得到高质量的解。

表1 微种群算法的实验结果

Table 1 Experimental results of micro-population algorithms

函数指标MDEVM-FajfarMDEVMDESPμJADEOBL-μTLBOf1f2f3f4f5f6f7f8f9f10f11f12f13平均值8.6E+042.8E+041.9E+042.2E+042.6E+02标准方差4.1E+053.3E+038.0E+027.8E+028.9E+00平均值6.0E+043.1E+04—3.7E+043.9E+02标准方差1.5E+054.7E+03—1.2E+031.1E+01平均值3.4E+051.4E+05—1.6E+054.3E+02标准方差4.7E+051.5E+04—7.7E+035.3E+01平均值———2.2E+054.3E+02标准方差———1.6E+041.2E+01平均值—2.3E+06—2.1E+051.8E+05标准方差—4.0E+05—5.5E+044.3E+04平均值4.1E+051.8E+04—1.2E+041.2E+02标准方差3.1E+056.3E+03—3.8E+031.0E+01平均值3.4E+058.9E+05—2.3E+052.1E+03标准方差2.2E+057.1E+05—1.6E+058.1E+02平均值6.9E+04——1.0E+051.9E+05标准方差1.6E+05——5.1E+036.7E+03平均值1.6E+05——1.2E+052.7E+02标准方差4.0E+05——6.8E+031.3E+01平均值9.5E+04——3.8E+043.9E+02标准方差1.0E+05——5.0E+031.0E+01平均值4.0E+042.6E+043.1E+044.6E+042.8E+02标准方差4.7E+043.1E+031.7E+033.7E+041.3E+01平均值9.5E+046.6E+041.8E+063.8E+044.1E+03标准方差2.3E+056.5E+040.0E+007.5E+037.8E+02平均值4.2E+057.0E+04—3.2E+042.5E+05标准方差6.8E+056.4E+04—1.8E+044.8E+05

表2 Friedman测试在微种群算法上所得排序结果

Table 2 Ranking obtained by Friedman′s test for micro-population algorithms

算法排序OBL-μTLBO1.3462μJADE2.3462MDEVM3.3077MDEVM-Fajfar3.6538DESP4.3462

表3 Bonferroni-Dunn、Holm和Hochberg在OBL-μTLBO和微种群算法上所得p值

Table 3 p-values obtained by Bonferroni-Dunn′s,Holm′s,and Hochberg′s procedures for OBL-μTLBO and micro-population algorithms

算法Bonferroni-DunnHolmHochbergDESP5.26E-065.26E-065.26E-06MDEVM-Fajfar7.94E-045.95E-045.95E-04MDEVM6.25E-033.12E-033.12E-03μJADE4.27E-011.06E-011.06E-01

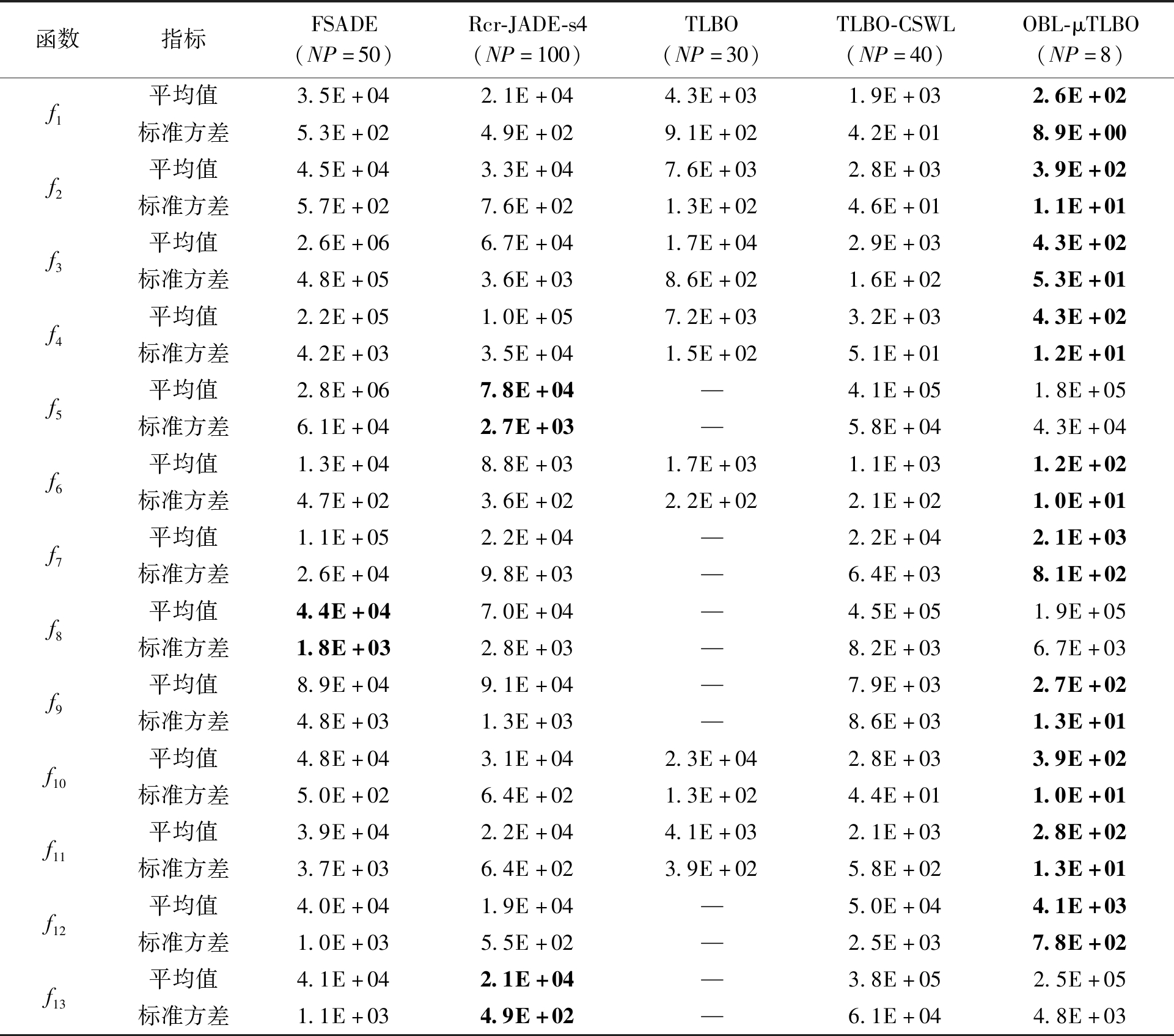

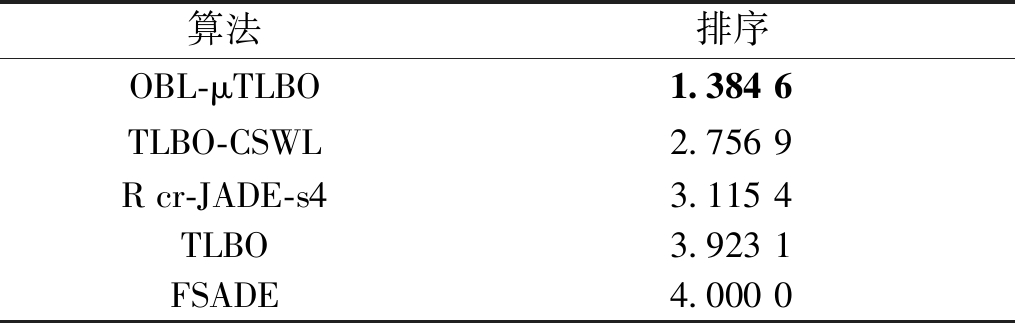

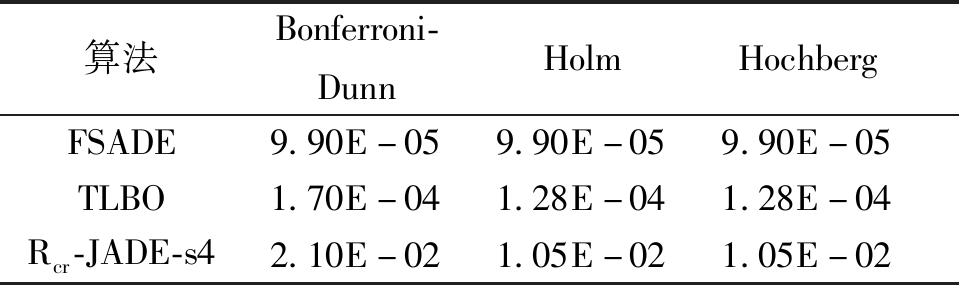

3.2 与非微种群算法的比较

在本实验中,OBL-μTLBO算法与4种非微种群算法的性能进行比较。期望求解精度同3.1节。标准TLBO算法的种群规模设定为30;TLBO-CSWL算法的种群规模设定为40;FSADE算法和Rcr-JADE-s4的种群规模分别设定为50和100,算法参数设置均与文献[6]一致,结果见表4。从表4可以看出,OBL-μTLBO算法在f1、f2、f3、f4、f6、f7、f9、f10、f11上的平均评价次数均明显少于所有比较算法,这说明所提方法具有较快的收敛速度。而在函数f5、f8、f13上,Rcr-JADE-s4算法的实验结果要优于本文的OBL-μTLBO算法。这说明Rcr-JADE-s4算法在这3个函数上具有较快的收敛速度。统计分析结果见表5和表6。由表5可知,笔者所提算法与非微种群算法相比,OBL-μTLBO同样具有较高的搜索效率。从表6可以看出,OBL-μTLBO算法的搜索效率要明显优于其他所有比较的非微种群算法。

表4 OBL-μTLBO算法与非微种群算法的结果

Table 4 Experimental results of the OBL-μTLBO algorithm and non-micro-population algorithms

函数指标FSADE(NP=50)Rcr-JADE-s4(NP=100)TLBO(NP=30)TLBO-CSWL(NP=40)OBL-μTLBO(NP=8)f1f2f3f4f5f6f7f8f9f10f11f12f13平均值3.5E+042.1E+044.3E+031.9E+032.6E+02标准方差5.3E+024.9E+029.1E+024.2E+018.9E+00平均值4.5E+043.3E+047.6E+032.8E+033.9E+02标准方差5.7E+027.6E+021.3E+024.6E+011.1E+01平均值2.6E+066.7E+041.7E+042.9E+034.3E+02标准方差4.8E+053.6E+038.6E+021.6E+025.3E+01平均值2.2E+051.0E+057.2E+033.2E+034.3E+02标准方差4.2E+033.5E+041.5E+025.1E+011.2E+01平均值2.8E+067.8E+04—4.1E+051.8E+05标准方差6.1E+042.7E+03—5.8E+044.3E+04平均值1.3E+048.8E+031.7E+031.1E+031.2E+02标准方差4.7E+023.6E+022.2E+022.1E+021.0E+01平均值1.1E+052.2E+04—2.2E+042.1E+03标准方差2.6E+049.8E+03—6.4E+038.1E+02平均值4.4E+047.0E+04—4.5E+051.9E+05标准方差1.8E+032.8E+03—8.2E+036.7E+03平均值8.9E+049.1E+04—7.9E+032.7E+02标准方差4.8E+031.3E+03—8.6E+031.3E+01平均值4.8E+043.1E+042.3E+042.8E+033.9E+02标准方差5.0E+026.4E+021.3E+024.4E+011.0E+01平均值3.9E+042.2E+044.1E+032.1E+032.8E+02标准方差3.7E+036.4E+023.9E+025.8E+021.3E+01平均值4.0E+041.9E+04—5.0E+044.1E+03标准方差1.0E+035.5E+02—2.5E+037.8E+02平均值4.1E+042.1E+04—3.8E+052.5E+05标准方差1.1E+034.9E+02—6.1E+044.8E+03

表5 Friedman测试在OBL-μTLBO和非微种群算法上所得排序结果

Table 5 Ranking obtained by Friedman′s test for OBL-μTLBO and non-micro-population algorithms

算法排序OBL-μTLBO1.3846TLBO-CSWL2.7569Rcr-JADE-s43.1154TLBO3.9231FSADE4.0000

表6 Bonferroni-Dunn、Holm和Hochberg在OBL-μTLBO和非微种群算法上所得p值

Table 6 p-values obtained by Bonferroni-Dunn′s,Holm′s,and Hochberg′s procedures for OBL-μTLBOand non-micro-population algorithms

算法Bonferroni-DunnHolmHochbergFSADE9.90E-059.90E-059.90E-05TLBO1.70E-041.28E-041.28E-04Rcr-JADE-s42.10E-021.05E-021.05E-02

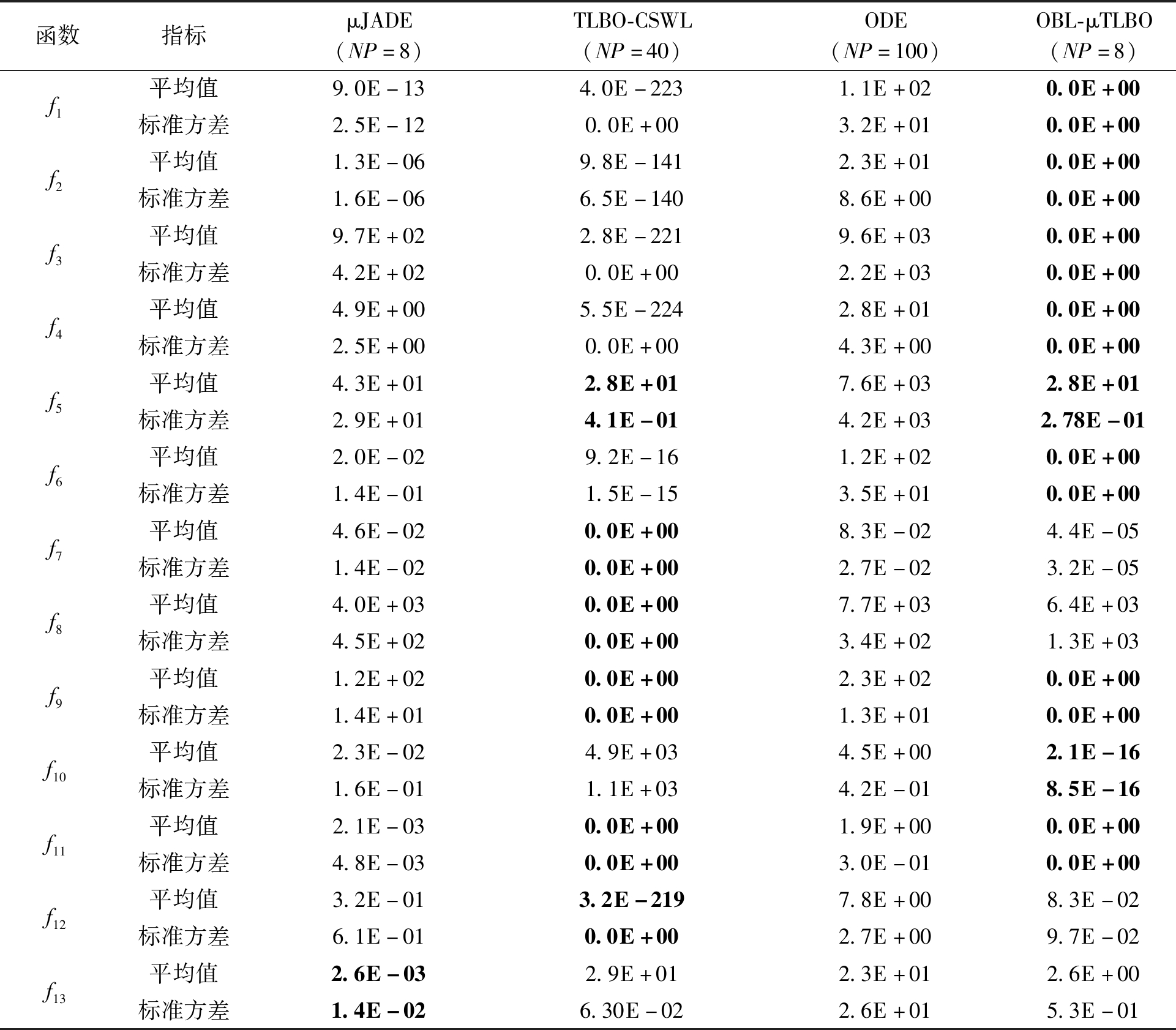

3.3 OBL-μTLBO与μJADE、TLBO-CSWL、ODE的比较

为进一步验证OBL-μTLBO算法的寻优性能,本部分将对OBL-μTLBO算法与表现较好的微种群算法μJADE和非微种群算法TLBO-CSWL、ODE进行性能比较。与3.1和3.2节不同,在本实验中,所有算法终止条件设定为最大的适应度函数评价次数,即30 000。同时,μJADE、ODE、TLBO-CSWL的种群规模分别设定为8、100、40。所得结果见表7。从表7可以看出,OBL-μTLBO 算法在f1、f2、f3、f4、f5、f6、f7、f9、f10、f11、f12上得到的平均结果明显优于μJADE算法。而μJADE只在f8和f13这两个函数上要比所提算法表现得好。这足以说明OBL-μTLBO算法的寻优效率要好于μJADE算法。相比于TLBO-CSWL,除测试函数f7、f8、f12外,OBL-μTLBO算法在所有函数上都要比它表现得好。此外,OBL-μTLBO算法在所有测试函数上的优化结果都要好于ODE。综上,OBL-μTLBO算法不仅具有较快的收敛速度和能够降低计算内存的要求,而且还有较强的全局搜索能力。

表7 所有比较算法30维仿真测试结果

Table 7 Experimental results on all Comparison algorithms with 30 D

函数指标μJADE(NP=8)TLBO-CSWL(NP=40)ODE(NP=100)OBL-μTLBO(NP=8)f1f2f3f4f5f6f7f8f9f10f11f12f13平均值9.0E-134.0E-2231.1E+020.0E+00标准方差2.5E-120.0E+003.2E+010.0E+00平均值1.3E-069.8E-1412.3E+010.0E+00标准方差1.6E-066.5E-1408.6E+000.0E+00平均值9.7E+022.8E-2219.6E+030.0E+00标准方差4.2E+020.0E+002.2E+030.0E+00平均值4.9E+005.5E-2242.8E+010.0E+00标准方差2.5E+000.0E+004.3E+000.0E+00平均值4.3E+012.8E+017.6E+032.8E+01标准方差2.9E+014.1E-014.2E+032.78E-01平均值2.0E-029.2E-161.2E+020.0E+00标准方差1.4E-011.5E-153.5E+010.0E+00平均值4.6E-020.0E+008.3E-024.4E-05标准方差1.4E-020.0E+002.7E-023.2E-05平均值4.0E+030.0E+007.7E+036.4E+03标准方差4.5E+020.0E+003.4E+021.3E+03平均值1.2E+020.0E+002.3E+020.0E+00标准方差1.4E+010.0E+001.3E+010.0E+00平均值2.3E-024.9E+034.5E+002.1E-16标准方差1.6E-011.1E+034.2E-018.5E-16平均值2.1E-030.0E+001.9E+000.0E+00标准方差4.8E-030.0E+003.0E-010.0E+00平均值3.2E-013.2E-2197.8E+008.3E-02标准方差6.1E-010.0E+002.7E+009.7E-02平均值2.6E-032.9E+012.3E+012.6E+00标准方差1.4E-026.30E-022.6E+015.3E-01

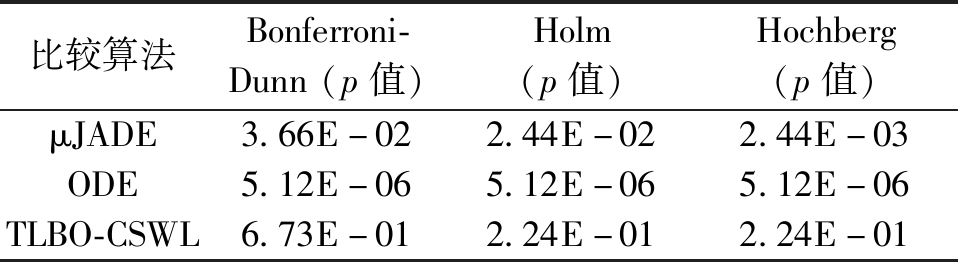

为得到可靠结论,3种非参数统计分析方法被用来对所有比较算法的平均值进行统计分析,其结果见表8。由表8可知,OBL-μTLBO算法的性能要明显优于μJADE和ODE。另外,虽然OBL-μTLBO算法和TLBO-CSWL算法的性能在统计学意义上不存在显著性的差异,但是从表7中的结果可知,OBL-μTLBO算法的整体性能要优于TLBO-CSWL算法。

表8 Bonferroni-Dunn、Holm在OBL-μTLBO和其他3种算法上所得p值

Table 8 p-values obtained by Bonferroni-Dunn′s,Holm′s,and Hochberg′s procedures for OBL-μTLBO and three algorithms

比较算法Bonferroni-Dunn(p值)Holm(p值)Hochberg(p值)μJADE3.66E-022.44E-022.44E-03ODE5.12E-065.12E-065.12E-06TLBO-CSWL6.73E-012.24E-012.24E-01

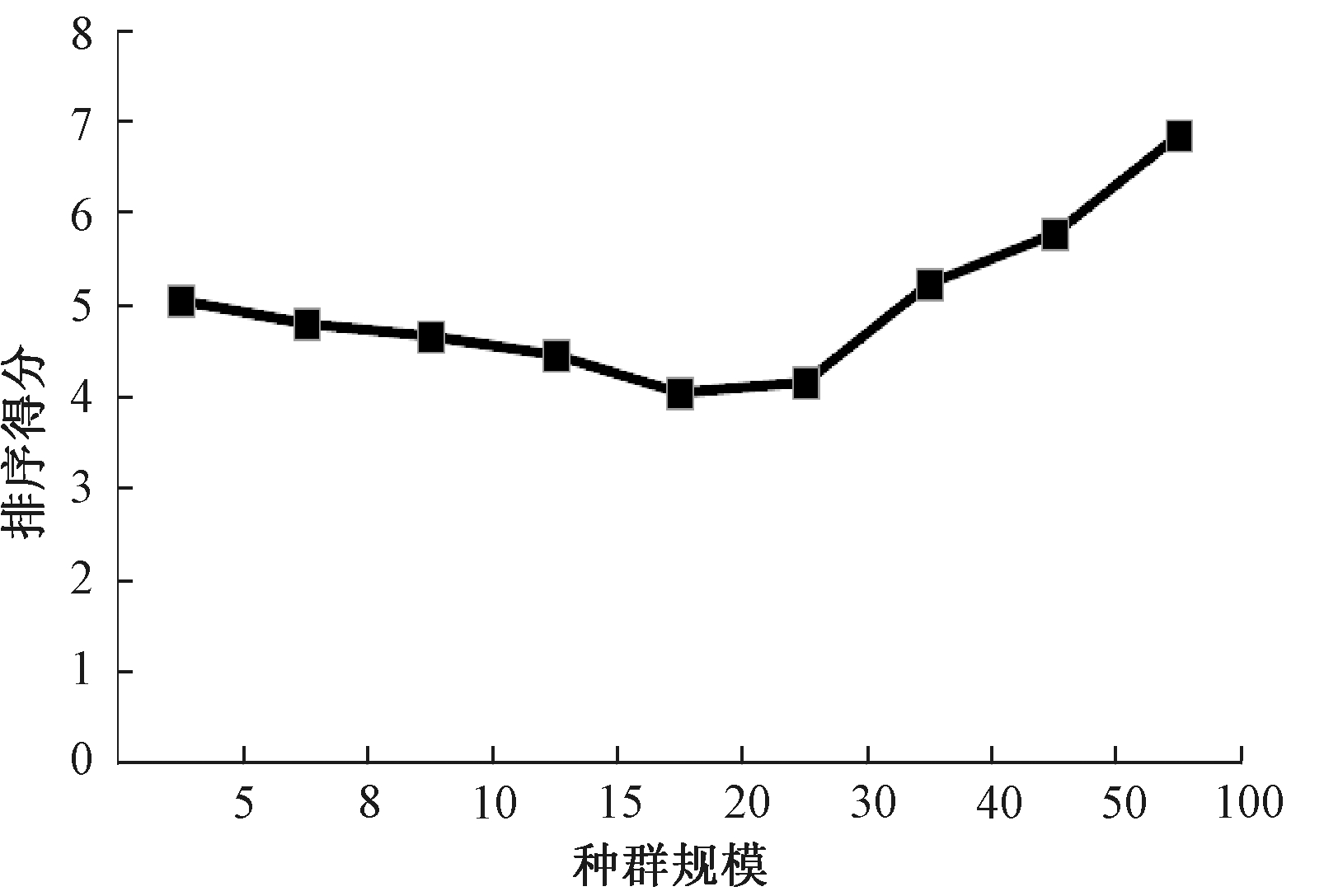

3.4 种群规模的敏感性分析

本部分对OBL-μTLBO算法的种群规模进行敏感性分析。其种群规模分别设定为5、8、10、15、20、30、40、50、100。对于每个测试函数,算法终止条件设定为最大适应度函数评价次数30 000,并使用13个30维的测试函数来对不同的种群规模进行分析。同时,Friedman统计方法用来对实验结果进行统计分析,结果见表9。从表9可知,种群规模对OBL-μTLBO算法的性能没有显著影响。因此,算法使用者可以对OBL-μTLBO算法的种群规模进行方便设置。此外,从Friedman的排序结果(见图1)来看,在有限的计算资源且要保证算法良好寻优能力的情况下,较小的种群规模更有利于OBL-μTLBO算法的搜索。

表9 OBL-μTLBO算法的种群规模敏感性分析

Table 9 Sensitivity analysis to population size of OBL-μTLBO

Friedman值χ2值p值1.119.498.93E-01

图1 Friedman 测试排序结果

Figure 1 Ranking obtained by Friedman′s test

4 OBL-μTLBO算法在非合作博弈问题中的应用

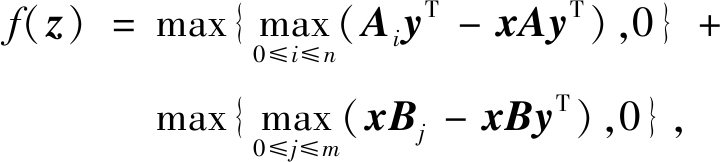

4.1 博弈问题描述

假设有n个局中人参与博弈,所有局中人策略构成一个策略组合(strategy profile),如果某情况下无一参与者可以独自行动而增加收益(即为了自身利益的最大化,没有任何单独的一方愿意改变其策略),此时博弈模型处于稳定的状态,此策略组合被称为纳什均衡。参考文献[13]中的问题描述,对于两人有限非合作博弈问题:设局中人1的混合策略x=(x1,x2,…,xm),局中人2的混合策略y=(y1,y2,…,yn)。Am×n、Bm×n分别为局中人1和局中人2的支付矩阵,则局中人1和局中人2的期望支付分别为xAyT和xByT。其中,(x*,y*)为双矩阵博弈问题的一个纳什均衡解的充分必要条件为:

(7)

算法中的每个个体的取值表示所有局中人的混合策略,则双矩阵博弈问题z=(x,y)的适应度函数可以表示为:

(8)

式中:Ai表示Am×n的第i行;Bj表示Bm×n的第j列。

根据纳什均衡的定义和性质[10]可知,混合局势z*=(x*,y *)为双矩阵博弈问题的一个纳什均衡解的充分必要条件为:存在z*=(x*,y *),使得f(z*)=0,且对于任意的z≠z*,都有f(z)>0。

4.2 案例研究

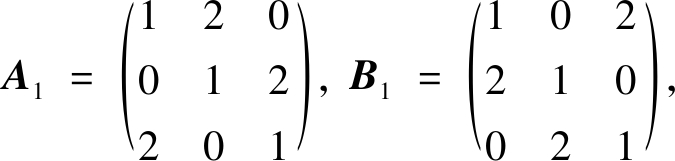

选取两个双矩阵博弈问题[26-27]。

例1:博弈模型1,Γ1≡(x1,y1;A1,B1),支付矩阵如下:

该问题的唯一纳什均衡解为(1/3,1/3,1/3;1/3,1/3,1/3)。

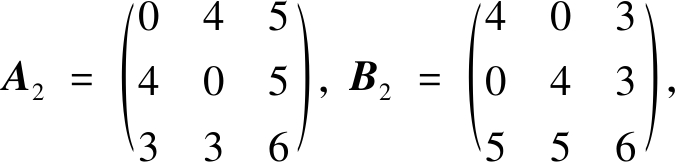

例2:博弈模型2,Γ2≡(x2,y2;A2,B2),支付矩阵如下:

该问题的唯一纳什均衡解为(0,0,1;0,0,1)。

为了验证微种群算法OBL-μTLBO求解非合作博弈纳什均衡问题的有效性,将OBL-μTLBO算法和测试中性能较好的TLBO-CSWL[19]算法应用于求解以上两个3维双矩阵博弈问题,并与其他几种知名算法jDE[28]、SaDE[29]、CLPSO[30]进行性能比较。其中OBL-μTLBO 的种群规模设定为8,而其余所有对比算法的参数设定均与对比文献[6]一致。求解结果使用Wilcoxon秩和检验[31]

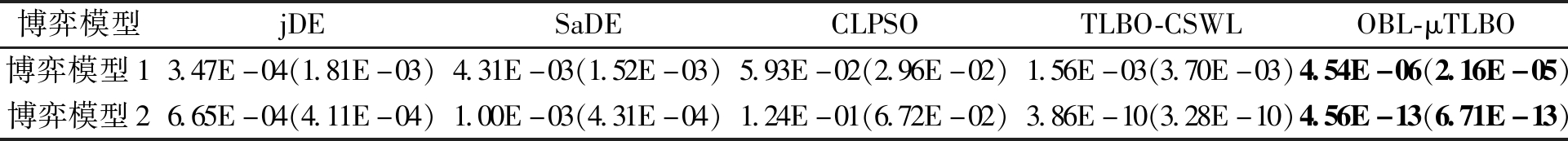

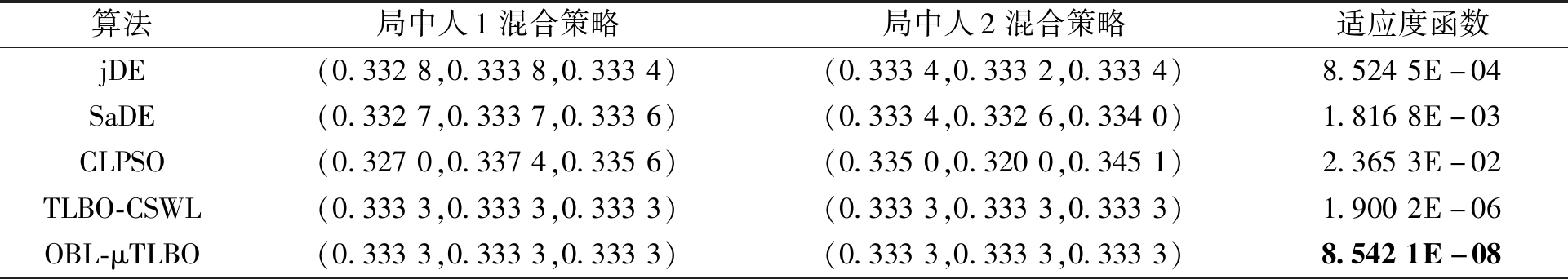

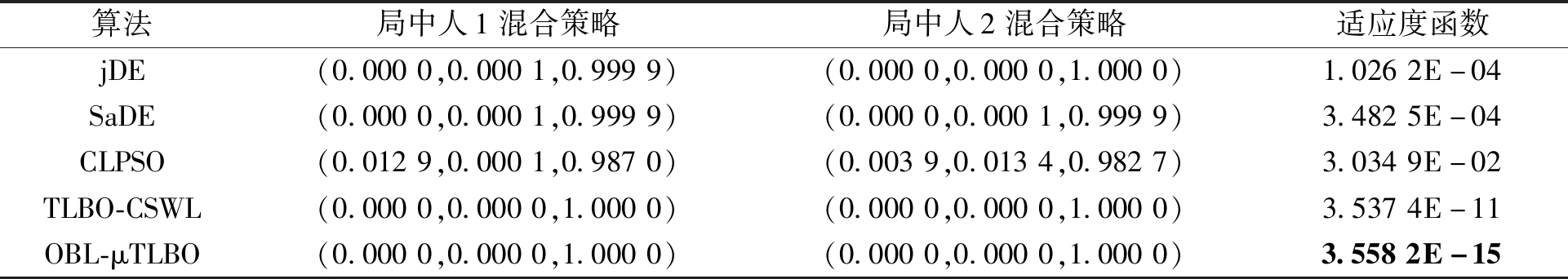

所有算法的求解结果(平均值和标准方差,括号内是标准方差)以及统计分析结果见表10。从表10中可以看出,OBL-μTLBO 算法在两个博弈实例上所得平均值均要好于所比较算法。表11和表12为所有算法在算例1和算例2上得到的最好结果。从表11和12可以看出,OBL-μTLBO算法在两个算法上均可以取得最优的纳什均衡解,且求解的适应度函数精度明显优于jDE、SaDE、CLPSO以及TLBO-CSWL算法。

表10 所有算法在博弈问题上得到的实验结果

Table 10 Experimental results of all algorithms on game problems

博弈模型jDESaDECLPSOTLBO-CSWLOBL-μTLBO博弈模型13.47E-04(1.81E-03)4.31E-03(1.52E-03)5.93E-02(2.96E-02)1.56E-03(3.70E-03)4.54E-06(2.16E-05)博弈模型26.65E-04(4.11E-04)1.00E-03(4.31E-04)1.24E-01(6.72E-02)3.86E-10(3.28E-10)4.56E-13(6.71E-13)

表11 所有算法在博弈算例1上得到的最好结果

Table 11 The best experimental results of all algorithms on game problem 1

算法局中人1混合策略局中人2混合策略适应度函数jDE(0.3328,0.3338,0.3334)(0.3334,0.3332,0.3334)8.5245E-04SaDE(0.3327,0.3337,0.3336)(0.3334,0.3326,0.3340)1.8168E-03CLPSO(0.3270,0.3374,0.3356)(0.3350,0.3200,0.3451)2.3653E-02TLBO-CSWL(0.3333,0.3333,0.3333)(0.3333,0.3333,0.3333)1.9002E-06OBL-μTLBO(0.3333,0.3333,0.3333)(0.3333,0.3333,0.3333)8.5421E-08

表12 所有算法在博弈算例2上得到的最好结果

Table 12 The best experimental results of all algorithms on game problem 2

算法局中人1混合策略局中人2混合策略适应度函数jDE(0.0000,0.0001,0.9999)(0.0000,0.0000,1.0000)1.0262E-04SaDE(0.0000,0.0001,0.9999)(0.0000,0.0001,0.9999)3.4825E-04CLPSO(0.0129,0.0001,0.9870)(0.0039,0.0134,0.9827)3.0349E-02TLBO-CSWL(0.0000,0.0000,1.0000)(0.0000,0.0000,1.0000)3.5374E-11OBL-μTLBO(0.0000,0.0000,1.0000)(0.0000,0.0000,1.0000)3.5582E-15

以上分析结果表明,所提出的OBL-μTLBO算法能够有效地求解非合作博弈纳什均衡问题。

5 结论

为平衡微种群教与学优化算法的全局和局部搜索能力,笔者提出了OBL-μTLBO算法。在该算法中,利用微种群来提高教与学优化算法的收敛速率,且在教学阶段加入了反向学习来指导种群进化,使算法具备反向学习的能力,提高了算法的全局探索能力。OBL-μTLBO算法跟μJADE、DESP、MDEVM、MDEVM-Fajfar等微种群算法和FSADE、Rcr-JADE-s4、TLBO、TLBO-CSWL、ODE等非微种群算法进行性能比较,结果表明,OBL-μTLBO算法的整体性能在所有比较算法中是最好的。因此,反向学习策略对于提升微种群算法的优化性能是有效的。另外,对OBL-μTLBO算法的种群规模进行敏感性分析。统计分析结果表明,OBL-μTLBO算法的性能不受种群大小影响,但在有限计算资源下,小的种群规模更有利于其搜索。最后,将OBL-μTLBO算法应用到非合作博弈问题,仿真结果表明,所提OBL-μTLBO算法能够取得较好的优化结果。

[1] RAO R V,SAVSANI V J,VAKHARIA D P.Teaching-learning-based optimization:an optimization method for continuous non-linear large scale problems[J].Information sciences,2012,183(1):1-15.

[2] RAO R V,SAVSANI V J,VAKHARIA D P.Teaching-learning-based optimization:a novel method for constrained mechanical design optimization problems[J].Computer-aided design,2011,43(3):303-315.

[3] 于坤杰,王昕,王振雷.基于反馈的精英教学优化算法[J].自动化学报,2014,40(9):1976-1983.

[4] MALLIPEDDI R,SUGANTHAN P N.Empirical study on the effect of population size on differential evolution algorithm[C]//IEEE Congress on Evolutionary Computation.Hong Kong:IEEE,2008:3663-3670.

[5] REN X,CHEN Z Z,MA Z.Differential evolution using smaller population[C]//Second International Conference on Machine Learning and Computing.Bangalore:IEEE,2010:76-80.

[6] BROWN C,JIN Y C,LEACH M,et al.μJADE:adaptive differential evolution with a small population[J].Soft computing,2016,20(10):4111-4120.

[7] GONG W Y,CAI Z H,WANG Y.Repairing the crossover rate in adaptive differential evolution[J].Applied soft computing,2014,15:149-168.

[8] MARQUEZ-GRAJALES A,MEZURA-MONTES E.μJADEε:micro adaptive differential evolution to solve constrained optimization problems[C]// IEEE Congress on Evolutionary Cmputation.Vancouver:IEEE,2016:4183-4190.

[9] SALEHINEJAD H,RAHNAMAYAN S,TIZHOOSH H R,et al.Micro-differential evolution with vectorized random mutation factor[C]// IEEE Congress on Evolutionary Computation.Beijing:IEEE,2014:2055-2062.

[10] NASH J.Non-cooperative games[J].The annals of mathematics,1951,54(2):286.

[11] 陈士俊,孙永广,吴宗鑫.一种求解NASH均衡解的遗传算法[J].系统工程,2001,19(5):67-70.

[12] 邱中华,高洁,朱跃星.应用免疫算法求解博弈问题[J].系统工程学报,2006,21(4):398-404.

[13] 贾文生,向淑文,杨剑锋,等.基于免疫粒子群算法的非合作博弈Nash均衡问题求解[J].计算机应用研究,2012,29(1):28-31.

[14] 王志勇,韩旭,许维胜,等.基于改进蚁群算法的纳什均衡求解[J].计算机工程,2010,36(14):166-168,171.

[15] TIZHOOSH H R.Opposition-based learning:a new scheme for machine intelligence[C]// International Conference on Computational Intelligence for Modelling,Control and Automation and International Conference on Intelligent Agents,Web Technologies and Internet Commerce.Vienna:IEEE,2005.

[16] WANG W J,WANG H,SUN H,et al.Using opposition-based learning to enhance differential evolution:a comparative study[C]// IEEE Congress on Evolutionary Computation.Vancouver:IEEE,2016:71-77.

[17] WANG H,WU Z J,RAHNAMAYAN S,et al.Enhancing particle swarm optimization using generalized opposition-based learning[J].Information sciences,2011,181(20):4699-4714.

[18] CHEN X,YU K J,DU W L,et al.Parameters identification of solar cell models using generalized oppositional teaching learning based optimization[J].Energy,2016,99:170-180.

[19] 柳缔西子,范勤勤,胡志华.基于混沌搜索和权重学习的教与学优化算法及其应用[J].智能系统学报,2018,13(5):818-828.

[20] SHARMA H,SHRIVASTAVA P,BANSAL J C,et al.Fitness based selfadaptive differential evolution[M]//Nature Inspired Cooperative Strategies for Optimization(NICSO 2013).Cham:Springer International ![]() 2014:71-84.

2014:71-84.

[21] RAHNAMAYAN S,TIZHOOSH H R,SALAMA M M A.Opposition-based differential evolution[J].IEEE transactions on evolutionary computation,2008,12(1):64-79.

[22] FAJFAR I,TUMA T,PUHAN J,et al.Towards smaller populations in differential evolution[J].Journal of microelectronics,electronic components and materials,2012,42(3):152-163.

[23] FRIEDMAN M.The use of ranks to avoid the assumption of normality implicit in the analysis of variance[J].Journal of the emerican statistical association,1939,34(205):109.

[24] DUNN O J.Multiple comparisons among means[J].Journal of the american statistical association,1961,56(293):52-64.

[25] GARCíA S,MOLINA D,LOZANO M,et al.A study on the use of non-parametric tests for analyzing the evolutionary algorithms′ behaviour:a case study on the CEC′ 2005 special session on real parameter optimization[J].Journal of heuristics,2009,15(6):617-644.

[26] WEIBULL J W.Evolutionary game theory[M].Cambridge:MIT Press,1997.

[27] WOLPERT D H,MACREADY W G.No free lunch theorems for optimization[J].IEEE transactions on evolutionary computation,1997,1(1):67-82.

[28] BREST J,GREINER S,BOSKOVIC B,et al.Self-adapting control parameters in differential evolution:a comparative study on numerical benchmark problems[J].IEEE transactions on evolutionary computation,2006,10(6):646-657.

[29] QIN A K,HUANG V L,SUGANTHAN P N.Differential evolution algorithm with strategy adaptation for global numerical optimization[J].IEEE transactions on evolutionary computation,2009,13(2):398-417.

[30] LIANG J J,QIN A K,SUGANTHAN P N,et al.Comprehensive learning particle swarm optimizer for global optimization of multimodal functions[J].IEEE transactions on evolutionary computation,2006,10(3):281-295.

[31] WILCOXON F.Individual comparisons by ranking methods[J].Biometrics bulletin,1945,1(6):80.